Agentic Physical AI toward a Domain-Specific Foundation Model for Nuclear Reactor Control

作者: Yoonpyo Lee, Kazuma Kobayashi, Sai Puppala, Sajedul Talukder, Seid Koric, Souvik Chakraborty, Syed Bahauddin Alam

分类: cs.AI, cs.LG

发布日期: 2025-12-29 (更新: 2026-01-06)

💡 一句话要点

提出Agentic Physical AI,用于核反应堆控制的领域特定基础模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 核反应堆控制 物理AI 领域特定模型 强化学习 物理验证

📋 核心要点

- 通用AI模型在物理系统控制中面临挑战,无法保证动作执行的物理约束。

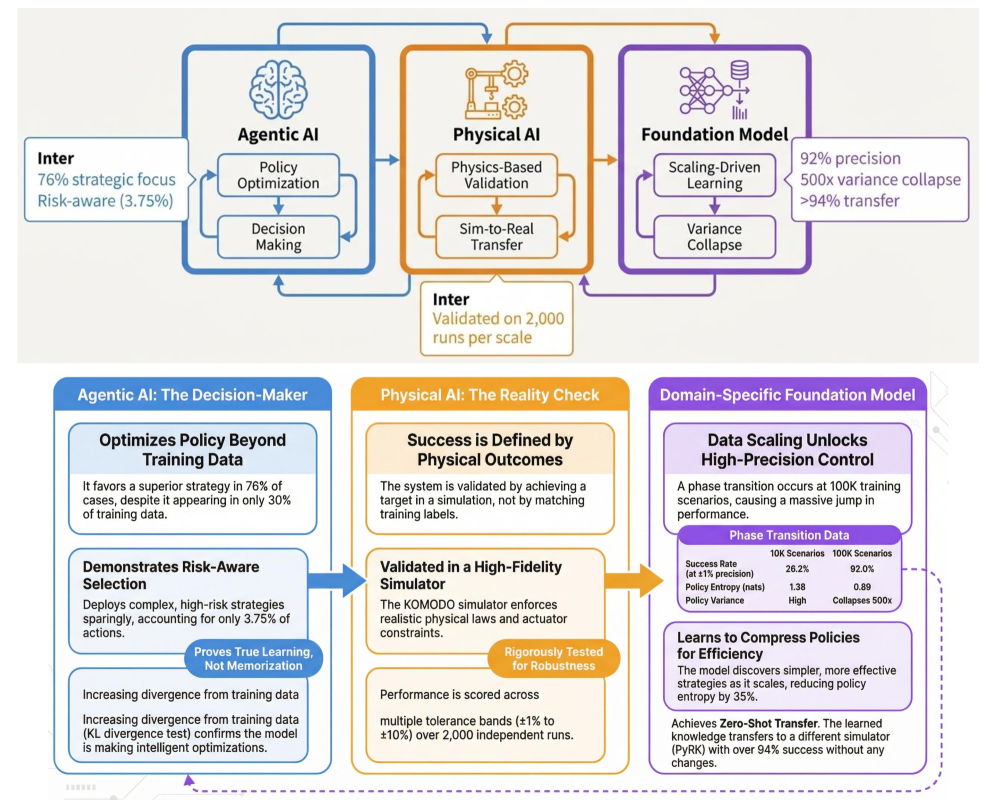

- Agentic Physical AI通过物理验证驱动策略优化,而非感知推理,构建领域特定模型。

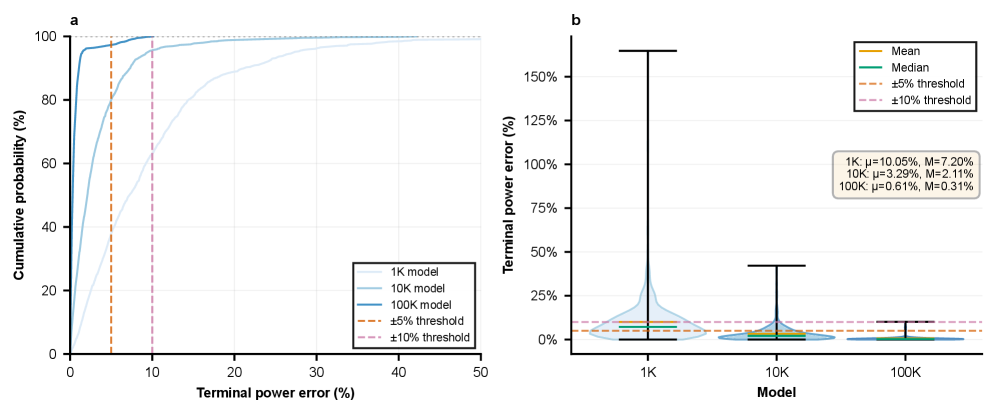

- 实验表明,大规模训练Agentic Physical AI模型可显著降低方差,稳定控制行为。

📝 摘要(中文)

当前物理系统AI的主流范式,即扩展通用基础模型以实现通用多模态推理,在控制界面面临根本性障碍。最新基准测试表明,即使是最先进的视觉-语言模型在基本定量物理任务上的准确率也仅为50-53%,表现得像近似猜测者,保留语义合理性但违反物理约束。这种输入不忠实并非缩放缺陷,而是结构性限制。以感知为中心的架构优化参数空间模仿,而安全关键控制需要对执行动作的结果空间保证。本文提出了一种根本不同的领域特定基础模型路径,引入了作为Agentic Physical AI的紧凑语言模型,其中策略优化由基于物理的验证驱动,而不是感知推理。我们在合成反应堆控制场景中训练了一个3.6亿参数的模型,将数据集从10^3扩展到10^5个示例。这引发了一般用途模型中不存在的急剧相变。小规模系统表现出具有灾难性尾部风险的高方差模仿,而大规模模型经历了超过500倍的方差崩溃,稳定了执行级别的行为。尽管平衡地暴露于四个驱动系列,该模型自主拒绝了大约70%的训练分布,并将95%的运行时执行集中在单一库策略上。学习到的表示在不同的物理和连续输入模态之间转移,而无需架构修改。

🔬 方法详解

问题定义:现有通用AI模型在物理系统控制任务中,尤其是在核反应堆控制等安全关键领域,表现出对物理规律理解不足的问题。它们倾向于模仿训练数据,但无法保证输出动作的物理合理性和安全性,导致控制性能不稳定甚至出现灾难性风险。现有方法过度依赖感知输入,忽略了物理约束的重要性。

核心思路:论文的核心思路是构建一个“Agentic Physical AI”,即一种以物理为中心的智能体。该智能体通过物理验证来驱动策略优化,而不是依赖于对环境的感知推理。这意味着模型在学习控制策略时,会优先考虑动作执行后的物理结果是否符合预期,从而保证控制的安全性。

技术框架:该方法使用一个紧凑的语言模型(3.6亿参数)作为控制策略的学习器。该模型在合成的核反应堆控制场景中进行训练,数据集规模从10^3扩展到10^5。训练过程中,模型接收反应堆状态信息作为输入,输出控制动作。关键在于,模型的优化目标不是简单地模仿训练数据,而是通过物理模拟器验证控制动作的有效性和安全性。

关键创新:该方法最重要的创新点在于将物理验证融入到策略优化过程中。与传统的基于感知的控制方法不同,Agentic Physical AI将物理约束作为学习过程的核心组成部分,从而能够学习到更加安全和可靠的控制策略。此外,该方法还展示了在不同物理和输入模态之间的迁移能力,无需修改模型架构。

关键设计:模型使用3.6亿参数的语言模型。训练数据集规模从10^3扩展到10^5,以观察模型性能的相变。模型暴露于四种不同的驱动方式,但允许模型自主选择最优策略。使用物理模拟器进行策略验证,并根据验证结果调整模型参数。具体损失函数和网络结构细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,随着训练数据规模的增加,Agentic Physical AI模型经历了显著的相变。小规模系统表现出高方差的模仿行为,而大规模模型则实现了超过500倍的方差降低,稳定了执行层面的行为。此外,模型自主拒绝了大约70%的训练分布,并将95%的运行时执行集中在单一库策略上,表明模型能够学习到最优的控制策略。

🎯 应用场景

该研究成果可应用于核反应堆控制、电力系统优化、航空航天等安全关键领域。通过构建领域特定的Agentic Physical AI模型,可以提高控制系统的安全性、可靠性和效率。未来,该方法有望推广到其他物理系统,实现更智能、更安全的自动化控制。

📄 摘要(原文)

The prevailing paradigm in AI for physical systems, scaling general-purpose foundation models toward universal multimodal reasoning, confronts a fundamental barrier at the control interface. Recent benchmarks show that even frontier vision-language models achieve only 50-53% accuracy on basic quantitative physics tasks, behaving as approximate guessers that preserve semantic plausibility while violating physical constraints. This input unfaithfulness is not a scaling deficiency but a structural limitation. Perception-centric architectures optimize parameter-space imitation, whereas safety-critical control demands outcome-space guarantees over executed actions. Here, we present a fundamentally different pathway toward domain-specific foundation models by introducing compact language models operating as Agentic Physical AI, in which policy optimization is driven by physics-based validation rather than perceptual inference. We train a 360-million-parameter model on synthetic reactor control scenarios, scaling the dataset from 10^3 to 10^5 examples. This induces a sharp phase transition absent in general-purpose models. Small-scale systems exhibit high-variance imitation with catastrophic tail risk, while large-scale models undergo variance collapse exceeding 500x reduction, stabilizing execution-level behavior. Despite balanced exposure to four actuation families, the model autonomously rejects approximately 70% of the training distribution and concentrates 95% of runtime execution on a single-bank strategy. Learned representations transfer across distinct physics and continuous input modalities without architectural modification.