Building AI Agents to Improve Job Referral Requests to Strangers

作者: Ross Chu, Yuting Huang

分类: cs.AI, cs.CL

发布日期: 2025-12-28

💡 一句话要点

构建AI Agent优化求职者向陌生人发送的职位推荐请求

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 职位推荐 AI Agent 大型语言模型 检索增强生成 文本优化

📋 核心要点

- 现有求职者难以有效撰写职位推荐请求,尤其是在向陌生人寻求帮助时,缺乏有效方法提升请求成功率。

- 论文提出利用AI Agent自动改进推荐请求,核心思想是结合大型语言模型(LLM)的生成能力和检索增强生成(RAG)策略。

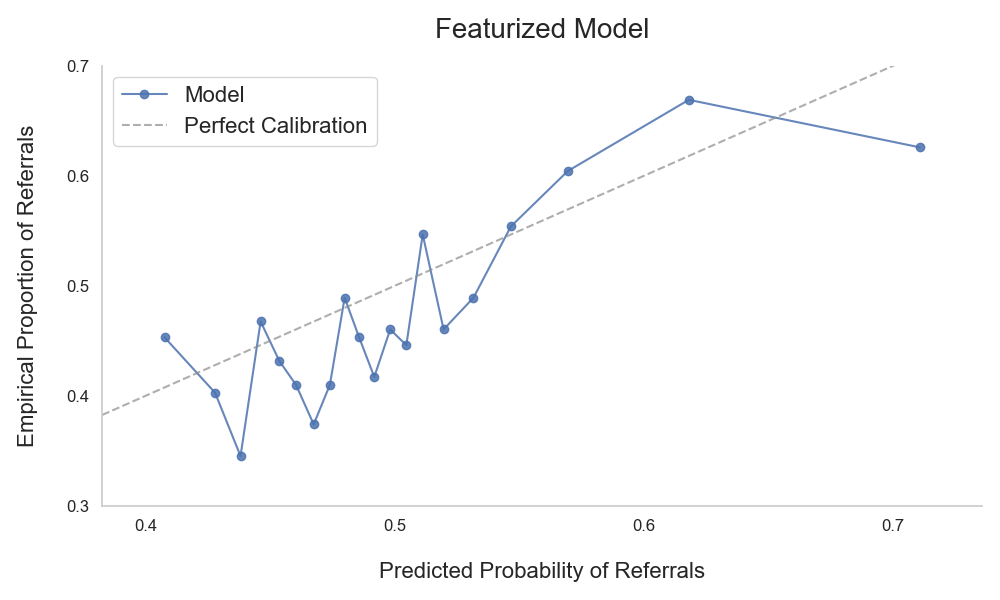

- 实验表明,结合RAG的LLM能够显著提升较弱请求的预测成功率(14%),同时避免降低较强请求的性能。

📝 摘要(中文)

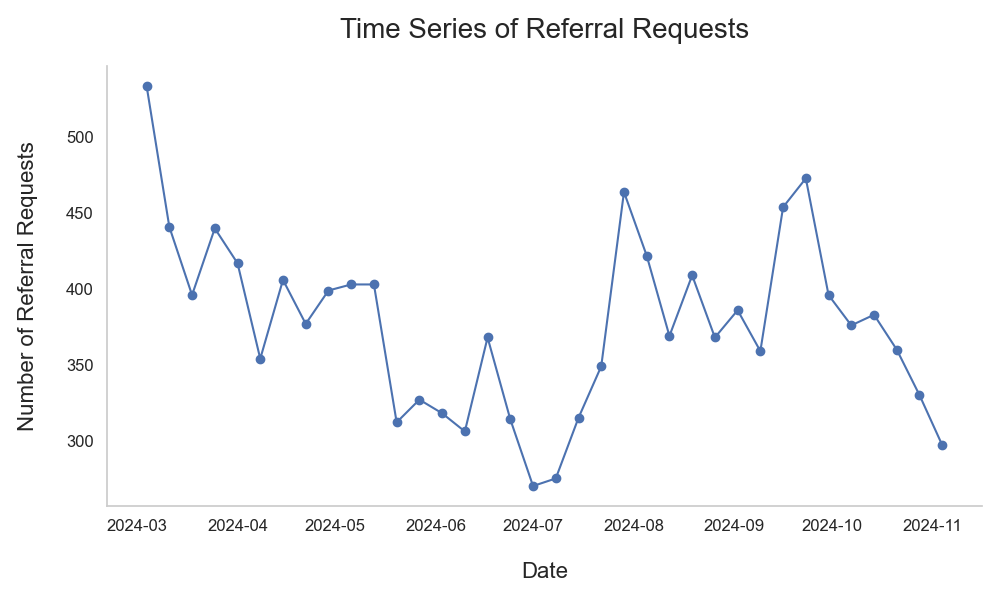

本文开发了AI Agent,旨在帮助求职者在专业在线社区中撰写有效的职位推荐请求。该工作流程主要包含两个Agent:改进Agent,用于重写推荐请求;评估Agent,使用训练好的模型评估修改质量,该模型预测收到其他用户推荐的概率。实验结果表明,大型语言模型(LLM)的修改可以提高较弱请求的预测成功率,但会降低较强请求的预测成功率。通过检索增强生成(RAG)增强LLM,可以避免对较强请求的负面影响,同时放大对较弱请求的改进。总体而言,使用RAG的LLM修改将较弱请求的预测成功率提高了14%,且不降低较强请求的性能。虽然模型预测的成功率提高并不能保证在现实世界中获得更多推荐,但它为在高风险的真实用户实验之前,提供了一种低成本的信号,用于评估有前景的特征。

🔬 方法详解

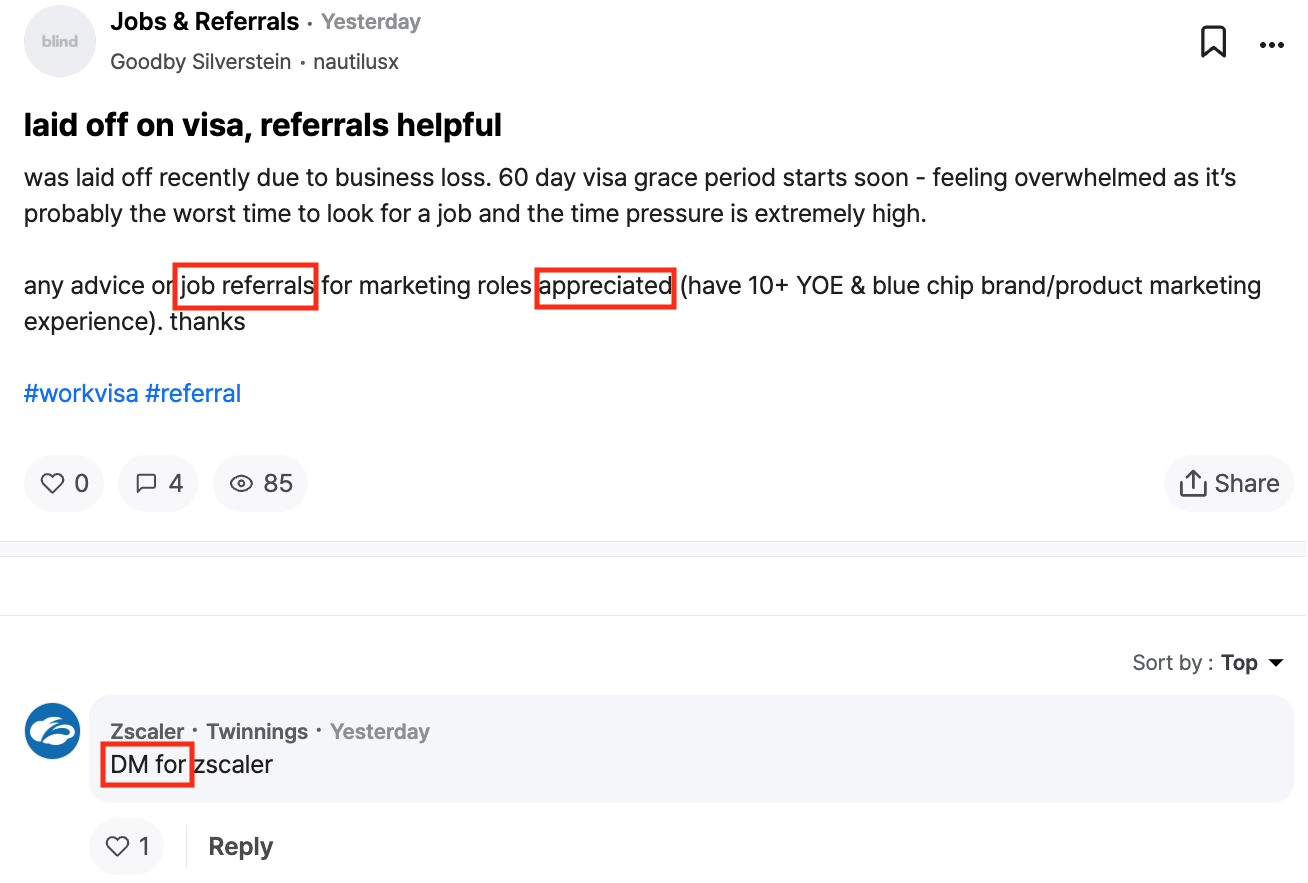

问题定义:论文旨在解决求职者在在线专业社区中,难以撰写出高效的职位推荐请求的问题。现有方法缺乏个性化和优化,导致请求成功率低,尤其是在向陌生人请求推荐时。

核心思路:论文的核心思路是利用AI Agent自动优化推荐请求。通过大型语言模型(LLM)生成更具吸引力的请求文本,并结合检索增强生成(RAG)策略,从相关信息中提取知识,提升生成质量和避免负面修改。

技术框架:整体框架包含两个主要模块:改进Agent和评估Agent。改进Agent负责重写推荐请求,它基于LLM和RAG。评估Agent则使用一个训练好的模型来预测修改后的请求被接受的可能性。该模型通过历史数据训练,预测用户收到推荐的概率。

关键创新:关键创新在于结合LLM和RAG来改进推荐请求,并使用模型预测的成功率作为优化目标。RAG的引入避免了LLM对已经较好的请求产生负面影响,同时增强了对较弱请求的改进效果。

关键设计:论文的关键设计包括:1) 使用预训练的LLM作为生成模型;2) 利用RAG从相关文档中检索信息,增强LLM的生成能力;3) 训练一个二元分类器,预测请求被接受的概率,作为评估Agent;4) 通过实验对比不同配置(如是否使用RAG)下,请求成功率的提升效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用LLM进行修改可以提高较弱请求的预测成功率,但会降低较强请求的预测成功率。通过引入RAG,可以避免对较强请求的负面影响,同时放大对较弱请求的改进。总体而言,使用RAG的LLM修改将较弱请求的预测成功率提高了14%,且不降低较强请求的性能。

🎯 应用场景

该研究成果可应用于在线招聘平台、职业社交网络等场景,帮助求职者提升职位推荐请求的成功率,提高求职效率。未来,该方法可以扩展到其他类型的文本生成任务,例如:邮件撰写、广告文案生成等,具有广泛的应用前景。

📄 摘要(原文)

This paper develops AI agents that help job seekers write effective requests for job referrals in a professional online community. The basic workflow consists of an improver agent that rewrites the referral request and an evaluator agent that measures the quality of revisions using a model trained to predict the probability of receiving referrals from other users. Revisions suggested by the LLM (large language model) increase predicted success rates for weaker requests while reducing them for stronger requests. Enhancing the LLM with Retrieval-Augmented Generation (RAG) prevents edits that worsen stronger requests while it amplifies improvements for weaker requests. Overall, using LLM revisions with RAG increases the predicted success rate for weaker requests by 14\% without degrading performance on stronger requests. Although improvements in model-predicted success do not guarantee more referrals in the real world, they provide low-cost signals for promising features before running higher-stakes experiments on real users.