Geometric Structural Knowledge Graph Foundation Model

作者: Ling Xin, Mojtaba Nayyeri, Zahra Makki Nayeri, Steffen Staab

分类: cs.AI, cs.LG

发布日期: 2025-12-28

备注: Submitted to IEEE TPAMI, under review

💡 一句话要点

Gamma:提出基于多头几何注意力的知识图谱基础模型,提升零样本归纳链接预测性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱 基础模型 几何注意力 链接预测 零样本学习

📋 核心要点

- 现有知识图谱基础模型依赖单一关系转换,表达能力受限,无法捕捉复杂关系模式。

- Gamma模型引入多头几何注意力,利用多种几何空间的关系转换,增强模型表达能力。

- 实验表明,Gamma在零样本归纳链接预测任务中显著优于Ultra,平均倒数排名提升显著。

📝 摘要(中文)

结构化知识图谱基础模型旨在将推理泛化到具有未见实体和关系的全新图谱。现有方法(如Ultra)的一个关键限制是它们在消息传递中依赖于单一的关系转换(例如,元素级乘法),这会限制表达能力,并且无法捕获不同图谱上表现出的各种关系和结构模式。本文提出了Gamma,一种新颖的基础模型,它将多头几何注意力引入知识图谱推理。Gamma用多个并行转换替换了单一关系转换,包括基于实数、复数、分裂复数和对偶数的转换,每种转换都旨在建模不同的关系结构。然后,关系条件注意力融合机制通过轻量级门控和熵正则化在链接级别自适应地融合它们,从而使模型能够稳健地强调每个三元组模式最合适的关系偏差。我们提出了这些代数消息函数的完整形式化,并讨论了它们的组合如何提高表达能力,超越任何单一空间。在56个不同的知识图谱上进行的综合实验表明,Gamma在零样本归纳链接预测方面始终优于Ultra,在归纳基准测试中平均倒数排名提高了5.5%,在所有基准测试中提高了4.4%,突出了互补几何表示的优势。

🔬 方法详解

问题定义:现有知识图谱基础模型,如Ultra,在消息传递过程中仅使用单一的关系转换方式(例如,逐元素相乘),这限制了模型对复杂关系和结构模式的建模能力,尤其是在面对包含大量未见实体和关系的全新图谱时,泛化性能会显著下降。

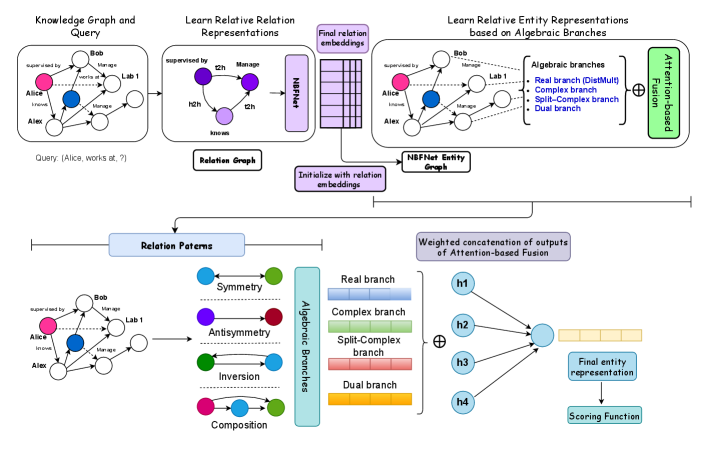

核心思路:Gamma的核心思路是利用多头几何注意力机制,通过多个并行的关系转换来增强模型的表达能力。不同的几何空间(实数、复数、分裂复数、对偶数)能够捕捉不同的关系结构,模型通过学习不同空间中的关系表示,并自适应地融合它们,从而提高对各种关系模式的建模能力。

技术框架:Gamma模型主要包含以下几个模块:1) 实体嵌入层:将实体映射到低维向量空间。2) 多头几何注意力层:使用多个并行的关系转换头,每个头基于不同的几何空间进行关系建模。3) 关系条件注意力融合层:通过轻量级门控机制和熵正则化,自适应地融合不同几何空间的关系表示。4) 链接预测层:基于融合后的关系表示进行链接预测。

关键创新:Gamma的关键创新在于引入了多头几何注意力机制,并将其应用于知识图谱推理。与现有方法仅使用单一关系转换不同,Gamma利用多个并行的关系转换头,每个头基于不同的几何空间进行关系建模,从而能够捕捉更丰富的关系结构。此外,关系条件注意力融合机制能够自适应地融合不同几何空间的关系表示,进一步提高了模型的表达能力。

关键设计:Gamma的关键设计包括:1) 使用实数、复数、分裂复数和对偶数等多种几何空间进行关系建模。2) 使用关系条件注意力融合机制,通过轻量级门控机制和熵正则化,自适应地融合不同几何空间的关系表示。3) 使用交叉熵损失函数进行链接预测任务的训练。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

Gamma在56个不同的知识图谱上进行了实验,结果表明,Gamma在零样本归纳链接预测方面始终优于Ultra。在归纳基准测试中,Gamma的平均倒数排名(MRR)提高了5.5%,在所有基准测试中提高了4.4%。这些结果表明,Gamma的多头几何注意力机制能够有效地捕捉复杂的关系结构,并提高模型的泛化性能。

🎯 应用场景

Gamma模型可应用于各种知识图谱相关的任务,例如知识图谱补全、实体消歧、关系抽取等。其在零样本归纳链接预测方面的优异性能使其在处理包含大量未见实体和关系的全新图谱时具有显著优势。该研究有助于构建更强大的知识图谱基础模型,为人工智能应用提供更可靠的知识支撑。

📄 摘要(原文)

Structural knowledge graph foundation models aim to generalize reasoning to completely new graphs with unseen entities and relations. A key limitation of existing approaches like Ultra is their reliance on a single relational transformation (e.g., element-wise multiplication) in message passing, which can constrain expressiveness and fail to capture diverse relational and structural patterns exhibited on diverse graphs. In this paper, we propose Gamma, a novel foundation model that introduces multi-head geometric attention to knowledge graph reasoning. Gamma replaces the single relational transformation with multiple parallel ones, including real, complex, split-complex, and dual number based transformations, each designed to model different relational structures. A relational conditioned attention fusion mechanism then adaptively fuses them at link level via a lightweight gating with entropy regularization, allowing the model to robustly emphasize the most appropriate relational bias for each triple pattern. We present a full formalization of these algebraic message functions and discuss how their combination increases expressiveness beyond any single space. Comprehensive experiments on 56 diverse knowledge graphs demonstrate that Gamma consistently outperforms Ultra in zero-shot inductive link prediction, with a 5.5% improvement in mean reciprocal rank on the inductive benchmarks and a 4.4% improvement across all benchmarks, highlighting benefits from complementary geometric representations.