Lessons from Neuroscience for AI: How integrating Actions, Compositional Structure and Episodic Memory could enable Safe, Interpretable and Human-Like AI

作者: Rajesh P. N. Rao, Vishwas Sathish, Linxing Preston Jiang, Matthew Bryan, Prashant Rangarajan

分类: cs.AI, physics.bio-ph, q-bio.NC

发布日期: 2025-12-27

💡 一句话要点

融合动作、组合结构与情景记忆,提升AI安全性、可解释性和类人能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 认知科学 神经科学 动作模型 情景记忆 组合结构 可解释性AI

📋 核心要点

- 现有大型语言模型缺乏与环境交互的动作机制,导致对世界的理解不深刻,容易产生幻觉。

- 该论文提出将动作、组合结构和情景记忆融入基础模型,使其更接近人类的认知方式。

- 通过借鉴神经科学和认知科学的发现,有望提升AI的安全性、可解释性和能源效率。

📝 摘要(中文)

近年来,大型语言模型(LLMs)和其他基础模型取得了显著进展,这主要归功于在Transformer模型上优化大规模的下一token预测损失,这是一种预测编码形式,也是神经科学和认知科学中日益流行的脑功能模型的基础。然而,当前的基础模型忽略了最先进的预测编码模型的三个重要组成部分:动作与生成模型的紧密集成、分层组合结构和情景记忆。我们提出,为了实现安全、可解释、节能和类人AI,基础模型应该将动作(在多个抽象尺度上)与组合生成架构和情景记忆相结合。我们展示了来自神经科学和认知科学的最新证据,证明了这些组成部分的重要性。我们描述了将这些缺失的组成部分添加到基础模型中如何帮助解决它们当前的一些缺陷:由于缺乏基础而产生的幻觉和对概念的肤浅理解,由于缺乏控制而产生的缺失的能动性/责任感,由于缺乏可解释性而对安全性和可信度造成的威胁,以及能源效率低下。我们将我们的提议与当前的趋势(例如,向基础模型添加思维链(CoT)推理和检索增强生成(RAG))进行比较,并讨论了用受大脑启发的组件增强这些模型的新方法。最后,我们认为,重新点燃脑科学和AI之间历史上富有成果的思想交流将有助于为安全和可解释的以人为本的AI铺平道路。

🔬 方法详解

问题定义:当前大型语言模型(LLMs)虽然在文本生成方面表现出色,但缺乏与环境交互的能力,导致其对世界的理解是片面的、不完整的。这导致了模型容易产生幻觉,并且缺乏对自身行为的责任感。此外,由于缺乏可解释性,这些模型的安全性和可信度也受到质疑。

核心思路:该论文的核心思路是借鉴神经科学和认知科学的研究成果,将动作(Actions)、组合结构(Compositional Structure)和情景记忆(Episodic Memory)这三个关键要素融入到基础模型中。通过模拟人类的认知机制,使AI能够更好地理解世界、进行推理和做出决策。

技术框架:该论文并没有提出一个具体的模型架构,而是提出了一个设计原则。其核心思想是将动作与生成模型紧密集成,构建一个分层的组合生成架构,并引入情景记忆机制。动作模块负责与环境交互,组合结构模块负责对信息进行组织和抽象,情景记忆模块负责存储和检索经验。这三个模块协同工作,共同完成任务。

关键创新:该论文的关键创新在于其对AI架构设计理念的转变。它不再仅仅关注于提高模型的预测精度,而是更加注重模型的认知能力和与环境的交互能力。通过借鉴神经科学和认知科学的成果,该论文为AI的发展提供了一个新的方向。

关键设计:论文中并未提供具体的参数设置或网络结构细节,而是侧重于概念性的框架搭建。未来的研究需要进一步探索如何将这些概念转化为具体的算法和模型,例如如何设计合适的动作空间、如何构建分层的组合结构、以及如何实现高效的情景记忆。

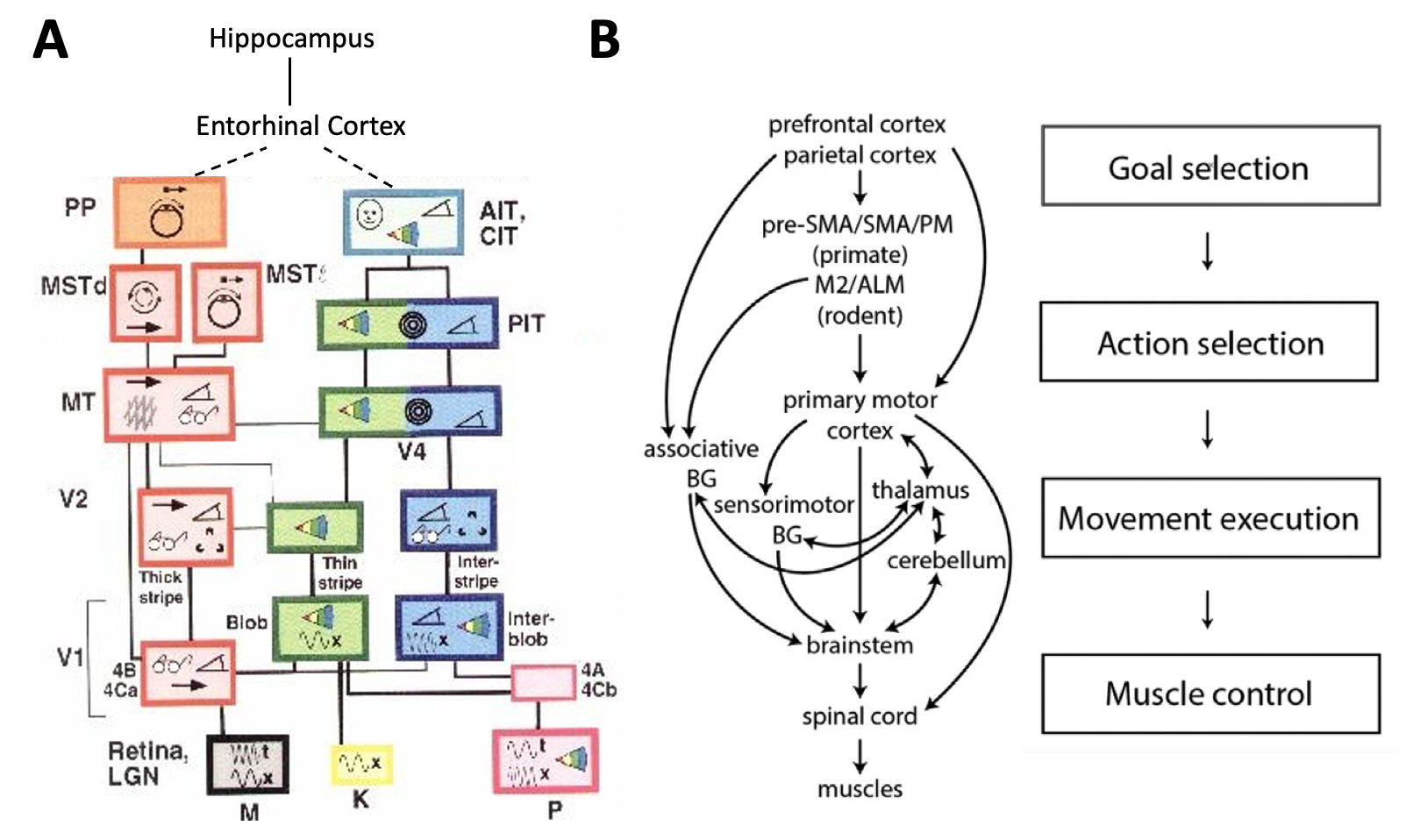

🖼️ 关键图片

📊 实验亮点

该论文主要提出了一个设计理念,并没有提供具体的实验结果。其亮点在于对现有大型语言模型的局限性进行了深刻的分析,并提出了一个有前景的解决方案。通过借鉴神经科学和认知科学的成果,该论文为AI的发展提供了一个新的方向。

🎯 应用场景

该研究的潜在应用领域包括机器人控制、自动驾驶、智能助手等。通过提升AI的认知能力和与环境的交互能力,可以使其在复杂环境中更好地完成任务。此外,该研究还有助于提高AI的安全性、可解释性和可信度,使其能够更好地服务于人类。

📄 摘要(原文)

The phenomenal advances in large language models (LLMs) and other foundation models over the past few years have been based on optimizing large-scale transformer models on the surprisingly simple objective of minimizing next-token prediction loss, a form of predictive coding that is also the backbone of an increasingly popular model of brain function in neuroscience and cognitive science. However, current foundation models ignore three other important components of state-of-the-art predictive coding models: tight integration of actions with generative models, hierarchical compositional structure, and episodic memory. We propose that to achieve safe, interpretable, energy-efficient, and human-like AI, foundation models should integrate actions, at multiple scales of abstraction, with a compositional generative architecture and episodic memory. We present recent evidence from neuroscience and cognitive science on the importance of each of these components. We describe how the addition of these missing components to foundation models could help address some of their current deficiencies: hallucinations and superficial understanding of concepts due to lack of grounding, a missing sense of agency/responsibility due to lack of control, threats to safety and trustworthiness due to lack of interpretability, and energy inefficiency. We compare our proposal to current trends, such as adding chain-of-thought (CoT) reasoning and retrieval-augmented generation (RAG) to foundation models, and discuss new ways of augmenting these models with brain-inspired components. We conclude by arguing that a rekindling of the historically fruitful exchange of ideas between brain science and AI will help pave the way towards safe and interpretable human-centered AI.