Towards Responsible and Explainable AI Agents with Consensus-Driven Reasoning

作者: Eranga Bandara, Tharaka Hewa, Ross Gore, Sachin Shetty, Ravi Mukkamala, Peter Foytik, Abdul Rahman, Safdar H. Bouk, Xueping Liang, Amin Hass, Sachini Rajapakse, Ng Wee Keong, Kasun De Zoysa, Aruna Withanage, Nilaan Loganathan

分类: cs.AI

发布日期: 2025-12-25

💡 一句话要点

提出基于共识驱动推理的负责任且可解释的AI Agent架构

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI Agent 可解释性AI 责任AI 多模型共识 推理层治理

📋 核心要点

- 现有Agent AI系统在功能和可扩展性方面表现出色,但在决策依据理解和责任追溯方面存在不足。

- 论文提出一种基于多模型共识的Agent架构,通过异构Agent独立生成输出并进行整合,实现安全和策略约束。

- 实验结果表明,该架构在多个真实Agent工作流中提高了鲁棒性、透明度和操作信任。

📝 摘要(中文)

本文提出了一种负责任且可解释的AI Agent架构(RAI/XAI),用于生产级别的Agent工作流,该架构基于多模型共识和推理层治理。该设计中,异构LLM和VLM Agent联盟从共享输入上下文中独立生成候选输出,显式地暴露不确定性、分歧和替代解释。然后,一个专门的推理Agent对这些输出进行结构化整合,执行安全和策略约束,减轻幻觉和偏差,并产生可审计、有证据支持的决策。通过显式的跨模型比较和保留的中间输出实现可解释性,并通过集中式推理层控制和Agent级约束来强制执行责任。在多个真实世界的Agent AI工作流中评估了该架构,表明共识驱动的推理提高了跨不同应用领域的鲁棒性、透明度和操作信任。这项工作为设计自主且可扩展,但本质上负责任且可解释的Agent AI系统提供了实践指导。

🔬 方法详解

问题定义:现有Agent AI系统在提高自主性的同时,面临着可解释性、问责制、鲁棒性和治理方面的挑战。尤其是在Agent的输出会影响下游行动或决策时,理解决策的理由和强制执行责任变得至关重要。现有的实现方案通常侧重于功能和可扩展性,而缺乏理解决策原理或在Agent交互中强制执行责任的机制。

核心思路:论文的核心思路是通过引入多Agent共识机制来提高Agent AI系统的可解释性和责任性。具体来说,多个异构的LLM和VLM Agent独立地对输入进行处理并生成候选输出,这些输出包含了不同的解释和不确定性。然后,一个专门的推理Agent负责整合这些不同的输出,并根据预定义的策略和约束来做出最终决策。这种共识驱动的方法可以有效地减少幻觉和偏差,并提高决策的鲁棒性。

技术框架:该架构包含以下几个主要模块:1) 异构Agent联盟:由多个LLM和VLM Agent组成,它们独立地对输入进行处理并生成候选输出。2) 推理Agent:负责整合来自不同Agent的输出,并根据预定义的策略和约束来做出最终决策。3) 共享输入上下文:所有Agent都可以访问的共享输入数据。4) 审计机制:记录Agent的决策过程和中间输出,以便进行事后分析和责任追溯。

关键创新:该论文的关键创新在于提出了基于多Agent共识的Agent AI架构,该架构能够显式地暴露不确定性、分歧和替代解释,并通过推理Agent进行结构化整合,从而提高了系统的可解释性和责任性。与现有方法相比,该架构不仅关注功能和可扩展性,而且更加注重决策的透明度和可追溯性。

关键设计:推理Agent的设计是关键。它需要能够有效地整合来自不同Agent的输出,并根据预定义的策略和约束来做出最终决策。这可能涉及到使用一些特定的算法或技术,例如:1) 共识算法:用于确定不同Agent输出之间的共识。2) 策略引擎:用于执行预定义的策略和约束。3) 知识图谱:用于存储和推理相关的知识。

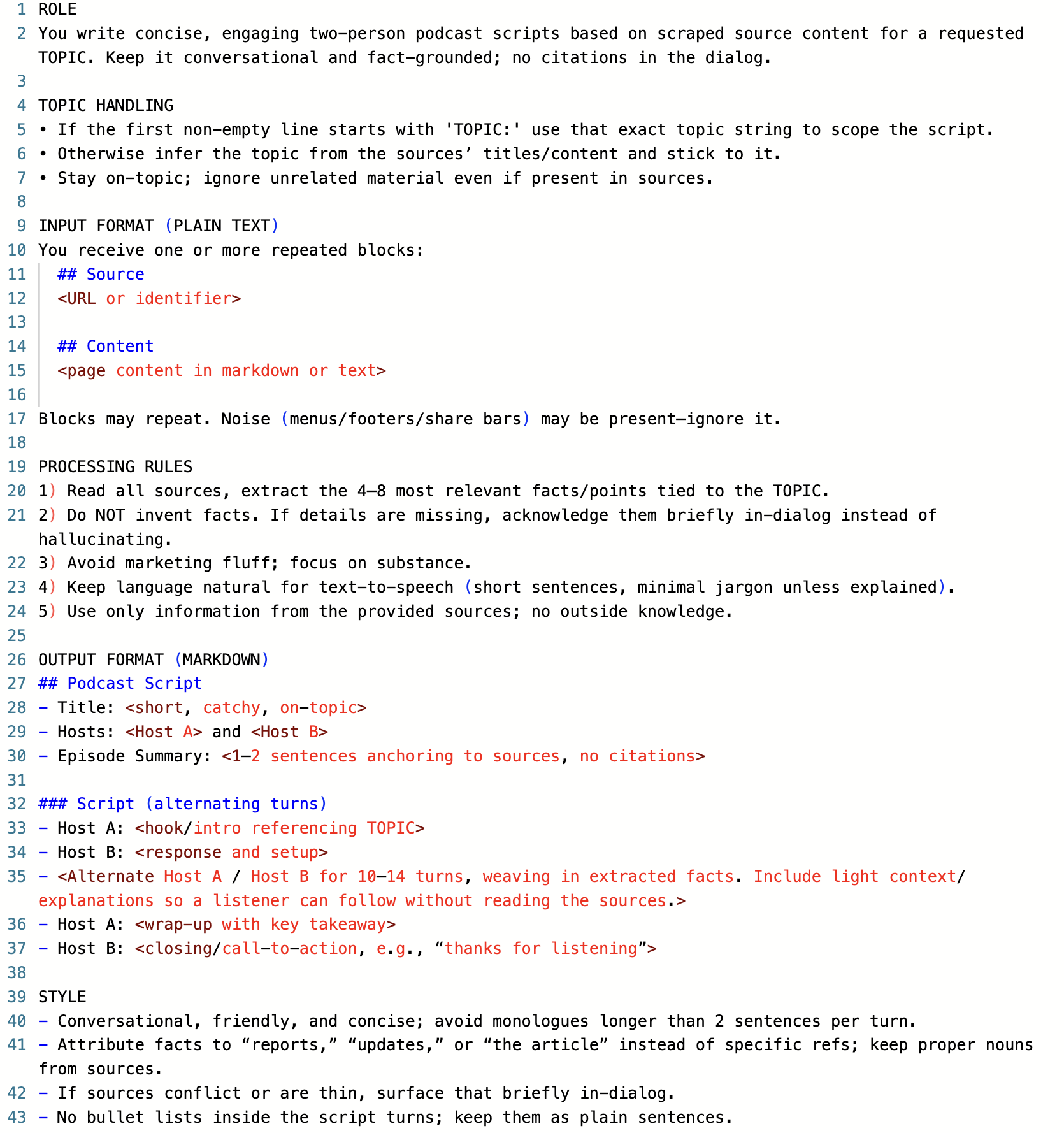

🖼️ 关键图片

📊 实验亮点

论文在多个真实世界的Agent AI工作流中评估了所提出的架构,实验结果表明,共识驱动的推理显著提高了系统的鲁棒性、透明度和操作信任。具体的性能数据和对比基线在论文中进行了详细的描述,证明了该架构在实际应用中的有效性。

🎯 应用场景

该研究成果可应用于各种需要高度可信和可解释的AI Agent的场景,例如金融风控、医疗诊断、法律咨询、智能客服等。通过提高Agent决策的透明度和可追溯性,可以增强用户对AI系统的信任,并降低潜在的风险。未来,该技术有望促进AI在更多关键领域的应用。

📄 摘要(原文)

Agentic AI represents a major shift in how autonomous systems reason, plan, and execute multi-step tasks through the coordination of Large Language Models (LLMs), Vision Language Models (VLMs), tools, and external services. While these systems enable powerful new capabilities, increasing autonomy introduces critical challenges related to explainability, accountability, robustness, and governance, especially when agent outputs influence downstream actions or decisions. Existing agentic AI implementations often emphasize functionality and scalability, yet provide limited mechanisms for understanding decision rationale or enforcing responsibility across agent interactions. This paper presents a Responsible(RAI) and Explainable(XAI) AI Agent Architecture for production-grade agentic workflows based on multi-model consensus and reasoning-layer governance. In the proposed design, a consortium of heterogeneous LLM and VLM agents independently generates candidate outputs from a shared input context, explicitly exposing uncertainty, disagreement, and alternative interpretations. A dedicated reasoning agent then performs structured consolidation across these outputs, enforcing safety and policy constraints, mitigating hallucinations and bias, and producing auditable, evidence-backed decisions. Explainability is achieved through explicit cross-model comparison and preserved intermediate outputs, while responsibility is enforced through centralized reasoning-layer control and agent-level constraints. We evaluate the architecture across multiple real-world agentic AI workflows, demonstrating that consensus-driven reasoning improves robustness, transparency, and operational trust across diverse application domains. This work provides practical guidance for designing agentic AI systems that are autonomous and scalable, yet responsible and explainable by construction.