Explainable and Fine-Grained Safeguarding of LLM Multi-Agent Systems via Bi-Level Graph Anomaly Detection

作者: Junjun Pan, Yixin Liu, Rui Miao, Kaize Ding, Yu Zheng, Quoc Viet Hung Nguyen, Alan Wee-Chung Liew, Shirui Pan

分类: cs.CR, cs.AI, cs.MA

发布日期: 2025-12-21

备注: 14 pages, 3 tables, 5 figures

💡 一句话要点

提出XG-Guard,通过双层图异常检测实现LLM多智能体系统的可解释和细粒度安全防护。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 异常检测 图神经网络 可解释性 大型语言模型 安全防护 恶意智能体检测

📋 核心要点

- 现有基于图异常检测的防御方法依赖粗粒度句子级信息,忽略细粒度词汇线索,导致检测性能受限且缺乏可解释性。

- XG-Guard通过双层智能体编码器联合建模句子级和token级表示,并利用基于主题的异常检测器捕获对话焦点。

- 实验表明,XG-Guard在不同MAS拓扑和攻击场景下表现出鲁棒的检测性能和强大的可解释性。

📝 摘要(中文)

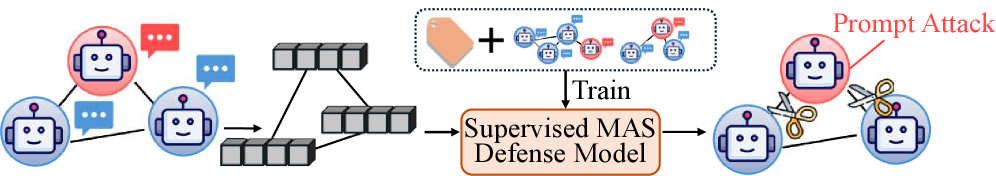

基于大型语言模型(LLM)的多智能体系统(MAS)在解决复杂任务方面表现出强大的能力。随着MAS在各种安全关键任务中变得越来越自主,检测恶意智能体已成为一个关键的安全问题。虽然现有的基于图异常检测(GAD)的防御方法可以识别异常智能体,但它们主要依赖于粗粒度的句子级信息,而忽略了细粒度的词汇线索,导致性能欠佳。此外,这些方法缺乏可解释性,限制了它们的可靠性和实际应用。为了解决这些局限性,我们提出了XG-Guard,一个可解释和细粒度的安全防护框架,用于检测MAS中的恶意智能体。为了结合粗粒度和细粒度的文本信息来识别异常智能体,我们利用双层智能体编码器来联合建模每个智能体的句子级和token级表示。一个基于主题的异常检测器进一步捕获MAS对话中不断演变的讨论焦点,而双层分数融合机制量化token级贡献以进行解释。在不同的MAS拓扑和攻击场景下进行的大量实验证明了XG-Guard的鲁棒检测性能和强大的可解释性。

🔬 方法详解

问题定义:论文旨在解决LLM多智能体系统中恶意智能体的检测问题。现有基于图异常检测的方法主要依赖于句子级别的粗粒度信息,忽略了token级别的细粒度信息,导致检测精度不高。此外,现有方法缺乏可解释性,难以判断恶意智能体的具体行为和原因。

核心思路:论文的核心思路是同时利用句子级别和token级别的文本信息,构建一个双层图异常检测模型。通过捕捉智能体之间交互的语义信息和细粒度的词汇特征,更准确地识别恶意智能体。同时,通过量化token级别的贡献,提供可解释的检测结果。

技术框架:XG-Guard框架主要包含三个模块:双层智能体编码器、基于主题的异常检测器和双层分数融合机制。首先,双层智能体编码器分别对每个智能体的句子级和token级表示进行建模。然后,基于主题的异常检测器捕获MAS对话中不断演变的讨论焦点。最后,双层分数融合机制将句子级和token级的异常分数进行融合,并量化token级贡献以进行解释。

关键创新:论文的关键创新在于提出了一个双层图异常检测模型,该模型能够同时利用句子级别和token级别的文本信息进行恶意智能体检测。此外,论文还提出了一个双层分数融合机制,能够量化token级别的贡献,提供可解释的检测结果。

关键设计:双层智能体编码器使用预训练语言模型(如BERT)对句子和token进行编码。基于主题的异常检测器使用LDA等主题模型来提取对话的主题信息。双层分数融合机制使用加权平均的方式将句子级和token级的异常分数进行融合,权重可以根据实验结果进行调整。损失函数的设计目标是最大化正常智能体和恶意智能体之间的差异。

🖼️ 关键图片

📊 实验亮点

实验结果表明,XG-Guard在各种MAS拓扑和攻击场景下均表现出优异的检测性能。相较于现有方法,XG-Guard在检测精度和召回率方面均有显著提升。此外,XG-Guard还能够提供可解释的检测结果,帮助用户理解恶意智能体的行为和原因。

🎯 应用场景

该研究成果可应用于各种基于LLM的多智能体系统,例如协同办公、智能客服、安全监控等领域。通过检测和隔离恶意智能体,可以提高系统的安全性、可靠性和公平性,防止恶意行为对系统造成损害。未来,该技术还可以扩展到其他类型的异常检测任务中。

📄 摘要(原文)

Large language model (LLM)-based multi-agent systems (MAS) have shown strong capabilities in solving complex tasks. As MAS become increasingly autonomous in various safety-critical tasks, detecting malicious agents has become a critical security concern. Although existing graph anomaly detection (GAD)-based defenses can identify anomalous agents, they mainly rely on coarse sentence-level information and overlook fine-grained lexical cues, leading to suboptimal performance. Moreover, the lack of interpretability in these methods limits their reliability and real-world applicability. To address these limitations, we propose XG-Guard, an explainable and fine-grained safeguarding framework for detecting malicious agents in MAS. To incorporate both coarse and fine-grained textual information for anomalous agent identification, we utilize a bi-level agent encoder to jointly model the sentence- and token-level representations of each agent. A theme-based anomaly detector further captures the evolving discussion focus in MAS dialogues, while a bi-level score fusion mechanism quantifies token-level contributions for explanation. Extensive experiments across diverse MAS topologies and attack scenarios demonstrate robust detection performance and strong interpretability of XG-Guard.