A Multi-agent Text2SQL Framework using Small Language Models and Execution Feedback

作者: Thanh Dat Hoang, Thanh Trung Huynh, Matthias Weidlich, Thanh Tam Nguyen, Tong Chen, Hongzhi Yin, Quoc Viet Hung Nguyen

分类: cs.DB, cs.AI, cs.CL, cs.HC, cs.MA

发布日期: 2025-12-21

🔗 代码/项目: GITHUB

💡 一句话要点

提出MATS框架,利用小语言模型和执行反馈解决Text2SQL任务,性能媲美大型语言模型。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Text2SQL 小型语言模型 多智能体系统 强化学习 执行反馈 自然语言处理 数据库查询

📋 核心要点

- 现有Text2SQL方法依赖大型语言模型,存在隐私和成本问题,而小型语言模型泛化能力不足,难以胜任复杂任务。

- MATS框架采用多智能体机制,将Text2SQL任务分解为多个专门角色,并通过智能体间的交互降低单个智能体的工作量。

- MATS利用强化学习和执行反馈对智能体进行训练,在参数量远小于大型语言模型的情况下,实现了可比的准确率。

📝 摘要(中文)

Text2SQL是从自然语言文本生成SQL查询的任务,是数据工程中的一个关键挑战。最近,大型语言模型(LLMs)由于其先进的理解和生成能力,在该任务上表现出卓越的性能。然而,隐私和成本考虑因素阻止公司使用基于外部LLMs的Text2SQL解决方案。因此,公司倾向于采用可以内部托管的、公开可用的小型语言模型(SLMs)。然而,这些SLMs缺乏大型LLMs的泛化能力,这损害了它们在Text2SQL等复杂任务中的有效性。为了解决这些限制,我们提出了一种专为SLMs设计的Text2SQL框架MATS。MATS使用多智能体机制,为辅助智能体分配专门的角色,从而减少了单个智能体的工作量并促进了交互。基于强化学习的训练方案使用执行期间获得的反馈来对齐这些智能体,从而在有限的LLM规模下保持了有竞争力的性能。在基准数据集上的评估结果表明,MATS部署在单GPU服务器上,在使用明显更少的参数时,其准确性与大型LLMs相当。我们的源代码和数据可在https://github.com/thanhdath/mats-sql上找到。

🔬 方法详解

问题定义:论文旨在解决在Text2SQL任务中使用小型语言模型(SLMs)时,由于SLMs泛化能力不足而导致性能下降的问题。现有方法要么依赖于昂贵且存在隐私风险的大型语言模型,要么无法充分利用SLMs的潜力。

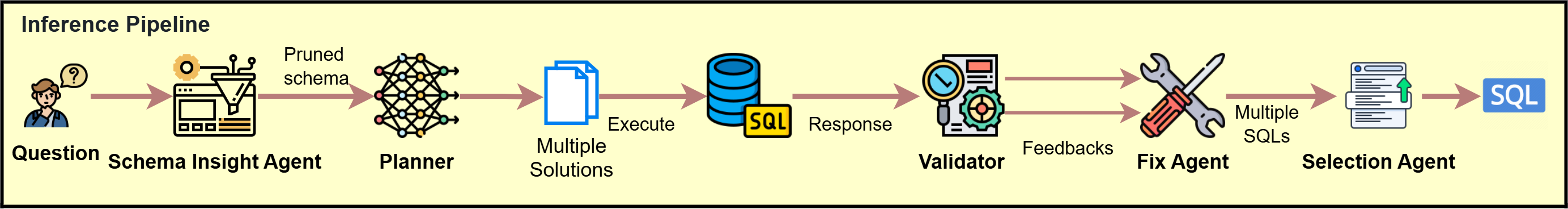

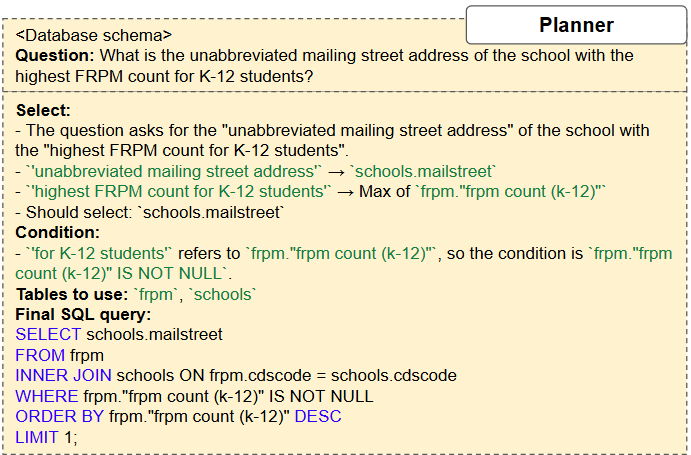

核心思路:论文的核心思路是将Text2SQL任务分解为多个子任务,并为每个子任务分配一个专门的智能体。通过智能体之间的协作和交互,可以有效地利用SLMs的有限能力,并提高整体性能。此外,利用执行反馈来指导智能体的训练,可以使其更好地适应Text2SQL任务的特点。

技术框架:MATS框架包含多个智能体,每个智能体负责Text2SQL任务的不同方面,例如问题理解、模式匹配、SQL生成等。这些智能体通过消息传递机制进行交互,共同完成Text2SQL任务。框架使用强化学习来训练智能体,奖励信号来自SQL查询的执行结果。

关键创新:MATS的关键创新在于其多智能体架构和基于执行反馈的训练方法。多智能体架构可以将复杂的Text2SQL任务分解为多个简单的子任务,从而降低了单个智能体的难度。基于执行反馈的训练方法可以使智能体更好地适应Text2SQL任务的特点,并提高整体性能。与现有方法相比,MATS能够在使用小型语言模型的情况下,实现与大型语言模型相当的性能。

关键设计:MATS框架的具体实现细节包括:智能体的数量和角色分配、消息传递机制的设计、强化学习算法的选择、奖励函数的设计等。论文中可能还涉及一些超参数的设置,例如学习率、折扣因子等。具体的网络结构和损失函数取决于所使用的具体的小型语言模型。

🖼️ 关键图片

📊 实验亮点

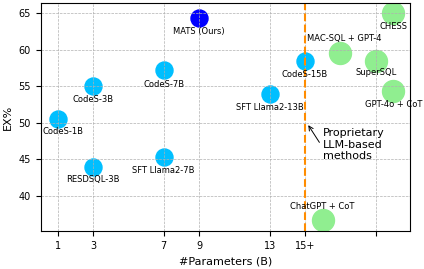

MATS框架在基准Text2SQL数据集上进行了评估,实验结果表明,在使用小型语言模型的情况下,MATS的准确率与大型语言模型相当。具体而言,MATS在某些数据集上的性能甚至超过了某些大型语言模型。此外,MATS框架可以在单GPU服务器上运行,降低了部署成本。

🎯 应用场景

MATS框架可应用于各种需要将自然语言转换为SQL查询的场景,例如智能客服、数据分析、商业智能等。该框架特别适用于对隐私和成本有较高要求的企业,因为它可以利用内部部署的小型语言模型,避免了使用外部大型语言模型的风险和成本。未来,该框架可以进一步扩展到其他自然语言处理任务中。

📄 摘要(原文)

Text2SQL, the task of generating SQL queries from natural language text, is a critical challenge in data engineering. Recently, Large Language Models (LLMs) have demonstrated superior performance for this task due to their advanced comprehension and generation capabilities. However, privacy and cost considerations prevent companies from using Text2SQL solutions based on external LLMs offered as a service. Rather, small LLMs (SLMs) that are openly available and can hosted in-house are adopted. These SLMs, in turn, lack the generalization capabilities of larger LLMs, which impairs their effectiveness for complex tasks such as Text2SQL. To address these limitations, we propose MATS, a novel Text2SQL framework designed specifically for SLMs. MATS uses a multi-agent mechanism that assigns specialized roles to auxiliary agents, reducing individual workloads and fostering interaction. A training scheme based on reinforcement learning aligns these agents using feedback obtained during execution, thereby maintaining competitive performance despite a limited LLM size. Evaluation results using on benchmark datasets show that MATS, deployed on a single- GPU server, yields accuracy that are on-par with large-scale LLMs when using significantly fewer parameters. Our source code and data are available at https://github.com/thanhdath/mats-sql.