Adaptive Accountability in Networked MAS: Tracing and Mitigating Emergent Norms at Scale

作者: Saad Alqithami

分类: cs.MA, cs.AI

发布日期: 2025-12-21

💡 一句话要点

提出自适应责任框架,用于大规模网络化多智能体系统中涌现规范的追踪与缓解。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体系统 涌现规范 责任追踪 自适应治理 去中心化检测

📋 核心要点

- 现有大规模多智能体系统易产生不良涌现规范,传统治理方法难以有效应对。

- 提出自适应责任框架,通过追踪责任流、检测有害规范和局部干预,实现智能体行为对齐。

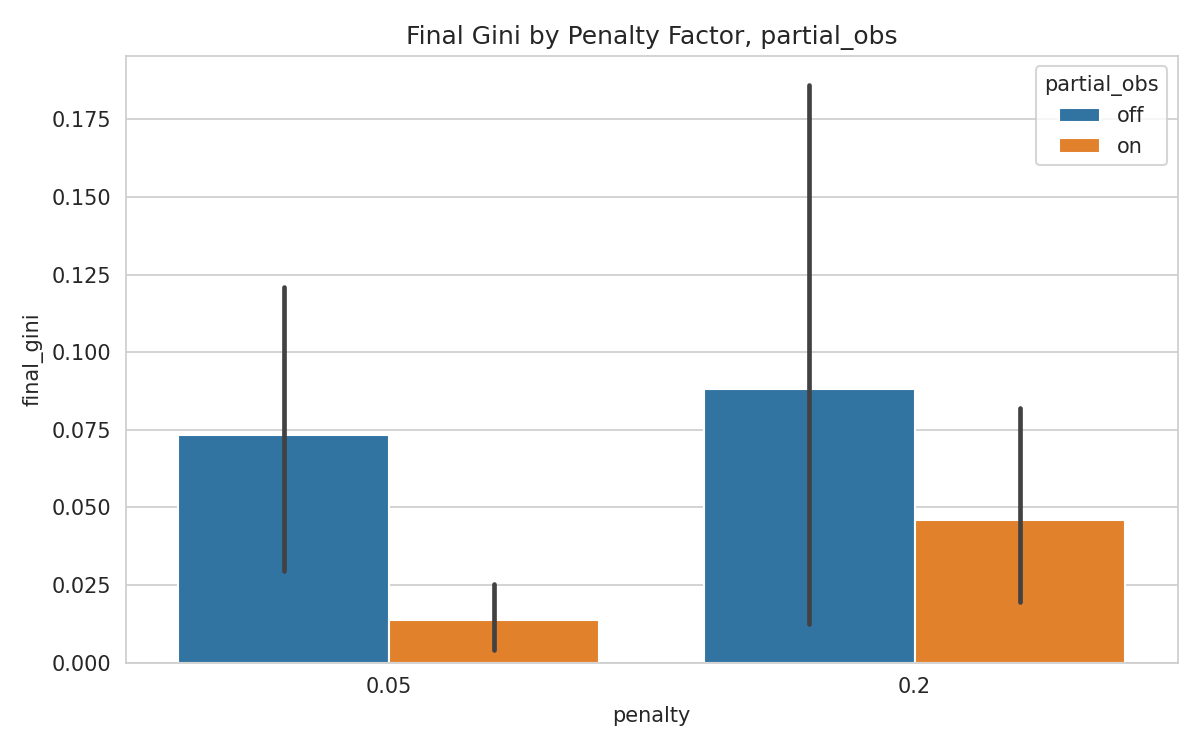

- 实验表明,该框架能有效防止勾结和资源囤积,提升集体奖励并降低不平等性。

📝 摘要(中文)

大规模网络化多智能体系统日益支撑着关键基础设施,但它们的集体行为可能偏离到传统治理机制难以控制的不良涌现规范。我们引入了一种自适应责任框架,该框架(i)通过生命周期感知的审计账本持续追踪责任流,(ii)通过去中心化的序贯假设检验在线检测有害的涌现规范,以及(iii)部署局部策略和奖励塑造干预,以近乎实时的速度使智能体与系统级目标保持一致。我们证明了一个有界妥协定理,表明只要预期的干预成本超过对手的收益,长期妥协交互的比例就会被一个严格小于1的常数所限制。对多达100个异构智能体、部分可观测性和随机通信图进行的大量高性能仿真表明,我们的框架在至少90%的配置中防止了勾结和资源囤积,将平均集体奖励提高了12-18%,并将基尼不平等指数相对于PPO基线降低了高达33%。这些结果表明,一个理论上合理的责任层可以在复杂的MAS中诱导符合伦理的、自我调节的行为,而不会牺牲性能或可扩展性。

🔬 方法详解

问题定义:大规模网络化多智能体系统(MAS)在实际应用中面临一个关键问题:由于智能体之间的复杂交互,系统容易涌现出不符合预期甚至有害的规范。现有的治理机制往往难以有效追踪和控制这些涌现规范,导致系统性能下降,甚至出现伦理问题,例如资源囤积和恶意串通。因此,如何设计一种能够动态适应并纠正这些不良涌现规范的机制,成为一个重要的挑战。

核心思路:该论文的核心思路是引入一个自适应的责任框架,该框架能够持续追踪系统中智能体的行为,检测有害的涌现规范,并通过局部干预来调整智能体的行为,使其与系统级的目标保持一致。这种方法的核心在于建立一个可追溯的责任体系,并利用去中心化的方式进行规范检测和干预,从而实现对大规模MAS的有效治理。

技术框架:该框架包含三个主要模块:(1) 责任追踪模块:通过生命周期感知的审计账本,记录系统中智能体的行为和交互,形成可追溯的责任流。(2) 涌现规范检测模块:采用去中心化的序贯假设检验方法,在线检测系统中出现的有害涌现规范。每个智能体根据自身观察到的信息,独立进行假设检验,从而实现对全局规范的分布式检测。(3) 干预模块:根据检测到的有害规范,采用局部策略和奖励塑造干预,调整智能体的行为,使其与系统级目标对齐。干预策略的设计需要考虑干预成本和效果,以避免过度干预或无效干预。

关键创新:该论文的关键创新在于提出了一个完整的自适应责任框架,将责任追踪、规范检测和行为干预三个模块有机结合,形成一个闭环的治理系统。与传统的集中式治理方法相比,该框架具有更好的可扩展性和鲁棒性,能够适应大规模、动态变化的MAS。此外,该框架采用去中心化的规范检测方法,避免了单点故障和信息瓶颈。

关键设计:在责任追踪模块中,审计账本的设计需要考虑存储效率和查询效率,以支持对大规模数据的快速分析。在涌现规范检测模块中,序贯假设检验的参数设置(如显著性水平和功效)需要根据具体的应用场景进行调整,以平衡检测的准确性和效率。在干预模块中,干预策略的设计需要考虑智能体的异质性和环境的随机性,采用强化学习等方法来学习最优的干预策略。论文还提出了一个有界妥协定理,用于分析干预成本和效果之间的关系,为干预策略的设计提供理论指导。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架在防止勾结和资源囤积方面表现出色,在至少90%的配置中有效。同时,平均集体奖励提高了12-18%,基尼不平等指数降低了高达33%,表明该框架在提升系统性能和公平性方面具有显著优势。这些结果验证了该自适应责任框架的有效性和实用性。

🎯 应用场景

该研究成果可应用于智能交通、分布式能源管理、金融交易等领域。通过建立责任体系和规范检测机制,可以有效防止系统中的恶意行为和资源滥用,提升系统的整体效率和安全性。未来,该研究有望推动构建更加可信、可靠和可持续的大规模多智能体系统。

📄 摘要(原文)

Large-scale networked multi-agent systems increasingly underpin critical infrastructure, yet their collective behavior can drift toward undesirable emergent norms that elude conventional governance mechanisms. We introduce an adaptive accountability framework that (i) continuously traces responsibility flows through a lifecycle-aware audit ledger, (ii) detects harmful emergent norms online via decentralized sequential hypothesis tests, and (iii) deploys local policy and reward-shaping interventions that realign agents with system-level objectives in near real time. We prove a bounded-compromise theorem showing that whenever the expected intervention cost exceeds an adversary's payoff, the long-run proportion of compromised interactions is bounded by a constant strictly less than one. Extensive high-performance simulations with up to 100 heterogeneous agents, partial observability, and stochastic communication graphs show that our framework prevents collusion and resource hoarding in at least 90% of configurations, boosts average collective reward by 12-18%, and lowers the Gini inequality index by up to 33% relative to a PPO baseline. These results demonstrate that a theoretically principled accountability layer can induce ethically aligned, self-regulating behavior in complex MAS without sacrificing performance or scalability.