NL2CA: Auto-formalizing Cognitive Decision-Making from Natural Language Using an Unsupervised CriticNL2LTL Framework

作者: Zihao Deng, Yijia Li, Renrui Zhang, Peijun Ye

分类: cs.AI, cs.SC

发布日期: 2025-12-20

💡 一句话要点

提出NL2CA,实现从自然语言到认知决策模型的自动形式化转换。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 认知计算 自然语言处理 线性时序逻辑 无监督学习 认知强化学习

📋 核心要点

- 认知计算模型开发耗时费力,缺乏自动化工具,阻碍了其广泛应用。

- NL2CA利用大型语言模型和无监督学习,将自然语言描述自动转换为可执行的认知规则。

- 实验表明,NL2CA在NL-to-LTL翻译和认知驾驶模拟中均表现出色,验证了其有效性。

📝 摘要(中文)

本文提出了一种名为NL2CA的新方法,用于从人类经验的自然语言描述中自动形式化认知决策规则,从而降低认知计算模型的开发成本。与依赖纯手动或人机交互建模的相关工作不同,NL2CA实现了完全自动化,无需人工干预。该方法首先使用微调的大型语言模型(LLM)将文本转换为线性时序逻辑(LTL),然后通过无监督的Critic Tree细化逻辑,最后将输出转换为与符号认知框架兼容的可执行产生式规则。基于生成的规则,进一步构建认知智能体,并通过认知强化学习根据真实世界的行为数据进行优化。该方法在两个领域进行了验证:(1)NL-to-LTL翻译,CriticNL2LTL模块在专家和大规模基准测试中均取得了稳定性能,无需人工反馈;(2)认知驾驶模拟,从人类访谈中自动构建的智能体成功学习了约70次不同关键场景中的多样化决策模式。实验结果表明,NL2CA能够从非结构化文本数据中实现可扩展、可解释且与人类对齐的认知建模,为自动设计符号认知智能体提供了一种新范式。

🔬 方法详解

问题定义:论文旨在解决认知计算模型构建过程中人工成本高昂的问题。现有方法要么依赖于纯手动建模,要么需要大量的人工指导和交互,效率低下且难以扩展。因此,如何从自然语言描述中自动提取并形式化认知决策规则,成为了一个重要的挑战。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大自然语言理解能力,将自然语言描述转换为形式化的线性时序逻辑(LTL),然后通过无监督学习方法对LTL进行优化和修正,最终将其转换为可执行的认知规则。这种方法旨在实现完全自动化,无需人工干预,从而显著降低认知模型构建的成本和时间。

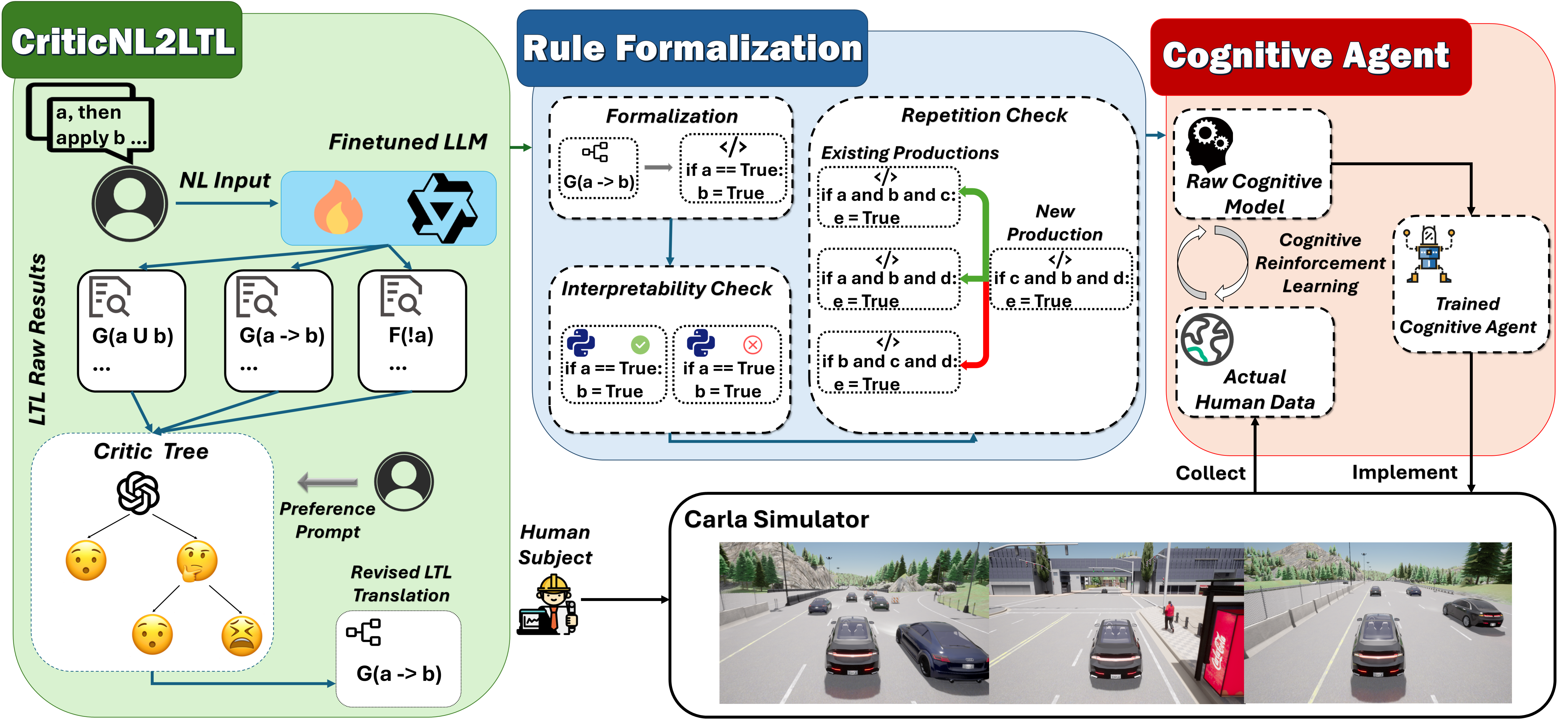

技术框架:NL2CA的技术框架主要包含三个阶段:1) NL-to-LTL翻译:使用微调的LLM将自然语言文本转换为LTL公式。2) LTL逻辑优化:利用无监督的Critic Tree对LTL公式进行细化和修正,提高其准确性和可靠性。3) 规则转换与智能体构建:将优化后的LTL公式转换为与符号认知框架兼容的产生式规则,并基于这些规则构建认知智能体。最后,使用认知强化学习根据真实世界的行为数据对智能体进行优化。

关键创新:NL2CA的关键创新在于其完全自动化的流程,无需任何人工干预。与以往需要人工参与的建模方法相比,NL2CA能够显著提高建模效率和可扩展性。此外,Critic Tree的使用使得LTL逻辑的优化过程无需人工标注数据,降低了对领域知识的依赖。

关键设计:在NL-to-LTL翻译阶段,论文对LLM进行了微调,以提高其在特定领域的翻译准确性。Critic Tree的设计利用了LTL公式的结构化特性,通过迭代地评估和修正公式的子树来优化整体逻辑。认知强化学习阶段,论文采用了合适的奖励函数和探索策略,以确保智能体能够有效地学习到人类的决策模式。具体的参数设置和网络结构在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

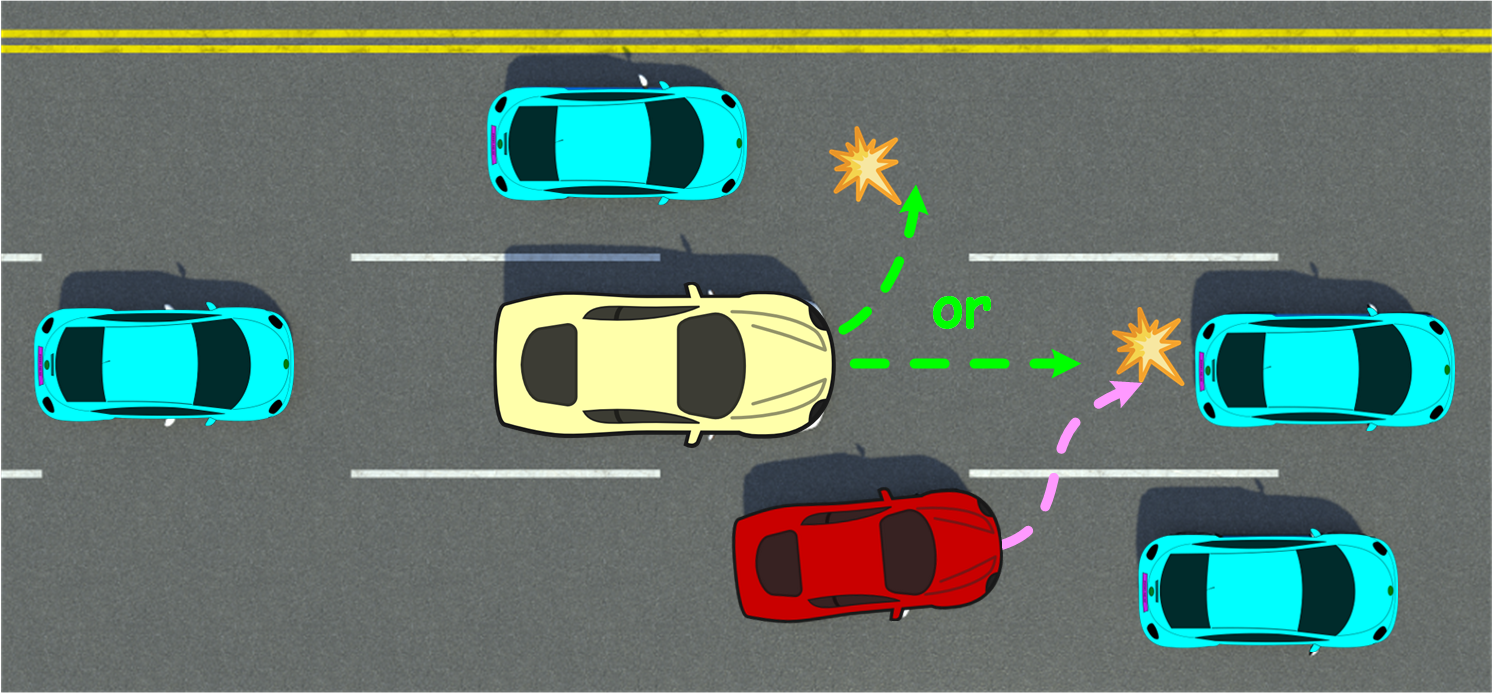

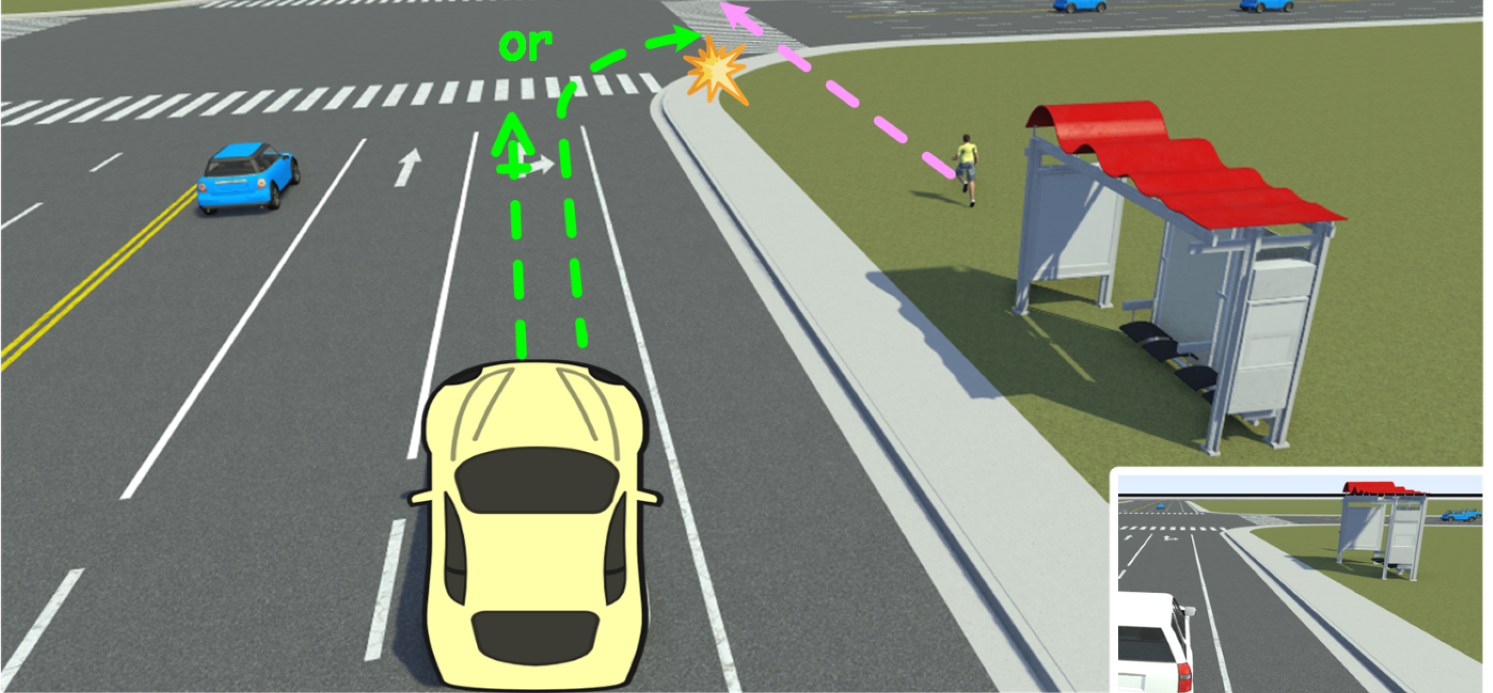

实验结果表明,NL2CA在NL-to-LTL翻译任务中取得了与人工标注数据训练的模型相当的性能,并且在认知驾驶模拟中,自动构建的智能体能够成功学习到人类驾驶员在不同场景下的决策模式。具体而言,CriticNL2LTL模块在专家和大规模基准测试中均取得了稳定性能,无需人工反馈。在认知驾驶模拟中,智能体成功学习了约70次不同关键场景中的多样化决策模式。

🎯 应用场景

NL2CA具有广泛的应用前景,例如:自动驾驶、智能家居、医疗诊断等领域。它可以帮助我们从人类专家的经验中自动提取知识,构建智能决策系统,从而提高工作效率和决策质量。此外,NL2CA还可以用于研究人类的认知过程,为认知科学和人工智能的交叉研究提供新的工具和方法。

📄 摘要(原文)

Cognitive computing models offer a formal and interpretable way to characterize human's deliberation and decision-making, yet their development remains labor-intensive. In this paper, we propose NL2CA, a novel method for auto-formalizing cognitive decision-making rules from natural language descriptions of human experience. Different from most related work that exploits either pure manual or human guided interactive modeling, our method is fully automated without any human intervention. The approach first translates text into Linear Temporal Logic (LTL) using a fine-tuned large language model (LLM), then refines the logic via an unsupervised Critic Tree, and finally transforms the output into executable production rules compatible with symbolic cognitive frameworks. Based on the resulted rules, a cognitive agent is further constructed and optimized through cognitive reinforcement learning according to the real-world behavioral data. Our method is validated in two domains: (1) NL-to-LTL translation, where our CriticNL2LTL module achieves consistent performance across both expert and large-scale benchmarks without human-in-the-loop feed-backs, and (2) cognitive driving simulation, where agents automatically constructed from human interviews have successfully learned the diverse decision patterns of about 70 trials in different critical scenarios. Experimental results demonstrate that NL2CA enables scalable, interpretable, and human-aligned cognitive modeling from unstructured textual data, offering a novel paradigm to automatically design symbolic cognitive agents.