How to Discover Knowledge for FutureG: Contextual RAG and LLM Prompting for O-RAN

作者: Nathan Conger, Nathan Scollar, Kemal Davaslioglu, Yalin E. Sagduyu, Sastry Kompella

分类: cs.NI, cs.AI, cs.IR, cs.LG

发布日期: 2025-12-18

💡 一句话要点

提出Contextual RAG框架,提升O-RAN领域问答系统性能,无需微调LLM。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: O-RAN 检索增强生成 大型语言模型 上下文感知 问答系统

📋 核心要点

- O-RAN规范快速演进,手动查阅复杂文档效率低下且易出错,阻碍了系统设计和部署。

- Contextual RAG利用候选答案指导文档检索,并结合特定上下文,提升LLM在O-RAN领域的问答性能。

- 实验表明,Contextual RAG在ORANBenchmark-13K数据集上优于传统RAG和基础提示,且无需微调LLM。

📝 摘要(中文)

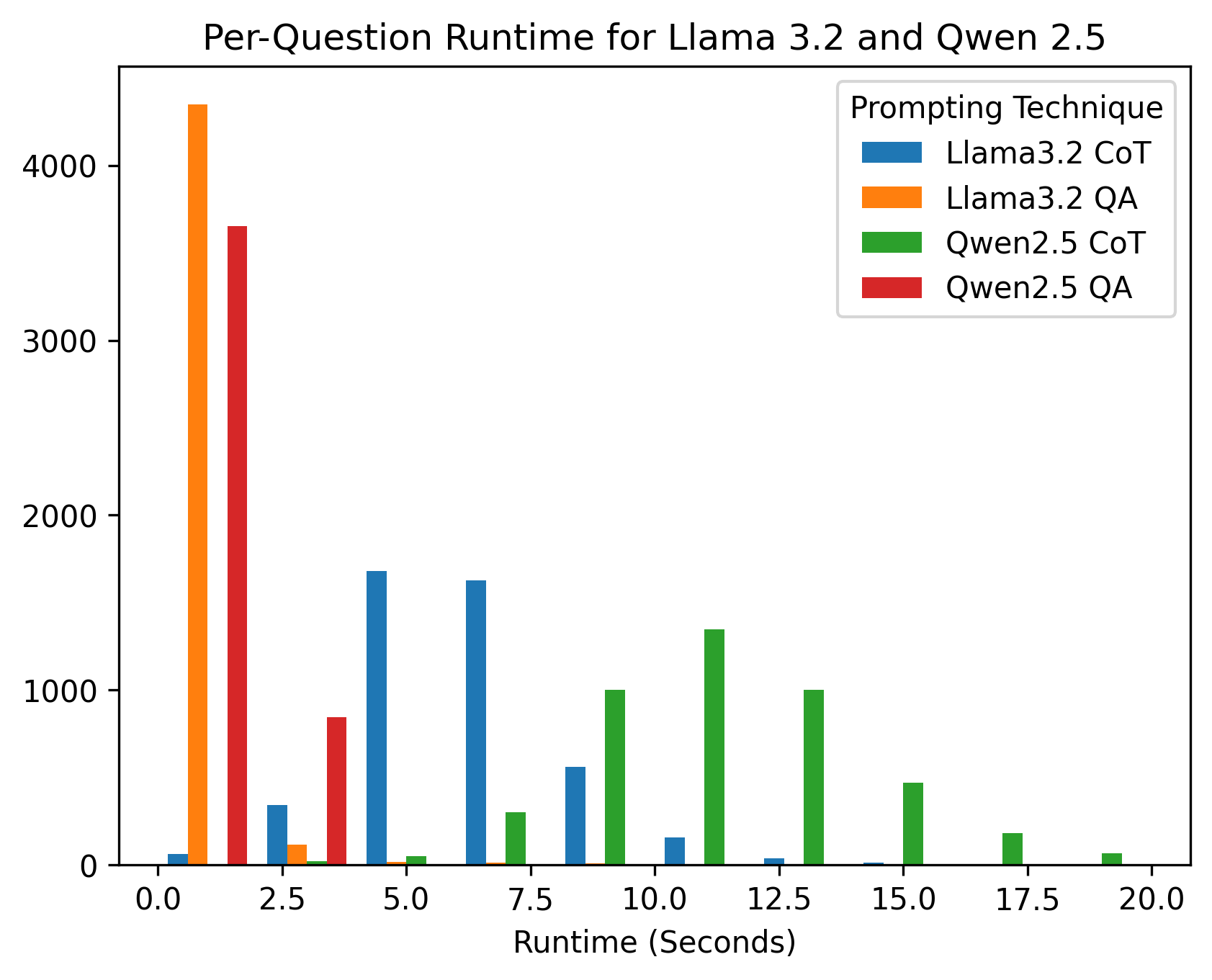

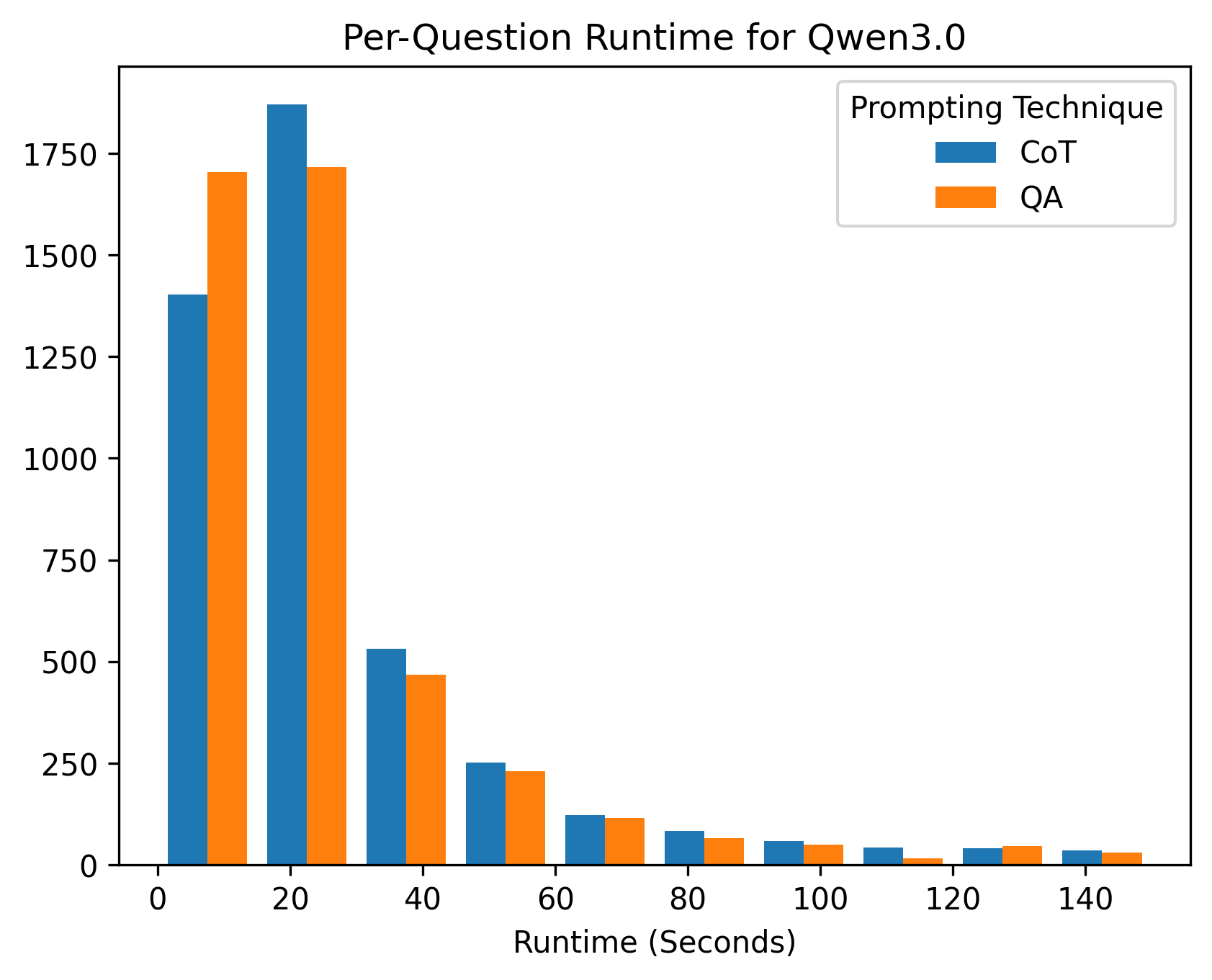

本文提出了一种用于5G/6G网络的检索增强问答框架,其中开放无线接入网络(O-RAN)在解耦、虚拟化和AI驱动的无线系统中占据核心地位。O-RAN实现了多厂商互操作性和云原生部署,但其快速变化的规范和接口给研究人员和从业者带来了重大挑战。手动浏览这些复杂文档既费力又容易出错,减缓了系统设计、集成和部署。为了解决这个问题,我们采用了Contextual RAG,这是一种利用候选答案选项来指导文档检索和特定块上下文的策略,以提高大型语言模型(LLM)的性能。与传统的RAG相比,这种改进实现了更有针对性和上下文感知的检索,提高了传递给LLM的文档的相关性,尤其是在查询本身缺乏足够的上下文以进行准确 grounding 时。我们的框架专为数据快速演变的动态领域而设计,模型必须不断更新或重新部署,所有这些都无需 LLM 微调。我们使用 ORANBenchmark-13K 数据集评估了该框架,并比较了三种 LLM,即 Llama3.2、Qwen2.5-7B 和 Qwen3.0-4B,采用了直接问答 (Direct Q&A) 和思维链 (Chain-of-Thought) 提示策略。结果表明,Contextual RAG 在保持竞争性运行时间和 CO2 排放的同时,始终优于标准 RAG 和基本提示。这些结果突出了 Contextual RAG 作为 ORAN 和更广泛的 5G/6G 环境中可扩展且有效的领域特定问答解决方案的潜力,从而能够更准确地解释不断发展的标准,同时保持效率和可持续性。

🔬 方法详解

问题定义:论文旨在解决O-RAN领域中,由于规范文档复杂且更新迅速,导致人工检索信息困难、效率低下的问题。现有方法,如传统RAG,在处理缺乏上下文信息的查询时,检索精度不足,影响问答效果。

核心思路:论文的核心思路是利用候选答案选项来增强检索过程,即Contextual RAG。通过分析候选答案,提取关键信息,从而更精准地检索相关文档和上下文,提高LLM的问答准确性。这种方法无需对LLM进行微调,适应了O-RAN规范快速变化的特点。

技术框架:Contextual RAG框架包含以下主要阶段:1) 问题输入;2) 候选答案生成;3) 基于候选答案的上下文检索;4) LLM问答生成;5) 输出答案。框架的关键在于上下文检索阶段,该阶段利用候选答案的信息来指导文档检索,并提取与问题和候选答案相关的特定块上下文。

关键创新:最重要的技术创新点在于Contextual RAG的上下文感知检索机制。与传统RAG直接使用问题进行检索不同,Contextual RAG利用候选答案提供的信息,更精准地定位相关文档和上下文,从而提高检索质量和问答准确性。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。Contextual RAG的核心在于检索策略的改进,而非LLM本身的结构或训练方式。论文侧重于利用现有的LLM(如Llama3.2、Qwen2.5-7B和Qwen3.0-4B)和提示策略(如Direct Q&A和Chain-of-Thought)来验证Contextual RAG的有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Contextual RAG在ORANBenchmark-13K数据集上显著优于标准RAG和基础提示方法。具体而言,Contextual RAG在保持竞争性运行时间和CO2排放的同时,提高了问答准确性。这证明了Contextual RAG在领域特定问答任务中的有效性和实用性。

🎯 应用场景

该研究成果可应用于O-RAN及其他5G/6G网络领域,为研究人员和从业者提供高效的知识发现和问答工具。通过Contextual RAG,可以更准确地理解和应用不断发展的无线通信标准,加速系统设计、集成和部署,并降低人工成本。该方法还可推广到其他需要处理大量复杂文档的领域,如法律、金融等。

📄 摘要(原文)

We present a retrieval-augmented question answering framework for 5G/6G networks, where the Open Radio Access Network (O-RAN) has become central to disaggregated, virtualized, and AI-driven wireless systems. While O-RAN enables multi-vendor interoperability and cloud-native deployments, its fast-changing specifications and interfaces pose major challenges for researchers and practitioners. Manual navigation of these complex documents is labor-intensive and error-prone, slowing system design, integration, and deployment. To address this challenge, we adopt Contextual Retrieval-Augmented Generation (Contextual RAG), a strategy in which candidate answer choices guide document retrieval and chunk-specific context to improve large language model (LLM) performance. This improvement over traditional RAG achieves more targeted and context-aware retrieval, which improves the relevance of documents passed to the LLM, particularly when the query alone lacks sufficient context for accurate grounding. Our framework is designed for dynamic domains where data evolves rapidly and models must be continuously updated or redeployed, all without requiring LLM fine-tuning. We evaluate this framework using the ORANBenchmark-13K dataset, and compare three LLMs, namely, Llama3.2, Qwen2.5-7B, and Qwen3.0-4B, across both Direct Question Answering (Direct Q&A) and Chain-of-Thought (CoT) prompting strategies. We show that Contextual RAG consistently improves accuracy over standard RAG and base prompting, while maintaining competitive runtime and CO2 emissions. These results highlight the potential of Contextual RAG to serve as a scalable and effective solution for domain-specific Q&A in ORAN and broader 5G/6G environments, enabling more accurate interpretation of evolving standards while preserving efficiency and sustainability.