Realistic threat perception drives intergroup conflict: A causal, dynamic analysis using generative-agent simulations

作者: Suhaib Abdurahman, Farzan Karimi-Malekabadi, Chenxiao Yu, Nour S. Kteily, Morteza Dehghani

分类: cs.AI

发布日期: 2025-12-18

💡 一句话要点

利用生成式Agent模拟,揭示现实威胁感知驱动群体冲突的因果动态机制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 群体冲突 威胁感知 生成式Agent 大型语言模型 社会模拟

📋 核心要点

- 现有研究缺乏对现实和象征威胁如何共同驱动群体冲突的有效因果控制和充足的时间序列数据。

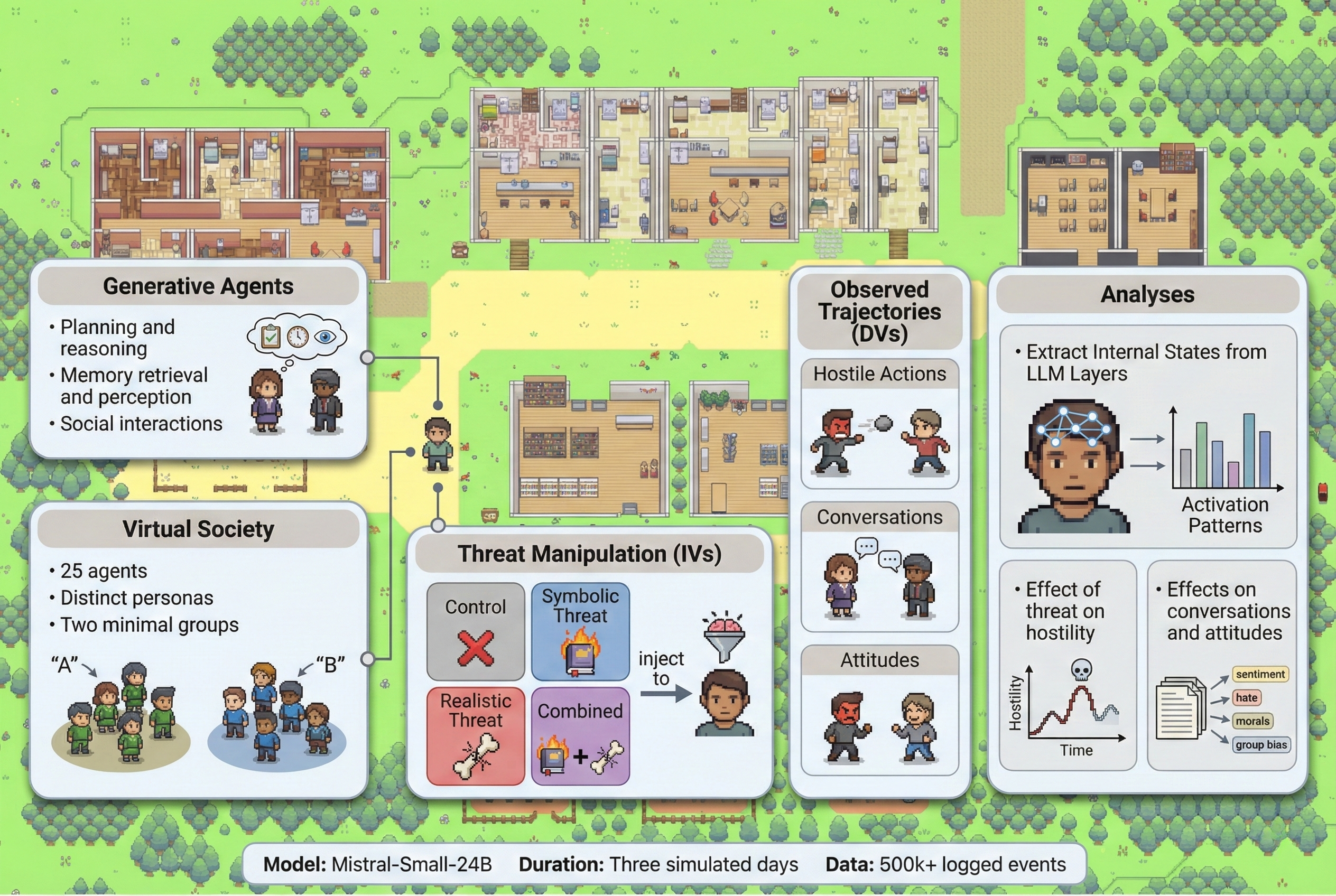

- 论文利用大型语言模型驱动的Agent在虚拟社会中进行模拟,独立操纵现实和象征威胁,并追踪Agent的行为和态度。

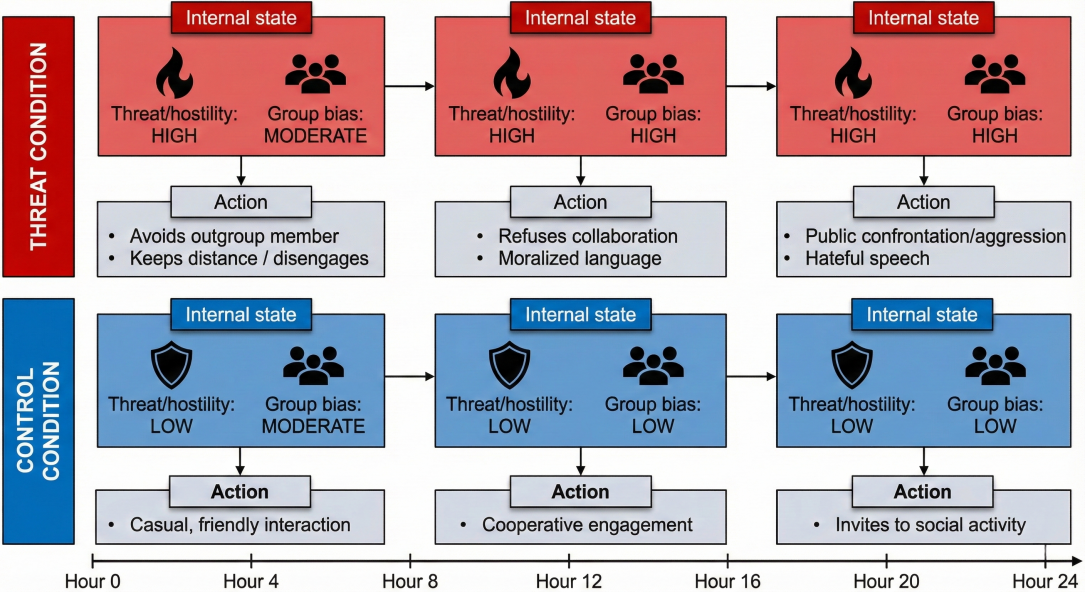

- 实验结果表明,现实威胁直接增加敌意,而象征威胁的影响较弱,且受内群体偏见的影响,非敌对接触可缓解冲突。

📝 摘要(中文)

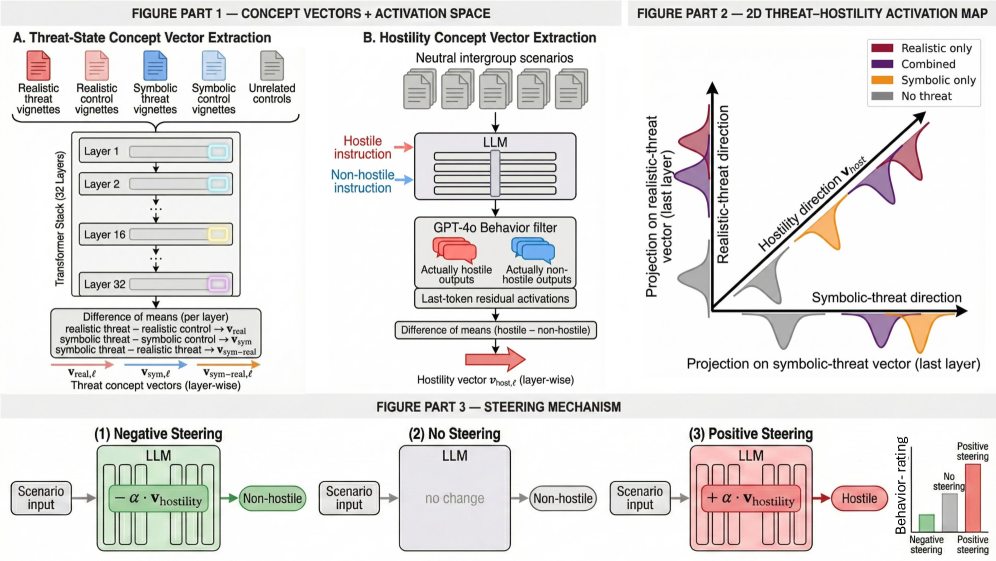

人类冲突通常归因于对物质条件和象征价值的威胁,但它们如何相互作用以及哪种威胁占主导地位仍不清楚。因果控制薄弱、伦理约束和时间数据稀缺限制了研究进展。本文通过在虚拟社会中模拟由大型语言模型(LLM)驱动的Agent来解决这些障碍,独立地改变现实威胁和象征威胁,同时跟踪行为、语言和态度。表征分析表明,底层LLM将现实威胁、象征威胁和敌意编码为不同的内部状态,我们的操作映射到这些状态,并且引导这些状态会因果地改变行为。我们的模拟提供了威胁驱动冲突随时间的因果解释:现实威胁直接增加敌意,而象征威胁的影响较弱,完全由内群体偏见介导,并且仅在不存在现实威胁时才增加敌意。非敌对的群体间接触可以缓冲冲突升级,而结构性不对称会将敌意集中在多数群体中。

🔬 方法详解

问题定义:现有研究难以区分现实威胁和象征威胁在群体冲突中的作用,缺乏有效的因果控制手段,并且难以获取足够长时间序列的行为数据。这使得理解威胁如何随时间演变并驱动冲突变得困难。

核心思路:论文的核心思路是利用大型语言模型(LLM)驱动的Agent在虚拟社会中进行模拟。通过独立操纵现实威胁和象征威胁,并观察Agent的行为、语言和态度变化,从而推断不同威胁对群体冲突的影响。这种方法可以克服传统研究中因果控制薄弱、伦理约束和数据稀缺的限制。

技术框架:该研究的技术框架主要包括以下几个模块:1) 基于LLM的Agent设计:使用LLM作为Agent的决策引擎,使其能够根据环境刺激(现实威胁和象征威胁)生成行为和语言。2) 虚拟社会环境构建:创建一个虚拟社会,其中包含多个Agent群体,并可以控制不同群体之间的资源分配和互动方式。3) 威胁操纵:独立地改变虚拟社会中的现实威胁(例如资源匮乏)和象征威胁(例如文化差异),以观察Agent的反应。4) 行为和态度追踪:记录Agent的行为(例如攻击、防御)和态度(例如敌意、偏见),以便分析威胁对群体冲突的影响。5) 表征分析:分析LLM内部状态,以了解其如何编码现实威胁、象征威胁和敌意。

关键创新:该研究的关键创新在于:1) 使用LLM驱动的Agent进行社会模拟,这为研究复杂社会现象提供了一种新的方法。2) 通过独立操纵现实威胁和象征威胁,实现了对群体冲突的因果分析。3) 通过表征分析,揭示了LLM如何编码不同类型的威胁和敌意。

关键设计:研究中关键的设计包括:1) LLM的选择和训练:选择合适的LLM,并对其进行微调,使其能够更好地模拟人类行为。2) 威胁的量化和操纵:设计合理的指标来量化现实威胁和象征威胁,并确保操纵的有效性。3) 行为和态度指标的选择:选择能够反映群体冲突程度的行为和态度指标,例如攻击频率、防御强度、敌意程度等。4) 实验参数设置:设置合理的实验参数,例如Agent数量、资源分配方式、威胁强度等,以确保实验结果的可靠性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现实威胁直接增加敌意,而象征威胁的影响较弱,且完全由内群体偏见介导。只有在现实威胁不存在时,象征威胁才会增加敌意。此外,非敌对的群体间接触可以缓冲冲突升级,而结构性不对称会将敌意集中在多数群体中。这些发现为理解群体冲突的动态机制提供了重要的见解。

🎯 应用场景

该研究的潜在应用领域包括:冲突预测与干预、社会政策制定、跨文化交流促进等。通过理解威胁如何驱动群体冲突,可以帮助我们预测冲突的发生,并制定有效的干预措施。此外,该研究还可以帮助我们更好地理解不同文化之间的差异,从而促进跨文化交流和合作。未来,该研究可以扩展到更复杂的社会环境中,例如在线社交网络和国际关系。

📄 摘要(原文)

Human conflict is often attributed to threats against material conditions and symbolic values, yet it remains unclear how they interact and which dominates. Progress is limited by weak causal control, ethical constraints, and scarce temporal data. We address these barriers using simulations of large language model (LLM)-driven agents in virtual societies, independently varying realistic and symbolic threat while tracking actions, language, and attitudes. Representational analyses show that the underlying LLM encodes realistic threat, symbolic threat, and hostility as distinct internal states, that our manipulations map onto them, and that steering these states causally shifts behavior. Our simulations provide a causal account of threat-driven conflict over time: realistic threat directly increases hostility, whereas symbolic threat effects are weaker, fully mediated by ingroup bias, and increase hostility only when realistic threat is absent. Non-hostile intergroup contact buffers escalation, and structural asymmetries concentrate hostility among majority groups.