EvoLattice: Persistent Internal-Population Evolution through Multi-Alternative Quality-Diversity Graph Representations for LLM-Guided Program Discovery

作者: Kamer Ali Yuksel

分类: cs.AI, cs.CL, cs.LG, cs.MA, cs.NE

发布日期: 2025-12-15 (更新: 2025-12-17)

💡 一句话要点

EvoLattice:通过多替代质量多样性图表示实现LLM引导的程序发现

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 程序演化 大型语言模型 质量多样性 图表示 智能体系统

📋 核心要点

- 现有LLM引导的程序演化方法依赖于单候选覆盖式突变,易丢失有用变体并导致结构性错误。

- EvoLattice通过有向无环图表示候选程序种群,节点存储多替代方案,实现组合搜索空间。

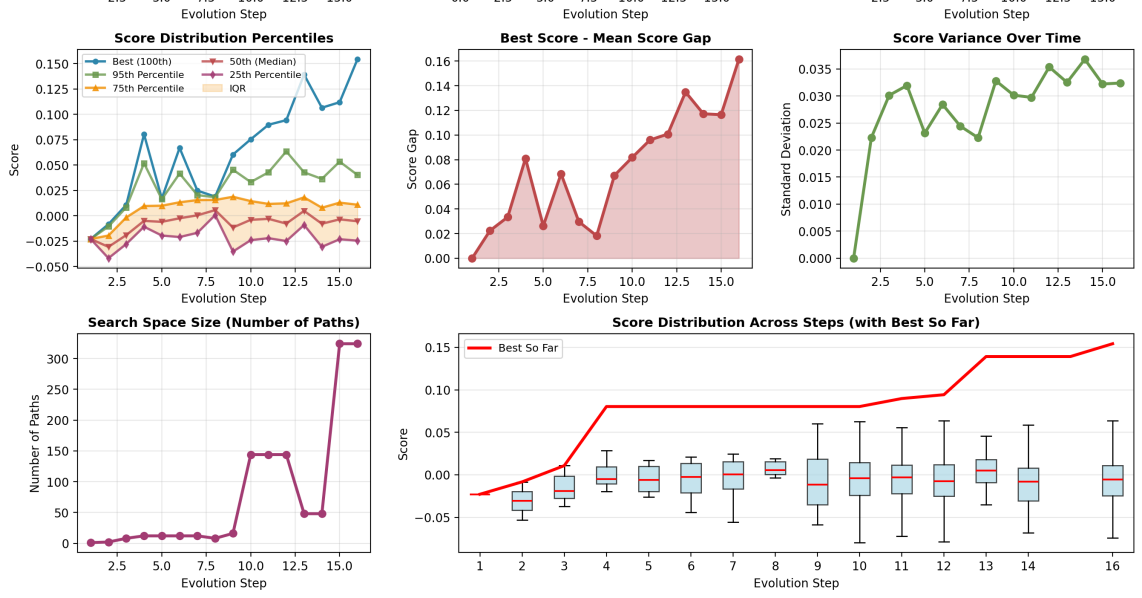

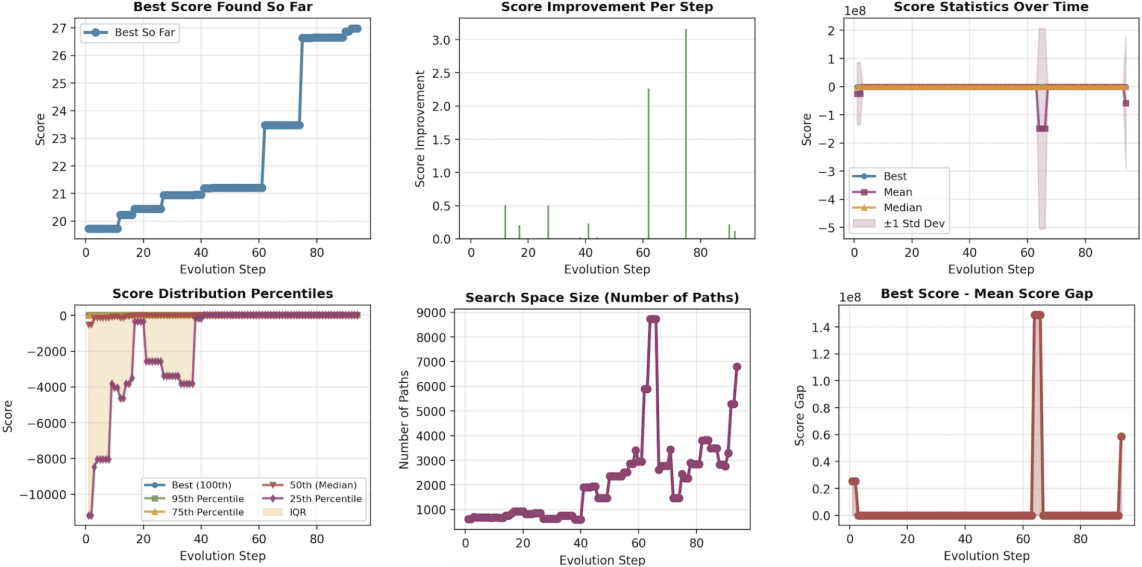

- EvoLattice在程序合成任务中表现出更稳定的演化和更强的改进轨迹,类似质量多样性优化。

📝 摘要(中文)

大型语言模型(LLM)越来越多地被用于演化程序和多智能体系统,但现有方法大多依赖于基于覆盖的突变,每次只维护一个候选方案。这些方法丢弃了有用的变体,遭受破坏性编辑,并探索了一个容易发生结构性故障的脆弱搜索空间。我们引入了EvoLattice,该框架在一个有向无环图中表示候选程序或智能体行为的整个种群。每个节点存储多个持久性替代方案,并且通过图的每个有效路径定义一个不同的可执行候选方案,从而产生一个大的组合搜索空间,而无需复制结构。EvoLattice通过对每个替代方案在其出现的所有路径中进行评分,从而实现细粒度的替代方案级别评估,从而产生统计数据,揭示局部设计选择如何影响全局性能。这些统计数据为LLM引导的突变、重组和修剪提供了密集的数据驱动反馈信号,同时保留了成功的组件。结构正确性由确定性的自修复机制保证,该机制独立于LLM强制执行非循环性和依赖性一致性。EvoLattice通过将替代方案解释为提示片段或子智能体行为,自然地扩展到智能体演化。在程序合成(代理和优化器元学习)中,EvoLattice比先前的LLM引导方法产生更稳定的演化、更大的表达性和更强的改进轨迹。由此产生的动态类似于质量多样性优化,从EvoLattice的内部多替代表示中隐式地出现,而不是显式的外部存档。

🔬 方法详解

问题定义:现有基于LLM的程序演化方法主要采用单候选覆盖式突变,这种方式容易丢失有用的程序变体,并且容易受到破坏性编辑的影响,导致搜索空间脆弱,容易出现结构性错误。因此,如何有效地利用LLM的生成能力,同时避免单候选方法的缺点,是本文要解决的问题。

核心思路:EvoLattice的核心思路是使用一个有向无环图来表示整个候选程序种群。图中的每个节点存储多个替代方案,每条有效的路径代表一个可执行的候选程序。这种表示方式允许在不复制结构的情况下,构建一个巨大的组合搜索空间,从而保留了更多的程序变体,并提高了演化的稳定性。

技术框架:EvoLattice框架包含以下几个主要模块:1) 图表示:使用有向无环图表示候选程序种群,每个节点包含多个替代方案。2) 替代方案评估:通过评估每个替代方案在所有路径中的表现,生成统计数据,反映局部设计选择对全局性能的影响。3) LLM引导的演化:利用LLM的生成能力,基于替代方案的评估结果,进行突变、重组和修剪操作。4) 结构自修复:通过确定性的自修复机制,保证图的非循环性和依赖性一致性。

关键创新:EvoLattice的关键创新在于其内部多替代方案表示。与传统的单候选方法不同,EvoLattice能够同时维护和评估多个替代方案,从而更好地利用LLM的生成能力,并避免了单候选方法的缺点。此外,EvoLattice的结构自修复机制保证了演化的稳定性。

关键设计:EvoLattice的关键设计包括:1) 替代方案的表示:每个节点存储多个替代方案,这些替代方案可以是程序片段、提示片段或子智能体行为。2) 替代方案的评估:通过评估每个替代方案在所有路径中的表现,生成统计数据,反映局部设计选择对全局性能的影响。3) LLM引导的演化策略:利用LLM的生成能力,基于替代方案的评估结果,进行突变、重组和修剪操作。4) 结构自修复机制:通过确定性的自修复机制,保证图的非循环性和依赖性一致性。

🖼️ 关键图片

📊 实验亮点

在程序合成任务中,EvoLattice表现出比现有LLM引导方法更稳定的演化和更强的改进轨迹。实验结果表明,EvoLattice能够生成更具表达性的程序,并且能够更好地适应不同的任务需求。此外,EvoLattice的性能提升类似于质量多样性优化,表明其能够有效地探索搜索空间。

🎯 应用场景

EvoLattice可应用于程序合成、元学习、多智能体系统等领域。通过更有效地利用LLM的生成能力,EvoLattice能够帮助研究人员和开发者自动发现更优的程序和智能体行为,从而提高软件开发的效率和质量,并推动人工智能技术的发展。

📄 摘要(原文)

Large language models (LLMs) are increasingly used to evolve programs and multi-agent systems, yet most existing approaches rely on overwrite-based mutations that maintain only a single candidate at a time. Such methods discard useful variants, suffer from destructive edits, and explore a brittle search space prone to structural failure. We introduce EvoLattice, a framework that represents an entire population of candidate programs or agent behaviors within a single directed acyclic graph. Each node stores multiple persistent alternatives, and every valid path through the graph defines a distinct executable candidate, yielding a large combinatorial search space without duplicating structure. EvoLattice enables fine-grained alternative-level evaluation by scoring each alternative across all paths in which it appears, producing statistics that reveal how local design choices affect global performance. These statistics provide a dense, data-driven feedback signal for LLM-guided mutation, recombination, and pruning, while preserving successful components. Structural correctness is guaranteed by a deterministic self-repair mechanism that enforces acyclicity and dependency consistency independently of the LLM. EvoLattice naturally extends to agent evolution by interpreting alternatives as prompt fragments or sub-agent behaviors. Across program synthesis (proxy and optimizer meta-learning), EvoLattice yields more stable evolution, greater expressivity, and stronger improvement trajectories than prior LLM-guided methods. The resulting dynamics resemble quality-diversity optimization, emerging implicitly from EvoLattice's internal multi-alternative representation rather than an explicit external archive.