SpeakRL: Synergizing Reasoning, Speaking, and Acting in Language Models with Reinforcement Learning

作者: Emre Can Acikgoz, Jinoh Oh, Jie Hao, Joo Hyuk Jeon, Heng Ji, Dilek Hakkani-Tür, Gokhan Tur, Xiang Li, Chengyuan Ma, Xing Fan

分类: cs.AI, cs.CL

发布日期: 2025-12-15

💡 一句话要点

SpeakRL:强化学习驱动语言模型,提升推理、对话与行动协同能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 语言模型 人机协作 主动对话 任务型对话

📋 核心要点

- 现有智能体在人机交互中缺乏主动性,未能充分利用语言模型的对话能力,导致协作效率受限。

- SpeakRL通过强化学习奖励智能体的主动对话行为,例如在必要时提出澄清问题,从而提升协作效果。

- SpeakRL在SpeakER数据集上进行评估,任务完成度显著提升20.14%,且对话轮数未增加,优于大型专有模型。

📝 摘要(中文)

在实际应用中,有效的人机协作日益重要。当前协作趋势主要为单向,用户向智能体发出指令或提问,智能体直接回应,不主动寻求必要的澄清或确认。然而,智能体能力的提升需要更积极的互动,智能体应动态参与对话,澄清用户意图,解决歧义,并适应变化的环境。现有工作未能充分利用语言模型的对话能力,将智能体优化为更好的跟随者而非有效的对话者。本文提出SpeakRL,一种强化学习方法,通过奖励与用户的主动互动来增强智能体的对话能力,例如在必要时提出正确的澄清问题。为此,我们创建了SpeakER,一个合成数据集,包含来自面向任务对话的各种场景,通过交互式澄清问题解决任务。我们对对话主动性的奖励设计进行了系统分析,并提出了一个原则性的奖励公式,用于教导智能体平衡提问和行动。实验评估表明,我们的方法在任务完成方面比基础模型提高了20.14%,且不增加对话轮数,甚至超过了更大的专有模型,证明了以澄清为中心的用户-智能体交互的潜力。

🔬 方法详解

问题定义:现有的人机协作模式主要依赖于用户单方面提供信息,智能体被动接收并执行指令,缺乏主动澄清和确认机制。这种模式限制了智能体在复杂场景下的应用,尤其是在用户意图模糊或环境发生变化时,容易导致任务失败。因此,需要解决的问题是如何提升智能体的主动对话能力,使其能够通过提问来澄清用户意图,从而提高任务完成的成功率。

核心思路:SpeakRL的核心思路是通过强化学习来训练智能体,使其能够主动地与用户进行对话,并通过提问来获取更多信息,从而更好地理解用户意图并完成任务。这种方法的核心在于设计合适的奖励函数,鼓励智能体在适当的时候提出问题,并在提问和行动之间找到平衡。

技术框架:SpeakRL的技术框架主要包括以下几个模块:1) 语言模型:作为智能体的核心,负责生成对话内容和执行动作。2) 强化学习环境:模拟人机交互场景,提供用户反馈和奖励信号。3) 奖励函数:根据智能体的行为(提问或执行动作)给予奖励或惩罚,引导智能体学习最佳策略。4) SpeakER数据集:用于训练和评估智能体,包含各种面向任务的对话场景。

关键创新:SpeakRL的关键创新在于将强化学习应用于提升语言模型的主动对话能力。与以往主要关注智能体被动接收指令的方法不同,SpeakRL鼓励智能体主动提问,从而更好地理解用户意图。此外,SpeakRL还提出了一个原则性的奖励公式,用于平衡提问和行动,避免智能体过度提问或过少提问。

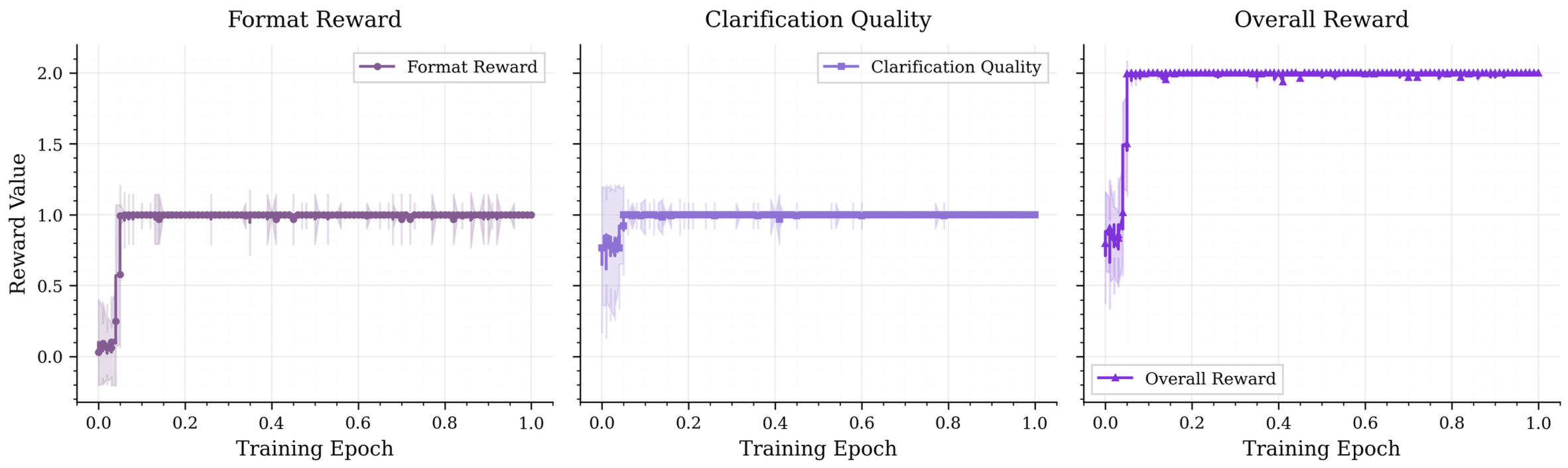

关键设计:SpeakRL的关键设计包括:1) SpeakER数据集的构建,该数据集包含了各种面向任务的对话场景,为智能体的训练提供了丰富的数据。2) 奖励函数的设计,该函数综合考虑了任务完成的成功率、对话轮数和提问的质量,从而引导智能体学习最佳策略。3) 强化学习算法的选择,论文中使用了合适的强化学习算法来训练智能体,使其能够有效地学习和优化对话策略。具体的参数设置、损失函数和网络结构等技术细节在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

SpeakRL在SpeakER数据集上进行了评估,实验结果表明,SpeakRL在任务完成方面比基础模型提高了20.14%,且不增加对话轮数。更重要的是,SpeakRL的性能甚至超过了更大的专有模型,这充分证明了以澄清为中心的用户-智能体交互的有效性。这些结果表明,通过强化学习提升语言模型的主动对话能力具有巨大的潜力。

🎯 应用场景

SpeakRL具有广泛的应用前景,可应用于智能客服、智能助手、游戏AI等领域。通过提升智能体的主动对话能力,可以提高人机交互的效率和用户满意度。例如,在智能客服场景中,智能体可以通过提问来澄清用户的问题,从而更准确地提供解决方案。在游戏AI场景中,智能体可以通过对话来了解玩家的意图,从而提供更个性化的游戏体验。未来,SpeakRL有望推动人机协作向更智能、更高效的方向发展。

📄 摘要(原文)

Effective human-agent collaboration is increasingly prevalent in real-world applications. Current trends in such collaborations are predominantly unidirectional, with users providing instructions or posing questions to agents, where agents respond directly without seeking necessary clarifications or confirmations. However, the evolving capabilities of these agents require more proactive engagement, where agents should dynamically participate in conversations to clarify user intents, resolve ambiguities, and adapt to changing circumstances. Existing prior work under-utilize the conversational capabilities of language models (LMs), thereby optimizing agents as better followers rather than effective speakers. In this work, we introduce SpeakRL, a reinforcement learning (RL) method that enhances agents' conversational capabilities by rewarding proactive interactions with users, such as asking right clarification questions when necessary. To support this, we curate SpeakER, a synthetic dataset that includes diverse scenarios from task-oriented dialogues, where tasks are resolved through interactive clarification questions. We present a systematic analysis of reward design for conversational proactivity and propose a principled reward formulation for teaching agents to balance asking with acting. Empirical evaluations demonstrate that our approach achieves a 20.14% absolute improvement in task completion over base models without increasing conversation turns even surpassing even much larger proprietary models, demonstrating the promise of clarification-centric user-agent interactions.