Towards Unified Co-Speech Gesture Generation via Hierarchical Implicit Periodicity Learning

作者: Xin Guo, Yifan Zhao, Jia Li

分类: cs.AI, cs.CV, cs.GR, cs.MM, cs.SD

发布日期: 2025-12-15

备注: IEEE Transactions on Image Processing

💡 一句话要点

提出基于分层隐式周期性学习的统一口语手势生成方法

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 口语手势生成 3D手势 分层学习 隐式周期性 自编码器

📋 核心要点

- 现有口语手势生成方法难以建模头部、身体和手部等运动单元之间的内在关联,导致生成的手势不自然。

- 提出分层隐式周期性学习方法,通过周期性自编码器和级联引导,显式地建模手势的周期性和层级关系。

- 实验结果表明,该方法在口语手势生成任务上优于现有技术,能够生成更自然和协调的3D手势。

📝 摘要(中文)

本文提出了一种统一的分层隐式周期性(HIP)学习方法,用于音频驱动的3D手势生成。现有方法难以建模不同运动单元(头部、身体和手部)之间的内在关联,导致动作不自然和协调性差。为了深入研究这些内在关联,该方法通过两个技术洞察建模多模态隐式关系:i) 利用周期性自编码器探索手势运动相位流形,从真实分布中模仿人类自然动作,同时结合来自当前潜在状态的非周期性动作,以实现实例级别的多样性。ii) 通过级联引导驱动动画,建模面部运动、身体姿势和手部动作的分层关系。在3D化身上的大量实验表明,该方法在定量和定性评估方面均优于最先进的口语手势生成方法。

🔬 方法详解

问题定义:现有口语手势生成方法,如GANs、VQ-VAE和扩散模型,主要采用端到端的学习方案。这些方法忽略了不同运动单元(头部、身体和手部)之间的内在关联,导致生成的手势不自然,缺乏协调性。因此,需要一种能够有效建模这些内在关联的方法,以生成更逼真的人体动作。

核心思路:本文的核心思路是通过显式地建模手势的周期性和层级关系来解决上述问题。具体来说,利用周期性自编码器来捕捉手势运动的周期性特征,并使用级联引导来建模面部、身体和手部动作之间的层级关系。这种方法能够更好地模拟人类自然动作,并提高生成手势的协调性。

技术框架:该方法主要包含两个关键模块:周期性自编码器和级联引导。周期性自编码器用于学习手势运动的相位流形,并从中提取周期性特征。级联引导则用于建模不同运动单元之间的层级关系,从而实现更协调的动作生成。整体流程是,首先使用音频信息驱动周期性自编码器生成初始手势,然后通过级联引导对生成的手势进行优化,最终得到自然协调的3D手势。

关键创新:该方法最重要的创新点在于提出了分层隐式周期性学习框架,显式地建模了手势的周期性和层级关系。与现有方法相比,该方法能够更好地捕捉人类自然动作的本质特征,并生成更逼真、协调的手势。现有方法通常采用端到端的学习方式,难以显式地建模这些内在关联。

关键设计:周期性自编码器的设计关键在于如何有效地提取手势运动的周期性特征。为此,论文可能采用了特定的损失函数或网络结构,以鼓励自编码器学习到周期性表示。级联引导的设计关键在于如何有效地建模不同运动单元之间的层级关系。论文可能采用了注意力机制或其他技术手段,以实现不同运动单元之间的信息传递和协调。

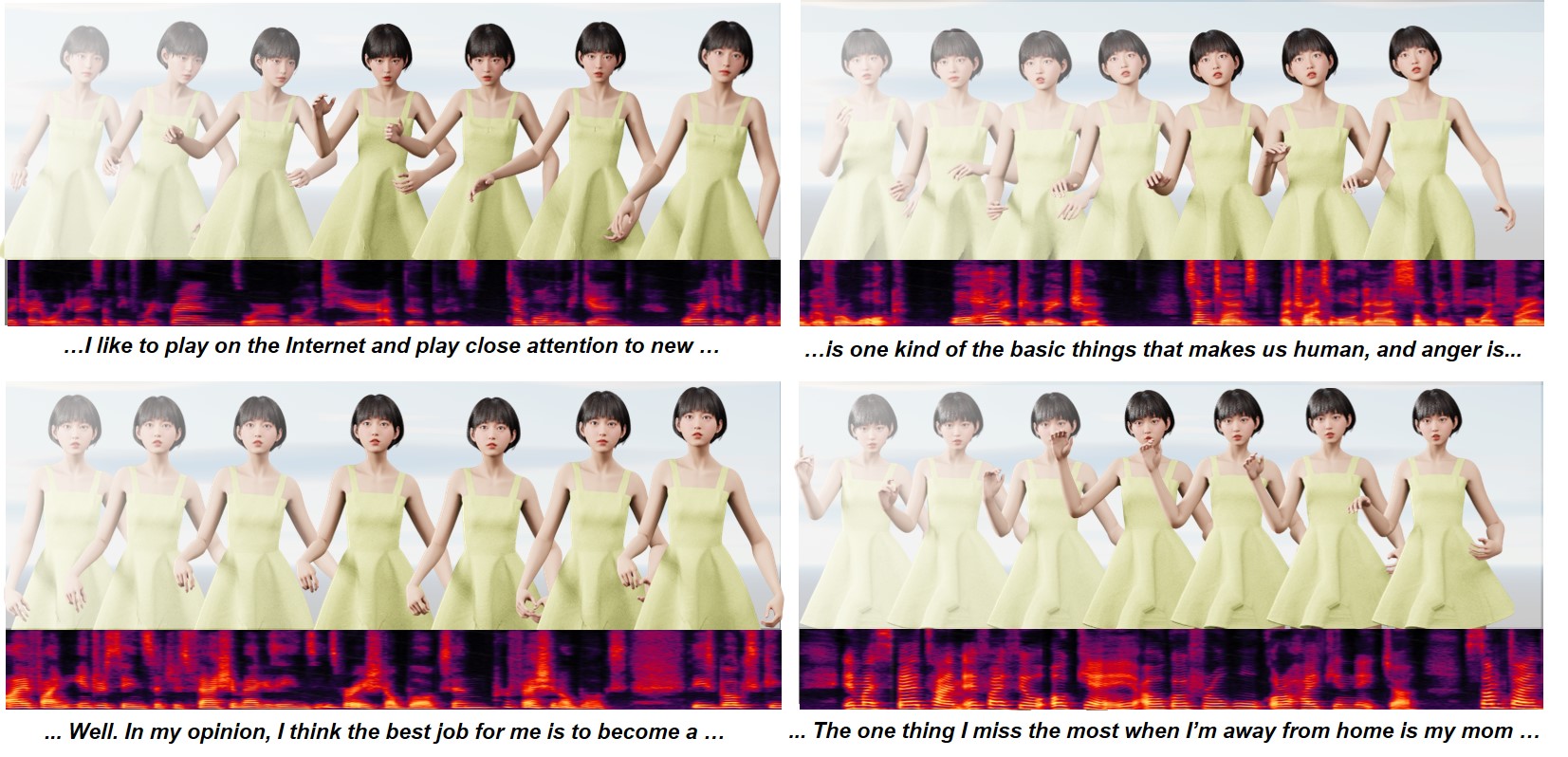

🖼️ 关键图片

📊 实验亮点

该方法在3D化身上进行了大量实验,结果表明,在口语手势生成任务上,该方法在定量和定性评估方面均优于现有最先进的方法。具体的性能数据(例如,在常用的评价指标上的提升幅度)未知,但摘要明确指出该方法取得了显著的改进。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、游戏、动画制作、人机交互等领域。通过该技术,可以生成更逼真、自然的虚拟人物动作,提升用户体验。例如,在虚拟会议中,虚拟人物可以根据语音生成自然的手势,从而增强交流的真实感。未来,该技术还可以应用于机器人控制领域,使机器人能够根据语音指令做出更自然、协调的动作。

📄 摘要(原文)

Generating 3D-based body movements from speech shows great potential in extensive downstream applications, while it still suffers challenges in imitating realistic human movements. Predominant research efforts focus on end-to-end generation schemes to generate co-speech gestures, spanning GANs, VQ-VAE, and recent diffusion models. As an ill-posed problem, in this paper, we argue that these prevailing learning schemes fail to model crucial inter- and intra-correlations across different motion units, i.e. head, body, and hands, thus leading to unnatural movements and poor coordination. To delve into these intrinsic correlations, we propose a unified Hierarchical Implicit Periodicity (HIP) learning approach for audio-inspired 3D gesture generation. Different from predominant research, our approach models this multi-modal implicit relationship by two explicit technique insights: i) To disentangle the complicated gesture movements, we first explore the gesture motion phase manifolds with periodic autoencoders to imitate human natures from realistic distributions while incorporating non-period ones from current latent states for instance-level diversities. ii) To model the hierarchical relationship of face motions, body gestures, and hand movements, driving the animation with cascaded guidance during learning. We exhibit our proposed approach on 3D avatars and extensive experiments show our method outperforms the state-of-the-art co-speech gesture generation methods by both quantitative and qualitative evaluations. Code and models will be publicly available.