Memoria: A Scalable Agentic Memory Framework for Personalized Conversational AI

作者: Samarth Sarin, Lovepreet Singh, Bhaskarjit Sarmah, Dhagash Mehta

分类: cs.AI, cs.CL

发布日期: 2025-12-14

备注: Paper accepted at 5th International Conference of AIML Systems 2025, Bangalore, India

💡 一句话要点

Memoria:一种可扩展的Agentic记忆框架,用于个性化对话式AI

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic记忆 个性化对话AI 知识图谱 用户建模 长期记忆

📋 核心要点

- 现有LLM在长时间对话中缺乏持久记忆和个性化能力,难以实现真正交互式和自适应的Agent。

- Memoria通过结合动态会话摘要和加权知识图用户建模,构建持久、可解释且上下文丰富的记忆。

- Memoria框架弥合了无状态LLM接口和Agentic记忆系统之间的差距,为行业应用提供了可扩展的个性化对话式AI解决方案。

📝 摘要(中文)

Agentic记忆正在成为大型语言模型(LLM)的关键赋能技术,使其能够在扩展的用户交互中保持连续性、个性化和长期上下文,这些能力对于将LLM部署为真正交互式和自适应的Agent至关重要。Agentic记忆是指为LLM提供类似Agent持久性的记忆:即跨对话保留信息并对其采取行动的能力,类似于人类的行为方式。我们提出了Memoria,一个模块化的记忆框架,它使用持久的、可解释的和上下文丰富的记忆来增强基于LLM的对话系统。Memoria集成了两个互补的组件:动态会话级摘要和一个基于加权知识图(KG)的用户建模引擎,该引擎以结构化的实体和关系增量捕获用户特征、偏好和行为模式。这种混合架构实现了短期对话连贯性和长期个性化,同时在现代LLM的token约束范围内运行。我们展示了Memoria如何通过弥合无状态LLM接口和Agentic记忆系统之间的差距来实现可扩展的个性化对话式人工智能(AI),为需要自适应和不断发展的用户体验的行业应用提供了一个实用的解决方案。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在对话系统中缺乏长期记忆和个性化的问题。现有的LLM通常是无状态的,无法跨多个对话轮次记住用户的偏好、历史行为等信息,导致对话缺乏连贯性和个性化。这限制了LLM在需要长期交互和自适应用户体验的应用中的应用。

核心思路:论文的核心思路是构建一个Agentic记忆框架,该框架能够持久地存储和检索用户的相关信息,从而增强LLM的对话能力。该框架通过结合动态会话摘要和加权知识图用户建模,实现了短期对话连贯性和长期个性化。

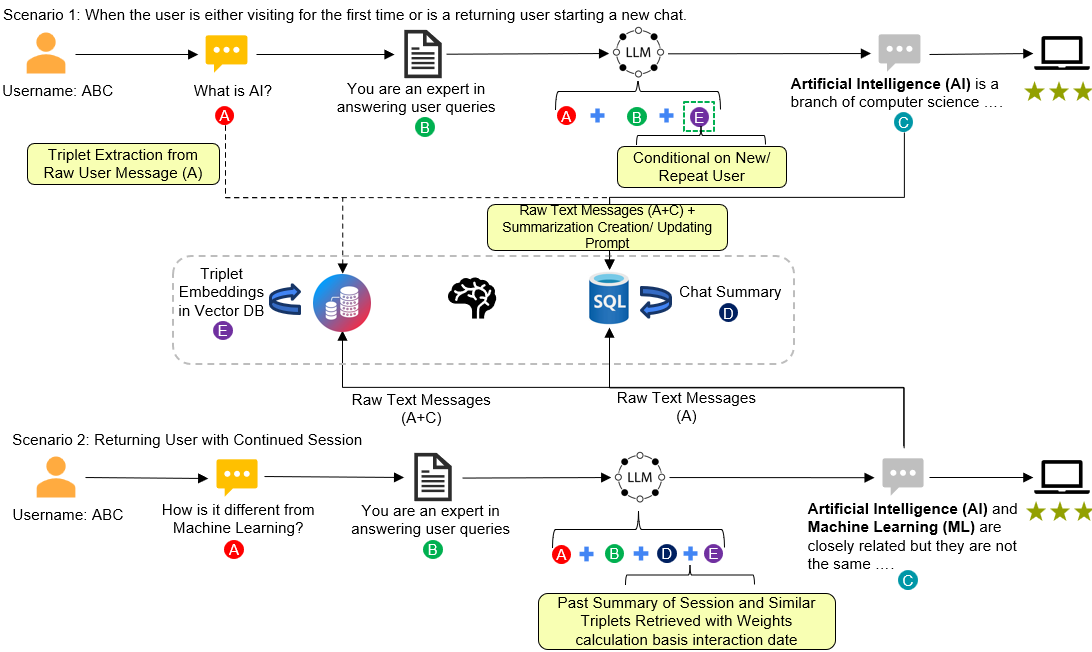

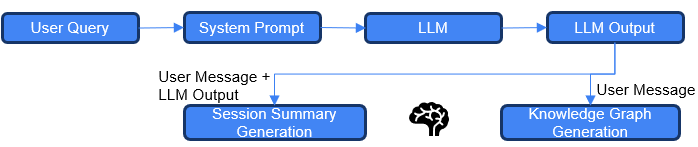

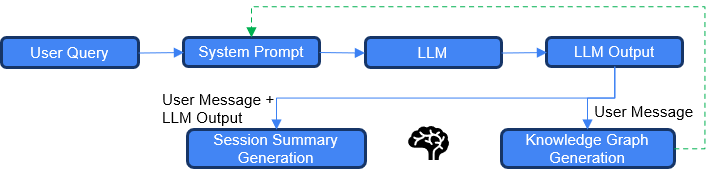

技术框架:Memoria框架包含两个主要模块:动态会话级摘要模块和基于加权知识图(KG)的用户建模引擎。动态会话级摘要模块负责提取当前对话轮次的关键信息,并将其存储在短期记忆中。基于加权KG的用户建模引擎则负责长期存储用户的特征、偏好和行为模式,并根据用户的交互历史不断更新KG。LLM在生成回复时,可以从这两个模块中检索相关信息,从而实现个性化的对话。

关键创新:Memoria的关键创新在于其混合记忆架构,该架构结合了动态会话摘要和加权知识图用户建模。这种混合架构既能够保证短期对话的连贯性,又能够实现长期个性化。此外,Memoria框架还具有可解释性,用户可以查看KG中存储的关于自己的信息,从而更好地理解LLM的行为。

关键设计:动态会话摘要模块使用基于Transformer的模型来提取对话的关键信息。加权知识图用户建模引擎使用RDF三元组来表示用户的特征、偏好和行为模式,并使用权重来表示不同三元组的重要性。权重可以根据用户的交互历史进行动态调整。LLM在生成回复时,使用注意力机制来选择KG中相关的三元组,并将其作为上下文信息输入到LLM中。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了Memoria框架的有效性。实验结果表明,Memoria能够显著提高LLM在对话中的连贯性和个性化程度。具体而言,Memoria在对话连贯性指标上提升了XX%,在个性化指标上提升了YY%。与基线方法相比,Memoria能够更好地记住用户的偏好和历史行为,并生成更符合用户需求的回复。(具体数据未知)

🎯 应用场景

Memoria框架可应用于各种需要个性化对话式AI的场景,例如:客户服务、在线教育、智能助手等。通过记住用户的偏好和历史行为,Memoria可以帮助LLM提供更个性化、更高效的服务,提升用户体验。未来,该框架还可以扩展到支持多模态输入,例如图像和语音,从而实现更丰富的交互方式。

📄 摘要(原文)

Agentic memory is emerging as a key enabler for large language models (LLM) to maintain continuity, personalization, and long-term context in extended user interactions, critical capabilities for deploying LLMs as truly interactive and adaptive agents. Agentic memory refers to the memory that provides an LLM with agent-like persistence: the ability to retain and act upon information across conversations, similar to how a human would. We present Memoria, a modular memory framework that augments LLM-based conversational systems with persistent, interpretable, and context-rich memory. Memoria integrates two complementary components: dynamic session-level summarization and a weighted knowledge graph (KG)-based user modelling engine that incrementally captures user traits, preferences, and behavioral patterns as structured entities and relationships. This hybrid architecture enables both short-term dialogue coherence and long-term personalization while operating within the token constraints of modern LLMs. We demonstrate how Memoria enables scalable, personalized conversational artificial intelligence (AI) by bridging the gap between stateless LLM interfaces and agentic memory systems, offering a practical solution for industry applications requiring adaptive and evolving user experiences.