Emergence: Overcoming Privileged Information Bias in Asymmetric Embodied Agents via Active Querying

作者: Shaun Baek, Sam Liu, Joseph Ukpong

分类: cs.AI, cs.MA, cs.RO

发布日期: 2025-12-13

备注: 12 pages, 9 pages of content, 6 tables, 5 figures

💡 一句话要点

提出主动查询框架以解决不对称智能体中的特权信息偏见问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 特权信息偏见 主动查询 非对称智能体 协作推理 心智理论

📋 核心要点

- 现有方法在信息不对称的情况下,知识丰富的智能体无法有效指导信息受限的智能体,导致协作失败。

- 提出了一种非对称辅助推理框架,通过主动查询机制来减少沟通中的不确定性,从而提高协作成功率。

- 实验结果显示,领导者与跟随者的成功率差距显著,主动查询协议的成功案例中澄清请求频率是传统方法的两倍。

📝 摘要(中文)

大型语言模型(LLMs)作为强大的推理引擎,在具身环境中面临“符号扎根”问题,尤其是在信息不对称分布时。本文探讨了特权信息偏见(或称“知识的诅咒”),即知识丰富的“领导者”智能体因缺乏心智理论而无法有效指导信息受限的“跟随者”。我们提出了一种新颖的非对称辅助推理框架,并在AI2-THOR环境中进行实验,发现成功率存在显著差距:领导者成功识别目标的概率为35.0%,而协作团队的成功率仅为17.0%。我们证明了“基于拉取”的主动查询协议在有效性上显著优于标准的“基于推送”的指令,成功案例中澄清请求的频率是前者的两倍。该研究揭示了主动不确定性降低机制在安全的人机和机器人间协作中的必要性。

🔬 方法详解

问题定义:本文旨在解决在非对称智能体协作中,知识丰富的领导者无法有效指导信息受限的跟随者的问题。现有方法未能充分考虑心智理论的缺失,导致协作失败率高。

核心思路:论文提出通过主动查询机制来减少沟通中的不确定性,允许跟随者在不理解时主动请求澄清,从而改善协作效果。

技术框架:整体架构包括领导者和跟随者两个智能体,领导者负责信息传递,跟随者通过主动查询获取必要信息。主要模块包括信息感知、查询生成和响应处理。

关键创新:最重要的技术创新在于引入了“基于拉取”的主动查询协议,相较于传统的“基于推送”的指令方式,显著提高了协作成功率。

关键设计:在实验中,设置了不同的查询频率和响应机制,采用了特定的损失函数来优化智能体的决策过程,确保在信息传递中减少误解。实验结果表明,优化后的设计有效提升了协作效率。

🖼️ 关键图片

📊 实验亮点

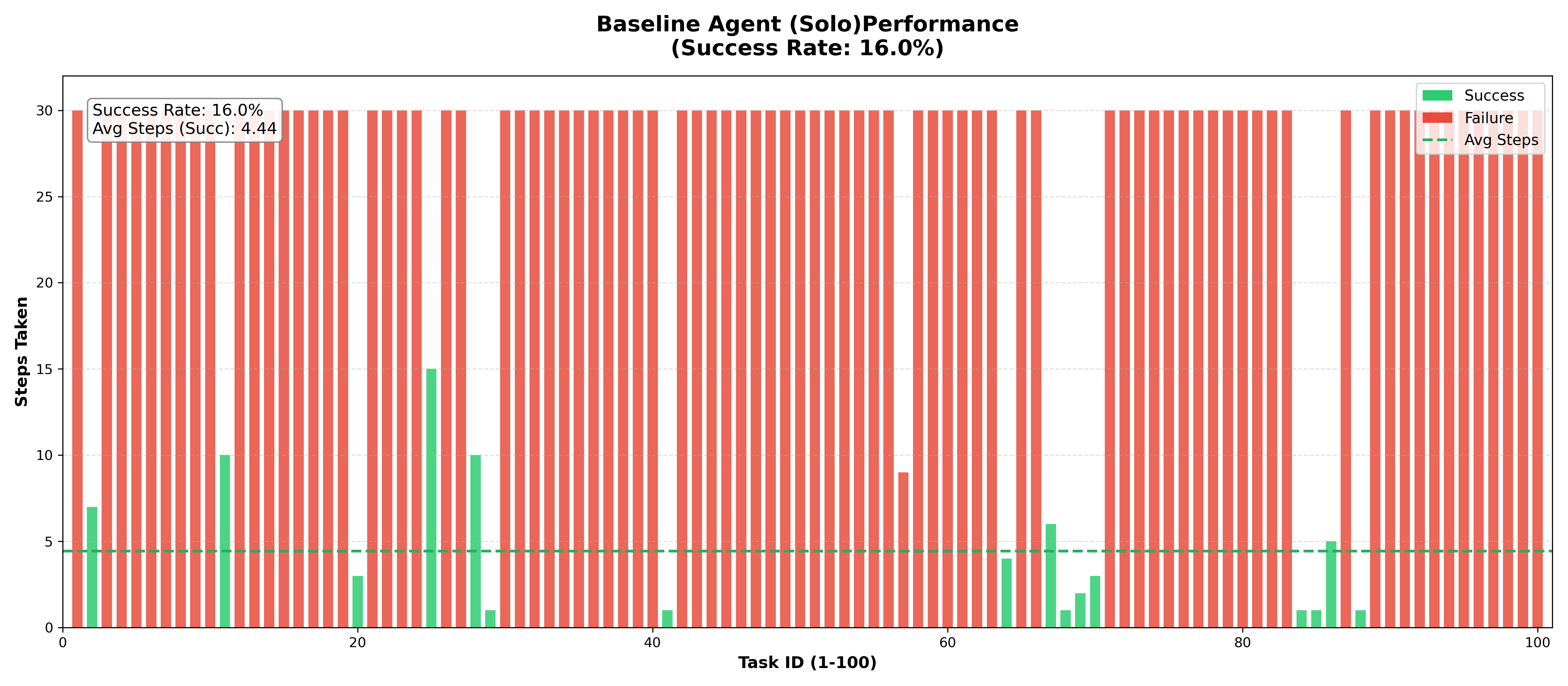

实验结果显示,领导者在35.0%的情况下成功识别目标,而协作团队的成功率仅为17.0%,表明沟通中的误解导致近50%的可行计划失败。采用主动查询协议的成功案例中,澄清请求的频率是传统方法的两倍,显著提升了协作效果。

🎯 应用场景

该研究的潜在应用领域包括人机协作、机器人团队协作以及智能家居系统等。通过改善智能体间的沟通机制,可以提升协作效率,减少误解,从而在实际应用中实现更高的安全性和可靠性。未来,该框架可扩展至更复杂的多智能体系统中,推动智能体协作技术的发展。

📄 摘要(原文)

Large Language Models (LLMs) act as powerful reasoning engines but struggle with "symbol grounding" in embodied environments, particularly when information is asymmetrically distributed. We investigate the Privileged Information Bias (or "Curse of Knowledge"), where a knowledgeable "Leader" agent fails to guide a sensor-limited "Follower" due to a lack of Theory of Mind. To quantify this phenomenon, we propose a novel Asymmetric Assistive Reasoning framework within AI2-THOR. Our experiments reveal a significant "Success Gap": while the Leader successfully perceives the target in 35.0% of episodes, the collaborative team succeeds only 17.0% of the time, implying that nearly 50% of feasible plans fail solely due to communicative grounding errors. We demonstrate that a "Pull-based" protocol (active querying) is significantly more robust than standard "Push-based" instruction, with successful episodes featuring 2x the frequency of clarification requests. This research isolates the mechanism of active uncertainty reduction as a prerequisite for safe human-AI and robot-robot collaboration.