Made-in China, Thinking in America:U.S. Values Persist in Chinese LLMs

作者: David Haslett, Linus Ta-Lun Huang, Leila Khalatbari, Janet Hui-wen Hsiao, Antoni B. Chan

分类: cs.CY, cs.AI

发布日期: 2025-12-13

💡 一句话要点

中美LLM价值观对比研究:中国LLM表现出更强的美国价值观倾向

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 价值观偏向 中美对比 道德基础 世界价值观调查

📋 核心要点

- 现有研究主要关注美国公司LLM的价值观偏向,缺乏对中国LLM的系统性评估。

- 论文通过对比中美LLM在道德和价值观问卷上的表现,揭示其价值观倾向。

- 实验发现,中国LLM在价值观上更接近美国人,提示方式和角色扮演影响有限。

📝 摘要(中文)

随着大型语言模型在信息获取和决策制定中扮演越来越重要的角色,它们正成为美国和中国等全球行为者之间软实力竞争的工具。目前,语言模型似乎与西方国家的价值观保持一致,但这种伦理偏见的证据主要来自美国公司制造的模型。当前最先进的模型包括一些中国制造的模型,因此我们首次大规模调查了中国和美国制造的模型如何与中国和美国的人保持一致。我们从十个中国模型和十个美国模型中获得了对道德基础问卷2.0和世界价值观调查的回答,并将它们的回答与来自数千名中国和美国人的回答进行了比较。我们发现,所有模型对这两项调查的回答都更像美国人,而不是中国人。当用中文提示模型或对模型施加中国角色时,这种对美国价值观的倾斜仅略有缓解。这些发现对不久的将来具有重要意义,在不久的将来,大型语言模型将生成人们消费的大部分内容,并塑造地缘政治中的规范影响力。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)在信息传播和决策辅助方面的影响力日益增强,因此其价值观偏向成为一个重要问题。以往的研究主要集中在美国公司开发的LLM,缺乏对中国LLM价值观的系统性评估。这使得我们难以了解不同文化背景下开发的LLM是否会带有特定的价值观倾向,以及这种倾向可能对社会产生的影响。

核心思路:本研究的核心思路是通过对比中美两国开发的LLM在标准化的价值观和道德观问卷上的表现,来评估它们的价值观倾向。研究假设,如果LLM受到其训练数据或开发环境的影响,那么中国开发的LLM应该更接近中国人的价值观,而美国开发的LLM应该更接近美国人的价值观。通过对比LLM与两国人群的回答,可以量化LLM的价值观偏向。

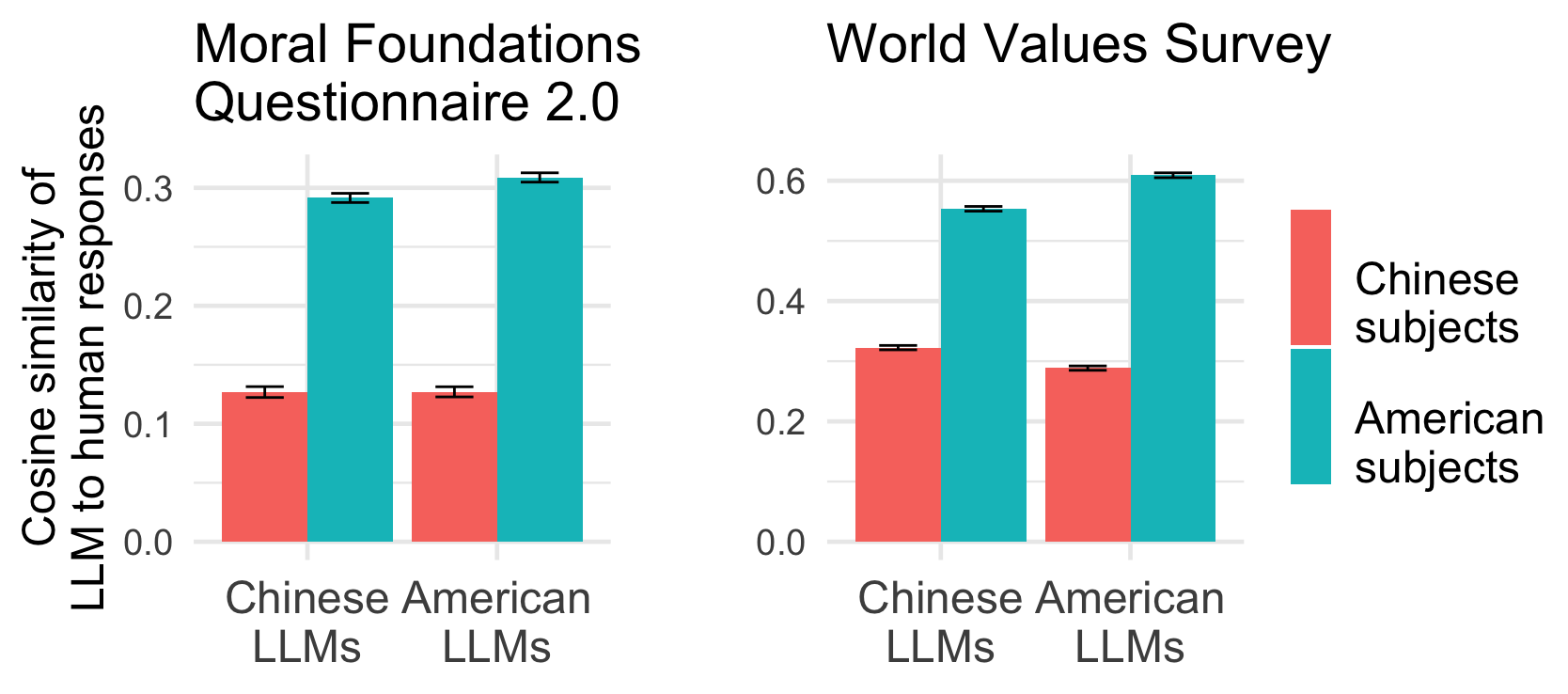

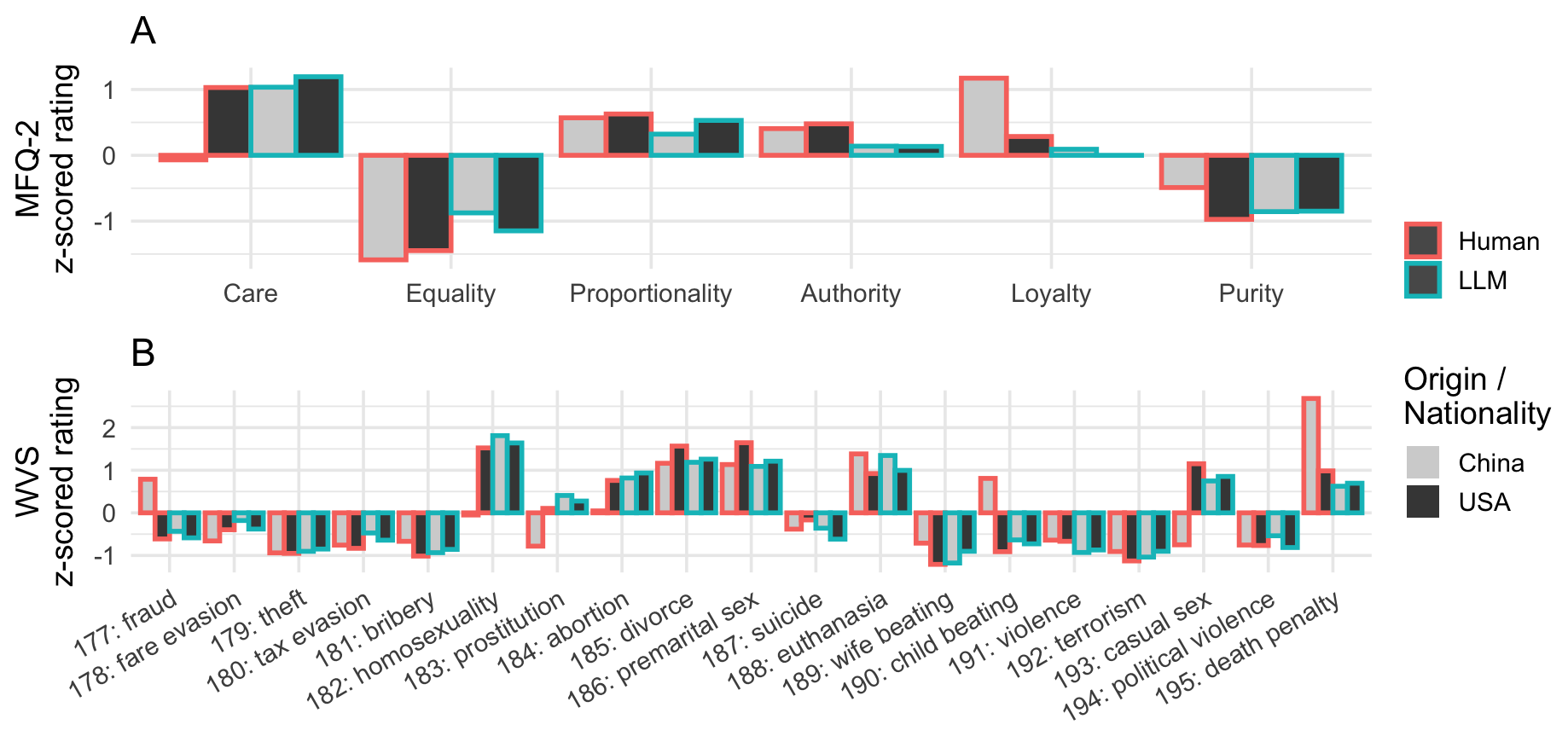

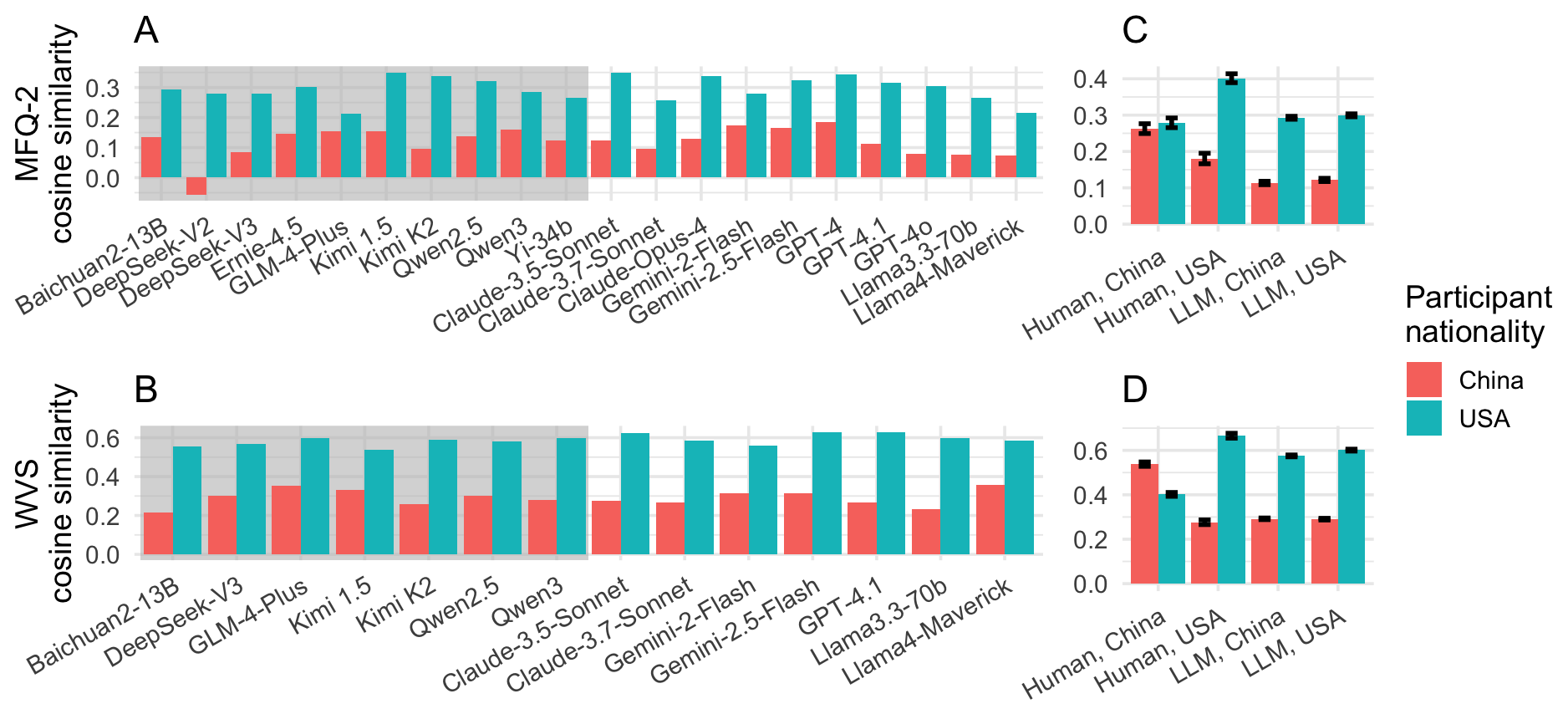

技术框架:研究采用了以下技术框架: 1. 选取了10个中国开发的LLM和10个美国开发的LLM。 2. 使用道德基础问卷2.0(Moral Foundations Questionnaire 2.0)和世界价值观调查(World Values Survey)作为评估工具。 3. 将LLM的回答与数千名中国人和美国人的回答进行对比。 4. 通过不同的提示方式(英文、中文)和角色扮演(赋予LLM中国人的角色)来考察这些因素对LLM价值观倾向的影响。 5. 使用统计方法分析LLM和人群的回答,量化LLM的价值观偏向。

关键创新:本研究的关键创新在于: 1. 首次大规模地评估了中国开发的LLM的价值观倾向。 2. 使用了标准化的价值观和道德观问卷,使得评估结果具有可比性。 3. 考察了提示方式和角色扮演对LLM价值观倾向的影响。 4. 揭示了中国开发的LLM在价值观上更接近美国人的现象,这与以往的认知有所不同。

关键设计:研究的关键设计包括: 1. 选取了具有代表性的中美LLM,包括不同规模和架构的模型。 2. 使用了经过验证的价值观和道德观问卷,确保评估的有效性。 3. 设计了多种提示方式和角色扮演情境,以考察不同因素对LLM价值观倾向的影响。 4. 采用了合适的统计方法,例如余弦相似度,来量化LLM和人群回答之间的相似度。

🖼️ 关键图片

📊 实验亮点

研究发现,所有被测试的LLM,无论产自中国还是美国,在道德基础问卷和世界价值观调查中的回答都更接近美国人而非中国人。即使使用中文提示或赋予模型中国人的角色,这种偏向也仅有轻微缓解。这表明LLM的价值观塑造可能受到更广泛的因素影响,例如训练数据的来源和算法设计。

🎯 应用场景

该研究结果对理解LLM的价值观偏向及其潜在影响具有重要意义。它可以帮助开发者更好地了解LLM的价值观来源,并采取措施减轻潜在的偏见。此外,该研究还可以为政策制定者提供参考,以制定更合理的LLM监管政策,确保LLM在社会中发挥积极作用。在国际关系领域,该研究提示我们需要关注LLM可能对不同文化和价值观产生的影响。

📄 摘要(原文)

As large language models increasingly mediate access to information and facilitate decision-making, they are becoming instruments in soft power competitions between global actors such as the United States and China. So far, language models seem to be aligned with the values of Western countries, but evidence for this ethical bias comes mostly from models made by American companies. The current crop of state-of-the-art models includes several made in China, so we conducted the first large-scale investigation of how models made in China and the USA align with people from China and the USA. We elicited responses to the Moral Foundations Questionnaire 2.0 and the World Values Survey from ten Chinese models and ten American models, and we compared their responses to responses from thousands of Chinese and American people. We found that all models respond to both surveys more like American people than like Chinese people. This skew toward American values is only slightly mitigated when prompting the models in Chinese or imposing a Chinese persona on the models. These findings have important implications for a near future in which large language models generate much of the content people consume and shape normative influence in geopolitics.