Instruction-Tuning Open-Weight Language Models for BPMN Model Generation

作者: Gökberk Çelikmasat, Atay Özgövde, Fatma Başak Aydemir

分类: cs.SE, cs.AI

发布日期: 2025-12-12

备注: Preprint. Under preparation for journal submission

💡 一句话要点

提出InstruBPM,通过指令微调开源大语言模型生成高质量BPMN流程模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: BPMN模型生成 指令微调 大语言模型 软件工程 流程自动化

📋 核心要点

- 现有软件工程领域模型构建耗时且依赖专家知识,阻碍了其广泛应用。

- InstruBPM通过指令微调开源大语言模型,直接从自然语言描述生成BPMN流程模型,降低建模门槛。

- 实验表明,InstruBPM在资源消耗更少的情况下,显著提升了BPMN模型生成的准确性和结构保真度。

📝 摘要(中文)

领域模型在软件工程中至关重要,它们促进共享理解、指导实现并支持自动化分析和模型驱动开发。然而,由于建模耗时且需要专业知识,从业者常常跳过建模。本文通过研究经指令微调的开源大语言模型是否能以经济高效且保护隐私的方式,直接从自然语言描述生成高质量BPMN流程模型来解决这一障碍。我们提出了InstruBPM,一种可复现的方法,用于准备配对的文本-图表数据,并通过参数高效微调和量化来指令微调开源大语言模型,以进行本地部署。我们通过互补的视角评估了微调后的模型:(i)使用BLEU、ROUGE-L和METEOR的文本/代码相似性,(ii)使用相对图编辑距离的结构保真度,(iii)使用外部工具检查的指南符合性,以及(iv)小型专家评审。使用多领域BPMN数据集的精选子集,我们在一致的提示机制下将微调后的模型与未微调的开源基线和强大的专有模型进行比较。我们紧凑的微调模型在序列和结构指标上优于所有基线,同时需要的资源要少得多;指南分析和专家反馈进一步表明,生成的图表在很大程度上遵循BPMN最佳实践,并且是有用的起点,可以减少建模工作。总体而言,与未微调的基线相比,指令微调提高了结构准确性和鲁棒性,并减少了对大量提示支架的依赖。我们公开发布了训练好的模型和脚本,以支持可重复性和进一步研究。

🔬 方法详解

问题定义:现有BPMN流程模型构建过程耗时且需要专业知识,导致软件工程师常常跳过建模环节。现有方法缺乏一种经济高效且易于使用的方式,能够直接从自然语言描述生成高质量的BPMN模型。

核心思路:论文的核心思路是利用指令微调(Instruction Tuning)技术,使开源大语言模型能够理解自然语言描述并生成对应的BPMN流程模型。通过指令微调,模型可以学习到自然语言描述与BPMN模型之间的映射关系,从而实现自动化的BPMN模型生成。

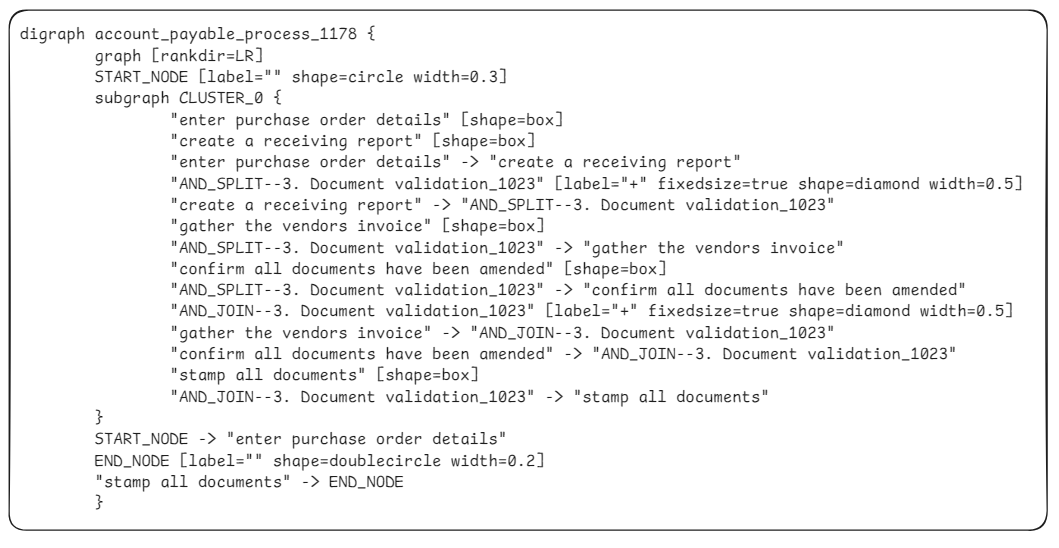

技术框架:InstruBPM框架主要包含以下几个阶段:1) 数据准备:构建配对的文本-BPMN图数据,用于指令微调。2) 模型选择:选择合适的开源大语言模型作为基础模型。3) 指令微调:使用参数高效微调(Parameter-Efficient Fine-Tuning)和量化(Quantization)技术,对基础模型进行指令微调,使其适应BPMN模型生成任务。4) 模型评估:使用多种指标(如BLEU、ROUGE-L、METEOR、相对图编辑距离等)以及专家评审,对生成的BPMN模型进行评估。

关键创新:该论文的关键创新在于将指令微调技术应用于BPMN模型生成任务,并提出了一种可复现的InstruBPM方法。与传统的基于规则或模板的方法相比,InstruBPM能够更好地理解自然语言描述的语义,并生成更准确、更符合BPMN规范的模型。此外,使用参数高效微调和量化技术,使得微调后的模型可以在资源有限的环境下部署。

关键设计:论文中使用了参数高效微调技术,例如LoRA (Low-Rank Adaptation),以减少微调所需的计算资源。同时,采用了量化技术,进一步压缩模型大小,使其更易于部署。在损失函数方面,可能使用了标准的语言模型损失函数,例如交叉熵损失,并结合BPMN模型的结构特点进行调整。具体的网络结构取决于所选择的开源大语言模型,但通常会包含Transformer结构。

🖼️ 关键图片

📊 实验亮点

InstruBPM在BPMN模型生成任务上取得了显著成果。实验结果表明,微调后的模型在序列和结构指标上均优于未微调的开源基线和强大的专有模型,同时需要的计算资源更少。例如,在结构保真度方面,InstruBPM显著降低了相对图编辑距离。专家评审也表明,生成的BPMN模型符合最佳实践,可作为建模的良好起点。

🎯 应用场景

该研究成果可应用于自动化软件工程领域,帮助软件工程师快速生成BPMN流程模型,从而提高开发效率和质量。此外,该方法还可用于业务流程分析、流程优化等领域,为企业提供更智能化的流程管理工具。未来,该技术有望进一步扩展到其他领域模型的自动生成,推动模型驱动开发的发展。

📄 摘要(原文)

Domain models are central to software engineering, as they enable a shared understanding, guide implementation, and support automated analyses and model-driven development. Yet, despite these benefits, practitioners often skip modeling because it is time-consuming and demands scarce expertise. We address this barrier by investigating whether open-weight large language models, adapted via instruction tuning, can generate high-quality BPMN process models directly from natural language descriptions in a cost-effective and privacy-preserving way. We introduce InstruBPM, a reproducible approach that prepares paired text-diagram data and instruction tunes an open source large language model with parameter-efficient fine-tuning and quantization for on-prem deployment. We evaluate the tuned model through complementary perspectives: (i) text/code similarity using BLEU, ROUGE-L, and METEOR, (ii) structural fidelity using Relative Graph Edit Distance, (iii) guidelines conformance using external tool checks, and (iv) a small expert review. Using a curated subset of a multi-domain BPMN dataset, we compare the tuned model with untuned open-weight baselines and strong proprietary models under consistent prompting regimes. Our compact tuned model outperforms all baselines across sequence and structural metrics while requiring substantially fewer resources; guideline analysis and expert feedback further indicate that the generated diagrams largely follow BPMN best practices and are useful starting points that reduce modeling effort. Overall, instruction tuning improves structural accuracy and robustness compared to untuned baselines and reduces reliance on heavy prompt scaffolding. We publicly share the trained models and scripts to support reproducibility and further research.