Towards Trustworthy Multi-Turn LLM Agents via Behavioral Guidance

作者: Gonca Gürsun

分类: cs.AI

发布日期: 2025-12-12

备注: Accepted to AAAI 2026 Workshop on Trust and Control in Agentic AI (TrustAgent)

💡 一句话要点

提出基于行为引导的多轮LLM Agent框架,提升任务可靠性和可验证性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 多轮对话 Agent 行为引导 可靠性 可验证性 强化学习 任务完成

📋 核心要点

- 现有LLM在多轮任务中表现出不足的可靠性和可验证性,难以保证行为的一致性和安全性。

- 该框架通过任务分析器、推理模块和生成模块的协同工作,引导LLM Agent在明确的行为约束下完成任务。

- 实验表明,随着Agent与环境交互,各组件共同进化,提升了Agent行为的可靠性和可信度。

📝 摘要(中文)

大型语言模型(LLM)展现出强大的推理和生成能力,但在多轮任务中的行为通常缺乏可靠性和可验证性。本文提出了一个任务完成框架,该框架使基于LLM的Agent能够在明确的行为指导下,在由强化学习形式化描述的环境中行动,这些环境具有明确的观察、动作和奖励信号。该框架集成了三个组件:一个轻量级的任务分析器,用于选择推理和生成策略;一个推理模块,用于学习可验证的观察-动作映射;以及一个生成模块,通过验证或确定性合成来强制执行符合约束的输出。结果表明,随着Agent与环境交互,这些组件共同进化,从而产生值得信赖的行为。

🔬 方法详解

问题定义:现有的大型语言模型在多轮对话和任务型Agent应用中,虽然具备强大的生成和推理能力,但其行为往往难以预测和验证。尤其是在需要与环境交互的任务中,LLM Agent容易产生不符合预期甚至有害的行为,缺乏可靠性和可信度。现有的方法难以对LLM的行为进行有效的约束和引导,导致Agent在复杂任务中表现不稳定。

核心思路:本文的核心思路是通过显式的行为指导来提升LLM Agent的可靠性和可验证性。具体而言,将Agent置于一个由强化学习形式化描述的环境中,并设计一个框架,该框架能够根据环境的观察、动作和奖励信号,对Agent的行为进行约束和引导。通过任务分析、可验证的推理和约束性生成,使Agent的行为更加可控和可信。

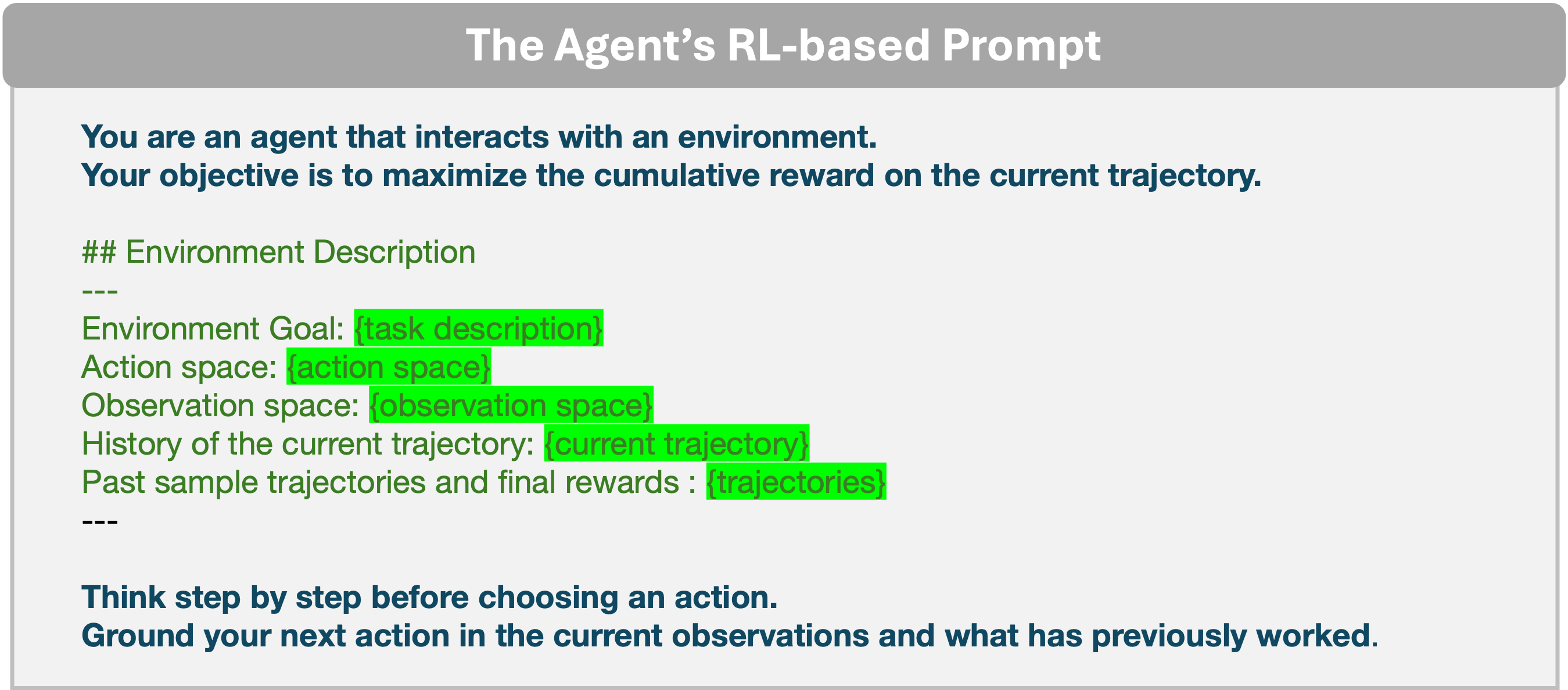

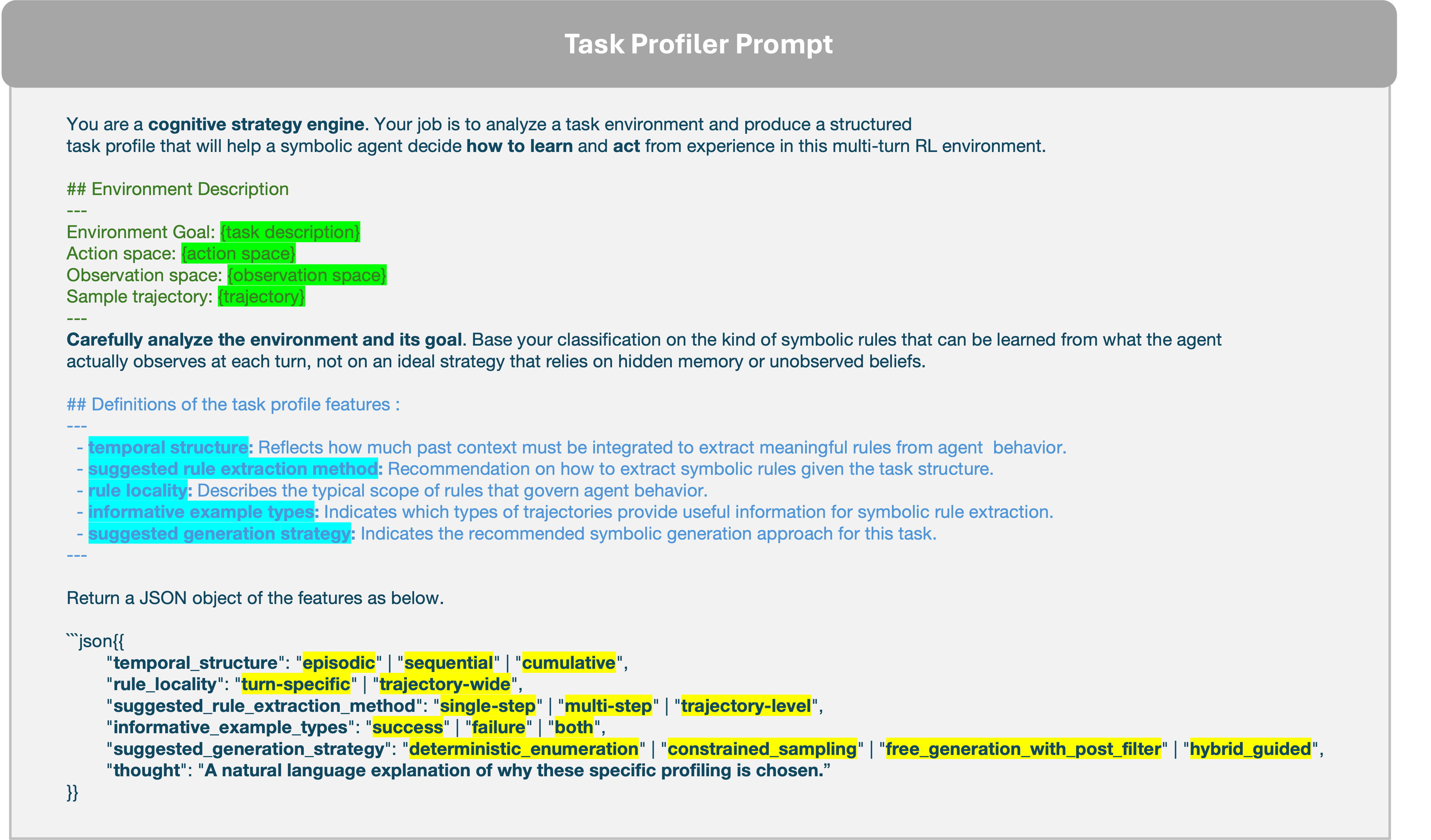

技术框架:该框架包含三个主要组件:1) 任务分析器:负责分析当前任务,并选择合适的推理和生成策略。这是一个轻量级的模块,旨在快速适应不同的任务需求。2) 推理模块:学习可验证的观察-动作映射。该模块的目标是建立环境观察和Agent动作之间的可靠关系,确保Agent的决策是基于可验证的证据。3) 生成模块:通过验证或确定性合成来强制执行符合约束的输出。该模块负责确保Agent生成的文本或动作符合预定义的约束条件,避免产生不符合预期或有害的行为。这三个模块协同工作,共同引导Agent在环境中完成任务。

关键创新:该论文的关键创新在于提出了一个集成的框架,能够通过显式的行为指导来提升LLM Agent的可靠性和可验证性。与现有方法相比,该框架更加注重对Agent行为的约束和引导,而不是仅仅依赖于LLM自身的生成能力。通过任务分析、可验证的推理和约束性生成,该框架能够有效地控制Agent的行为,使其更加可信和可靠。

关键设计:任务分析器采用轻量级设计,可以快速适应不同的任务需求。推理模块采用可验证的观察-动作映射学习方法,确保Agent的决策是基于可验证的证据。生成模块采用验证或确定性合成方法,强制执行符合约束的输出。具体的参数设置、损失函数和网络结构等技术细节在论文中未明确给出,属于未知信息。

🖼️ 关键图片

📊 实验亮点

论文主要提出了一个框架,并阐述了其设计思路,但摘要中没有提供具体的实验结果和性能数据。因此,无法总结具体的实验亮点。具体的性能数据、对比基线、提升幅度等信息未知。

🎯 应用场景

该研究成果可应用于需要高可靠性和安全性的多轮对话系统、智能客服、机器人控制等领域。例如,在医疗诊断、金融服务等场景中,Agent的行为必须是可信赖的,以避免产生误导或错误决策。该框架可以有效地提升Agent的可靠性和可验证性,使其能够安全地应用于这些关键领域。未来,该研究可以进一步扩展到更复杂的任务和环境,并与其他技术相结合,例如知识图谱、强化学习等,以实现更智能、更可靠的Agent。

📄 摘要(原文)

Large Language Models demonstrate strong reasoning and generation abilities, yet their behavior in multi-turn tasks often lacks reliability and verifiability. We present a task completion framework that enables LLM-based agents to act under explicit behavioral guidance in environments described by reinforcement learning formalisms with defined observation, action, and reward signals. The framework integrates three components: a lightweight task profiler that selects reasoning and generation strategies, a reasoning module that learns verifiable observation - action mappings, and a generation module that enforces constraint-compliant outputs through validation or deterministic synthesis. We show that as the agent interacts with the environment, these components co-evolve, yielding trustworthy behavior.