Developing and Evaluating a Large Language Model-Based Automated Feedback System Grounded in Evidence-Centered Design for Supporting Physics Problem Solving

作者: Holger Maus, Paul Tschisgale, Fabian Kieser, Stefan Petersen, Peter Wulff

分类: physics.ed-ph, cs.AI, cs.HC

发布日期: 2025-12-11

💡 一句话要点

提出基于证据中心设计的LLM物理问题自动反馈系统,但需警惕其潜在错误。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 自动反馈系统 证据中心设计 物理问题求解 教育应用

📋 核心要点

- 现有LLM在物理问题求解等需要专业知识的任务中,难以提供高质量的反馈,存在领域知识不足的问题。

- 论文提出基于证据中心设计(ECD)的LLM反馈系统,旨在提升LLM在复杂物理问题求解中的反馈质量。

- 实验表明该系统生成的反馈通常被认为有用且准确,但仍存在20%的事实错误,提示需谨慎使用。

📝 摘要(中文)

生成式人工智能为个性化和自适应学习提供了新的机遇,特别是通过基于大型语言模型(LLM)的反馈系统。虽然LLM可以为相对简单的概念性任务生成有效的反馈,但为需要高级领域专业知识的任务(如物理问题解决)提供高质量的反馈仍然是一个巨大的挑战。本研究提出了一个基于证据中心设计(ECD)的LLM物理问题自动反馈系统的设计,并评估了其在德国物理奥林匹克竞赛中的性能。参与者评估了生成的反馈的有用性和准确性,这些反馈通常被认为是有用且高度准确的。然而,深入分析显示,反馈在20%的情况下包含事实错误,这些错误通常未被学生注意到。我们讨论了对基于LLM的反馈系统不加批判地依赖所带来的风险,并概述了未来生成更具适应性和可靠性的基于LLM的反馈的潜在方向。

🔬 方法详解

问题定义:论文旨在解决LLM在物理问题求解中提供高质量反馈的难题。现有方法在处理需要高级领域知识的任务时表现不佳,容易产生不准确或误导性的反馈,阻碍学生的有效学习。

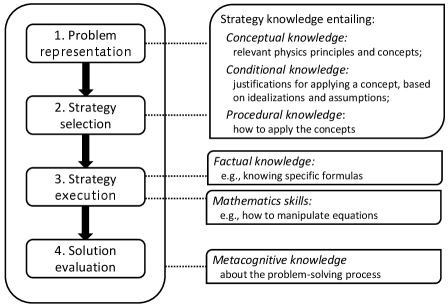

核心思路:论文的核心思路是将证据中心设计(ECD)的原则应用于LLM反馈系统的构建。ECD是一种系统化的评估设计方法,强调明确学习目标、证据和评估任务之间的关系。通过将ECD融入LLM反馈系统,可以更好地引导LLM生成与学习目标对齐、基于证据的反馈。

技术框架:该LLM反馈系统的整体框架包含以下几个主要模块:1) 问题表示模块:将物理问题转化为LLM可以理解的格式。2) 解题过程分析模块:利用LLM分析学生的解题步骤,识别潜在的错误或不足。3) 反馈生成模块:基于ECD原则,生成针对学生解题过程的个性化反馈。4) 反馈评估模块:评估反馈的质量和有效性。

关键创新:该论文的关键创新在于将证据中心设计(ECD)的理念引入到LLM反馈系统的设计中。传统的LLM反馈系统往往依赖于LLM自身的知识和推理能力,缺乏对学习目标和证据的明确指导。通过ECD,该系统可以更好地将反馈与学生的学习需求对齐,提高反馈的有效性和可靠性。

关键设计:论文中未详细描述具体的参数设置、损失函数或网络结构等技术细节。但ECD的应用体现在反馈生成模块的设计中,例如,系统会根据预定义的学习目标,评估学生的解题步骤是否提供了足够的证据来证明其对相关概念的理解,并据此生成相应的反馈。

🖼️ 关键图片

📊 实验亮点

实验结果表明,参与者普遍认为该系统生成的反馈是有用且高度准确的。然而,深入分析发现,反馈中存在20%的事实错误,且这些错误往往未被学生察觉。这一结果强调了在教育领域应用LLM时,必须重视其潜在的错误风险,并采取相应的措施来提高其可靠性。

🎯 应用场景

该研究成果可应用于在线教育平台、智能辅导系统等领域,为学生提供个性化的物理问题求解指导。通过不断改进LLM反馈系统的准确性和可靠性,有望显著提升学生的学习效率和学习效果。未来,该方法可以推广到其他需要专业知识的学科领域。

📄 摘要(原文)

Generative AI offers new opportunities for individualized and adaptive learning, particularly through large language model (LLM)-based feedback systems. While LLMs can produce effective feedback for relatively straightforward conceptual tasks, delivering high-quality feedback for tasks that require advanced domain expertise, such as physics problem solving, remains a substantial challenge. This study presents the design of an LLM-based feedback system for physics problem solving grounded in evidence-centered design (ECD) and evaluates its performance within the German Physics Olympiad. Participants assessed the usefulness and accuracy of the generated feedback, which was generally perceived as useful and highly accurate. However, an in-depth analysis revealed that the feedback contained factual errors in 20% of cases; errors that often went unnoticed by the students. We discuss the risks associated with uncritical reliance on LLM-based feedback systems and outline potential directions for generating more adaptive and reliable LLM-based feedback in the future.