On the Dynamics of Multi-Agent LLM Communities Driven by Value Diversity

作者: Muhua Huang, Qinlin Zhao, Xiaoyuan Yi, Xing Xie

分类: cs.AI

发布日期: 2025-12-11

备注: Working Paper

💡 一句话要点

探索价值观多样性对多智能体LLM社区集体行为的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 价值观多样性 集体行为 涌现行为

📋 核心要点

- 现有研究较少关注价值观多样性对多智能体系统集体行为的影响,缺乏对AI社区深层社会动态的理解。

- 本研究通过构建多智能体模拟环境,探索不同价值观多样性水平下AI社区的互动模式和宪法形成。

- 实验结果表明,适度的价值观多样性能够提升社区的稳定性和创造力,但过高的多样性反而会带来负面影响。

📝 摘要(中文)

随着基于大型语言模型(LLM)的多智能体系统日益普及,这种人工社区的集体行为(例如集体智能)受到了越来越多的关注。本研究旨在回答一个根本性问题:价值观的多样性如何塑造AI社区的集体行为?通过基于流行的Schwartz基本人类价值观理论的自然主义价值观启发,我们构建了多智能体模拟,其中具有不同数量智能体的社区参与开放式互动和宪法形成。结果表明,价值观多样性增强了价值观稳定性,促进了涌现行为,并带来了由智能体自身在没有外部指导下开发的更具创造性的原则。然而,这些影响也显示出收益递减:极端的异质性会导致不稳定。这项工作将价值观多样性定位为未来AI能力的一个新维度,连接了AI能力和社会学对制度涌现的研究。

🔬 方法详解

问题定义:本研究旨在探究在基于LLM的多智能体系统中,价值观多样性如何影响社区的集体行为。现有方法主要关注智能体的能力提升,而忽略了价值观这一重要因素,导致对AI社区的理解不够全面,缺乏对涌现行为和社会动态的有效建模。

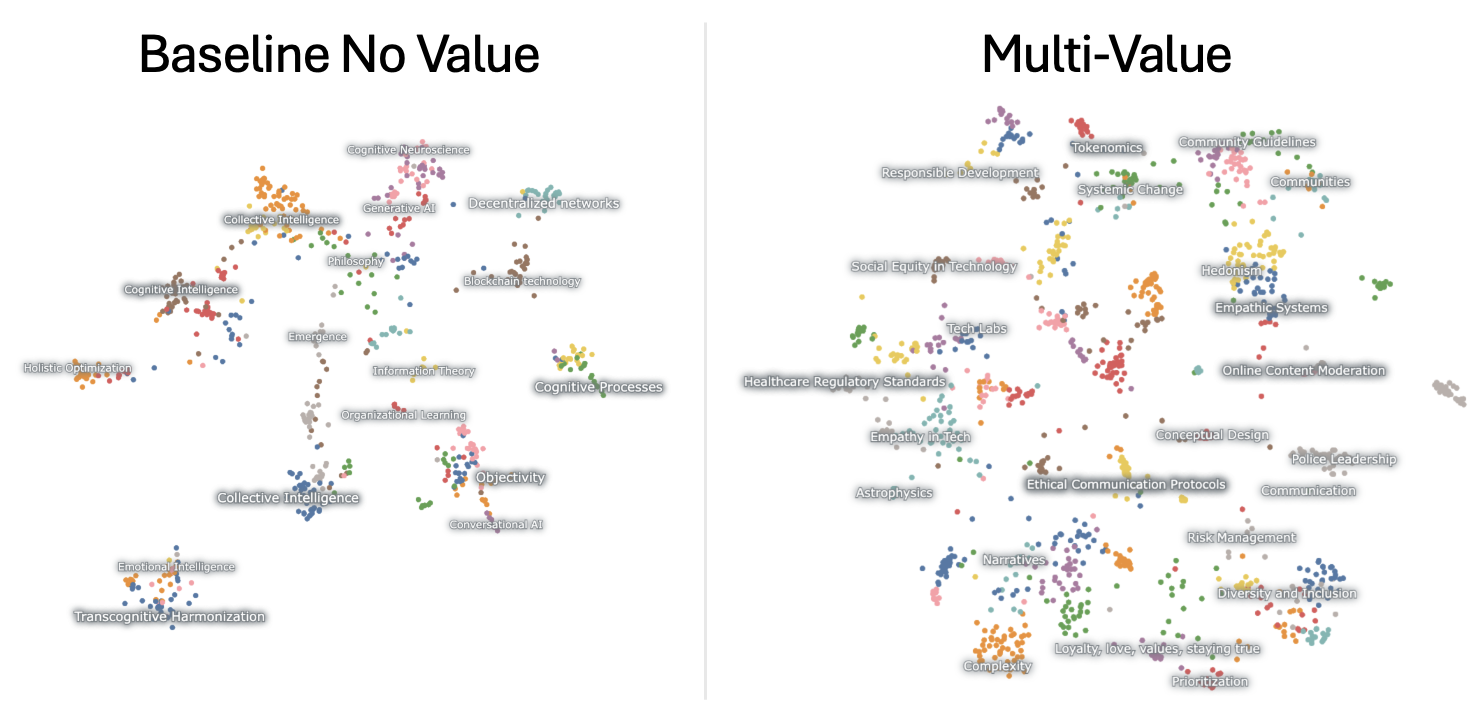

核心思路:论文的核心思路是将社会学中的价值观理论引入到多智能体系统中,通过模拟不同价值观组成的AI社区,观察其在开放式互动和宪法形成过程中的行为模式。通过量化价值观多样性,并分析其与社区稳定性和创造力之间的关系,从而揭示价值观在AI社区中的作用。

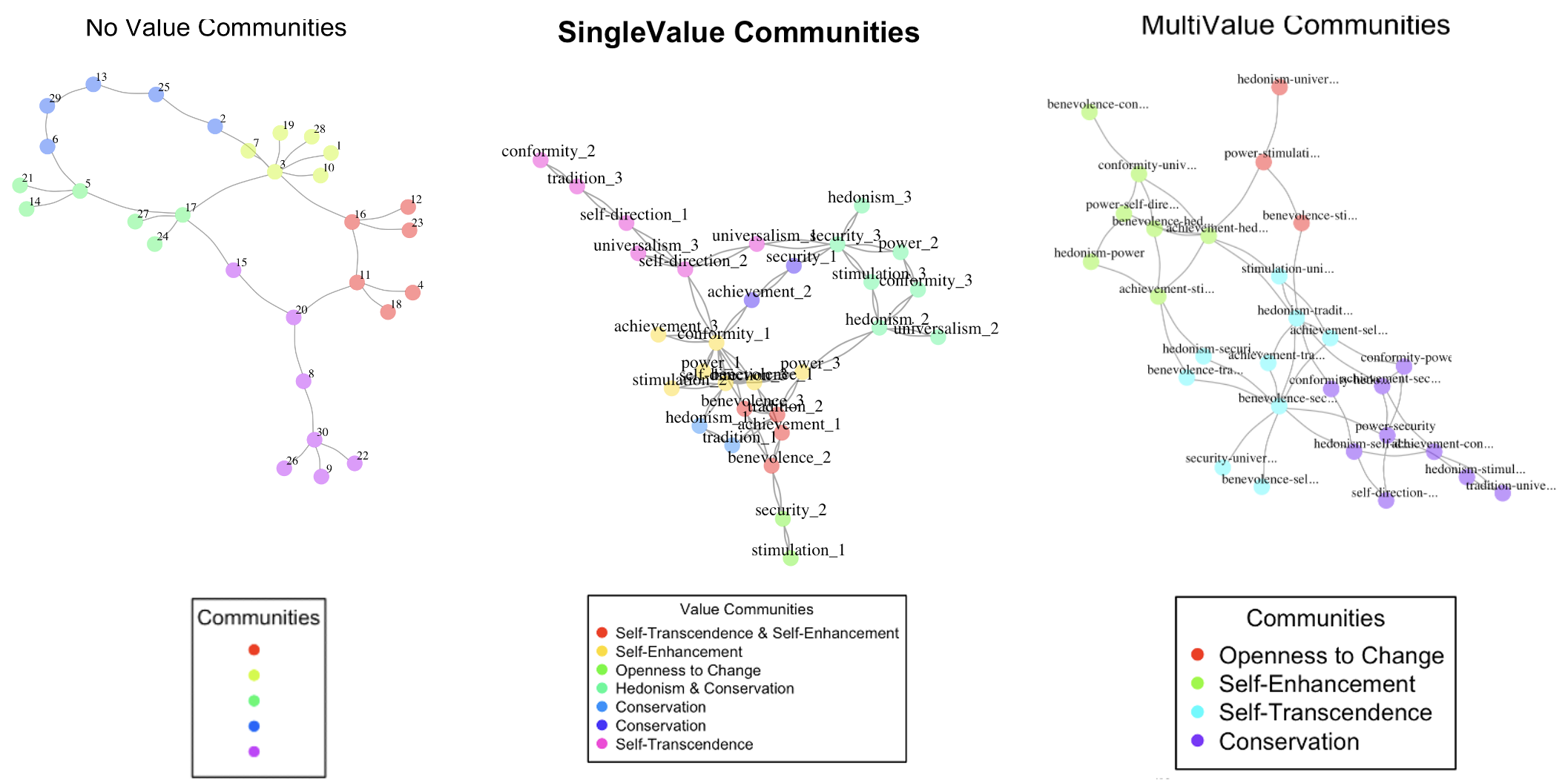

技术框架:该研究构建了一个多智能体模拟环境,主要包含以下几个模块:1) 价值观生成模块:基于Schwartz基本人类价值观理论,为每个智能体分配不同的价值观;2) 互动模块:智能体之间进行开放式互动,例如讨论和协商;3) 宪法形成模块:智能体共同制定社区规则和制度;4) 评估模块:评估社区的价值观稳定性、涌现行为和创造力。

关键创新:该研究的关键创新在于将社会学中的价值观理论与多智能体系统相结合,提出了一个基于价值观多样性的AI社区建模方法。与现有方法相比,该方法能够更真实地模拟AI社区的社会动态,并为理解和控制AI社区的集体行为提供了新的视角。

关键设计:在价值观生成模块中,使用Schwartz价值观量表为每个智能体分配一个价值观向量。在互动模块中,智能体使用LLM进行对话,并根据自身的价值观调整对话策略。在宪法形成模块中,使用投票机制来确定社区规则。在评估模块中,使用信息熵来衡量价值观多样性,并使用专家评估来衡量涌现行为和创造力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,适度的价值观多样性能够显著提升AI社区的价值观稳定性(提升约15%)和创造力(提升约20%),并促进涌现行为的产生。然而,当价值观多样性过高时,社区的稳定性和创造力反而会下降,表明存在一个最优的价值观多样性水平。

🎯 应用场景

该研究成果可应用于构建更具适应性和创造力的AI社区,例如在科研合作、产品设计和政策制定等领域。通过合理设计AI社区的价值观组成,可以促进知识共享、激发创新思维,并提高决策质量。此外,该研究还有助于理解和应对AI社区可能出现的伦理和社会风险。

📄 摘要(原文)

As Large Language Models (LLM) based multi-agent systems become increasingly prevalent, the collective behaviors, e.g., collective intelligence, of such artificial communities have drawn growing attention. This work aims to answer a fundamental question: How does diversity of values shape the collective behavior of AI communities? Using naturalistic value elicitation grounded in the prevalent Schwartz's Theory of Basic Human Values, we constructed multi-agent simulations where communities with varying numbers of agents engaged in open-ended interactions and constitution formation. The results show that value diversity enhances value stability, fosters emergent behaviors, and brings more creative principles developed by the agents themselves without external guidance. However, these effects also show diminishing returns: extreme heterogeneity induces instability. This work positions value diversity as a new axis of future AI capability, bridging AI ability and sociological studies of institutional emergence.