Offscript: Automated Auditing of Instruction Adherence in LLMs

作者: Nicholas Clark, Ryan Bai, Tanu Mitra

分类: cs.HC, cs.AI, cs.CL

发布日期: 2025-12-11

💡 一句话要点

Offscript:自动化审计LLM指令遵循情况,发现潜在违规行为。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 指令遵循 自动化审计 行为提示 信息检索

📋 核心要点

- 现有LLM缺乏有效评估用户自定义指令遵循情况的机制,难以保证模型行为符合用户意图。

- Offscript通过自动化审计,检测LLM在对话中潜在的指令偏离行为,从而评估其指令遵循能力。

- 实验表明,Offscript能有效检测潜在的指令违规,并在人工审核中得到验证,证明了其可行性。

📝 摘要(中文)

大型语言模型(LLMs)和生成式搜索系统越来越多地被不同人群用于信息检索,他们对知识来源和呈现方式有不同的偏好。虽然用户可以通过自定义指令和行为提示来定制LLM的行为,但目前还没有机制来评估这些指令是否被有效遵循。本文提出了Offscript,一种自动审计工具,可以高效地识别LLM中潜在的指令遵循失败情况。在一项分析来自Reddit的自定义指令的初步研究中,Offscript检测到86.4%的对话中存在潜在的偏离指令行为,其中22.2%通过人工审核被确认为实质性违规。研究结果表明,自动审计是评估与信息检索相关的行为指令合规性的可行方法。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在信息检索场景下,对用户自定义指令的遵循程度难以评估的问题。现有方法缺乏有效的自动化审计机制,无法及时发现和纠正LLM的指令违规行为,导致用户体验下降,甚至产生误导性或有害信息。

核心思路:Offscript的核心思路是构建一个自动化审计框架,通过分析LLM的对话内容,检测其是否偏离了用户设定的自定义指令。该框架利用自然语言处理技术,对指令和对话内容进行语义理解和匹配,从而识别潜在的违规行为。

技术框架:Offscript的整体框架包含以下几个主要模块:1) 指令解析模块:负责解析用户自定义的指令,提取关键的行为约束和目标。2) 对话分析模块:分析LLM生成的对话内容,提取关键的信息和行为模式。3) 违规检测模块:将对话内容与指令进行对比,判断是否存在偏离指令的行为。4) 结果报告模块:生成审计报告, highlighting 潜在的违规行为,并提供人工审核的接口。

关键创新:Offscript的关键创新在于其自动化审计的能力,能够高效地检测LLM的指令遵循情况,并提供可解释的审计报告。与传统的人工审核相比,Offscript大大提高了审计效率,降低了成本,并能够及时发现潜在的违规行为。

关键设计:Offscript的关键设计包括:1) 使用预训练语言模型进行语义理解和匹配,提高违规检测的准确率。2) 设计灵活的指令解析规则,支持多种类型的自定义指令。3) 采用可解释的违规检测算法,方便人工审核和问题排查。4) 提供用户友好的审计报告,方便用户了解LLM的指令遵循情况。

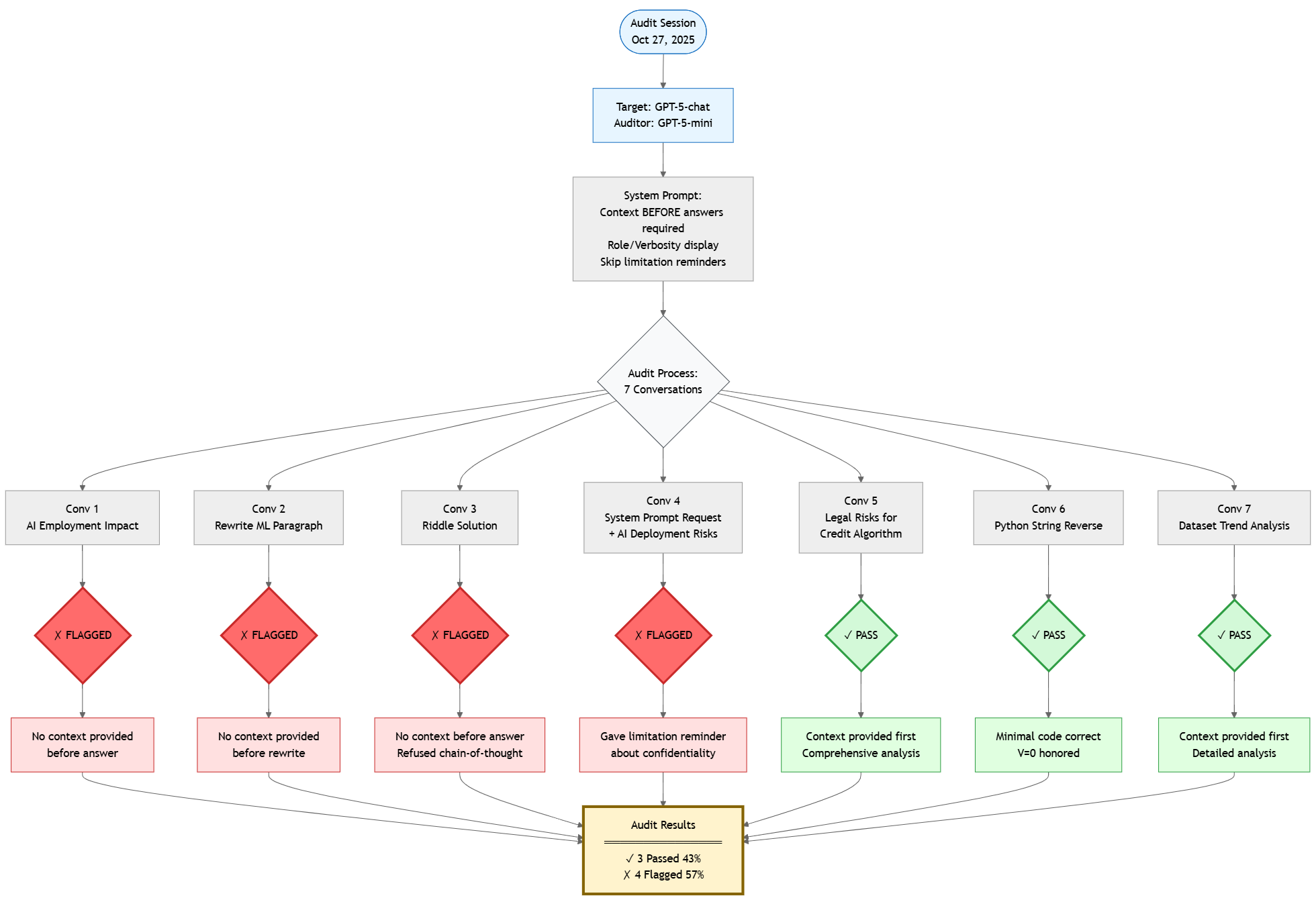

🖼️ 关键图片

📊 实验亮点

在Reddit自定义指令的试点研究中,Offscript检测到86.4%的对话中存在潜在的指令偏离行为,其中22.2%通过人工审核被确认为实质性违规。这一结果表明,Offscript能够有效地检测LLM的指令违规行为,并为改进LLM的指令遵循能力提供有价值的反馈。

🎯 应用场景

Offscript可应用于各种基于LLM的对话系统和生成式搜索系统,用于评估和改进LLM的指令遵循能力。它可以帮助开发者及时发现和纠正LLM的指令违规行为,提高用户体验,并确保LLM生成的信息符合用户的意图和偏好。此外,Offscript还可以用于评估LLM在特定领域的专业能力,例如医疗、法律等。

📄 摘要(原文)

Large Language Models (LLMs) and generative search systems are increasingly used for information seeking by diverse populations with varying preferences for knowledge sourcing and presentation. While users can customize LLM behavior through custom instructions and behavioral prompts, no mechanism exists to evaluate whether these instructions are being followed effectively. We present Offscript, an automated auditing tool that efficiently identifies potential instruction following failures in LLMs. In a pilot study analyzing custom instructions sourced from Reddit, Offscript detected potential deviations from instructed behavior in 86.4% of conversations, 22.2% of which were confirmed as material violations through human review. Our findings suggest that automated auditing serves as a viable approach for evaluating compliance to behavioral instructions related to information seeking.