Using reinforcement learning to probe the role of feedback in skill acquisition

作者: Antonio Terpin, Raffaello D'Andrea

分类: cs.AI, cs.LG, cs.RO, eess.SY

发布日期: 2025-12-09

备注: Website: https://antonioterpin.com/fluids-control

💡 一句话要点

利用强化学习探究反馈在技能习得中的作用,应用于流体控制

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 技能习得 反馈控制 流体控制 物理系统 深度学习 机器人控制

📋 核心要点

- 现有方法难以在复杂物理系统中精确建模和控制,阻碍了技能习得的研究。

- 采用强化学习智能体与物理水槽中的旋转圆柱体交互,通过奖励函数引导智能体学习阻力控制策略。

- 实验表明,高维流动反馈能使智能体快速发现高性能策略,且执行时无需反馈。

📝 摘要(中文)

许多高水平的人类活动在几乎没有或完全没有外部反馈的情况下完成。为了在完全受控的条件下研究技能习得过程,本文绕过人类受试者,直接将通用强化学习智能体与桌面循环水槽中的旋转圆柱体连接,以最大化或最小化阻力。该设置具有几个优点:首先,它是一个物理系统,具有丰富的交互和复杂的动力学;其次,目标(阻力最小化或最大化)易于陈述并可以直接体现在奖励中,但好的策略事先并不明显;第三,数十年前的实验研究提供了简单、高性能的开环策略;最后,该设置成本低廉且比人类研究更容易重现。实验表明,高维流动反馈使智能体能够在几分钟的真实世界交互中发现高性能的阻力控制策略。当在没有任何反馈的情况下重放相同的动作序列时,获得了几乎相同的性能。这表明执行学习到的策略不需要反馈,特别是流动反馈。令人惊讶的是,在训练期间没有流动反馈的情况下,智能体无法发现任何在阻力最大化方面表现良好的策略,但在阻力最小化方面仍然成功,尽管速度较慢且不太可靠。研究表明,学习一项高性能技能可能需要比执行它更丰富的信息,并且学习条件可能是友好的或有害的,这完全取决于目标,而不是动力学或策略复杂性。

🔬 方法详解

问题定义:论文旨在研究在技能习得过程中,反馈所起的作用。现有方法难以在复杂物理系统中精确建模和控制,例如流体动力学系统,这使得研究技能习得变得困难。此外,人类实验存在可重复性差、成本高等问题。

核心思路:论文的核心思路是利用强化学习智能体与物理环境直接交互,通过奖励函数引导智能体学习控制策略。通过控制水槽中旋转圆柱体的运动,实现阻力的最大化或最小化。这种方法避免了复杂的物理建模,并提供了一个可控且可重复的实验环境。

技术框架:整体框架包括一个强化学习智能体和一个物理水槽系统。智能体通过执行动作(控制圆柱体的旋转)与水槽交互,并根据阻力大小获得奖励。智能体使用深度强化学习算法(具体算法未知)进行训练,以学习最优的控制策略。训练过程中,智能体可以选择接收或不接收流动反馈。

关键创新:该研究的关键创新在于将强化学习应用于一个真实的、复杂的物理系统,并系统地研究了反馈在技能习得中的作用。通过比较有无流动反馈的训练结果,揭示了反馈对于学习高性能策略的重要性。此外,该研究还表明,学习和执行技能所需的反馈信息可能不同。

关键设计:论文中未明确给出强化学习算法的具体细节,例如网络结构、损失函数、优化器等。但是,实验中使用了高维流动反馈作为输入,这表明智能体能够处理复杂的感知信息。奖励函数的设计直接关系到智能体的学习目标,因此阻力最大化和最小化的奖励函数设计是关键。

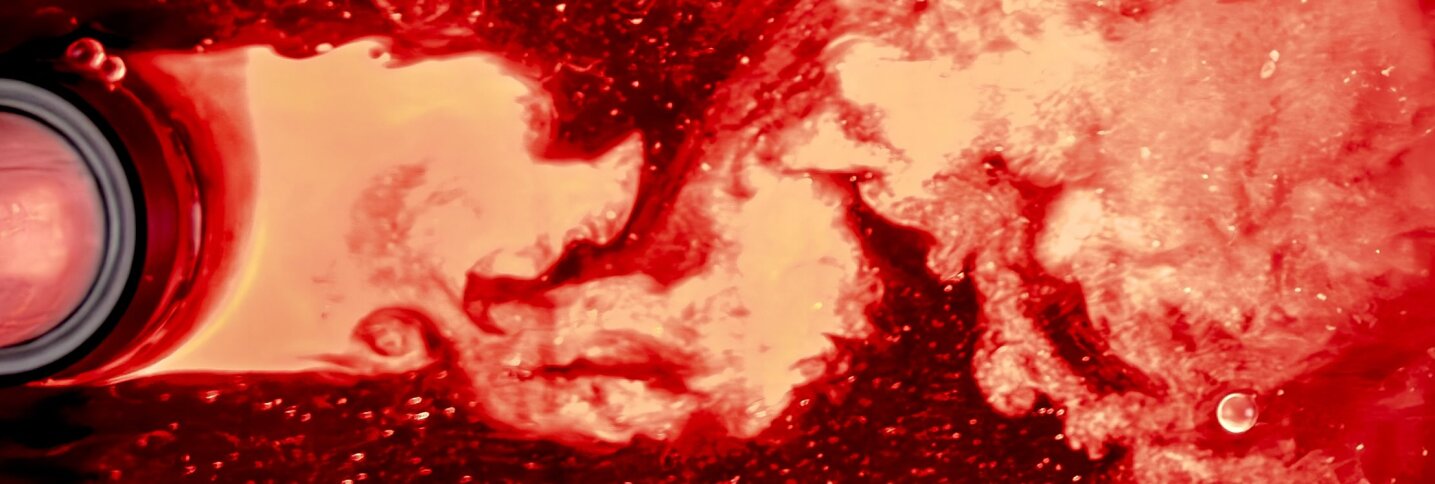

🖼️ 关键图片

📊 实验亮点

实验结果表明,在有流动反馈的情况下,智能体能够在几分钟内学会高性能的阻力控制策略。更重要的是,即使在没有反馈的情况下重放学习到的动作序列,也能获得几乎相同的性能,这表明执行学习到的策略不需要反馈。此外,研究发现,在没有流动反馈的情况下,智能体在阻力最大化任务中表现不佳,但在阻力最小化任务中仍然能够成功,尽管速度较慢。

🎯 应用场景

该研究的潜在应用领域包括流体控制、机器人控制和自动化。通过强化学习,可以开发出在复杂环境中执行任务的高性能控制策略,例如飞行器控制、水下机器人导航等。该研究也为理解人类技能习得提供了新的视角,有助于开发更有效的训练方法。

📄 摘要(原文)

Many high-performance human activities are executed with little or no external feedback: think of a figure skater landing a triple jump, a pitcher throwing a curveball for a strike, or a barista pouring latte art. To study the process of skill acquisition under fully controlled conditions, we bypass human subjects. Instead, we directly interface a generalist reinforcement learning agent with a spinning cylinder in a tabletop circulating water channel to maximize or minimize drag. This setup has several desirable properties. First, it is a physical system, with the rich interactions and complex dynamics that only the physical world has: the flow is highly chaotic and extremely difficult, if not impossible, to model or simulate accurately. Second, the objective -- drag minimization or maximization -- is easy to state and can be captured directly in the reward, yet good strategies are not obvious beforehand. Third, decades-old experimental studies provide recipes for simple, high-performance open-loop policies. Finally, the setup is inexpensive and far easier to reproduce than human studies. In our experiments we find that high-dimensional flow feedback lets the agent discover high-performance drag-control strategies with only minutes of real-world interaction. When we later replay the same action sequences without any feedback, we obtain almost identical performance. This shows that feedback, and in particular flow feedback, is not needed to execute the learned policy. Surprisingly, without flow feedback during training the agent fails to discover any well-performing policy in drag maximization, but still succeeds in drag minimization, albeit more slowly and less reliably. Our studies show that learning a high-performance skill can require richer information than executing it, and learning conditions can be kind or wicked depending solely on the goal, not on dynamics or policy complexity.