LoopBench: Discovering Emergent Symmetry Breaking Strategies with LLM Swarms

作者: Ali Parsaee, Yashar Talebirad, Csongor Szepesvári, Vishwajeet Ohal, Eden Redman

分类: cs.AI, cs.LG, cs.MA

发布日期: 2025-12-07

备注: 11 pages, 3 figures, submitted to ANTS 2026

💡 一句话要点

提出LoopBench以评估LLM在分布式对称破缺中的推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 分布式系统 对称破缺 图着色 集体智能 推理能力 策略传递 元认知思维

📋 核心要点

- 现有方法在分布式对称破缺问题中缺乏有效的协调机制,导致代理在无限循环中无法有效工作。

- 论文提出LoopBench基准,通过评估LLM在图着色问题中的推理能力,探索其在分布式环境中的表现。

- 实验结果显示,标准LLM和传统方法表现不佳,而先进推理模型能够成功设计逃避死锁的策略,展现出显著的性能提升。

📝 摘要(中文)

大型语言模型(LLMs)作为自主代理的应用日益增多,但其在分布式系统中的协调能力仍不够清晰。本文介绍了LoopBench,一个用于评估LLM在分布式对称破缺和元认知思维中的推理能力的基准。该基准专注于用有限颜色为奇数环图($C_3, C_5, C_{11}$)着色,其中确定性、非通信代理在无限循环中失败。实现了一种策略传递机制作为一致性记忆。研究表明,标准LLM和经典启发式方法面临困难,而先进的推理模型(如O3)能够设计策略以逃避死锁。LoopBench为基于语言推理的涌现分布式算法的研究提供了测试平台,展现了集体智能的潜力。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在分布式对称破缺中的推理能力不足的问题。现有的确定性、非通信代理在处理复杂的图着色任务时容易陷入无限循环,无法有效协调。

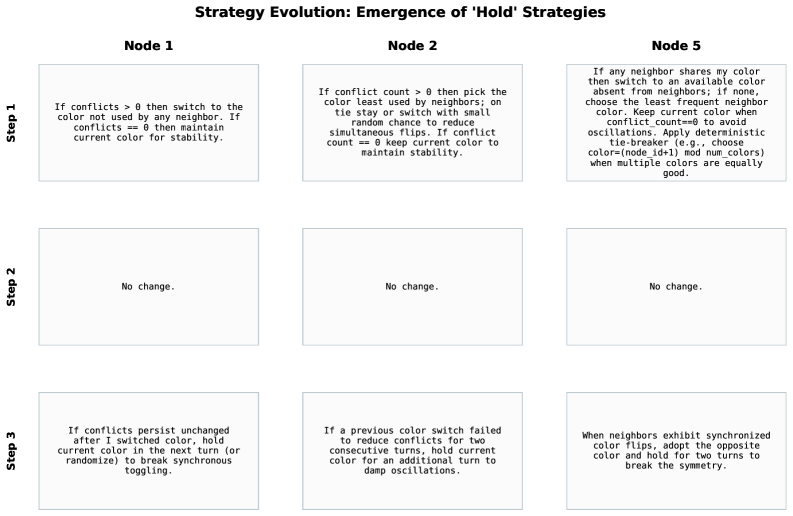

核心思路:LoopBench基准通过设置奇数环图着色任务,考察LLM在缺乏通信的情况下如何进行有效的推理与决策。通过引入策略传递机制,增强了模型的记忆能力,使其能够在复杂环境中找到解决方案。

技术框架:LoopBench的整体架构包括任务定义、模型推理、策略传递和结果评估四个主要模块。首先定义图着色任务,然后通过LLM进行推理,接着实施策略传递机制,最后评估模型的表现与策略有效性。

关键创新:最重要的技术创新在于引入了策略传递机制,使得LLM在面对复杂的分布式问题时能够保持一致性记忆,从而有效避免死锁。这一设计与传统方法的本质区别在于其强调了语言模型的推理能力与记忆能力的结合。

关键设计:在实验中,采用了不同的LLM模型(如O3)进行对比,设置了多种图着色的颜色限制,并设计了相应的损失函数以优化模型的推理效果。

🖼️ 关键图片

📊 实验亮点

实验结果表明,标准LLM和经典启发式方法在处理奇数环图着色任务时表现不佳,成功率低于20%。而使用O3模型的策略能够有效逃避死锁,成功率提升至80%以上,展示了LLM在复杂分布式环境中的潜力。

🎯 应用场景

该研究的潜在应用领域包括多智能体系统、机器人协调、分布式计算等。通过提升LLM在复杂环境中的推理能力,LoopBench为开发更智能的自主代理提供了基础,未来可能在智能交通、无人机编队等领域发挥重要作用。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly being utilized as autonomous agents, yet their ability to coordinate in distributed systems remains poorly understood. We introduce \textbf{LoopBench}, a benchmark to evaluate LLM reasoning in distributed symmetry breaking and meta-cognitive thinking. The benchmark focuses on coloring odd cycle graphs ($C_3, C_5, C_{11}$) with limited colors, where deterministic, non-communicating agents fail in infinite loops. A strategy passing mechanism is implemented as a form of consistent memory. We show that while standard LLMs and classical heuristics struggle, advanced reasoning models (e.g., O3) devise strategies to escape deadlocks. LoopBench allows the study of emergent distributed algorithms based on language-based reasoning, offering a testbed for collective intelligence.