ELANA: A Simple Energy and Latency Analyzer for LLMs

作者: Hung-Yueh Chiang, Bokun Wang, Diana Marculescu

分类: cs.DC, cs.AI

发布日期: 2025-12-07

🔗 代码/项目: GITHUB

💡 一句话要点

ELANA:一款轻量级的LLM能耗与延迟分析工具,支持多GPU和边缘设备。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 性能分析 延迟测量 功耗评估 边缘计算 Hugging Face 模型优化

📋 核心要点

- 现有LLM部署面临延迟和功耗挑战,尤其是在边缘设备上,缺乏轻量级分析工具。

- ELANA通过轻量级设计,提供模型大小、KV缓存、延迟等关键指标的快速分析能力。

- ELANA支持Hugging Face模型,提供命令行界面和能耗记录,易于定制和扩展。

📝 摘要(中文)

大型语言模型(LLM)的延迟和功耗是在各种硬件平台(从移动边缘设备到云GPU集群)上部署它们时的主要限制。基准测试对于优化模型部署和下一代模型开发的效率至关重要。为了满足这一需求,我们开源了一个简单的LLM评估分析工具 extbf{ELANA}。ELANA被设计为一个轻量级的、学术友好的分析器,用于分析LLM的模型大小、键值(KV)缓存大小、预填充延迟(首个token生成时间,TTFT)、生成延迟(每个输出token的时间,TPOT)和端到端延迟(最后一个token生成时间,TTLT),支持多GPU和边缘GPU平台。它支持Hugging Face上所有公开可用的模型,并提供一个简单的命令行界面,以及可选的能耗记录。此外,ELANA完全兼容流行的Hugging Face API,并且可以轻松定制或适配压缩或低比特宽度的模型,使其成为高效LLM研究或小规模概念验证研究的理想选择。ELANA分析工具已在https://github.com/enyac-group/Elana 上发布。

🔬 方法详解

问题定义:现有的大型语言模型在部署时面临着延迟和功耗的挑战,尤其是在资源受限的边缘设备上。现有的分析工具可能过于复杂或不适用于学术研究,缺乏一个轻量级、易于使用的工具来评估LLM的性能瓶颈。

核心思路:ELANA的核心思路是提供一个简单、轻量级的分析工具,能够快速评估LLM的关键性能指标,如模型大小、KV缓存大小、预填充延迟、生成延迟和端到端延迟。通过提供这些关键指标,研究人员和开发人员可以更好地了解LLM的性能瓶颈,并进行优化。

技术框架:ELANA的整体框架围绕Hugging Face API构建,用户可以通过简单的命令行界面来分析LLM。它主要包含以下几个模块:模型加载模块(负责从Hugging Face Hub加载模型)、性能分析模块(负责测量延迟和功耗等指标)、结果输出模块(负责将分析结果以易于理解的格式输出)。ELANA支持多GPU和边缘GPU平台,并提供可选的能耗记录功能。

关键创新:ELANA的关键创新在于其轻量级和易用性。它避免了复杂的配置和依赖,使得研究人员可以快速地对LLM进行性能分析。此外,ELANA完全兼容Hugging Face API,可以轻松地应用于各种LLM模型,包括压缩或低比特宽度的模型。

关键设计:ELANA的关键设计包括:1) 使用Hugging Face Transformers库进行模型加载和推理;2) 使用Python的time模块和torch.cuda.Event API来精确测量延迟;3) 使用nvidia-smi命令行工具来记录GPU的功耗(可选);4) 提供一个简单的命令行界面,方便用户进行配置和运行。

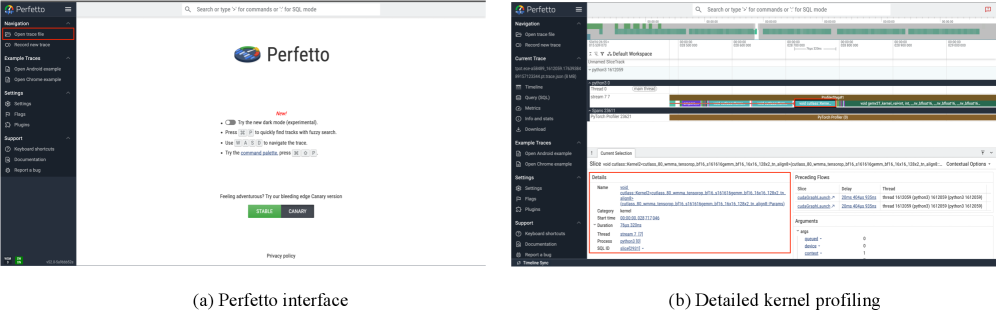

🖼️ 关键图片

📊 实验亮点

ELANA作为一个轻量级工具,能够快速分析LLM的关键性能指标,例如模型大小、KV缓存大小、TTFT、TPOT和TTLT。它支持Hugging Face上所有公开可用的模型,并提供简单的命令行界面和可选的能耗记录。ELANA的易用性和可定制性使其成为高效LLM研究的理想选择。

🎯 应用场景

ELANA可应用于LLM的性能评估、模型压缩和量化研究、边缘设备上的LLM部署优化、以及下一代LLM架构的设计。它能够帮助研究人员和工程师快速了解LLM的性能瓶颈,并指导模型优化和硬件选择,加速LLM在各种场景下的应用。

📄 摘要(原文)

The latency and power consumption of large language models (LLMs) are major constraints when serving them across a wide spectrum of hardware platforms, from mobile edge devices to cloud GPU clusters. Benchmarking is crucial for optimizing efficiency in both model deployment and next-generation model development. To address this need, we open-source a simple profiling tool, \textbf{ELANA}, for evaluating LLMs. ELANA is designed as a lightweight, academic-friendly profiler for analyzing model size, key-value (KV) cache size, prefilling latency (Time-to-first-token, TTFT), generation latency (Time-per-output-token, TPOT), and end-to-end latency (Time-to-last-token, TTLT) of LLMs on both multi-GPU and edge GPU platforms. It supports all publicly available models on Hugging Face and offers a simple command-line interface, along with optional energy consumption logging. Moreover, ELANA is fully compatible with popular Hugging Face APIs and can be easily customized or adapted to compressed or low bit-width models, making it ideal for research on efficient LLMs or for small-scale proof-of-concept studies. We release the ELANA profiling tool at: https://github.com/enyac-group/Elana.