JT-DA: Enhancing Data Analysis with Tool-Integrated Table Reasoning Large Language Models

作者: Ce Chi, Xing Wang, Zhendong Wang, Xiaofan Liu, Ce Li, Zhiyan Song, Chen Zhao, Kexin Yang, Boshen Shi, Jingjing Yang, Chao Deng, Junlan Feng

分类: cs.AI

发布日期: 2025-12-07

💡 一句话要点

JT-DA:通过工具集成表格推理大语言模型增强数据分析能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 表格推理 大语言模型 数据分析 工具集成 强化学习 数据集构建 多步推理

📋 核心要点

- 现有表格推理方法缺乏高质量的训练数据,难以应对真实场景中复杂的多步分析任务。

- JT-DA-8B通过构建大规模表格推理数据集,并结合工具集成和工作流程优化,提升模型性能。

- 实验表明,JT-DA-8B在各种表格推理任务中表现出色,验证了数据驱动和流程优化的有效性。

📝 摘要(中文)

本文提出了JT-DA-8B(九天数据分析师8B),一个专为复杂表格推理任务设计的大语言模型,适用于各种真实场景。为了解决表格推理场景中缺乏高质量监督的问题,我们通过聚合29个公共表格问答数据集和300万个表格,构建了一个包含34个明确定义的表格推理任务的综合性训练语料库。提出了一个自动流程来生成包含推理模式的真实多步分析任务。该模型基于开源的JT-Coder-8B模型进行训练,这是一个从头开始训练的80亿参数的仅解码器基础模型。在训练阶段,我们利用基于LLM的评分和工作流程对齐的过滤来提炼高质量的、以表格为中心的数据。采用监督微调(SFT)和强化学习(RL)来优化我们的模型。之后,提出了一个四阶段的表格推理工作流程,包括表格预处理、表格感知、工具集成推理和提示工程,以提高模型的可解释性和执行准确性。实验结果表明,JT-DA-8B在各种表格推理任务中表现出强大的性能,证明了以数据为中心的生成和工作流程驱动的优化的有效性。

🔬 方法详解

问题定义:论文旨在解决现有表格推理模型在处理复杂、真实世界场景下的数据分析任务时,由于缺乏高质量的训练数据和有效的推理流程,导致性能受限的问题。现有方法难以进行多步推理,可解释性差,且难以利用外部工具辅助分析。

核心思路:论文的核心思路是构建一个高质量、多样化的表格推理数据集,并结合工具集成和工作流程优化,训练一个专门的大语言模型(JT-DA-8B)。通过数据增强、模型微调和流程设计,提升模型在复杂表格推理任务中的性能和可解释性。

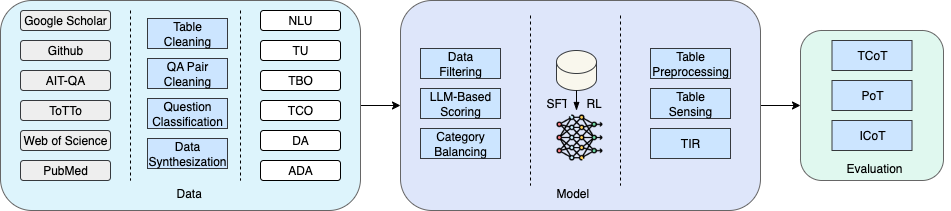

技术框架:JT-DA-8B的整体框架包括数据构建、模型训练和推理流程三个主要部分。数据构建阶段,通过聚合多个公共数据集并生成新的分析任务,构建大规模训练语料库。模型训练阶段,基于JT-Coder-8B进行监督微调和强化学习。推理流程包括表格预处理、表格感知、工具集成推理和提示工程四个阶段。

关键创新:论文的关键创新在于:1) 构建了大规模、高质量的表格推理数据集,包含多种推理模式;2) 提出了一个四阶段的表格推理工作流程,集成了外部工具,提高了模型的可解释性和执行准确性;3) 利用LLM进行数据过滤和评分,提升了训练数据的质量。

关键设计:在数据构建方面,设计了自动流程生成多步分析任务。在模型训练方面,采用了监督微调和强化学习相结合的方法。在推理流程方面,表格预处理包括数据清洗和格式转换,表格感知用于理解表格结构和内容,工具集成推理利用外部工具进行计算和分析,提示工程用于优化模型输出。

🖼️ 关键图片

📊 实验亮点

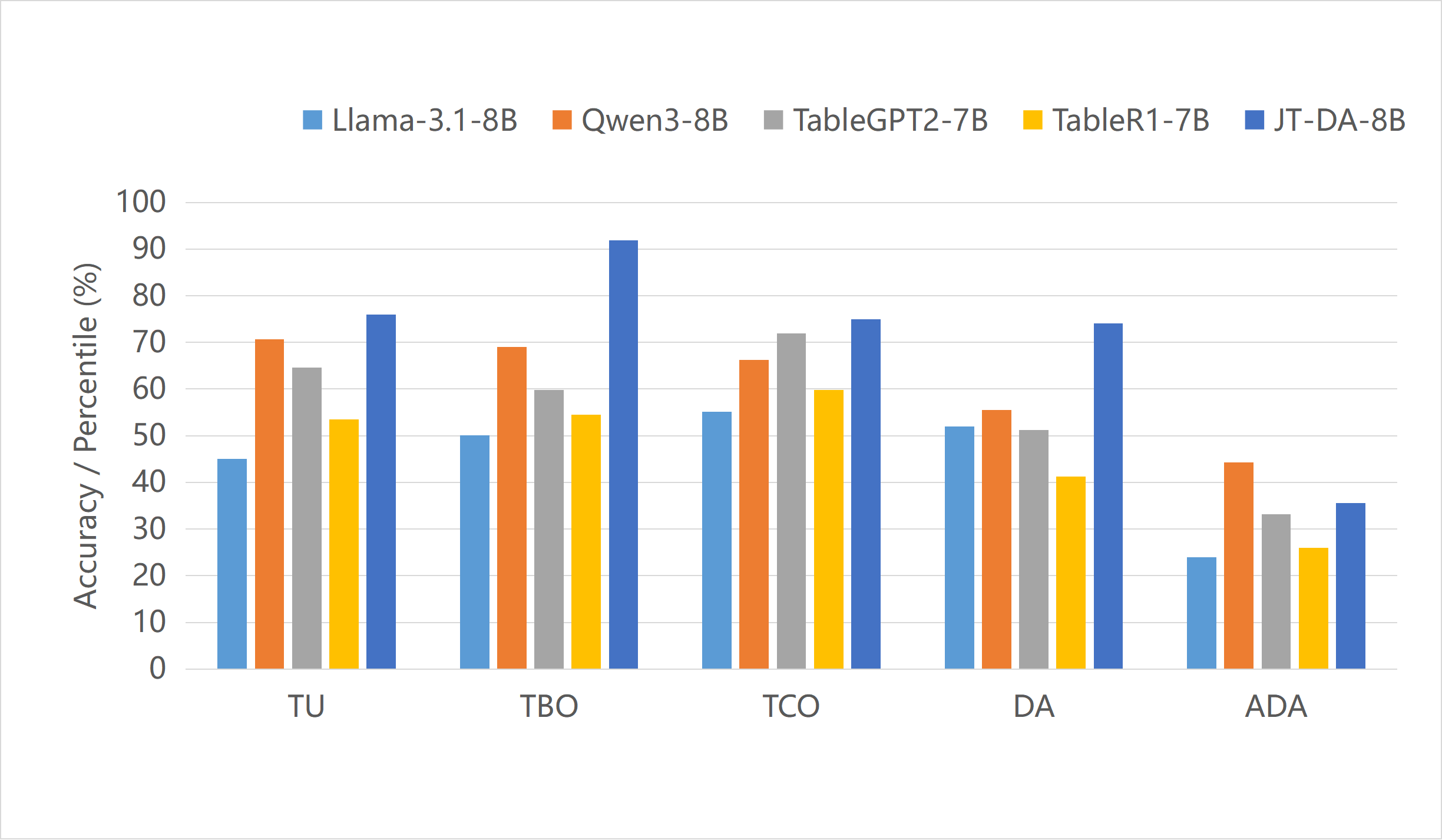

JT-DA-8B在各种表格推理任务中取得了显著的性能提升,证明了数据驱动和工作流程优化的有效性。具体实验数据未在摘要中给出,但强调了其在不同表格推理任务中的强大性能,表明其优于现有基线模型(具体数值未知)。

🎯 应用场景

该研究成果可应用于金融分析、市场调研、商业智能等领域,帮助用户从海量表格数据中提取有价值的信息,进行决策支持。未来可进一步扩展到更多领域,例如医疗健康、教育等,提升数据分析的效率和准确性,赋能各行业智能化升级。

📄 摘要(原文)

In this work, we present JT-DA-8B (JiuTian Data Analyst 8B), a specialized large language model designed for complex table reasoning tasks across diverse real-world scenarios. To address the lack of high-quality supervision in tabular reasoning scenarios, we construct a comprehensive and diverse training corpus with 34 well-defined table reasoning tasks, by aggregating 29 public table QA datasets and 3 million tables. An automatic pipeline is proposed to generate realistic multi-step analytical tasks involving reasoning patterns. The model is trained upon open-source JT-Coder-8B model, an 8B-parameter decoder-only foundation model trained from scratch. In the training stage, we leverage LLM-based scoring and workflow-aligned filtering to distill high-quality, table-centric data. Both supervised fine-tuning (SFT) and Reinforcement learning (RL) are adopted to optimize our model. Afterwards, a four-stage table reasoning workflow is proposed, including table preprocessing, table sensing, tool-integrated reasoning, and prompt engineering, to improve model interpretability and execution accuracy. Experimental results show that JT-DA-8B achieves strong performance in various table reasoning tasks, demonstrating the effectiveness of data-centric generation and workflow-driven optimization.