Towards Small Language Models for Security Query Generation in SOC Workflows

作者: Saleha Muzammil, Rahul Reddy, Vishal Kamalakrishnan, Hadi Ahmadi, Wajih Ul Hassan

分类: cs.CR, cs.AI

发布日期: 2025-12-07

💡 一句话要点

提出面向安全运营中心工作流的小型语言模型KQL查询生成方法,降低查询成本。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自然语言查询 Kusto查询语言 小型语言模型 安全运营中心 提示工程 微调 理由蒸馏

📋 核心要点

- 安全运营中心分析师需要使用KQL查询海量遥测数据,但编写正确的KQL需要专业知识,限制了安全团队的扩展。

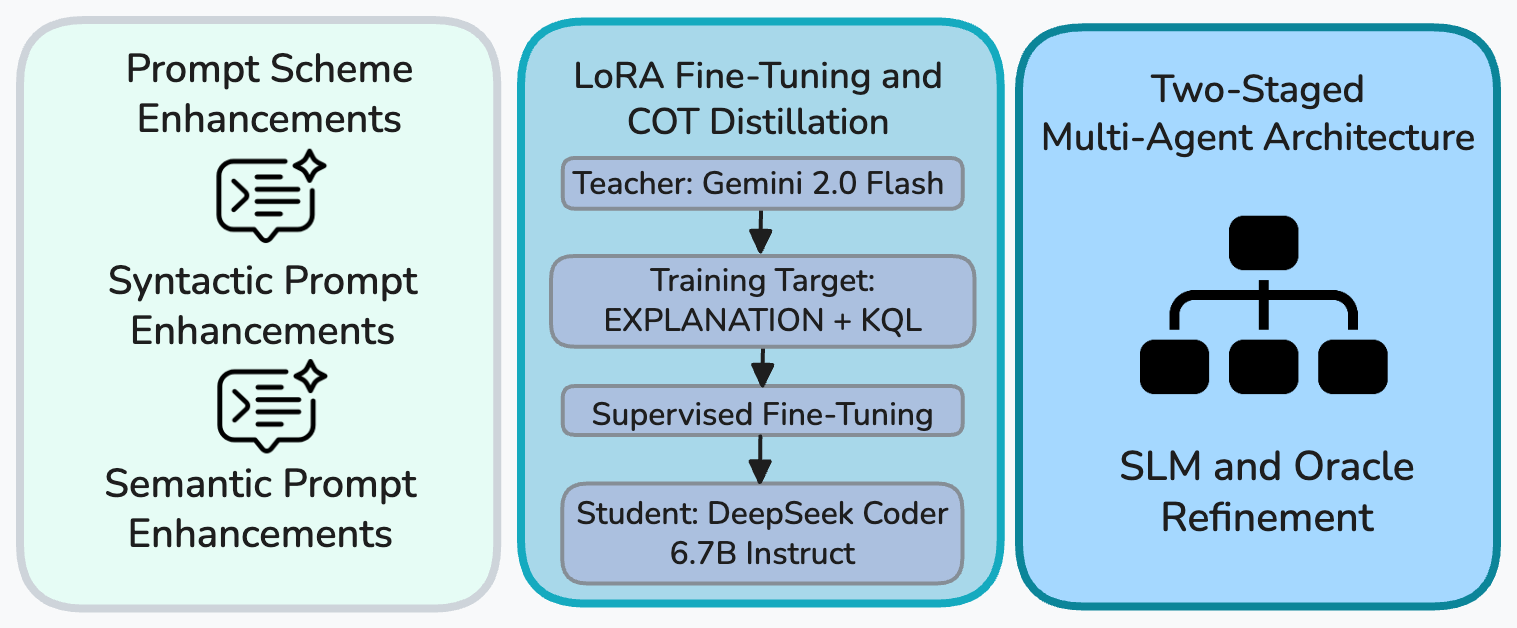

- 论文提出一个三旋钮框架,包括轻量级检索的错误感知提示、LoRA微调的理由蒸馏以及SLM生成+LLM判断的两阶段架构。

- 实验结果表明,该方法在Microsoft Defender和Sentinel数据集上均取得了优异的语法和语义准确率,且token成本远低于GPT-5。

📝 摘要(中文)

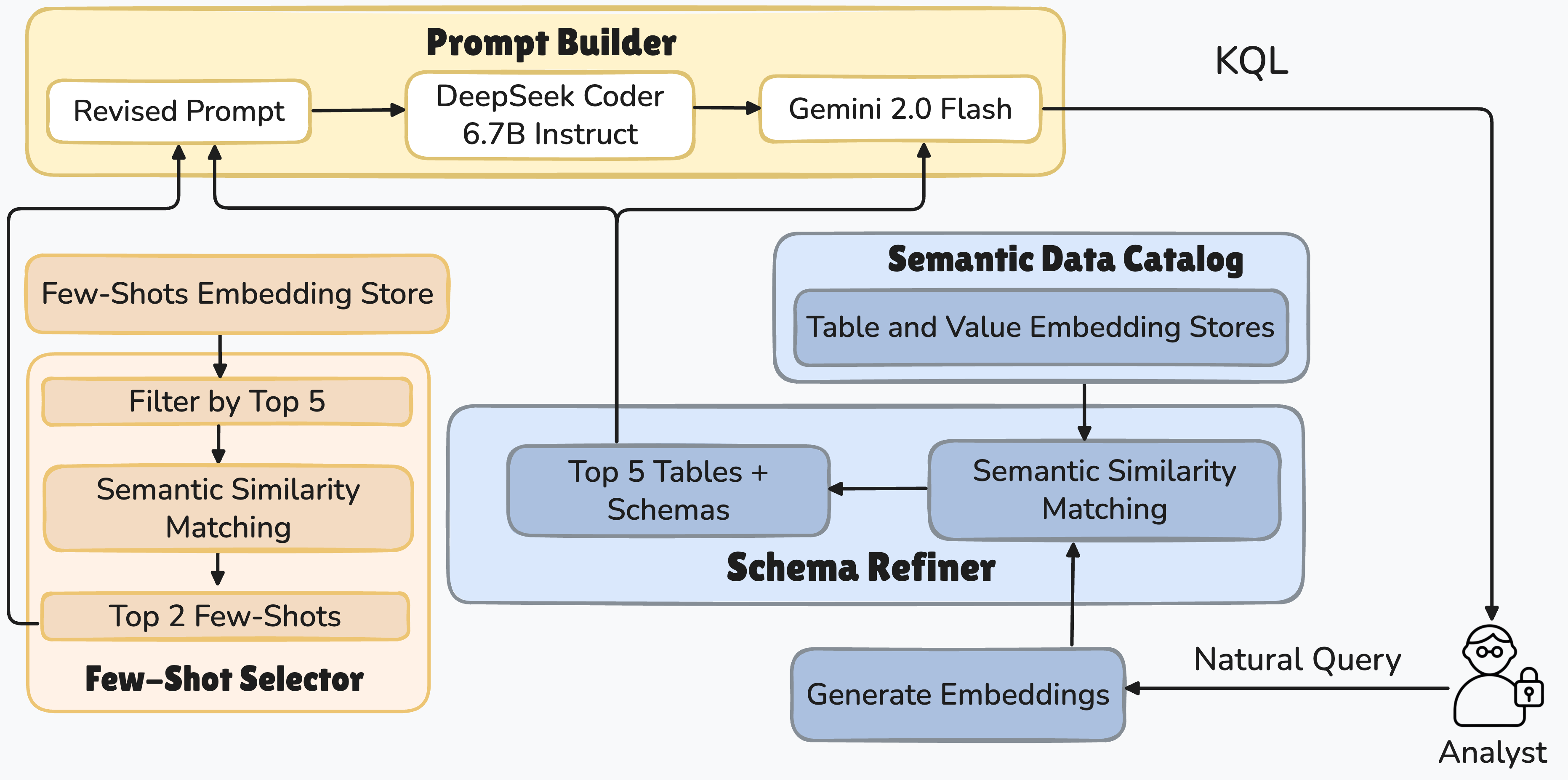

本文研究了小型语言模型(SLMs)在企业安全领域中实现准确、经济高效的自然语言到Kusto查询语言(NL2KQL)转换的可行性。我们提出了一个三旋钮框架,针对提示工程、微调和架构设计。首先,我们采用现有的NL2KQL框架,通过轻量级检索来适配SLM,并引入错误感知提示,以解决常见的解析器故障,且不增加token数量。其次,我们应用LoRA微调和理由蒸馏,使用简短的思维链解释来扩充每个NLQ-KQL对,从而从教师模型传递推理能力,同时保持SLM的紧凑性。第三,我们提出了一种两阶段架构,使用SLM进行候选生成,并使用低成本LLM判断器进行模式感知的细化和选择。我们在Microsoft的NL2KQL Defender Evaluation数据集上评估了九个模型(五个SLM和四个LLM)的语法正确性、语义准确性、表选择和过滤器精度,以及延迟和token成本。我们的两阶段方法实现了0.987的语法准确率和0.906的语义准确率。我们进一步证明了在Microsoft Sentinel数据上的泛化能力,达到了0.964的语法准确率和0.831的语义准确率。这些结果的token成本比GPT-5低10倍,证明了SLM是安全运营中自然语言查询的实用且可扩展的基础。

🔬 方法详解

问题定义:论文旨在解决安全运营中心(SOC)分析师在编写Kusto查询语言(KQL)时面临的专业知识瓶颈问题。现有方法依赖于专家,成本高昂且难以扩展。大型语言模型(LLM)虽然可以生成KQL,但计算成本和延迟较高,不适合大规模应用。因此,需要一种低成本、高性能的自然语言到KQL的转换方法。

核心思路:论文的核心思路是利用小型语言模型(SLM)的效率和可扩展性,结合提示工程、微调和两阶段架构来提高NL2KQL的准确性。通过错误感知提示解决解析器错误,利用理由蒸馏将LLM的推理能力迁移到SLM,并使用LLM判断器进行schema感知的细化和选择,从而在保证性能的同时降低成本。

技术框架:整体架构分为三个主要部分:1) 提示工程:设计错误感知提示,提高SLM对KQL语法的理解。2) 微调:使用LoRA微调SLM,并采用理由蒸馏,将LLM的推理能力迁移到SLM。3) 两阶段架构:首先使用SLM生成多个候选KQL查询,然后使用低成本的LLM判断器对这些候选查询进行schema感知的细化和选择,最终输出最佳查询。

关键创新:论文的关键创新在于结合了多种技术来优化SLM在NL2KQL任务中的性能。错误感知提示针对性地解决了解析器错误,理由蒸馏有效地将LLM的知识迁移到SLM,而两阶段架构则利用了SLM的生成能力和LLM的判断能力,实现了性能和成本的平衡。此外,针对安全领域的特定需求进行了优化。

关键设计:在提示工程方面,设计了能够识别和纠正常见KQL语法错误的提示模板。在微调方面,使用了LoRA技术来减少微调参数量,并采用理由蒸馏来提高SLM的推理能力。在两阶段架构中,LLM判断器的选择标准包括语法正确性、语义准确性和与数据库schema的匹配程度。具体参数设置和损失函数细节未知。

🖼️ 关键图片

📊 实验亮点

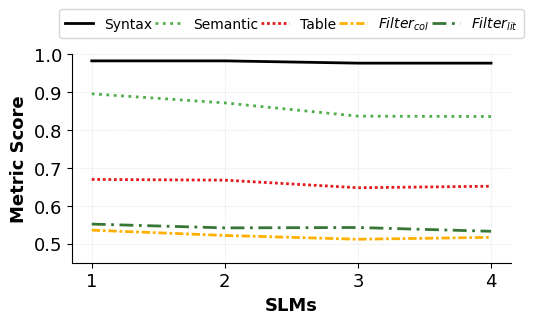

实验结果表明,该方法在Microsoft的NL2KQL Defender Evaluation数据集上实现了0.987的语法准确率和0.906的语义准确率,在Microsoft Sentinel数据上达到了0.964的语法准确率和0.831的语义准确率。与GPT-5相比,token成本降低了10倍,证明了SLM在安全运营领域NL2KQL任务中的实用性和经济性。

🎯 应用场景

该研究成果可应用于安全运营中心,帮助安全分析师更高效地查询和分析安全数据,从而更快地检测和响应安全事件。此外,该方法还可以推广到其他需要自然语言查询的领域,例如数据库管理、日志分析等,具有广泛的应用前景。

📄 摘要(原文)

Analysts in Security Operations Centers routinely query massive telemetry streams using Kusto Query Language (KQL). Writing correct KQL requires specialized expertise, and this dependency creates a bottleneck as security teams scale. This paper investigates whether Small Language Models (SLMs) can enable accurate, cost-effective natural-language-to-KQL translation for enterprise security. We propose a three-knob framework targeting prompting, fine-tuning, and architecture design. First, we adapt existing NL2KQL framework for SLMs with lightweight retrieval and introduce error-aware prompting that addresses common parser failures without increasing token count. Second, we apply LoRA fine-tuning with rationale distillation, augmenting each NLQ-KQL pair with a brief chain-of-thought explanation to transfer reasoning from a teacher model while keeping the SLM compact. Third, we propose a two-stage architecture that uses an SLM for candidate generation and a low-cost LLM judge for schema-aware refinement and selection. We evaluate nine models (five SLMs and four LLMs) across syntax correctness, semantic accuracy, table selection, and filter precision, alongside latency and token cost. On Microsoft's NL2KQL Defender Evaluation dataset, our two-stage approach achieves 0.987 syntax and 0.906 semantic accuracy. We further demonstrate generalizability on Microsoft Sentinel data, reaching 0.964 syntax and 0.831 semantic accuracy. These results come at up to 10x lower token cost than GPT-5, establishing SLMs as a practical, scalable foundation for natural-language querying in security operations.