Echo-CoPilot: A Multi-View, Multi-Task Agent for Echocardiography Interpretation and Reporting

作者: Moein Heidari, Mohammad Amin Roohi, Ilker Hacihaliloglu

分类: cs.AI, cs.CV, cs.LG, eess.IV

发布日期: 2025-12-06 (更新: 2025-12-15)

💡 一句话要点

Echo-CoPilot:用于心动超声解读和报告的多视角多任务智能体

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心动超声 多任务学习 大型语言模型 医学影像 智能体 ReAct 临床报告

📋 核心要点

- 传统心动超声解读耗时且易出错,现有模型通常孤立运行,缺乏临床连贯性。

- Echo-CoPilot利用大型语言模型协调多个专业工具,实现多视角、多任务的综合分析。

- 实验表明,Echo-CoPilot在MIMIC-EchoQA基准上优于现有模型,并能处理复杂临床病例。

📝 摘要(中文)

心动超声检查是现代心血管护理的核心,但完整的研究解读仍然是一项认知需求高、多视角的任务,目前仍由人工完成。虽然最近的心动超声基础模型可以在视图分类、分割或疾病预测等单个感知子任务上取得良好的性能,但它们通常孤立运行,无法提供统一的、临床上连贯的评估。本文介绍了Echo-CoPilot,一个多视角、多任务智能体,它使用大型语言模型来协调一套专门的心动超声工具。在ReAct风格的循环中,该智能体分解临床医生的查询,调用工具进行视图识别、心脏结构分割、测量和疾病预测以及报告合成,并将它们的输出集成到符合指南的答案和叙述性摘要中。我们在公共MIMIC-EchoQA基准上评估了Echo-CoPilot,其准确率达到50.8%,优于通用和生物医学视频视觉语言模型。定性分析进一步表明,该智能体利用定量测量和生理背景来解决临床决策阈值附近的具有挑战性的病例,例如临界左心室肥厚或心包积液严重程度。

🔬 方法详解

问题定义:心动超声检查结果的判读需要整合多视角信息,并进行复杂的推理,现有方法通常针对单一任务,无法提供全面的临床评估,导致效率低下和潜在的误诊风险。

核心思路:利用大型语言模型(LLM)作为协调者,将不同的专业工具(如视图分类、分割、疾病预测等)整合到一个统一的框架中,模拟医生进行诊断的流程,从而实现更准确、更全面的心动超声解读。

技术框架:Echo-CoPilot采用ReAct风格的循环框架。首先,LLM接收临床医生的查询,并将其分解为一系列子任务。然后,LLM调用相应的专业工具来执行这些子任务,例如视图识别、心脏结构分割、测量和疾病预测。最后,LLM将这些工具的输出整合到符合临床指南的答案和叙述性摘要中。

关键创新:Echo-CoPilot的关键创新在于它将大型语言模型与专业的心动超声工具相结合,构建了一个多视角、多任务的智能体。这种方法能够充分利用LLM的推理能力和专业工具的精确性,从而实现更准确、更全面的心动超声解读。与现有方法相比,Echo-CoPilot能够更好地模拟医生的诊断流程,并提供更具临床价值的信息。

关键设计:Echo-CoPilot的关键设计包括:1) 使用ReAct风格的循环框架,允许智能体根据先前的行动和观察结果动态地调整其行为。2) 集成了一套专门的心动超声工具,包括视图识别、心脏结构分割、测量和疾病预测等。3) 使用大型语言模型作为协调者,负责分解查询、调用工具和整合输出。具体参数设置、损失函数和网络结构等细节未在摘要中明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

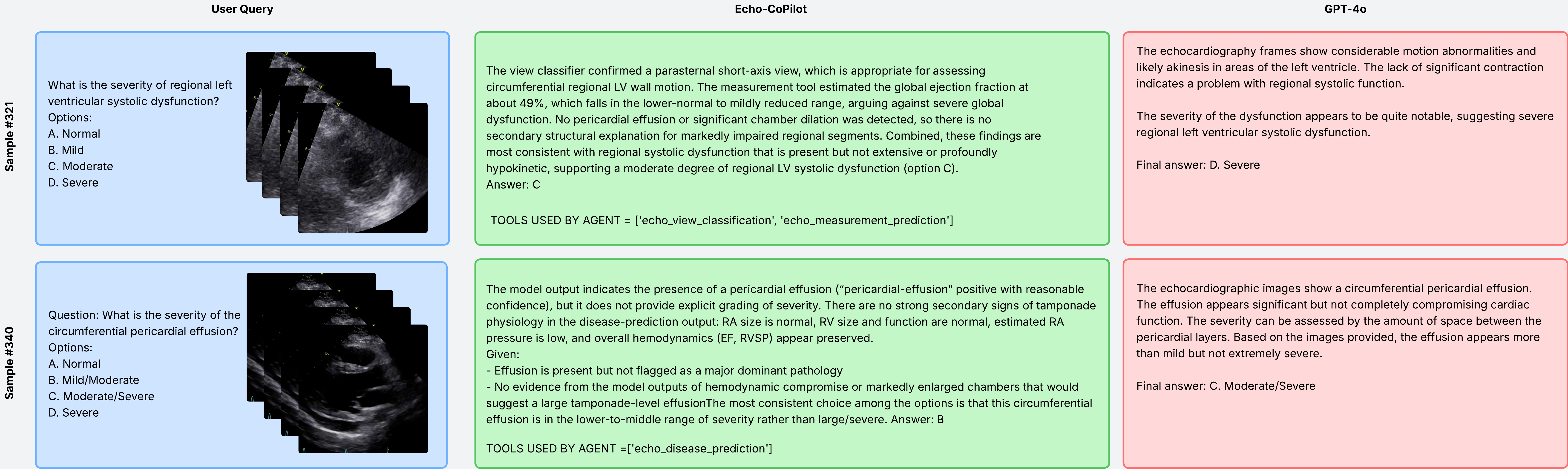

Echo-CoPilot在MIMIC-EchoQA基准测试中取得了50.8%的准确率,超越了现有的通用和生物医学视频视觉语言模型。定性分析表明,该智能体能够有效利用定量测量和生理背景信息,解决临床决策阈值附近的复杂病例,例如临界左心室肥厚和心包积液严重程度的判断。

🎯 应用场景

Echo-CoPilot可应用于临床心动超声报告的自动生成、辅助诊断和远程医疗等领域。它能够提高诊断效率,减少人为误差,并为缺乏专业知识的医生提供支持。未来,该技术有望推广到其他医学影像领域,助力精准医疗的发展。

📄 摘要(原文)

Echocardiography is central to contemporary cardiovascular care, but full-study interpretation remains a cognitively demanding, multi-view task that is still performed manually. While recent foundation models for echocardiography can achieve strong performance on individual perceptual subtasks such as view classification, segmentation, or disease prediction, they typically operate in isolation and do not provide a unified, clinically coherent assessment. In this work, we introduce Echo-CoPilot, a multi-view, multi-task agent that uses a large language model to orchestrate a suite of specialized echocardiography tools. Within a ReAct-style loop, the agent decomposes clinician queries, invokes tools for view recognition, cardiac structure segmentation, measurement and disease prediction, and report synthesis, and integrates their outputs into guideline-aware answers and narrative summaries. We evaluate Echo-CoPilot on the public MIMIC-EchoQA benchmark, where it achieves an accuracy of 50.8\%, outperforming both general-purpose and biomedical video vision-language models. Qualitative analyses further show that the agent leverages quantitative measurements and physiologic context to resolve challenging cases near clinical decision thresholds, such as borderline left ventricular hypertrophy or pericardial effusion severity. The code will be released upon acceptance of the paper.