The Missing Layer of AGI: From Pattern Alchemy to Coordination Physics

作者: Edward Y. Chang

分类: cs.AI, cs.LG

发布日期: 2025-12-05

备注: 13 pages, 3 figures

💡 一句话要点

提出UCCT理论和MACI架构,为LLM增加协调层以实现更强的推理和规划能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 通用人工智能 推理 规划 语义锚定 协调层 UCCT理论

📋 核心要点

- 现有观点认为大型语言模型(LLMs)仅是模式匹配器,缺乏真正的推理和规划能力,阻碍了AGI的发展。

- 论文提出UCCT理论和MACI架构,通过增加一个协调层来选择、约束和绑定LLMs中的模式,从而提升推理能力。

- 论文将常见的对LLM的质疑转化为可测试的协调失败,并认为AGI的实现依赖于LLMs的改进。

📝 摘要(中文)

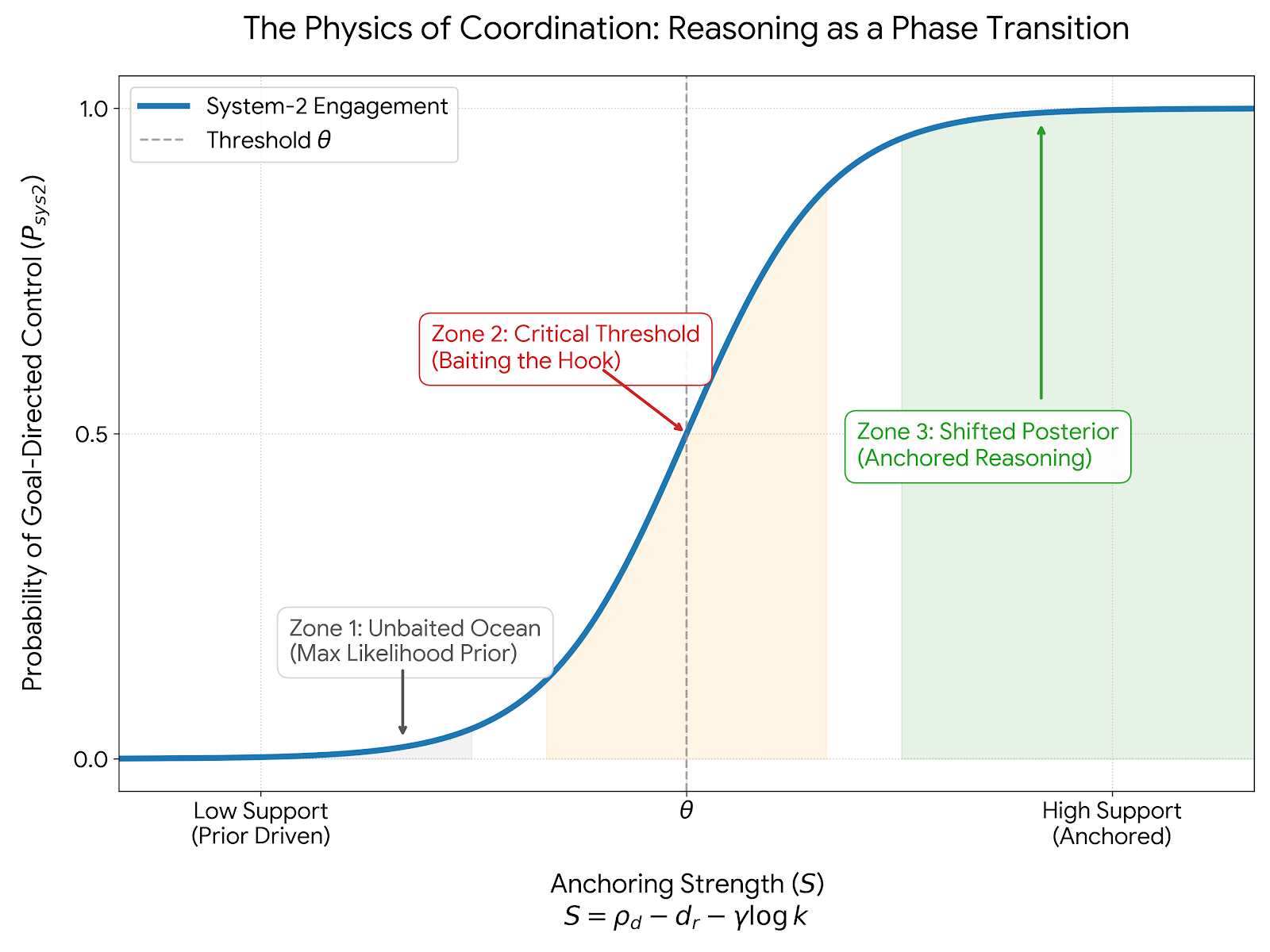

本文认为大型语言模型(LLMs)是实现通用人工智能(AGI)的必要基础,而非终点。现有的批评认为LLMs只是“模式匹配器”,缺乏推理和规划能力,这是对瓶颈的误判。模式库是必要的System-1基质,而缺失的组件是System-2协调层,用于选择、约束和绑定这些模式。本文通过UCCT理论形式化了这个协调层,该理论将语义锚定建模为由有效支持(rho_d)、表征失配(d_r)和自适应锚定预算(gamma log k)控制的相变。在此视角下,无根据的生成只是对基质的最大似然先验的无诱饵检索,而“推理”则是在锚点将后验转移到目标导向约束时出现的。本文将UCCT转化为MACI架构,该架构实现诱饵(行为调节辩论)、过滤(苏格拉底式判断)和持久化(事务性内存)。通过将常见的反对意见重新定义为可测试的协调失败,本文认为通往AGI的路径是通过LLMs,而不是绕过它们。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)虽然在模式匹配方面表现出色,但缺乏真正的推理和规划能力。它们往往生成无根据的内容,难以进行目标导向的约束,这阻碍了它们在需要复杂推理和规划任务中的应用。现有方法缺乏有效的机制来协调和约束LLMs内部的知识模式,导致其难以产生连贯和有意义的输出。

核心思路:论文的核心思路是为LLMs增加一个协调层,该层负责选择、约束和绑定LLMs中的模式,从而实现更高级的推理和规划能力。这个协调层通过语义锚定来实现,将推理过程建模为由有效支持、表征失配和自适应锚定预算控制的相变。通过引入锚点,可以将LLMs的输出从最大似然先验转移到目标导向的约束,从而实现更可控和有意义的生成。

技术框架:论文提出了MACI架构,该架构实现了UCCT理论。MACI架构包含三个主要模块:诱饵(baiting)、过滤(filtering)和持久化(persistence)。诱饵模块通过行为调节辩论来引导LLMs的生成过程。过滤模块使用苏格拉底式判断来评估和筛选LLMs的输出。持久化模块使用事务性内存来存储和管理LLMs的知识模式。整个架构通过这三个模块的协同工作,实现了对LLMs的协调和约束。

关键创新:论文最重要的技术创新点在于提出了UCCT理论,该理论将语义锚定建模为由有效支持、表征失配和自适应锚定预算控制的相变。与现有方法不同,UCCT理论提供了一个形式化的框架来理解和控制LLMs的推理过程。此外,MACI架构的提出也为实现UCCT理论提供了一个可行的实现方案。

关键设计:UCCT理论中的关键参数包括有效支持(rho_d)、表征失配(d_r)和自适应锚定预算(gamma log k)。这些参数控制了语义锚定的强度和方向。MACI架构中的关键设计包括行为调节辩论的实现方式、苏格拉底式判断的评估标准以及事务性内存的存储结构。具体的参数设置和实现细节需要根据具体的应用场景进行调整。

🖼️ 关键图片

📊 实验亮点

论文通过将常见的对LLM的质疑转化为可测试的协调失败,验证了UCCT理论和MACI架构的有效性。虽然具体的性能数据和对比基线未在摘要中提及,但该研究为解决LLMs的推理和规划问题提供了一个新的思路和方法。

🎯 应用场景

该研究成果可应用于需要复杂推理和规划的领域,如智能客服、自动驾驶、医疗诊断等。通过提升LLMs的推理能力,可以使其更好地理解用户意图,生成更准确和有用的回复,从而提高工作效率和用户满意度。此外,该研究还可以促进AGI的发展,为实现更智能和自主的系统奠定基础。

📄 摘要(原文)

Influential critiques argue that Large Language Models (LLMs) are a dead end for AGI: "mere pattern matchers" structurally incapable of reasoning or planning. We argue this conclusion misidentifies the bottleneck: it confuses the ocean with the net. Pattern repositories are the necessary System-1 substrate; the missing component is a System-2 coordination layer that selects, constrains, and binds these patterns. We formalize this layer via UCCT, a theory of semantic anchoring that models reasoning as a phase transition governed by effective support (rho_d), representational mismatch (d_r), and an adaptive anchoring budget (gamma log k). Under this lens, ungrounded generation is simply an unbaited retrieval of the substrate's maximum likelihood prior, while "reasoning" emerges when anchors shift the posterior toward goal-directed constraints. We translate UCCT into architecture with MACI, a coordination stack that implements baiting (behavior-modulated debate), filtering (Socratic judging), and persistence (transactional memory). By reframing common objections as testable coordination failures, we argue that the path to AGI runs through LLMs, not around them.