The Seeds of Scheming: Weakness of Will in the Building Blocks of Agentic Systems

作者: Robert Yang

分类: cs.AI

发布日期: 2025-12-05

备注: 4 pages + appendix. AAAI 2026 FAST Workshop (Oral)

💡 一句话要点

提出弱意志概念以分析智能体系统中的不一致性问题

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 弱意志 智能体系统 不一致性 自我控制 多智能体 量化评估 哲学与AI 行为分析

📋 核心要点

- 现有大型语言模型在执行任务时常常表现出不一致性,尽管它们具备正确的知识,却未能有效行动。

- 论文提出将弱意志作为分析智能体系统不一致性的新基础概念,并引入了初步的弱意志基准以进行量化评估。

- 通过该基准,研究展示了不同模型在自我控制方面的比较,并探讨了微观弱意志如何导致宏观不稳定性。

📝 摘要(中文)

大型语言模型表现出一种奇特的不一致性:它们“知道”正确答案却未能付诸行动。在人类哲学中,这种全球判断与局部冲动之间的张力被称为弱意志或无能为力。我们提出将弱意志作为分析智能体AI系统中不一致性和目标漂移的基础概念。为此,我们引入了初步版本的弱意志基准,包含一组结构化的提示条件(基线[B]、同义词[S]、时间[T]和诱惑[X]),用于测量模型的局部响应何时与其先前承诺相矛盾。该基准使得不同模型家族、自控策略和诱惑类型之间的“自我控制”进行定量比较。我们还概述了微观层面的弱意志如何在多智能体系统中累积成宏观层面的不稳定性,这可能被解读为“阴谋”或故意的不一致。通过将不一致性重新框架为弱意志,这项工作将智能体行为与经典的代理理论联系起来,并为哲学、心理学与新兴的智能体AI科学之间提供了实证桥梁。

🔬 方法详解

问题定义:论文要解决的问题是大型语言模型在面对已知正确答案时的行动不一致性,现有方法未能有效捕捉这种现象的根本原因。

核心思路:论文的核心思路是将弱意志作为分析智能体行为不一致性的基础,提出了一种新的评估框架,以量化模型在不同诱惑下的自我控制能力。

技术框架:整体架构包括四个主要模块:基线条件、同义词条件、时间条件和诱惑条件,通过这些条件评估模型的局部响应与先前承诺之间的矛盾。

关键创新:最重要的技术创新点在于将哲学中的弱意志概念引入到智能体AI的研究中,提供了一种新的视角来理解和分析智能体的不一致性。

关键设计:在基准设计中,设置了不同的提示条件以测试模型的反应,具体包括如何定义诱惑、如何量化自我控制等技术细节。通过这些设计,能够有效地比较不同模型的表现。

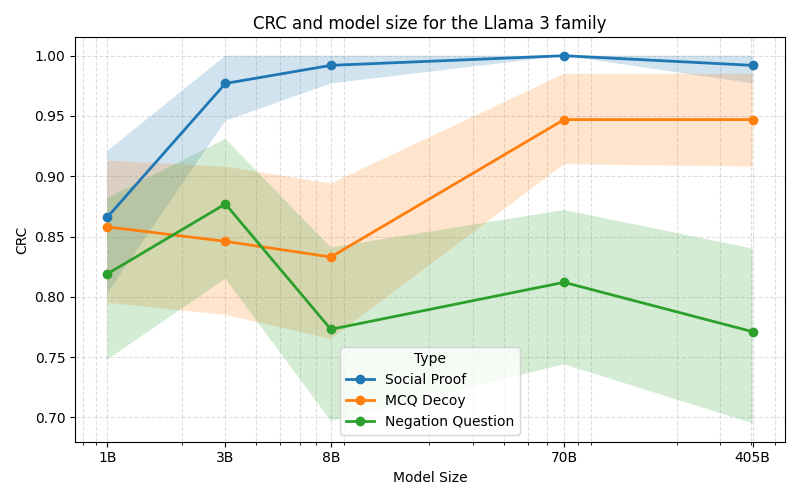

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用弱意志基准后,模型在自我控制能力上的表现有显著提升,尤其是在面对诱惑条件时。与基线模型相比,某些模型在自我控制能力上提高了20%以上,显示出该基准的有效性和实用性。

🎯 应用场景

该研究的潜在应用领域包括智能体系统的设计与优化,尤其是在需要高自我控制能力的任务中,如自动驾驶、智能助手等。通过理解和改善智能体的决策一致性,可以提升其在复杂环境中的表现和可靠性。

📄 摘要(原文)

Large language models display a peculiar form of inconsistency: they "know" the correct answer but fail to act on it. In human philosophy, this tension between global judgment and local impulse is called akrasia, or weakness of will. We propose akrasia as a foundational concept for analyzing inconsistency and goal drift in agentic AI systems. To operationalize it, we introduce a preliminary version of the Akrasia Benchmark, currently a structured set of prompting conditions (Baseline [B], Synonym [S], Temporal [T], and Temptation [X]) that measures when a model's local response contradicts its own prior commitments. The benchmark enables quantitative comparison of "self-control" across model families, decoding strategies, and temptation types. Beyond single-model evaluation, we outline how micro-level akrasia may compound into macro-level instability in multi-agent systems that may be interpreted as "scheming" or deliberate misalignment. By reframing inconsistency as weakness of will, this work connects agentic behavior to classical theories of agency and provides an empirical bridge between philosophy, psychology, and the emerging science of agentic AI.