Medication counseling with large language models: balancing flexibility and rigidity

作者: Joar Sabel, Mattias Wingren, Andreas Lundell, Sören Andersson, Sara Rosenberg, Susanne Hägglund, Linda Estman, Malin Andtfolk

分类: cs.HC, cs.AI, cs.CL

发布日期: 2025-12-02

备注: Accepted for 2025 IEEE International Conference on Agentic AI (ICA). 14 pages, 2 figures

DOI: 10.1109/ICA67499.2025.00047

💡 一句话要点

提出一种平衡灵活性与严谨性的LLM药物咨询系统,解决药房场景中的错误风险。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 药物咨询 人机交互 医疗健康 自然语言处理

📋 核心要点

- 现有基于规则的药房咨询系统过于僵化,无法处理复杂情况,而直接应用LLM则可能因其灵活性导致错误。

- 该论文提出一种原型系统,旨在平衡LLM在药物咨询中的灵活性和对会话要求的严格遵守,以减少幻觉并提高回复质量。

- 该研究专注于窄而长的任务,以便更深入地理解任务,并为长时间交互提供洞察,但仍需持续测试和人机协作。

📝 摘要(中文)

大型语言模型(LLM)的引入极大地增强了软件代理的能力。代理现在可以像人类一样以灵活的方式进行交互,而不是依赖于基于规则的交互。然而,这种灵活性在错误可能造成灾难性后果的领域(如药房)中迅速成为一个问题。但另一方面,过于死板的系统也会导致错误,因为它可能过于僵化而无法处理未考虑到的情况。在药房环境中使用LLM的工作已经采用了广泛的范围,在简短的交互中考虑了许多不同的药物——我们的策略恰恰相反:专注于更窄和更长的任务。这不仅能够更好地理解手头的任务,而且还能够深入了解较长时间交互中存在的挑战。然而,主要挑战对于窄系统和宽系统来说仍然相同:它需要在遵守会话要求和灵活性之间取得平衡。为了努力实现这种平衡,我们提出了一个旨在提供药物咨询的原型系统,同时兼顾这两个极端。我们还介绍了构建这种系统的设计,重点是旨在满足会话要求、减少幻觉和促进高质量响应的方法。所使用的方法有可能提高系统的确定性,同时又不消除使用LLM所赋予的动态会话能力。然而,仍有大量工作要做,这种系统的开发需要持续的测试和人机协作。它还应该在LLM的常用基准之外进行评估,因为这些基准不能充分捕捉这种会话系统的复杂性。

🔬 方法详解

问题定义:现有药房咨询系统要么过于死板,无法应对复杂情况,要么直接使用LLM,但LLM的过度灵活性可能导致幻觉和错误,尤其是在药物咨询这种高风险场景下。因此,需要一种既能保持LLM的自然语言交互能力,又能保证咨询过程的准确性和安全性的方法。

核心思路:该论文的核心思路是在LLM的基础上,通过引入约束和控制机制,使其在提供药物咨询时,既能灵活应对用户的问题,又能严格遵守药物咨询的规范和要求。这种平衡旨在减少LLM的幻觉,并提高回复的质量和可靠性。

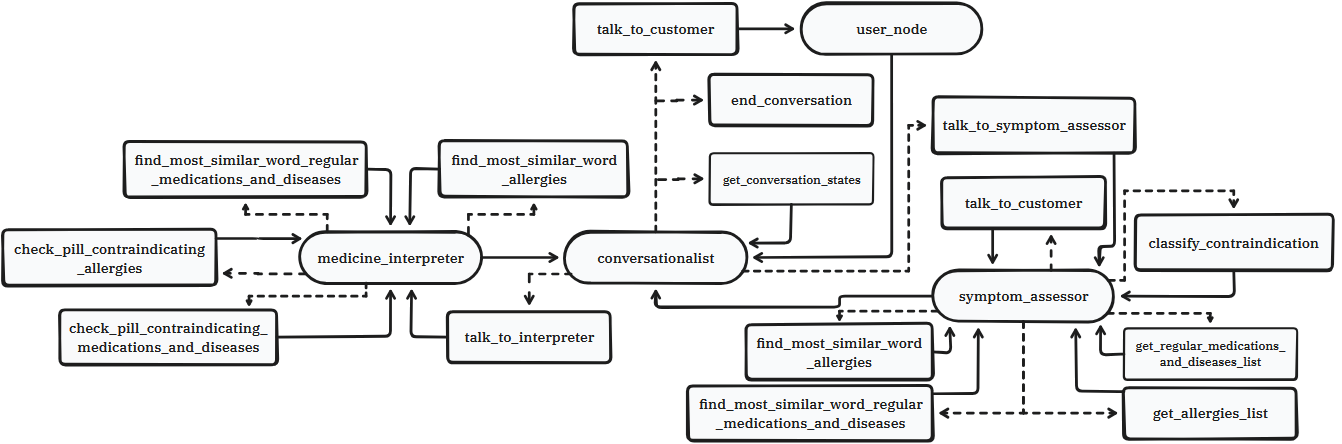

技术框架:该原型系统采用LLM作为核心引擎,并在此基础上构建了一系列模块,用于控制对话流程、约束回复内容和减少幻觉。具体架构细节未知,但强调了对会话要求的满足和高质量回复的生成。

关键创新:该论文的关键创新在于探索了一种在药物咨询场景下,平衡LLM灵活性和严谨性的方法。与以往专注于广泛药物知识的系统不同,该研究专注于更窄更长的任务,以便更深入地理解任务,并为长时间交互提供洞察。

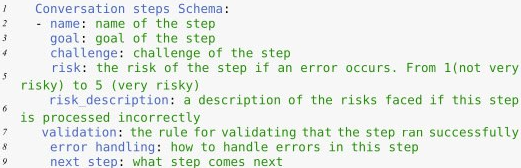

关键设计:论文重点介绍了旨在满足会话要求、减少幻觉和促进高质量响应的方法,但没有提供具体的参数设置、损失函数或网络结构等技术细节。强调了持续测试和人机协作的重要性,以及在常用LLM基准之外进行评估的必要性。

🖼️ 关键图片

📊 实验亮点

论文提出了一个药物咨询原型系统,旨在平衡LLM的灵活性和严谨性,以减少幻觉并提高回复质量。虽然没有提供具体的性能数据,但强调了该系统在满足会话要求和生成高质量回复方面的潜力,以及持续测试和人机协作的重要性。

🎯 应用场景

该研究成果可应用于智能药房、在线医疗咨询等领域,为患者提供个性化、准确的药物咨询服务,提高用药安全性,并减轻药剂师的工作负担。未来,该技术有望扩展到其他高风险领域的知识密集型咨询服务。

📄 摘要(原文)

The introduction of large language models (LLMs) has greatly enhanced the capabilities of software agents. Instead of relying on rule-based interactions, agents can now interact in flexible ways akin to humans. However, this flexibility quickly becomes a problem in fields where errors can be disastrous, such as in a pharmacy context, but the opposite also holds true; a system that is too inflexible will also lead to errors, as it can become too rigid to handle situations that are not accounted for. Work using LLMs in a pharmacy context have adopted a wide scope, accounting for many different medications in brief interactions -- our strategy is the opposite: focus on a more narrow and long task. This not only enables a greater understanding of the task at hand, but also provides insight into what challenges are present in an interaction of longer nature. The main challenge, however, remains the same for a narrow and wide system: it needs to strike a balance between adherence to conversational requirements and flexibility. In an effort to strike such a balance, we present a prototype system meant to provide medication counseling while juggling these two extremes. We also cover our design in constructing such a system, with a focus on methods aiming to fulfill conversation requirements, reduce hallucinations and promote high-quality responses. The methods used have the potential to increase the determinism of the system, while simultaneously not removing the dynamic conversational abilities granted by the usage of LLMs. However, a great deal of work remains ahead, and the development of this kind of system needs to involve continuous testing and a human-in-the-loop. It should also be evaluated outside of commonly used benchmarks for LLMs, as these do not adequately capture the complexities of this kind of conversational system.