Culture Affordance Atlas: Reconciling Object Diversity Through Functional Mapping

作者: Joan Nwatu, Longju Bai, Oana Ignat, Rada Mihalcea

分类: cs.CY, cs.AI, cs.CL, cs.CV

发布日期: 2025-12-02

期刊: AAAI 2026 Social Impact Track

💡 一句话要点

提出文化功能可供性图谱,通过功能映射弥合对象多样性中的文化差异。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 文化偏见 视觉-语言模型 功能可供性 数据集构建 跨文化理解

📋 核心要点

- 现有视觉-语言数据集存在文化偏见,过度关注西方高收入环境,导致模型在不同文化背景下的泛化能力不足。

- 论文提出以功能为中心的框架,通过对不同文化和经济环境下的对象进行功能分类,弥合文化差异。

- 实验表明,使用功能标签能显著缩小高低收入群体间的性能差距,中位数提升6个百分点,提升了模型在低收入环境下的有效性。

📝 摘要(中文)

主流视觉-语言(VL)数据集常常表现出文化偏见,不成比例地偏向高收入西方环境,这降低了模型的泛化能力,并加剧了性能差异,尤其影响低收入和非西方社区。为了解决这些差距,我们提出了一个新颖的以功能为中心的框架,该框架根据对象在不同文化和经济环境中实现的功能对其进行分类。我们通过创建文化功能可供性图谱来实现这个框架,该图谱是对Dollar Street数据集的重新注释和文化基础上的重构,涵盖46个功能和288个对象,可在https://lit.eecs.umich.edu/CultureAffordance-Atlas/index.html公开获取。通过使用CLIP模型进行广泛的实证分析,我们证明了以功能为中心的标签显著缩小了高收入和低收入群体之间的社会经济性能差距,中位数提高了6个百分点(具有统计学意义),从而提高了模型在低收入环境中的有效性。此外,我们的分析揭示了许多在主要的VL数据集中经常被忽视的文化上必不可少的对象。我们的贡献为构建包容性的VL数据集和公平的AI系统提供了一条可扩展的途径。

🔬 方法详解

问题定义:论文旨在解决视觉-语言模型在不同文化背景下的泛化能力不足的问题。现有视觉-语言数据集存在严重的文化偏见,主要集中在高收入西方环境,导致模型在低收入和非西方环境下的表现不佳。现有方法缺乏对不同文化背景下对象的功能性理解,无法有效弥合文化差异。

核心思路:论文的核心思路是以功能为中心,将对象按照其在不同文化和经济环境中实现的功能进行分类。通过关注对象的功能而非其具体形态,可以更好地理解不同文化背景下人们的需求和使用习惯,从而提高模型的泛化能力。这种方法能够减少文化偏见,使模型更好地适应不同的文化环境。

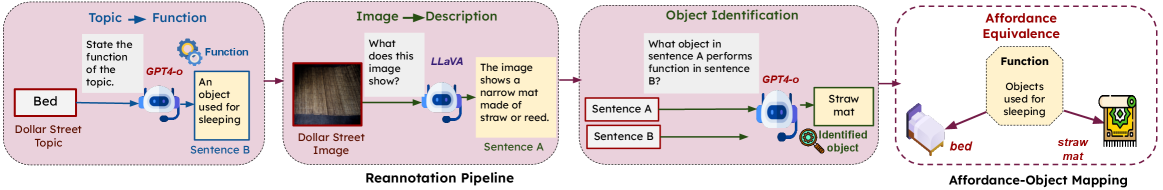

技术框架:论文构建了文化功能可供性图谱(Culture Affordance Atlas),该图谱是对Dollar Street数据集的重新注释和文化基础上的重构。该图谱包含46个功能和288个对象,每个对象都根据其在不同文化背景下实现的功能进行标注。研究人员使用CLIP模型对该图谱进行评估,以验证其在减少文化偏见方面的有效性。

关键创新:论文的关键创新在于提出了以功能为中心的视觉-语言模型训练方法。与传统的以对象为中心的训练方法不同,该方法关注对象的功能而非其具体形态,从而能够更好地理解不同文化背景下人们的需求和使用习惯。这种方法能够有效减少文化偏见,提高模型在不同文化环境下的泛化能力。

关键设计:论文的关键设计包括:1) 对Dollar Street数据集进行重新注释,构建文化功能可供性图谱;2) 定义了46个涵盖广泛文化背景的功能类别;3) 使用CLIP模型作为评估工具,验证功能标签在减少文化偏见方面的有效性。论文没有涉及特定的损失函数或网络结构创新,而是侧重于数据集的构建和评估方法的设计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用文化功能可供性图谱进行训练,能够显著缩小高收入和低收入群体之间的社会经济性能差距,中位数提高了6个百分点(具有统计学意义)。此外,该研究还揭示了许多在主流视觉-语言数据集中经常被忽视的文化上必不可少的对象,为构建更全面的数据集提供了指导。

🎯 应用场景

该研究成果可应用于构建更公平、更具包容性的AI系统,尤其是在视觉-语言理解领域。例如,可以用于改进图像搜索、视觉问答等应用,使其更好地服务于不同文化背景的用户。此外,该方法还可以推广到其他领域,如机器人、人机交互等,以提高AI系统在不同文化环境下的适应性和可用性。

📄 摘要(原文)

Culture shapes the objects people use and for what purposes, yet mainstream Vision-Language (VL) datasets frequently exhibit cultural biases, disproportionately favoring higher-income, Western contexts. This imbalance reduces model generalizability and perpetuates performance disparities, especially impacting lower-income and non-Western communities. To address these disparities, we propose a novel function-centric framework that categorizes objects by the functions they fulfill, across diverse cultural and economic contexts. We implement this framework by creating the Culture Affordance Atlas, a re-annotated and culturally grounded restructuring of the Dollar Street dataset spanning 46 functions and 288 objects publicly available at https://lit.eecs.umich.edu/CultureAffordance-Atlas/index.html. Through extensive empirical analyses using the CLIP model, we demonstrate that function-centric labels substantially reduce socioeconomic performance gaps between high- and low-income groups by a median of 6 pp (statistically significant), improving model effectiveness for lower-income contexts. Furthermore, our analyses reveals numerous culturally essential objects that are frequently overlooked in prominent VL datasets. Our contributions offer a scalable pathway toward building inclusive VL datasets and equitable AI systems.