Peer-to-Peer Energy Trading in Dairy Farms using Multi-Agent Reinforcement Learning

作者: Mian Ibad Ali Shah, Marcos Eduardo Cruz Victorio, Maeve Duffy, Enda Barrett, Karl Mason

分类: cs.AI

发布日期: 2025-11-28

备注: 51 pages, 7 figures, 11 tables, Preprint of the article published in Applied Energy: Shah, M.I.A., Victorio, M.E.C., Duffy, M., Barrett, E. and Mason, K. (2026). Peer-to-peer energy trading in dairy farms using multi-agent reinforcement learning. Applied Energy, 402, 127041. doi:10.1016/j.apenergy.2025.127041

期刊: Applied Energy (2026), 402, 127041

DOI: 10.1016/j.apenergy.2025.127041

💡 一句话要点

提出基于多智能体强化学习的P2P能源交易方法,优化乳品农场的能源管理。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 点对点能源交易 可再生能源 能源管理 乳品农场

📋 核心要点

- 传统能源管理方法在动态环境下表现不佳,无法有效应对可再生能源的波动性和需求变化。

- 利用多智能体强化学习(MARL)和点对点(P2P)能源交易机制,实现去中心化的能源优化管理。

- 实验结果表明,该方法有效降低了电力成本和峰时需求,并增加了电力销售收入,提升能源利用效率。

📝 摘要(中文)

本研究探讨了点对点(P2P)能源交易在农村地区(如乳品农场社区)整合可再生能源资源中的作用,实现了去中心化的能源管理。传统规则方法在稳定条件下表现良好,但在动态环境中表现不佳。为了解决这个问题,研究结合了多智能体强化学习(MARL),特别是近端策略优化(PPO)和深度Q网络(DQN),以及社区/分布式P2P交易机制。通过结合基于拍卖的市场清算、价格顾问代理以及负载和电池管理,该方法取得了显著改进。结果表明,与基线模型相比,DQN在爱尔兰降低了14.2%的电力成本,在芬兰降低了5.16%,同时分别增加了7.24%和12.73%的电力收入。PPO在爱尔兰实现了最低的峰时需求,降低了55.5%,而DQN在爱尔兰和芬兰分别降低了50.0%和27.02%的峰时需求。这些改进归功于MARL算法和P2P能源交易,共同降低了电力成本和峰时需求,并增加了电力销售收入。这项研究强调了DQN、PPO和P2P交易在实现农村社区高效、适应性和可持续能源管理方面的互补优势。

🔬 方法详解

问题定义:论文旨在解决乳品农场等农村地区可再生能源整合过程中,传统能源管理方法在动态环境下效率低下的问题。现有方法难以有效应对可再生能源的波动性,无法实现能源的优化分配和利用,导致电力成本高昂和峰时需求过高。

核心思路:论文的核心思路是利用多智能体强化学习(MARL)技术,结合点对点(P2P)能源交易机制,构建一个去中心化的能源管理系统。每个农场作为一个智能体,通过学习和交互,优化自身的能源生产和消费策略,实现能源的有效分配和利用。

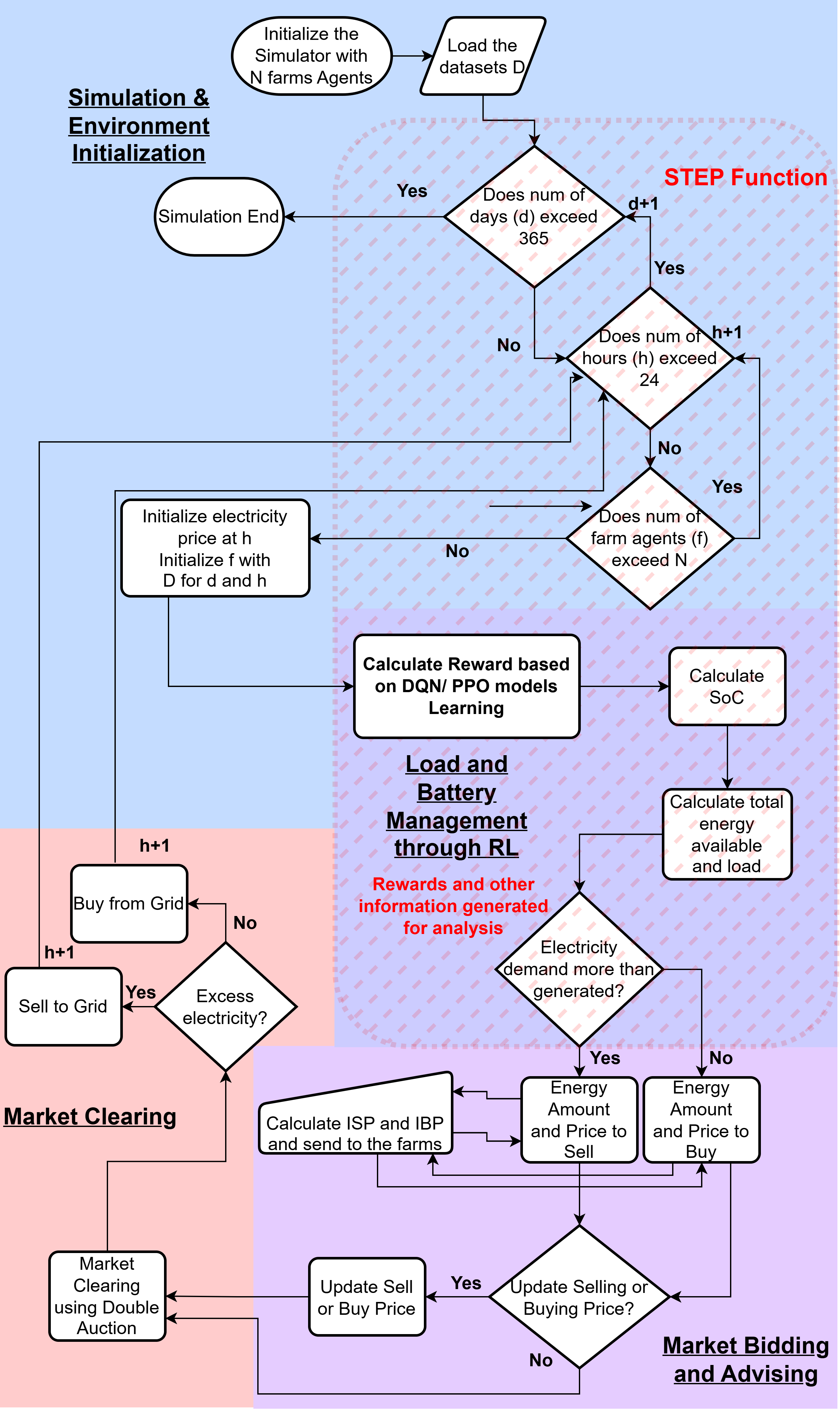

技术框架:该方法的技术框架包含以下主要模块:1) 基于拍卖的市场清算机制,用于确定能源交易价格;2) 价格顾问代理,用于提供市场价格信息;3) 负载和电池管理模块,用于优化能源的生产、存储和消费;4) 基于Proximal Policy Optimization (PPO) 和 Deep Q-Networks (DQN) 的多智能体强化学习算法,用于训练每个农场的能源管理策略。整体流程是,每个农场根据自身情况和市场信息,通过MARL算法学习最优的能源交易策略,并在P2P网络中进行能源交易,最终实现整个社区的能源优化。

关键创新:该方法最重要的技术创新点在于将多智能体强化学习(MARL)与点对点(P2P)能源交易机制相结合。与传统的集中式能源管理方法相比,该方法具有更高的灵活性和适应性,能够更好地应对动态环境下的能源管理挑战。此外,通过引入基于拍卖的市场清算机制和价格顾问代理,可以有效地促进能源交易,提高能源利用效率。

关键设计:在MARL算法方面,论文采用了Proximal Policy Optimization (PPO) 和 Deep Q-Networks (DQN) 两种算法。PPO是一种基于策略梯度的强化学习算法,具有较好的稳定性和收敛性。DQN是一种基于价值函数的强化学习算法,能够处理高维状态空间。在P2P能源交易方面,论文采用了基于拍卖的市场清算机制,通过竞争性 bidding 确定能源交易价格。此外,论文还设计了价格顾问代理,用于提供市场价格信息,帮助农场制定更合理的能源交易策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与基线模型相比,DQN在爱尔兰降低了14.2%的电力成本,在芬兰降低了5.16%,同时分别增加了7.24%和12.73%的电力收入。PPO在爱尔兰实现了最低的峰时需求,降低了55.5%,而DQN在爱尔兰和芬兰分别降低了50.0%和27.02%的峰时需求。这些数据表明,该方法在降低电力成本、增加电力收入和降低峰时需求方面具有显著优势。

🎯 应用场景

该研究成果可应用于乳品农场、偏远社区等农村地区,实现可再生能源的有效整合和利用,降低电力成本,提高能源自给自足能力。此外,该方法还可推广到城市微电网、工业园区等场景,促进能源的清洁化和智能化转型,为构建可持续的能源系统提供技术支撑。

📄 摘要(原文)

The integration of renewable energy resources in rural areas, such as dairy farming communities, enables decentralized energy management through Peer-to-Peer (P2P) energy trading. This research highlights the role of P2P trading in efficient energy distribution and its synergy with advanced optimization techniques. While traditional rule-based methods perform well under stable conditions, they struggle in dynamic environments. To address this, Multi-Agent Reinforcement Learning (MARL), specifically Proximal Policy Optimization (PPO) and Deep Q-Networks (DQN), is combined with community/distributed P2P trading mechanisms. By incorporating auction-based market clearing, a price advisor agent, and load and battery management, the approach achieves significant improvements. Results show that, compared to baseline models, DQN reduces electricity costs by 14.2% in Ireland and 5.16% in Finland, while increasing electricity revenue by 7.24% and 12.73%, respectively. PPO achieves the lowest peak hour demand, reducing it by 55.5% in Ireland, while DQN reduces peak hour demand by 50.0% in Ireland and 27.02% in Finland. These improvements are attributed to both MARL algorithms and P2P energy trading, which together results in electricity cost and peak hour demand reduction, and increase electricity selling revenue. This study highlights the complementary strengths of DQN, PPO, and P2P trading in achieving efficient, adaptable, and sustainable energy management in rural communities.