Learning to Debug: LLM-Organized Knowledge Trees for Solving RTL Assertion Failures

作者: Yunsheng Bai, Haoxing Ren

分类: cs.AI, cs.SE

发布日期: 2025-11-21 (更新: 2025-12-13)

💡 一句话要点

GROVE:利用LLM组织知识树解决RTL断言失败问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 硬件验证 RTL调试 断言失败 大型语言模型 知识图谱

📋 核心要点

- 硬件验证中,RTL断言失败的调试成本高昂,现有方法难以有效复用工程师的专业知识。

- GROVE通过构建LLM组织的知识树,从历史案例中学习并存储可复用的调试知识,提升调试效率。

- 实验表明,GROVE在解决断言失败问题时,pass@1和pass@5指标均有提升,验证了其有效性。

📝 摘要(中文)

调试是现代硬件验证中最主要的成本,其中断言失败是最频繁且解决成本最高的问题之一。虽然大型语言模型(LLM)显示出潜力,但它们常常无法捕捉工程师应用的精确、可复用的专业知识,导致不准确的响应。我们提出了GROVE,一个分层知识管理框架,它学习并将可复用的调试专业知识组织成一个由LLM组织的知识树,用于解决断言失败问题。GROVE从先前的案例中提取调试知识,并将其组织成一个可配置深度的垂直树,每个节点编码一个简洁的知识项和明确的适用条件。在训练期间,GROVE使用一个并行的、无梯度的循环,其中LLM通过学习案例,以结构化的JSON编辑方式提出树的修改。在测试时,执行预算感知的迭代缩放来导航树,检索一小部分适用的知识项,以指导基础LLM的假设生成和修复建议。在断言失败案例套件上的评估表明,GROVE在pass@1和pass@5方面都取得了持续的收益,证明了结构化知识演化的价值。

🔬 方法详解

问题定义:论文旨在解决现代硬件验证中RTL(Register Transfer Level)断言失败调试成本高昂的问题。现有方法,包括直接使用LLM,无法有效捕捉和复用工程师的调试经验,导致调试效率低下,结果不准确。工程师的专业知识难以形式化和自动化。

核心思路:论文的核心思路是将调试知识组织成一个分层的知识树结构,并利用LLM来学习和维护这个知识树。通过将调试知识分解为小的、可复用的知识项,并明确每个知识项的适用条件,可以更有效地利用LLM的推理能力,从而提高调试效率和准确性。知识树的结构使得知识的检索和应用更加高效。

技术框架:GROVE框架包含训练和测试两个阶段。在训练阶段,GROVE从历史的断言失败案例中学习调试知识,并构建知识树。LLM作为知识树的组织者,负责提出树的修改建议,例如添加、删除或修改节点。这个过程在一个并行的、无梯度的循环中进行。在测试阶段,GROVE使用一个预算感知的迭代缩放方法来导航知识树,检索相关的知识项,并指导基础LLM生成假设和修复建议。整体流程是:案例输入 -> 知识树导航 -> 知识项检索 -> LLM生成修复方案。

关键创新:GROVE的关键创新在于使用LLM来组织和维护知识树。传统的知识库构建通常需要人工干预,成本高昂且难以维护。GROVE通过让LLM自动学习和组织知识,降低了知识库构建的成本,并提高了知识库的适应性。此外,GROVE还引入了预算感知的迭代缩放方法,可以在有限的计算资源下,有效地检索相关的知识项。

关键设计:知识树的每个节点包含一个简洁的知识项和明确的适用条件。适用条件用于判断该知识项是否适用于当前的断言失败案例。LLM通过结构化的JSON编辑方式来修改知识树,例如添加新的节点、删除不相关的节点或修改现有节点的知识项和适用条件。预算感知的迭代缩放方法根据可用的计算资源,动态调整搜索的深度和广度,以在有限的时间内找到最相关的知识项。

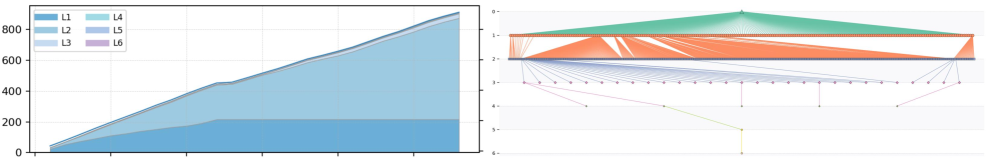

🖼️ 关键图片

📊 实验亮点

GROVE在断言失败案例套件上的评估中,pass@1和pass@5指标均优于基线方法,表明其能够更有效地解决断言失败问题。具体的性能提升数据未知,但摘要强调了“consistent gains”,表明GROVE具有稳定的性能优势。

🎯 应用场景

GROVE可应用于各种硬件验证场景,尤其是在需要处理大量断言失败案例的复杂系统中。它可以帮助工程师更快地定位和修复错误,缩短开发周期,降低验证成本。未来,该方法可以扩展到其他类型的调试问题,例如软件错误和系统故障。

📄 摘要(原文)

Debugging is the dominant cost in modern hardware verification, where assertion failures are among the most frequent and expensive to resolve. While Large Language Models (LLMs) show promise, they often fail to capture the precise, reusable expertise that engineers apply, leading to inaccurate responses. We propose GROVE, a hierarchical knowledge management framework that learns and organizes reusable debugging expertise into an LLM-organized knowledge tree for solving assertion failures. GROVE distills debugging knowledge from prior cases and organizes it into a vertical tree of configurable depth, with each node encoding a concise knowledge item and explicit applicability conditions. During training, GROVE uses a parallel, gradient-free loop where an LLM proposes tree modifications as structured JSON edits by learning from the cases. At test time, a budget-aware iterative zoom is performed to navigate the tree, retrieving a small set of applicable knowledge items that guide a base LLM's hypothesis generation and fix proposals. Evaluated on a suite of assertion-failure cases, GROVE delivers consistent gains in pass@1 and pass@5, demonstrating the value of structured knowledge evolution.