Datacenters in the Desert: Feasibility and Sustainability of LLM Inference in the Middle East

作者: Lara Hassan, Mohamed ElZeftawy, Abdulrahman Mahmoud

分类: cs.CY, cs.AI

发布日期: 2025-11-21

备注: 3 pages, 1 figure

期刊: DCEE-2025@ISCA-2025

💡 一句话要点

分析中东沙漠地区部署LLM推理数据中心的可行性与可持续性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 LLM推理 数据中心 能源消耗 碳排放 可持续性 气候感知AI

📋 核心要点

- 现有AI基础设施扩展面临能源消耗和碳排放挑战,尤其是在气候条件严苛的地区。

- 该研究分析了不同地理位置部署LLM推理数据中心的环境影响,重点关注中东沙漠地区。

- 通过实证研究,量化了不同国家LLM推理的能源消耗和碳足迹,为气候感知AI部署提供参考。

📝 摘要(中文)

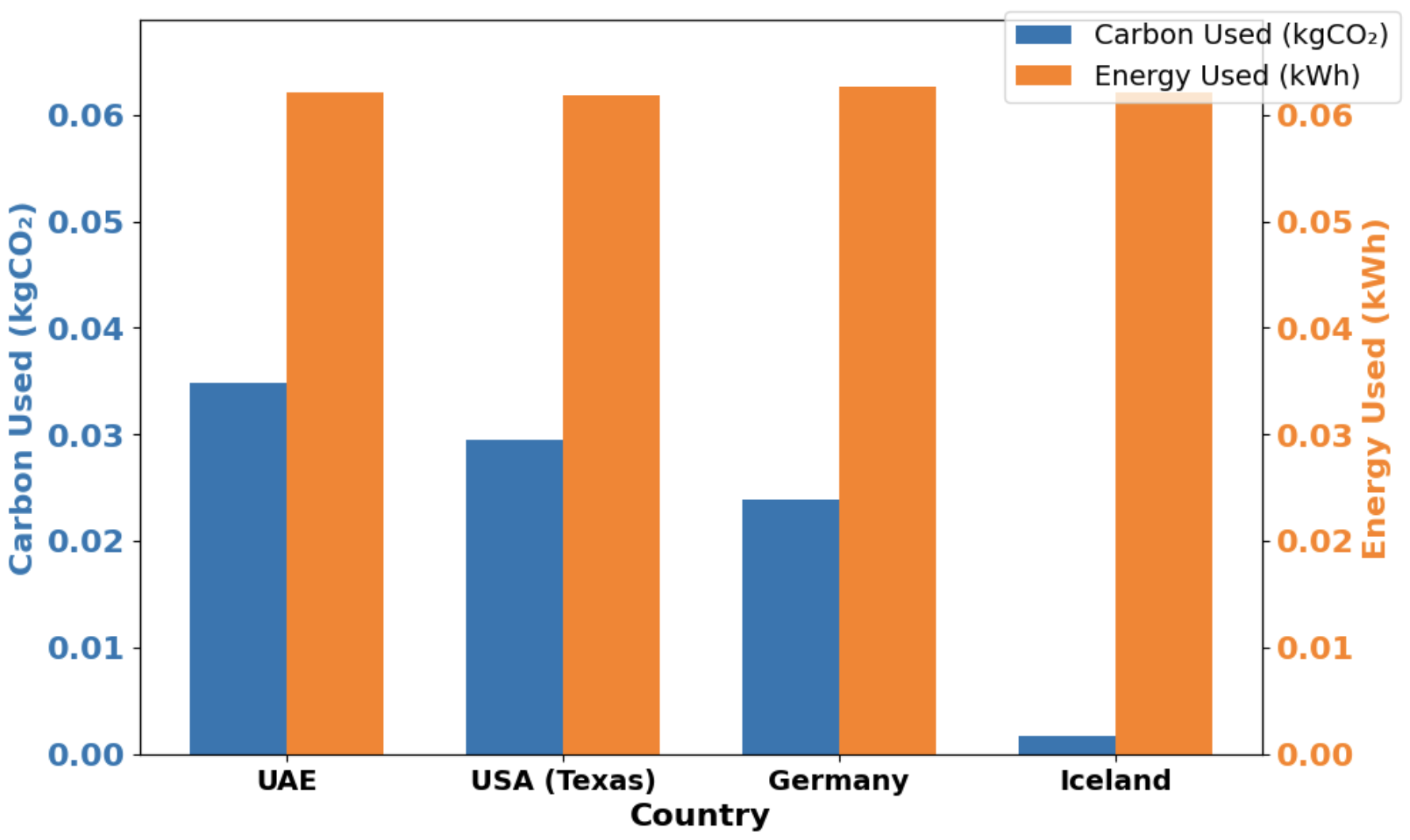

随着中东地区崛起为人工智能(AI)基础设施的战略枢纽,在沙漠环境中部署可持续数据中心的可行性日益重要。本文通过实证研究,分析了大型语言模型(LLM)推理在四个国家(阿拉伯联合酋长国、冰岛、德国和美国)的能源消耗和碳足迹。研究使用了DeepSeek Coder 1.3B模型和HumanEval数据集,针对代码生成任务进行了评估。我们使用CodeCarbon库来跟踪能源消耗和碳排放,并比较了不同地理位置在气候感知AI部署方面的权衡。研究结果突出了沙漠地区数据中心面临的挑战和潜力,并对它们在全球AI扩展中的作用提供了平衡的展望。

🔬 方法详解

问题定义:论文旨在评估在中东沙漠地区部署大型语言模型(LLM)推理数据中心的可行性和可持续性。现有方法缺乏对不同地理位置,特别是气候条件严苛地区(如中东沙漠)部署AI基础设施的环境影响的量化分析,难以指导气候感知的AI部署决策。

核心思路:论文的核心思路是通过实证研究,量化不同地理位置(包括中东沙漠地区)部署LLM推理数据中心的能源消耗和碳足迹,从而评估其环境影响。通过比较不同地区的能耗和碳排放,为气候感知的AI部署提供决策依据。

技术框架:研究的技术框架主要包括以下几个步骤:1) 选择代表性地理位置:阿拉伯联合酋长国(阿联酋)、冰岛、德国和美国。2) 选择LLM模型和数据集:DeepSeek Coder 1.3B模型和HumanEval数据集,用于代码生成任务。3) 能源和碳排放跟踪:使用CodeCarbon库来跟踪LLM推理过程中的能源消耗和碳排放。4) 数据分析和比较:比较不同地理位置的能源消耗和碳排放,分析气候条件对数据中心环境影响的权衡。

关键创新:该研究的关键创新在于其针对中东沙漠地区部署LLM推理数据中心的可行性和可持续性进行了实证分析,并量化了不同地理位置的能源消耗和碳足迹。与现有研究相比,该研究更关注气候条件对AI基础设施环境影响的差异性,为气候感知的AI部署提供了更具体的指导。

关键设计:研究的关键设计包括:1) 选择DeepSeek Coder 1.3B模型,因为它是一个相对较小的LLM,适合在不同硬件平台上进行部署和推理。2) 使用HumanEval数据集,因为它是一个广泛使用的代码生成基准,可以用于评估不同模型的性能。3) 使用CodeCarbon库,它可以自动跟踪Python代码的能源消耗和碳排放,无需手动测量。4) 在不同地理位置部署相同的LLM推理任务,以确保结果的可比性。

🖼️ 关键图片

📊 实验亮点

研究结果表明,不同地理位置的LLM推理的能源消耗和碳足迹存在显著差异。例如,在阿联酋部署数据中心可能面临更高的冷却成本和碳排放,而在冰岛则可能利用可再生能源降低环境影响。该研究为气候感知的AI部署提供了量化的数据支持,有助于优化AI基础设施的选址和能源利用。

🎯 应用场景

该研究成果可应用于指导AI基础设施的选址和部署决策,尤其是在气候条件严苛的地区。通过量化不同地理位置的能源消耗和碳足迹,可以帮助企业和政府选择更可持续的AI部署方案,降低环境影响。此外,该研究还可以促进气候感知AI技术的发展,例如开发更节能的LLM模型和推理算法。

📄 摘要(原文)

As the Middle East emerges as a strategic hub for artificial intelligence (AI) infrastructure, the feasibility of deploying sustainable datacenters in desert environments has become a topic of growing relevance. This paper presents an empirical study analyzing the energy consumption and carbon footprint of large language model (LLM) inference across four countries: the United Arab Emirates, Iceland, Germany, and the United States of America using DeepSeek Coder 1.3B and the HumanEval dataset on the task of code generation. We use the CodeCarbon library to track energy and carbon emissions andcompare geographical trade-offs for climate-aware AI deployment. Our findings highlight both the challenges and potential of datacenters in desert regions and provide a balanced outlook on their role in global AI expansion.