Constrained Network Slice Assignment via Large Language Models

作者: Sagar Sudhakara, Pankaj Rajak

分类: cs.NI, cs.AI

发布日期: 2025-11-14

备注: Accepted at NeurIPS 2025 Workshop on AI and ML for Next-Generation Wireless Communications and Networking (AI4NextG), San Diego, CA

💡 一句话要点

利用大语言模型解决约束条件下的网络切片分配问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 网络切片 资源分配 大语言模型 零样本学习 整数规划

📋 核心要点

- 传统网络切片资源分配依赖复杂算法,难以应对多样化服务需求和约束条件。

- 利用LLM的语义理解能力,直接进行零样本切片分配,或辅助整数规划模型。

- 实验表明,LLM能生成合理分配方案,结合优化求解器可媲美传统方法,提升资源利用率。

📝 摘要(中文)

现代网络支持网络切片,它将物理基础设施划分为虚拟切片,以满足不同的服务需求(例如,高带宽或低延迟)。将用户最佳地分配到切片是一个受约束的优化问题,传统上需要复杂的算法。本文探讨了使用大型语言模型(LLM)来解决网络切片的无线资源分配问题。我们重点关注两种方法:(1)在零样本设置中使用LLM直接将用户服务请求分配给切片;(2)构建一个整数规划模型,其中LLM通过估计请求之间的相似性来提供语义洞察。实验表明,即使采用零样本提示,LLM也可以生成切片分配的合理初稿,尽管它可能违反一些容量或延迟约束。然后,我们将LLM对服务需求的理解纳入优化求解器,以生成改进的分配。结果表明,基于最少文本输入,LLM引导的请求分组在资源利用率和切片隔离方面,实现了与使用详细数值数据的传统方法相当的性能。虽然LLM本身并不能完全满足所有约束,但它显著减少了搜索空间,并且在与精确求解器结合使用时,为高效的5G网络切片资源分配提供了一种有前景的方法。

🔬 方法详解

问题定义:论文旨在解决网络切片中用户到切片的资源分配问题。现有方法通常依赖于复杂的优化算法和详细的数值数据,计算成本高昂,且难以有效利用服务请求中的语义信息,导致资源分配效率不高,难以满足不同切片的隔离需求。

核心思路:论文的核心思路是利用大型语言模型(LLM)的语义理解能力,从用户服务请求的文本描述中提取关键信息,辅助或直接进行切片分配。通过LLM对请求相似性的判断,可以更好地将具有相似需求的用户分配到同一切片,从而提高资源利用率和切片隔离度。

技术框架:论文提出了两种基于LLM的切片分配方法。第一种方法是零样本方法,直接使用LLM根据用户请求的文本描述进行切片分配。第二种方法是LLM辅助的整数规划方法,首先使用LLM计算用户请求之间的相似度,然后将这些相似度信息作为整数规划模型的输入,由优化求解器生成最终的切片分配方案。整体流程包括:用户请求输入 -> LLM处理(零样本分配或相似度计算) -> (可选)整数规划求解 -> 切片分配结果。

关键创新:论文的关键创新在于将大型语言模型引入到网络切片资源分配领域。与传统方法相比,该方法能够利用LLM的语义理解能力,从用户请求的文本描述中提取关键信息,从而更好地进行切片分配。此外,该方法还能够减少对详细数值数据的依赖,降低计算成本。

关键设计:在零样本方法中,关键在于设计合适的prompt,引导LLM进行切片分配。在LLM辅助的整数规划方法中,关键在于如何定义用户请求之间的相似度,以及如何将这些相似度信息有效地融入到整数规划模型中。论文中使用了余弦相似度来衡量用户请求之间的相似性,并将其作为整数规划模型的约束条件。

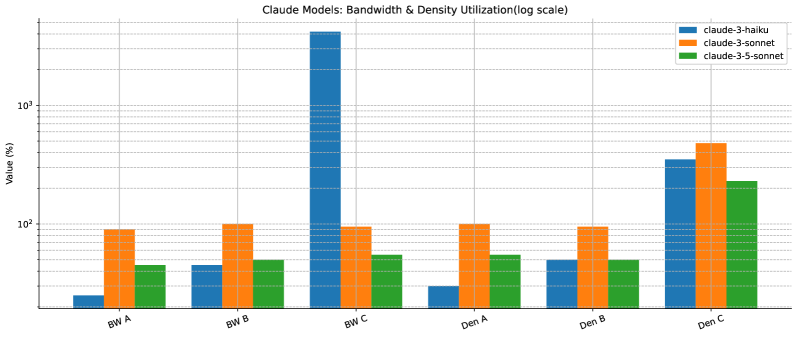

🖼️ 关键图片

📊 实验亮点

实验结果表明,即使采用零样本提示,LLM也能生成合理的切片分配方案,虽然可能违反部分约束。结合优化求解器后,LLM引导的请求分组在资源利用率和切片隔离方面,可达到与传统方法相当的性能。该方法在减少搜索空间和降低计算复杂度方面具有显著优势。

🎯 应用场景

该研究成果可应用于5G/6G网络切片资源分配、智能交通、工业自动化等领域。通过LLM理解用户需求,实现更智能、高效的网络资源管理,提升用户体验,降低运营成本。未来可扩展到边缘计算、物联网等场景,实现更灵活的网络服务定制。

📄 摘要(原文)

Modern networks support network slicing, which partitions physical infrastructure into virtual slices tailored to different service requirements (for example, high bandwidth or low latency). Optimally allocating users to slices is a constrained optimization problem that traditionally requires complex algorithms. In this paper, we explore the use of Large Language Models (LLMs) to tackle radio resource allocation for network slicing. We focus on two approaches: (1) using an LLM in a zero-shot setting to directly assign user service requests to slices, and (2) formulating an integer programming model where the LLM provides semantic insight by estimating similarity between requests. Our experiments show that an LLM, even with zero-shot prompting, can produce a reasonable first draft of slice assignments, although it may violate some capacity or latency constraints. We then incorporate the LLM's understanding of service requirements into an optimization solver to generate an improved allocation. The results demonstrate that LLM-guided grouping of requests, based on minimal textual input, achieves performance comparable to traditional methods that use detailed numerical data, in terms of resource utilization and slice isolation. While the LLM alone does not perfectly satisfy all constraints, it significantly reduces the search space and, when combined with exact solvers, provides a promising approach for efficient 5G network slicing resource allocation.