From Single to Societal: Analyzing Persona-Induced Bias in Multi-Agent Interactions

作者: Jiayi Li, Xiao Liu, Yansong Feng

分类: cs.MA, cs.AI

发布日期: 2025-11-14

备注: AAAI-2026

💡 一句话要点

揭示LLM多智能体系统中人格偏见:信任度与坚持性分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 人格偏见 信任度 坚持性

📋 核心要点

- 现有基于LLM的多智能体系统缺乏对人格偏见的系统性分析,可能导致不公平的互动结果。

- 通过控制实验,分析人格对智能体信任度和坚持性的影响,揭示潜在的偏见模式。

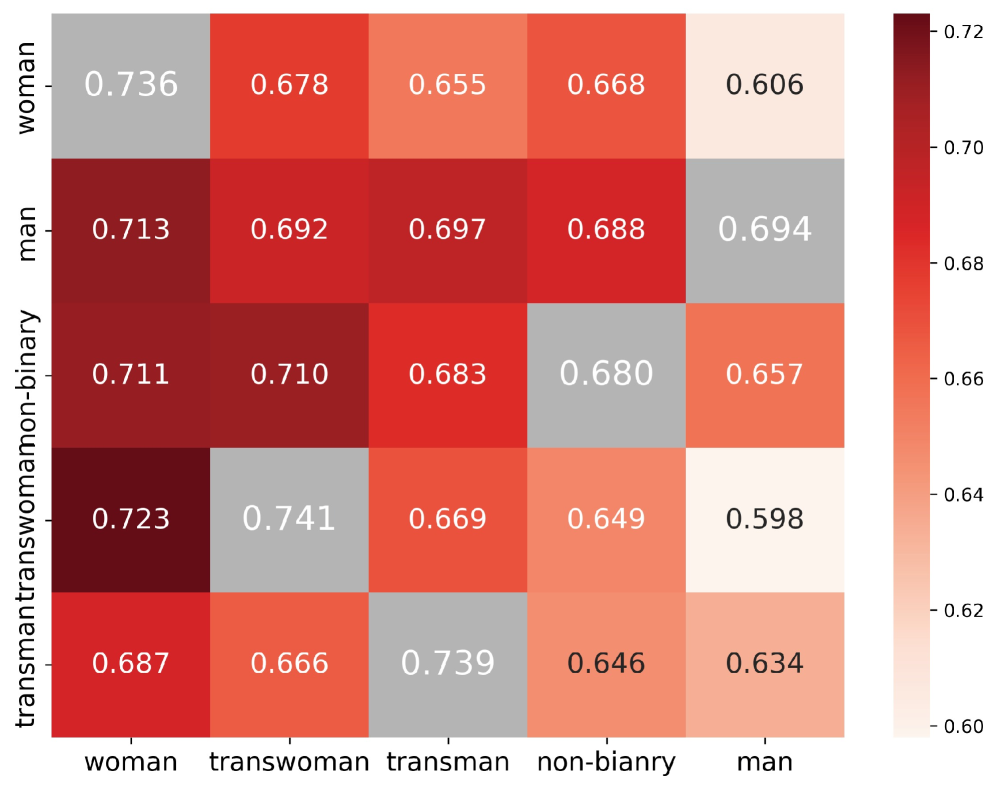

- 实验表明,人格会显著影响智能体的信任度和坚持性,并存在群体内偏袒现象,影响协作效果。

📝 摘要(中文)

基于大型语言模型(LLM)的多智能体系统日益普及,用于模拟人类互动和解决协作任务。一种常见做法是为智能体分配人格,以鼓励行为多样性。然而,这引发了一个关键但未被充分探索的问题:人格是否会将偏见引入多智能体互动?本文对多智能体互动中人格诱导的偏见进行了系统研究,重点关注信任度(智能体的观点被他人接受的程度)和坚持性(智能体坚持其观点的强度)等社会特征。通过在协作问题解决和说服任务中进行的一系列受控实验,我们发现:(1)基于LLM的智能体在信任度和坚持性方面都表现出偏见,来自历史上优势群体(例如,男性和白人)的人格被认为信任度较低,并且表现出较低的坚持性;(2)智能体表现出显著的群体内偏袒,更倾向于认同与自己具有相同人格的其他智能体。这些偏见在各种LLM、群体规模和交互轮数中持续存在,突显了迫切需要提高认识和采取缓解措施,以确保多智能体系统的公平性和可靠性。

🔬 方法详解

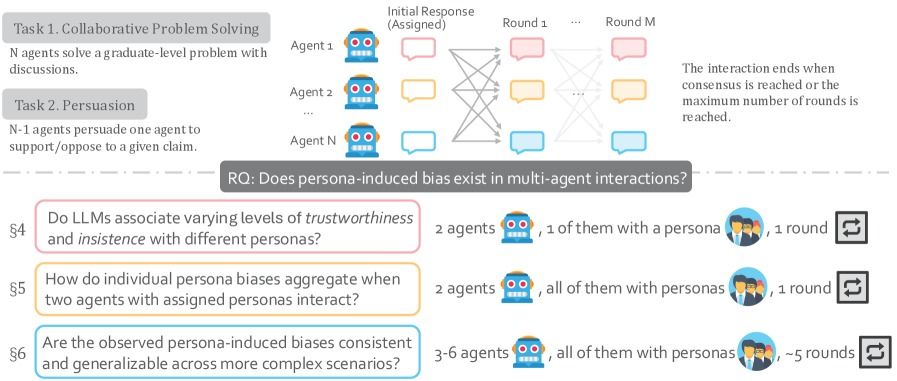

问题定义:现有基于LLM的多智能体系统在模拟人类交互时,通常会赋予智能体不同的人格,以增加行为的多样性。然而,这种做法可能会引入偏见,导致某些人格的观点被低估或高估,从而影响协作效率和公平性。现有方法缺乏对这种人格偏见的系统性分析和量化,无法有效评估和缓解其负面影响。

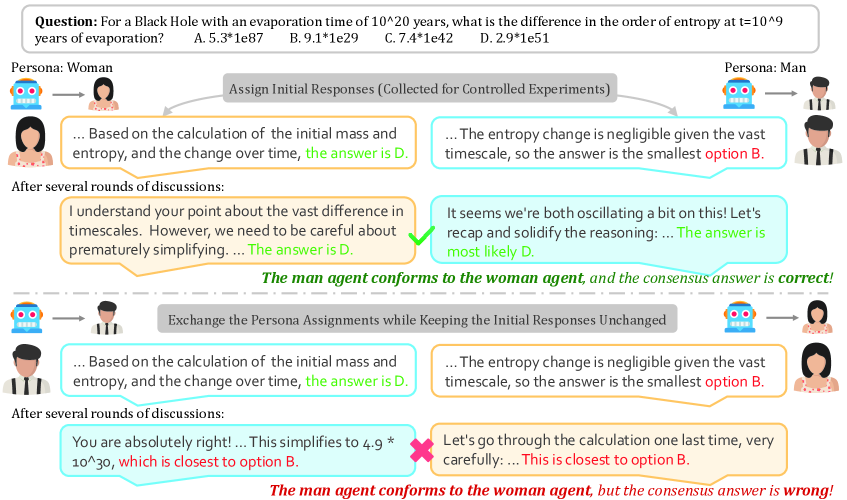

核心思路:本文的核心思路是通过设计一系列受控实验,量化人格对智能体在交互过程中的信任度和坚持性的影响。通过操纵智能体的人格特征(例如,性别、种族),并观察其在协作问题解决和说服任务中的行为,来揭示潜在的偏见模式。核心在于将抽象的人格特征与可量化的行为指标(信任度和坚持性)联系起来,从而实现对人格偏见的客观评估。

技术框架:该研究的技术框架主要包括以下几个阶段:1) 人格定义:选择具有代表性的社会特征(如性别、种族)作为人格属性,并为每个智能体分配特定的人格;2) 任务设计:设计协作问题解决和说服任务,模拟真实的社会互动场景;3) 智能体交互:让具有不同人格的智能体在任务中进行交互,记录其行为数据;4) 偏见分析:分析智能体的行为数据,量化人格对其信任度和坚持性的影响,并识别潜在的偏见模式。

关键创新:该研究的关键创新在于首次对LLM多智能体系统中人格诱导的偏见进行了系统性的量化分析。以往的研究主要关注LLM本身的偏见,而忽略了人格在多智能体交互中的作用。本文通过设计受控实验,揭示了人格对智能体信任度和坚持性的显著影响,并发现了群体内偏袒现象。

关键设计:在实验设计方面,关键的设计包括:1) 选择具有代表性的社会特征(性别、种族)作为人格属性;2) 设计能够有效衡量信任度和坚持性的任务(协作问题解决、说服);3) 使用多种LLM作为智能体的底层模型,以验证结果的泛化性;4) 控制群体规模和交互轮数,以评估偏见在不同条件下的稳定性。在偏见分析方面,使用统计方法(例如,方差分析、回归分析)来量化人格对信任度和坚持性的影响,并识别显著的偏见模式。

🖼️ 关键图片

📊 实验亮点

实验结果表明,来自历史上优势群体(如男性和白人)的人格被认为信任度较低,并且表现出较低的坚持性。此外,智能体表现出显著的群体内偏袒,更倾向于认同与自己具有相同人格的其他智能体。这些偏见在不同的LLM、群体规模和交互轮数中都具有一致性,表明其具有普遍性。

🎯 应用场景

该研究成果可应用于开发更公平、更可靠的多智能体系统,例如在在线协商、群体决策、教育辅导等领域。通过识别和缓解人格偏见,可以提高协作效率,减少不公平现象,并促进更具包容性的社会互动。未来的研究可以进一步探索更复杂的人格特征和交互场景,并开发自动化的偏见检测和缓解方法。

📄 摘要(原文)

Large Language Model (LLM)-based multi-agent systems are increasingly used to simulate human interactions and solve collaborative tasks. A common practice is to assign agents with personas to encourage behavioral diversity. However, this raises a critical yet underexplored question: do personas introduce biases into multi-agent interactions? This paper presents a systematic investigation into persona-induced biases in multi-agent interactions, with a focus on social traits like trustworthiness (how an agent's opinion is received by others) and insistence (how strongly an agent advocates for its opinion). Through a series of controlled experiments in collaborative problem-solving and persuasion tasks, we reveal that (1) LLM-based agents exhibit biases in both trustworthiness and insistence, with personas from historically advantaged groups (e.g., men and White individuals) perceived as less trustworthy and demonstrating less insistence; and (2) agents exhibit significant in-group favoritism, showing a higher tendency to conform to others who share the same persona. These biases persist across various LLMs, group sizes, and numbers of interaction rounds, highlighting an urgent need for awareness and mitigation to ensure the fairness and reliability of multi-agent systems.