MALBO: Optimizing LLM-Based Multi-Agent Teams via Multi-Objective Bayesian Optimization

作者: Antonio Sabbatella

分类: cs.MA, cs.AI

发布日期: 2025-11-14

备注: Master's Thesis, University of Milano-Bicocca, 2025

💡 一句话要点

MALBO:通过多目标贝叶斯优化提升基于LLM的多智能体团队性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 贝叶斯优化 多目标优化 帕累托前沿 成本优化 智能体配置

📋 核心要点

- 现有方法难以在多智能体系统中,针对LLM的角色分配进行性能与成本的权衡优化。

- MALBO将智能体团队构建形式化为多目标优化问题,利用贝叶斯优化寻找帕累托最优配置。

- 实验表明,MALBO在保持性能的同时,降低了平均配置成本,并实现了显著的成本节约。

📝 摘要(中文)

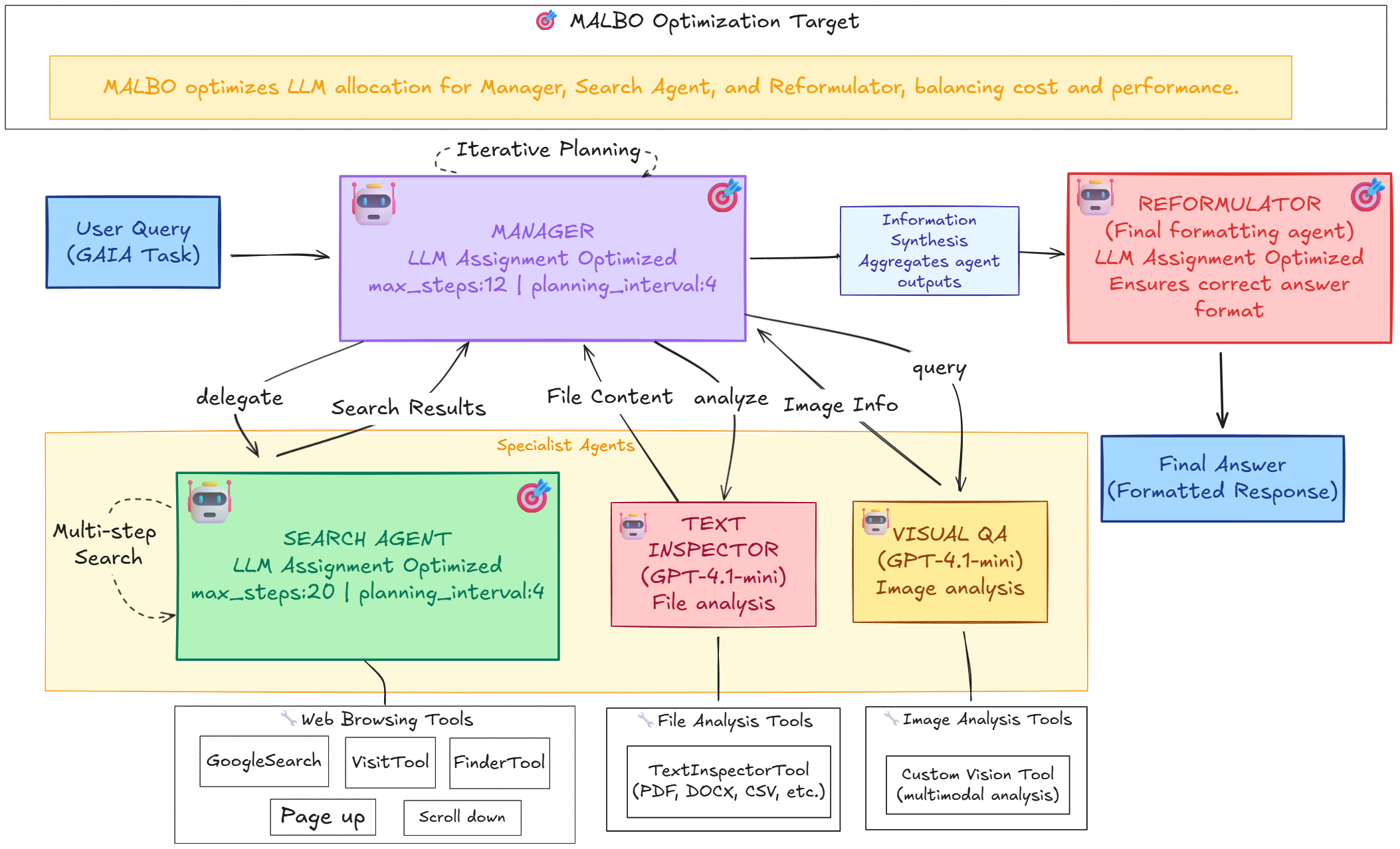

在多智能体系统中,将大型语言模型(LLM)优化分配到特定角色是一项重大挑战,其特点是组合搜索空间巨大、黑盒评估成本高昂,以及性能和成本之间的内在权衡。现有的优化方法侧重于单智能体设置,缺乏针对这种多智能体、多目标问题的系统框架。本研究提出了MALBO(多智能体LLM贝叶斯优化),这是一个旨在自动高效地构建基于LLM的智能体团队的系统框架。我们将分配挑战形式化为多目标优化问题,旨在识别任务准确性和推理成本之间的帕累托最优配置。该方法采用具有独立高斯过程代理模型的多目标贝叶斯优化(MOBO)。通过在LLM的连续特征空间表示上进行搜索,这种方法执行由预期超体积改进引导的样本高效探索。

🔬 方法详解

问题定义:论文旨在解决在多智能体系统中,如何高效且经济地分配大型语言模型(LLM)到不同的专业角色。现有方法主要集中在单智能体设置,无法有效处理多智能体环境下的复杂组合优化问题,尤其是在性能(任务准确性)和成本(推理成本)之间存在权衡时。此外,直接评估不同LLM配置的成本很高,使得传统的搜索方法效率低下。

核心思路:MALBO的核心思路是将LLM的角色分配问题建模为一个多目标优化问题,目标是在任务准确性和推理成本之间找到帕累托最优解。通过使用贝叶斯优化,MALBO能够有效地探索LLM的配置空间,并在少量样本的情况下找到高质量的解决方案。这种方法利用代理模型来估计不同配置的性能和成本,从而避免了大量的昂贵的真实评估。

技术框架:MALBO的技术框架主要包括以下几个阶段:1) 问题形式化:将LLM分配问题定义为多目标优化问题,明确任务准确性和推理成本作为优化目标。2) 特征空间表示:将LLM表示为连续的特征向量,以便在连续空间中进行搜索。3) 多目标贝叶斯优化(MOBO):使用具有独立高斯过程代理模型的MOBO来估计不同LLM配置的性能和成本。4) 帕累托前沿识别:通过MOBO找到帕累托最优的LLM配置集合,这些配置在性能和成本之间实现了最佳的权衡。

关键创新:MALBO的关键创新在于将多目标贝叶斯优化应用于LLM多智能体团队的构建。与传统的单智能体优化方法相比,MALBO能够同时优化多个目标(性能和成本),并找到一组帕累托最优解,从而为用户提供更多的选择。此外,MALBO使用连续特征空间表示LLM,使得搜索空间更加平滑,从而提高了优化效率。

关键设计:MALBO的关键设计包括:1) 高斯过程代理模型:使用高斯过程来建模LLM配置的性能和成本,并利用高斯过程的不确定性估计来指导搜索。2) 预期超体积改进(Expected Hypervolume Improvement, EHI):使用EHI作为采集函数,引导MOBO探索能够最大程度地改进帕累托前沿的区域。3) 连续特征空间表示:将LLM表示为连续的特征向量,例如嵌入向量或性能指标,以便在连续空间中进行优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与随机搜索相比,MALBO在保持相似平均性能的同时,将平均配置成本降低了45%以上。此外,MALBO能够识别出专业化的异构团队,与同构基线相比,在保持最高性能的同时,成本降低高达65.8%。这些结果验证了MALBO在构建高效LLM多智能体团队方面的有效性。

🎯 应用场景

MALBO可应用于各种需要多智能体协作的场景,例如客户服务、内容创作、软件开发等。通过自动优化LLM团队的配置,可以显著降低运营成本,提高任务完成效率和质量。该研究为构建经济高效且高度专业化的多智能体AI系统提供了一种数据驱动的工具,具有广阔的应用前景。

📄 摘要(原文)

The optimal assignment of Large Language Models (LLMs) to specialized roles in multi-agent systems is a significant challenge, defined by a vast combinatorial search space, expensive black-box evaluations, and an inherent trade-off between performance and cost. Current optimization methods focus on single-agent settings and lack a principled framework for this multi-agent, multi-objective problem. This thesis introduces MALBO (Multi-Agent LLM Bayesian Optimization), a systematic framework designed to automate the efficient composition of LLM-based agent teams. We formalize the assignment challenge as a multi-objective optimization problem, aiming to identify the Pareto front of configurations between task accuracy and inference cost. The methodology employs multi-objective Bayesian Optimization (MOBO) with independent Gaussian Process surrogate models. By searching over a continuous feature-space representation of the LLMs, this approach performs a sample-efficient exploration guided by the expected hypervolume improvement. The primary contribution is a principled and automated methodology that yields a Pareto front of optimal team configurations. Our results demonstrate that the Bayesian optimization phase, compared to an initial random search, maintained a comparable average performance while reducing the average configuration cost by over 45%. Furthermore, MALBO identified specialized, heterogeneous teams that achieve cost reductions of up to 65.8% compared to homogeneous baselines, all while maintaining maximum performance. The framework thus provides a data-driven tool for deploying cost-effective and highly specialized multi-agent AI systems.