MOON Embedding: Multimodal Representation Learning for E-commerce Search Advertising

作者: Chenghan Fu, Daoze Zhang, Yukang Lin, Zhanheng Nie, Xiang Zhang, Jianyu Liu, Yueran Liu, Wanxian Guan, Pengjie Wang, Jian Xu, Bo Zheng

分类: cs.IR, cs.AI, cs.CV, cs.LG

发布日期: 2025-11-14 (更新: 2025-11-18)

备注: 31 pages, 12 figures

💡 一句话要点

MOON:用于电商搜索广告的多模态表征学习框架,CTR提升显著

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态表征学习 电商搜索广告 点击率预测 三阶段训练 汇率 图像搜索召回 缩放规律 对比学习

📋 核心要点

- 电商搜索广告中,如何有效融合多模态信息以提升用户点击率是一个关键挑战。

- MOON框架通过三阶段训练范式,有效整合多模态表征,并利用“汇率”概念对中间指标进行优化。

- MOON在淘宝搜索广告系统中全面部署,在CTR预测任务上实现了显著的+20.00%的在线CTR提升。

📝 摘要(中文)

本文介绍了MOON,一套用于电商应用中多模态表征学习的可持续迭代实践方案。MOON已全面部署于淘宝搜索广告系统的各个阶段,包括检索、相关性、排序等。在点击率(CTR)预测任务上,性能提升尤为显著,实现了整体+20.00%的在线CTR提升。在过去的三年里,该项目在CTR预测任务上取得了最大的改进,并经历了五次全面迭代。通过MOON的探索和迭代,我们积累了宝贵的见解和实践经验,相信这将有益于研究界。MOON包含一个“预训练、后训练和应用”的三阶段训练范式,能够有效地将多模态表征与下游任务集成。值得注意的是,为了弥合多模态表征学习和下游训练目标之间的不一致,我们定义了汇率来量化中间指标的改进能够有效地转化为下游收益。通过这种分析,我们将基于图像的搜索召回率确定为指导多模态模型优化的关键中间指标。在三年和五次迭代中,MOON沿着数据处理、训练策略、模型架构和下游应用四个关键维度发展。还将分享通过迭代改进获得的经验教训和见解。作为我们对电子商务领域规模效应探索的一部分,我们进一步对控制多模态表征学习的缩放规律进行了系统研究,考察了训练token的数量、负样本和用户行为序列的长度等多个因素。

🔬 方法详解

问题定义:论文旨在解决电商搜索广告中,如何有效利用多模态信息(例如商品图像、文本描述、用户行为等)来提升点击率(CTR)预测的准确性。现有方法可能无法充分融合不同模态的信息,或者在多模态表征学习的目标与下游CTR预测任务的目标之间存在偏差,导致性能提升受限。

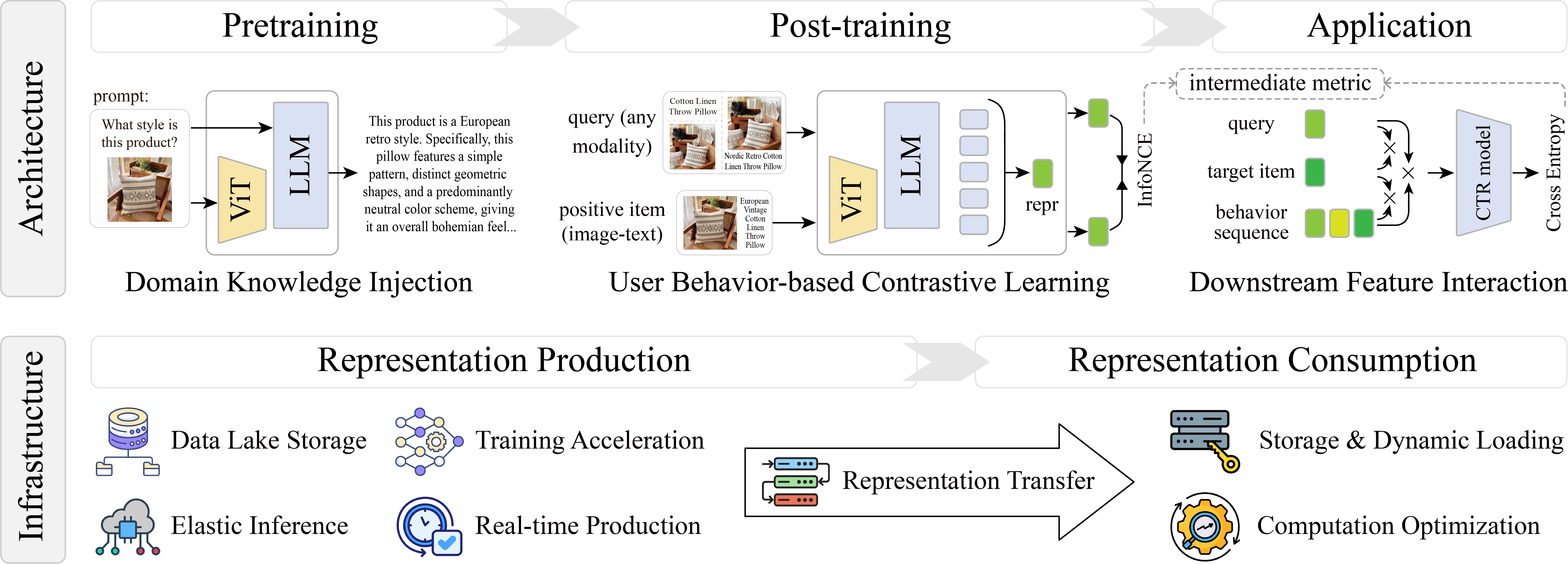

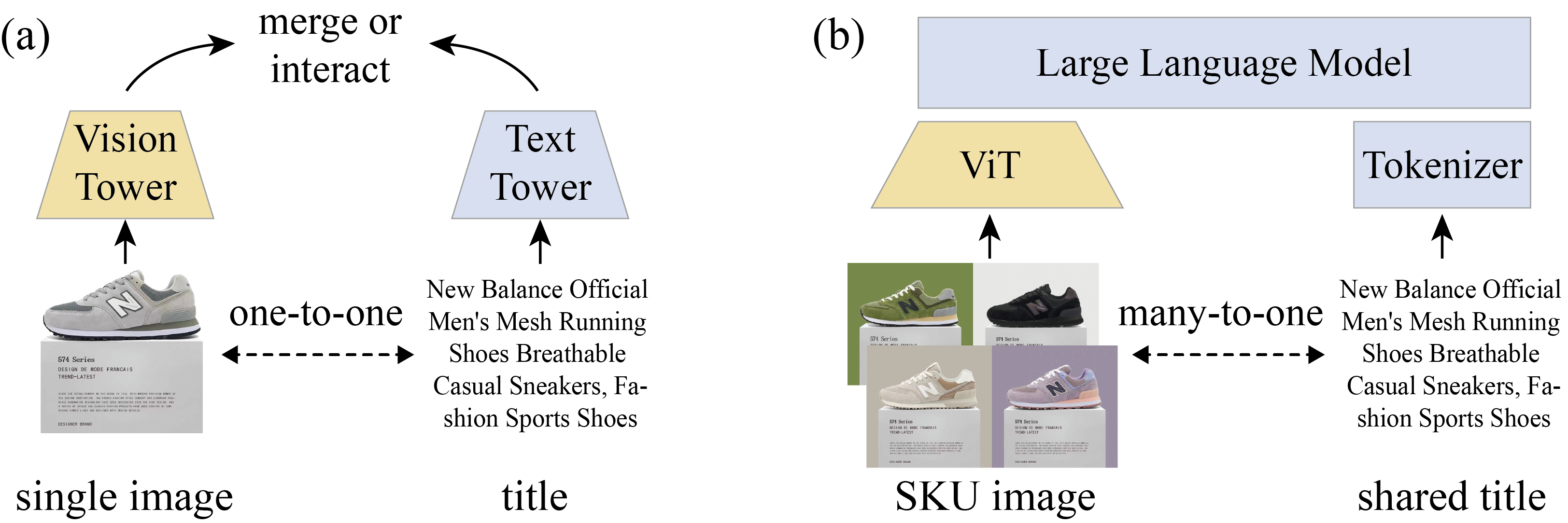

核心思路:MOON的核心思路是采用一个三阶段的训练范式,包括预训练、后训练和应用,从而有效地将多模态表征与下游任务集成。此外,论文还提出了“汇率”的概念,用于量化中间指标(例如图像搜索召回率)的改进对下游CTR预测任务的收益转化,从而指导多模态模型的优化。

技术框架:MOON的整体框架包含三个主要阶段:1) 预训练:利用大规模无监督数据学习通用的多模态表征;2) 后训练:利用与下游任务相关的有监督数据对预训练模型进行微调,优化中间指标;3) 应用:将训练好的多模态表征应用于下游CTR预测任务。框架的关键在于通过“汇率”分析,确定对下游任务影响最大的中间指标,并重点优化这些指标。

关键创新:MOON的关键创新在于提出了“汇率”的概念,用于桥接多模态表征学习和下游任务之间的目标不一致性。通过量化中间指标的改进对下游收益的转化,可以更有效地指导多模态模型的优化方向。此外,三阶段训练范式也为多模态表征学习提供了一种有效的实践方法。

关键设计:论文中提到,通过实验发现图像搜索召回率是一个关键的中间指标。因此,在后训练阶段,可能会采用对比学习等方法,优化图像表征的质量,从而提升图像搜索召回率。具体的损失函数、网络结构等细节可能根据实际情况进行调整。此外,论文还研究了训练token数量、负样本数量和用户行为序列长度等因素对模型性能的影响,为模型设计提供了指导。

🖼️ 关键图片

📊 实验亮点

MOON框架在淘宝搜索广告系统中全面部署,并在CTR预测任务上取得了显著的+20.00%的在线CTR提升。这一结果表明,MOON框架能够有效地融合多模态信息,并提升下游任务的性能。此外,论文还对多模态表征学习的缩放规律进行了系统研究,为模型设计提供了重要的参考。

🎯 应用场景

MOON框架可广泛应用于电商搜索广告、推荐系统等领域,通过有效融合多模态信息,提升用户点击率、转化率等关键指标。该研究的实践经验和方法论,对多模态表征学习在工业界的应用具有重要的指导意义,并有望推动相关技术的发展。

📄 摘要(原文)

We introduce MOON, our comprehensive set of sustainable iterative practices for multimodal representation learning for e-commerce applications. MOON has already been fully deployed across all stages of Taobao search advertising system, including retrieval, relevance, ranking, and so on. The performance gains are particularly significant on click-through rate (CTR) prediction task, which achieves an overall +20.00% online CTR improvement. Over the past three years, this project has delivered the largest improvement on CTR prediction task and undergone five full-scale iterations. Throughout the exploration and iteration of our MOON, we have accumulated valuable insights and practical experience that we believe will benefit the research community. MOON contains a three-stage training paradigm of "Pretraining, Post-training, and Application", allowing effective integration of multimodal representations with downstream tasks. Notably, to bridge the misalignment between the objectives of multimodal representation learning and downstream training, we define the exchange rate to quantify how effectively improvements in an intermediate metric can translate into downstream gains. Through this analysis, we identify the image-based search recall as a critical intermediate metric guiding the optimization of multimodal models. Over three years and five iterations, MOON has evolved along four critical dimensions: data processing, training strategy, model architecture, and downstream application. The lessons and insights gained through the iterative improvements will also be shared. As part of our exploration into scaling effects in the e-commerce field, we further conduct a systematic study of the scaling laws governing multimodal representation learning, examining multiple factors such as the number of training tokens, negative samples, and the length of user behavior sequences.