Advancing Cognitive Science with LLMs

作者: Dirk U. Wulff, Rui Mata

分类: cs.AI, cs.CL

发布日期: 2025-10-31

💡 一句话要点

利用大型语言模型(LLMs)促进认知科学的知识整合与理论形式化

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 认知科学 知识整合 理论形式化 跨学科研究 人工智能 自然语言处理

📋 核心要点

- 认知科学面临知识整合和概念清晰的挑战,现有方法难以有效连接跨学科知识和形式化理论。

- 论文提出利用大型语言模型(LLMs)辅助认知科学研究,促进跨学科联系、理论形式化和模型泛化。

- 论文分析了LLMs在认知科学领域的应用潜力与局限性,强调其作为辅助工具而非替代人类专家的作用。

📝 摘要(中文)

认知科学在知识综合和概念清晰性方面面临持续的挑战,部分原因是其多方面和跨学科的性质。人工智能的最新进展,特别是大型语言模型(LLMs)的开发,为解决这些问题提供了工具。本文探讨了LLMs如何支持该领域长期以来难以解决的领域,包括建立跨学科联系、形式化理论、开发清晰的测量分类、通过集成建模框架实现泛化,以及捕捉情境和个体差异。我们概述了LLMs在这些领域中的当前能力和局限性,包括潜在的陷阱。总而言之,我们得出结论,当LLMs被明智地使用以补充而非取代人类专业知识时,它们可以作为一种工具,促进更具综合性和累积性的认知科学。

🔬 方法详解

问题定义:认知科学由于其固有的跨学科性和复杂性,在知识整合、理论形式化、建立清晰的测量体系以及实现模型泛化等方面面临诸多挑战。现有方法往往难以有效地连接不同学科的知识,无法充分捕捉情境和个体差异,导致研究结果的通用性和可重复性受到限制。

核心思路:本文的核心思路是利用大型语言模型(LLMs)强大的自然语言处理能力和知识表示能力,辅助认知科学家解决上述问题。LLMs能够从海量文本数据中学习并提取知识,从而帮助建立跨学科联系,形式化认知理论,并构建更具泛化能力的模型。

技术框架:本文并非提出一个全新的技术框架,而是探讨如何将现有的LLMs应用于认知科学研究的各个方面。其主要思路是利用LLMs的以下能力:1) 知识检索和推理,用于建立跨学科联系;2) 文本生成和摘要,用于形式化认知理论;3) 语义理解和分类,用于开发清晰的测量分类;4) 模型集成和泛化,用于构建更具通用性的认知模型。

关键创新:本文的创新之处在于将LLMs视为一种辅助工具,用于解决认知科学领域长期存在的挑战。它并非试图用LLMs完全取代人类专家,而是强调LLMs在知识整合、理论形式化和模型泛化等方面的辅助作用。这种以人为本的LLM应用视角是本文的关键创新。

关键设计:本文并没有涉及具体的参数设置、损失函数或网络结构等技术细节,而是侧重于对LLMs在认知科学领域的应用潜力进行分析和展望。文章强调了在使用LLMs时需要注意的潜在风险,例如模型偏差和过度依赖等,并建议将LLMs与人类专业知识相结合,以实现更可靠和有效的认知科学研究。

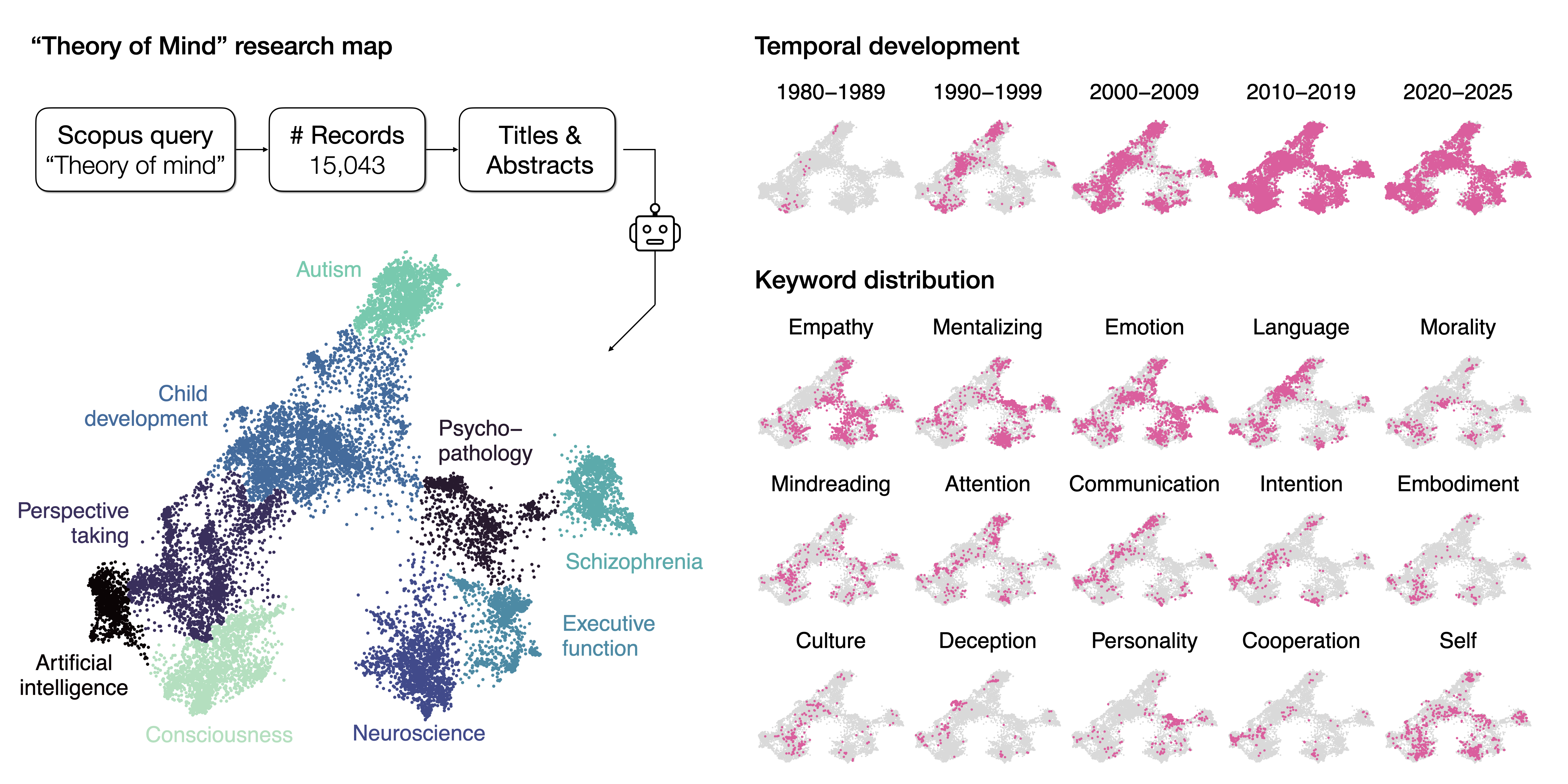

🖼️ 关键图片

📊 实验亮点

论文重点在于对LLMs在认知科学领域的潜在应用进行分析和展望,而非提供具体的实验结果。文章强调了LLMs在知识整合、理论形式化和模型泛化等方面的潜力,并指出了在使用LLMs时需要注意的潜在风险。虽然没有提供具体的性能数据,但该研究为认知科学研究人员提供了一个新的视角和工具,有望促进该领域的创新发展。

🎯 应用场景

该研究成果可应用于认知科学的多个领域,例如:辅助研究人员进行文献综述和知识整合,加速理论模型的构建和验证,提高实验设计的效率和可靠性,以及开发更个性化的认知干预方案。未来,结合LLMs的认知科学研究有望推动人工智能和认知科学的交叉融合,促进更智能、更人性化的技术发展。

📄 摘要(原文)

Cognitive science faces ongoing challenges in knowledge synthesis and conceptual clarity, in part due to its multifaceted and interdisciplinary nature. Recent advances in artificial intelligence, particularly the development of large language models (LLMs), offer tools that may help to address these issues. This review examines how LLMs can support areas where the field has historically struggled, including establishing cross-disciplinary connections, formalizing theories, developing clear measurement taxonomies, achieving generalizability through integrated modeling frameworks, and capturing contextual and individual variation. We outline the current capabilities and limitations of LLMs in these domains, including potential pitfalls. Taken together, we conclude that LLMs can serve as tools for a more integrative and cumulative cognitive science when used judiciously to complement, rather than replace, human expertise.