VeriMoA: A Mixture-of-Agents Framework for Spec-to-HDL Generation

作者: Heng Ping, Arijit Bhattacharjee, Peiyu Zhang, Shixuan Li, Wei Yang, Anzhe Cheng, Xiaole Zhang, Jesse Thomason, Ali Jannesari, Nesreen Ahmed, Paul Bogdan

分类: cs.AI

发布日期: 2025-10-31

💡 一句话要点

提出VeriMoA框架以解决HDL生成中的噪声传播与推理空间限制问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 硬件描述语言 寄存器传输级 大型语言模型 多代理架构 自动化设计 生成模型 知识积累 性能提升

📋 核心要点

- 现有方法在HDL生成中面临噪声传播和推理空间受限的问题,影响生成质量和效率。

- VeriMoA框架通过质量引导缓存和多路径生成策略,优化了HDL生成过程,提升了知识积累和解决方案多样性。

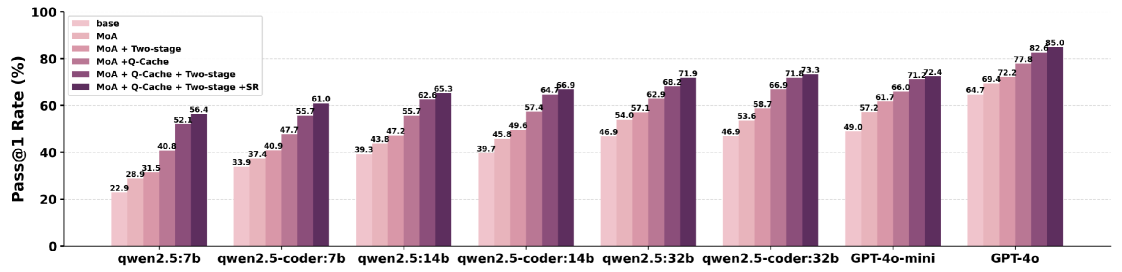

- 在VerilogEval 2.0和RTLLM 2.0基准测试中,VeriMoA实现了15-30%的性能提升,尤其在小模型上表现突出。

📝 摘要(中文)

自动化寄存器传输级(RTL)设计有助于开发者应对日益增长的计算需求。大型语言模型(LLMs)在硬件描述语言(HDL)生成中展现出潜力,但由于参数知识有限和领域特定约束面临挑战。现有的多代理架构虽然提供了无训练的协作生成方式,但存在噪声传播和推理空间受限的缺陷。本文提出VeriMoA,一个无训练的混合代理框架,包含质量引导缓存机制和多路径生成策略,显著提高了生成过程的质量和多样性。实验结果表明,VeriMoA在VerilogEval 2.0和RTLLM 2.0基准测试中实现了15-30%的Pass@1提升,尤其使得小模型能够与大模型和微调替代品相媲美,而无需昂贵的训练。

🔬 方法详解

问题定义:本文旨在解决在HDL生成过程中,现有多代理方法面临的噪声传播和推理空间受限的问题。这些问题导致生成的HDL质量不稳定,影响设计效率。

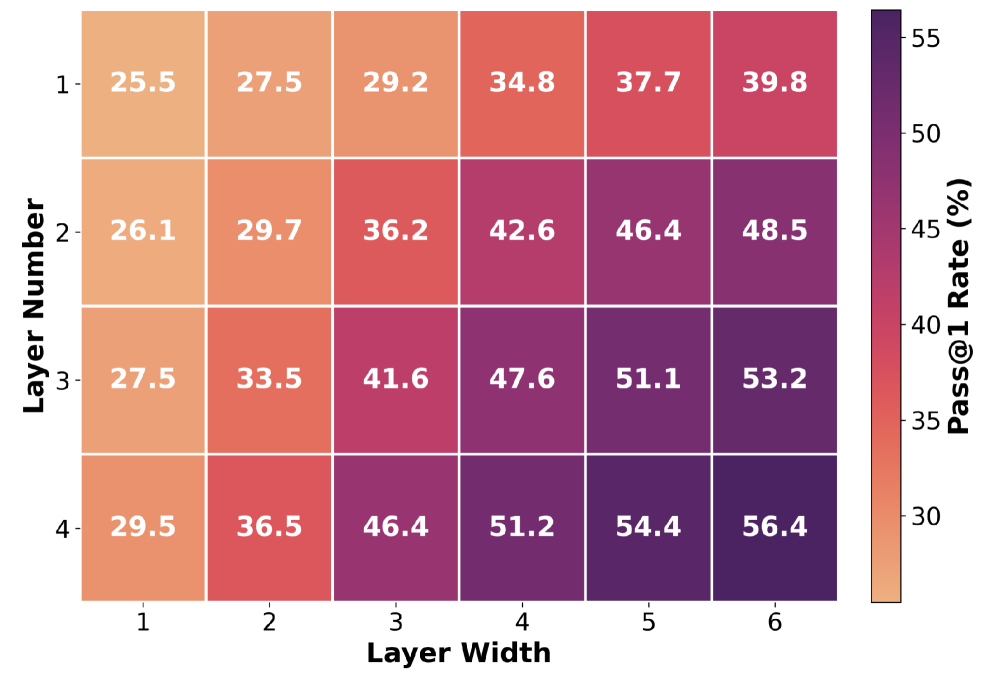

核心思路:VeriMoA框架的核心思路是通过引入质量引导缓存机制和多路径生成策略,提升生成过程中的知识积累和多样性,从而提高生成质量。

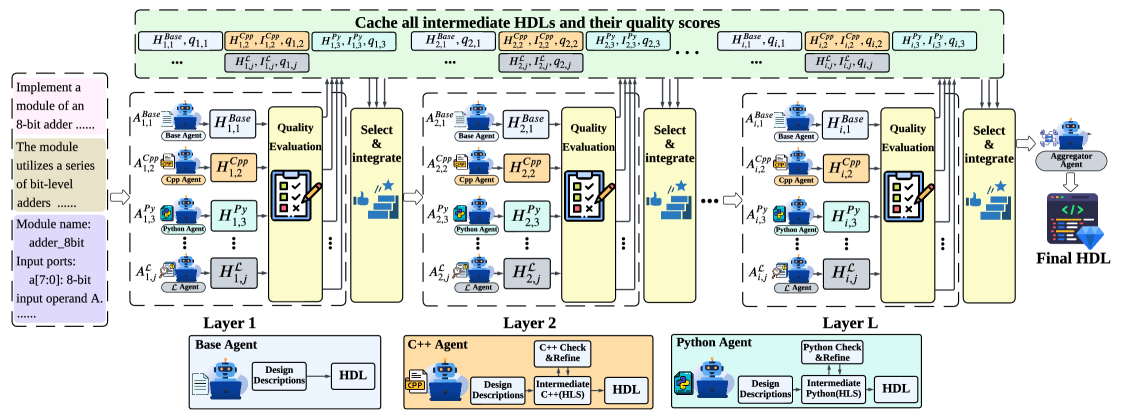

技术框架:VeriMoA的整体架构包括两个主要模块:质量引导缓存机制用于维护中间HDL输出并进行质量排名,和多路径生成策略通过C++和Python作为中间表示,分解规格到HDL的转换过程。

关键创新:VeriMoA的关键创新在于其无训练的混合代理架构,能够有效避免噪声传播,同时通过多路径生成策略促进了解决方案的多样性。这与现有方法的训练依赖性形成鲜明对比。

关键设计:在设计中,质量引导缓存机制确保所有中间输出被记录并进行质量评估,而多路径生成策略则利用高资源语言的流利性,优化了生成过程的效率和效果。

🖼️ 关键图片

📊 实验亮点

在VerilogEval 2.0和RTLLM 2.0基准测试中,VeriMoA实现了15-30%的Pass@1提升,尤其使得小模型在性能上能够与大模型和微调版本相媲美,展示了其在HDL生成中的有效性和优势。

🎯 应用场景

VeriMoA框架在硬件设计自动化领域具有广泛的应用潜力,能够帮助开发者更高效地生成高质量的HDL代码,满足复杂计算需求。未来,该框架还可能扩展到其他需要自动化生成代码的领域,如软件开发和系统设计,推动智能设计工具的发展。

📄 摘要(原文)

Automation of Register Transfer Level (RTL) design can help developers meet increasing computational demands. Large Language Models (LLMs) show promise for Hardware Description Language (HDL) generation, but face challenges due to limited parametric knowledge and domain-specific constraints. While prompt engineering and fine-tuning have limitations in knowledge coverage and training costs, multi-agent architectures offer a training-free paradigm to enhance reasoning through collaborative generation. However, current multi-agent approaches suffer from two critical deficiencies: susceptibility to noise propagation and constrained reasoning space exploration. We propose VeriMoA, a training-free mixture-of-agents (MoA) framework with two synergistic innovations. First, a quality-guided caching mechanism to maintain all intermediate HDL outputs and enables quality-based ranking and selection across the entire generation process, encouraging knowledge accumulation over layers of reasoning. Second, a multi-path generation strategy that leverages C++ and Python as intermediate representations, decomposing specification-to-HDL translation into two-stage processes that exploit LLM fluency in high-resource languages while promoting solution diversity. Comprehensive experiments on VerilogEval 2.0 and RTLLM 2.0 benchmarks demonstrate that VeriMoA achieves 15--30% improvements in Pass@1 across diverse LLM backbones, especially enabling smaller models to match larger models and fine-tuned alternatives without requiring costly training.