Closing the Expression Gap in LLM Instructions via Socratic Questioning

作者: Jianwen Sun, Yukang Feng, Yifan Chang, Chuanhao Li, Zizhen Li, Jiaxin Ai, Fanrui Zhang, Yu Dai, Kaipeng Zhang

分类: cs.AI

发布日期: 2025-10-31 (更新: 2026-01-30)

💡 一句话要点

提出Nous,通过苏格拉底式提问弥合LLM指令中的表达鸿沟

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 意图表达 苏格拉底式提问 信息增益 大型语言模型

📋 核心要点

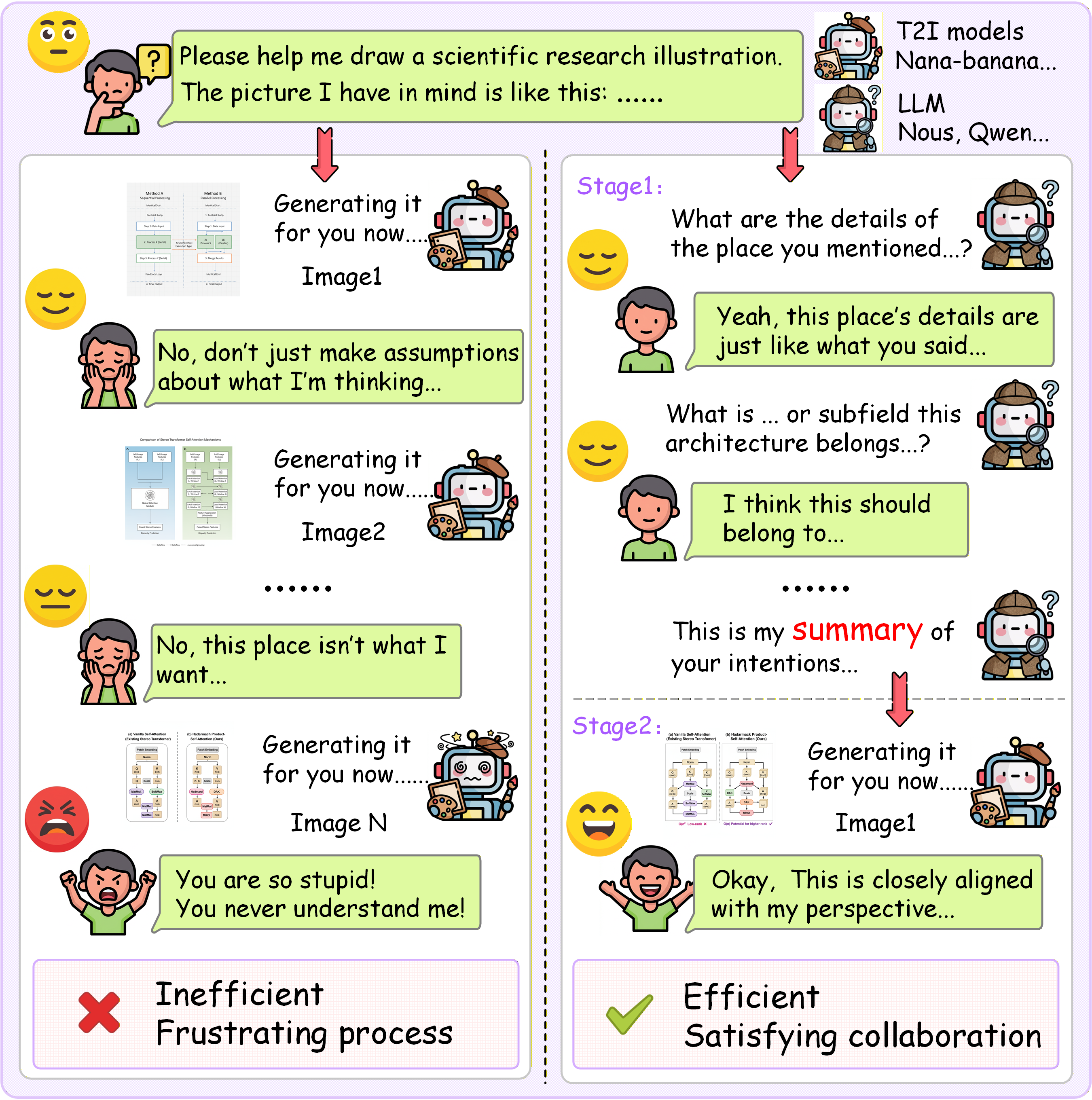

- 现有方法难以让用户有效地向AI传达复杂意图,导致人机协作效率低下,尤其是在用户专业知识水平参差不齐的情况下。

- 论文提出Nous,一个基于苏格拉底式提问的智能体,通过主动探究用户意图来弥合表达鸿沟,提升人机协作效率。

- 实验表明,Nous在科学图表生成任务上实现了领先的效率和输出质量,并且对不同专业水平的用户具有鲁棒性。

📝 摘要(中文)

人机协作的一个根本瓶颈是“意图表达鸿沟”,即人类难以有效地向AI传达复杂、高维的想法。这个问题常常让用户陷入低效的试错循环,并且会因用户专业知识水平的差异而加剧。本文将此问题从被动指令遵循重新定义为苏格拉底式协作范式,提出了一种主动探测信息以解决其对用户意图不确定性的智能体,命名为Nous,并训练其掌握这种探究策略。Nous的核心机制是一个基于信息论第一性原理的训练框架。在该框架内,我们将对话中的信息增益定义为内在奖励信号,它从根本上等同于结构化任务空间上香农熵的减少。这种奖励设计使我们能够避免依赖昂贵的人工偏好标注或外部奖励模型。为了验证我们的框架,我们开发了一个自动模拟流程,以生成用于科学图表生成这一具有挑战性任务的大规模、基于偏好的数据集。全面的实验,包括消融研究、主观和客观评估以及跨用户专业知识水平的测试,证明了我们提出的框架的有效性。Nous实现了领先的效率和输出质量,同时对不同的用户专业知识保持鲁棒性。总之,我们的研究为解决复杂人机协作中模糊意图的问题提供了一种系统的方法和新的视角。

🔬 方法详解

问题定义:论文旨在解决人机交互中由于用户意图表达不清晰,导致大型语言模型(LLM)难以准确理解用户需求的问题。现有方法通常依赖于用户提供详尽的指令,但用户往往难以一次性表达完整意图,导致需要多次迭代和试错,效率低下。尤其是在复杂任务中,用户可能缺乏相关领域的专业知识,更难以清晰表达需求。

核心思路:论文的核心思路是将LLM从被动的指令执行者转变为主动的意图探究者。通过让LLM主动提问,引导用户逐步完善指令,从而更准确地理解用户意图。这种“苏格拉底式提问”的方式,能够有效地弥合用户意图与LLM理解之间的差距。

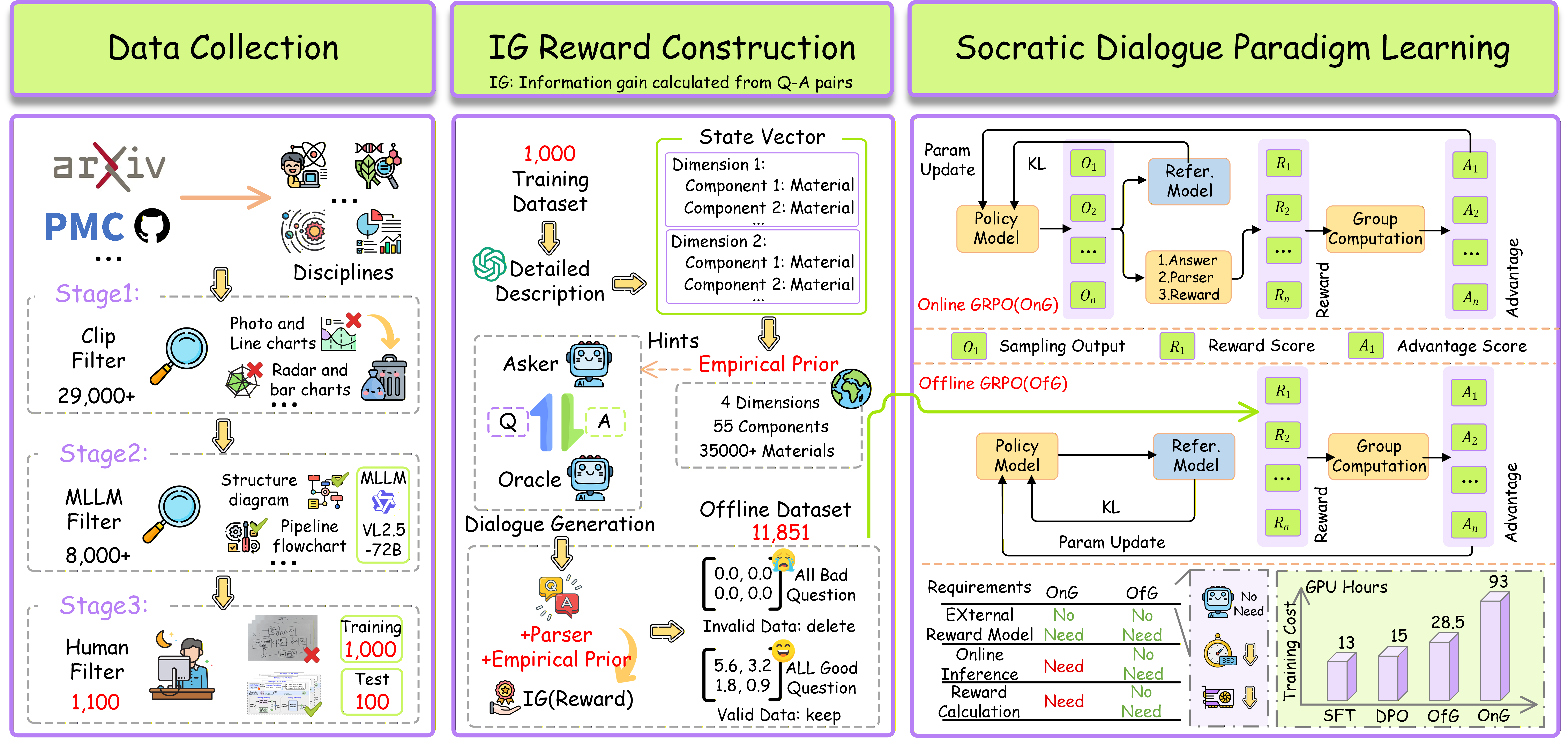

技术框架:论文提出的Nous智能体采用基于信息论的训练框架。整体流程如下:1) 用户提供初始指令;2) Nous根据当前指令和任务空间,选择信息增益最大的问题进行提问;3) 用户回答问题,提供更详细的指令;4) Nous根据更新后的指令生成输出;5) 循环2-4步,直到满足停止条件。该框架的核心是信息增益的计算和问题选择策略。

关键创新:论文的关键创新在于将信息论中的香农熵与人机交互中的意图表达联系起来。通过将对话中的信息增益定义为内在奖励信号,并将其等同于结构化任务空间上香农熵的减少,从而避免了对昂贵的人工标注或外部奖励模型的依赖。这种基于信息论的奖励设计,能够有效地引导Nous学习提问策略,从而更准确地理解用户意图。

关键设计:论文的关键设计包括:1) 使用自动模拟流程生成大规模、基于偏好的数据集,用于训练Nous;2) 定义信息增益的计算方式,即提问后任务空间不确定性的减少量;3) 设计问题选择策略,选择信息增益最大的问题进行提问;4) 采用合适的LLM作为Nous的基础模型,并进行微调,使其具备提问和回答问题的能力。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Nous在科学图表生成任务上取得了显著的性能提升。与基线方法相比,Nous能够以更少的迭代次数生成更高质量的图表。主观评估结果显示,用户更倾向于选择由Nous生成的图表。此外,Nous对不同专业水平的用户都表现出良好的鲁棒性,证明了其在实际应用中的潜力。

🎯 应用场景

该研究成果可广泛应用于各种人机协作场景,例如:科学研究、软件开发、艺术创作等。通过让AI主动探究用户意图,可以显著提高人机协作效率,降低用户的使用门槛,并促进AI在各个领域的应用。未来,该技术有望应用于智能助手、自动化设计工具等领域,实现更自然、高效的人机交互。

📄 摘要(原文)

A fundamental bottleneck in human-AI collaboration is the ``intention expression gap," the difficulty for humans to effectively convey complex, high-dimensional thoughts to AI. This challenge often traps users in inefficient trial-and-error loops and is exacerbated by the diverse expertise levels of users. We reframe this problem from passive instruction following to a Socratic collaboration paradigm, proposing an agent that actively probes for information to resolve its uncertainty about user intent. we name the proposed agent Nous, trained to acquire proficiency in this inquiry policy. The core mechanism of Nous is a training framework grounded in the first principles of information theory. Within this framework, we define the information gain from dialogue as an intrinsic reward signal, which is fundamentally equivalent to the reduction of Shannon entropy over a structured task space. This reward design enables us to avoid reliance on costly human preference annotations or external reward models. To validate our framework, we develop an automated simulation pipeline to generate a large-scale, preference-based dataset for the challenging task of scientific diagram generation. Comprehensive experiments, including ablations, subjective and objective evaluations, and tests across user expertise levels, demonstrate the effectiveness of our proposed framework. Nous achieves leading efficiency and output quality, while remaining robust to varying user expertise. In conclusion, our research provides a systematic methodology and a new perspective for addressing the issue of ambiguous intentions in complex human-machine collaboration.