Vintage Code, Modern Judges: Meta-Validation in Low Data Regimes

作者: Ora Nova Fandina, Gal Amram, Eitan Farchi, Shmulik Froimovich, Raviv Gal, Wesam Ibraheem, Rami Katan, Alice Podolsky, Orna Raz

分类: cs.SE, cs.AI

发布日期: 2025-10-31

💡 一句话要点

提出SparseAlign框架,解决低数据环境下LaaJ的元验证问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 代码现代化 低资源学习 元验证 人工评估 COBOL LaaJ 对齐评估

📋 核心要点

- 传统代码现代化面临专家和高质量标注数据匮乏的挑战,LaaJ的可靠性验证至关重要。

- SparseAlign框架通过成对置信度和分数敏感对齐度量,有效评估LaaJ与稀疏人工标注数据的对齐程度。

- SparseAlign应用于COBOL代码解释的LaaJ选择,指导模型发布,并在案例研究中验证了其有效性。

📝 摘要(中文)

在COBOL、PL/I和REXX等传统语言的应用现代化过程中,专家资源和高质量人工评估数据严重短缺。虽然大型语言模型作为评判者(LaaJ)提供了一种可扩展的替代方案,但在高风险工作流程中信任它们之前,必须验证其可靠性。缺乏原则性验证会导致循环评估,未经验证的LaaJ被用于评估模型输出,从而可能强化不可靠的判断并损害下游部署决策。本文提出了SparseAlign,一个用于评估LaaJ与稀疏人工标注数据对齐情况的正式框架。SparseAlign结合了一种新颖的成对置信度概念和一种分数敏感的对齐度量,共同捕捉排序一致性和分数接近度,即使在传统统计方法因标注示例有限而失效时,也能实现可靠的评估器选择。SparseAlign已在内部应用于选择用于COBOL代码解释的LaaJ,并将对齐度最高的评估器集成到评估工作流程中,指导模型发布决策。本文展示了一个包含四个LaaJ的案例研究,以证明SparseAlign在实际评估场景中的效用。

🔬 方法详解

问题定义:论文旨在解决在低数据环境下,如何有效验证大型语言模型作为评判者(LaaJ)的可靠性问题。现有方法在人工标注数据稀缺时,难以准确评估LaaJ与人类判断的对齐程度,导致无法信任LaaJ的评估结果,进而影响模型部署决策。传统统计方法在数据量不足时表现不佳,无法提供可靠的验证结果。

核心思路:论文的核心思路是利用成对比较和置信度评估,即使在数据稀疏的情况下,也能有效衡量LaaJ与人类判断的对齐程度。通过关注排序一致性和分数接近度,SparseAlign能够更准确地捕捉LaaJ的评估质量,从而选择出与人类判断最一致的LaaJ。这种方法避免了直接依赖绝对分数,而是关注相对排序和分数差异,从而降低了对数据量的需求。

技术框架:SparseAlign框架主要包含以下几个阶段:1) 数据准备:收集稀疏的人工标注数据,包括代码片段和人类专家给出的评估分数。2) LaaJ评估:使用多个LaaJ对相同的代码片段进行评估,得到各自的评估分数。3) 成对比较:对每个代码片段,比较不同LaaJ给出的分数,形成成对比较结果。4) 置信度评估:计算每个成对比较结果的置信度,反映LaaJ对该比较结果的确定程度。5) 对齐度量:使用分数敏感的对齐度量,综合考虑排序一致性和分数接近度,计算每个LaaJ与人类判断的对齐程度。6) LaaJ选择:选择对齐程度最高的LaaJ,用于后续的模型评估和部署决策。

关键创新:SparseAlign的关键创新在于:1) 成对置信度概念:通过评估LaaJ在成对比较中的置信度,更准确地反映其判断质量。2) 分数敏感的对齐度量:综合考虑排序一致性和分数接近度,更全面地衡量LaaJ与人类判断的对齐程度。3) 低数据适用性:即使在人工标注数据稀疏的情况下,也能有效评估LaaJ的可靠性。与现有方法相比,SparseAlign不需要大量的人工标注数据,就能实现可靠的LaaJ选择。

关键设计:论文中关键的设计包括:1) 成对置信度的计算方法:具体如何量化LaaJ对成对比较结果的确定程度,可能涉及到概率模型或置信区间的计算。2) 分数敏感的对齐度量的具体形式:如何将排序一致性和分数接近度进行有效结合,可能涉及到加权平均或更复杂的函数形式。3) LaaJ选择策略:如何根据对齐度量选择最佳的LaaJ,可能涉及到阈值设定或排序算法。

🖼️ 关键图片

📊 实验亮点

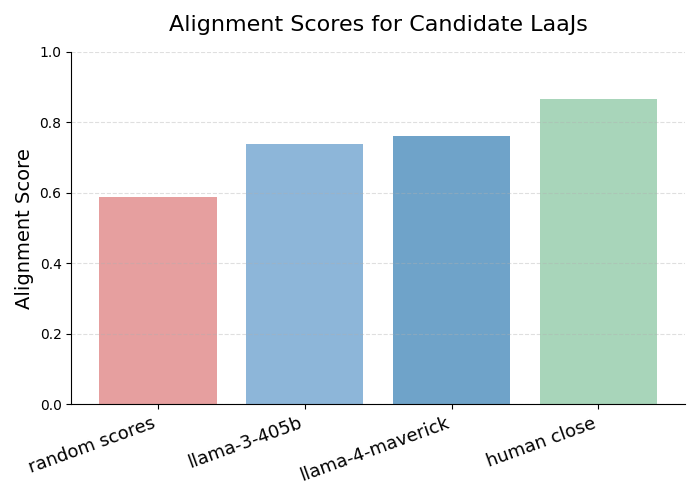

SparseAlign在COBOL代码解释的LaaJ选择中表现出色,能够有效识别与人类判断对齐度最高的LaaJ。案例研究表明,使用SparseAlign选择的LaaJ能够更准确地评估模型输出,指导模型发布决策。虽然论文中没有给出具体的性能数据和提升幅度,但强调了SparseAlign在实际评估场景中的有效性。

🎯 应用场景

该研究成果可广泛应用于代码现代化、软件质量评估、自然语言处理等领域。尤其是在缺乏专家资源和高质量标注数据的场景下,SparseAlign能够帮助企业更有效地利用大型语言模型进行自动化评估,降低成本,提高效率,加速应用现代化进程。未来,该方法有望推广到其他低资源场景,例如罕见疾病诊断、小语种翻译等。

📄 摘要(原文)

Application modernization in legacy languages such as COBOL, PL/I, and REXX faces an acute shortage of resources, both in expert availability and in high-quality human evaluation data. While Large Language Models as a Judge (LaaJ) offer a scalable alternative to expert review, their reliability must be validated before being trusted in high-stakes workflows. Without principled validation, organizations risk a circular evaluation loop, where unverified LaaJs are used to assess model outputs, potentially reinforcing unreliable judgments and compromising downstream deployment decisions. Although various automated approaches to validating LaaJs have been proposed, alignment with human judgment remains a widely used and conceptually grounded validation strategy. In many real-world domains, the availability of human-labeled evaluation data is severely limited, making it difficult to assess how well a LaaJ aligns with human judgment. We introduce SparseAlign, a formal framework for assessing LaaJ alignment with sparse human-labeled data. SparseAlign combines a novel pairwise-confidence concept with a score-sensitive alignment metric that jointly capture ranking consistency and score proximity, enabling reliable evaluator selection even when traditional statistical methods are ineffective due to limited annotated examples. SparseAlign was applied internally to select LaaJs for COBOL code explanation. The top-aligned evaluators were integrated into assessment workflows, guiding model release decisions. We present a case study of four LaaJs to demonstrate SparseAlign's utility in real-world evaluation scenarios.