Scales++: Compute Efficient Evaluation Subset Selection with Cognitive Scales Embeddings

作者: Andrew M. Bean, Nabeel Seedat, Shengzhuang Chen, Jonathan Richard Schwarz

分类: cs.AI, cs.LG

发布日期: 2025-10-30

备注: 9 pages, 2 figures, 4 tables

💡 一句话要点

Scales++:利用认知尺度嵌入实现计算高效的评估子集选择

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大规模语言模型 基准测试 子集选择 认知尺度 高效评估

📋 核心要点

- 现有LLM评估方法依赖模型性能选择数据子集,成本高且无法处理新基准,假设未来模型与现有模型有相似失败模式。

- Scales++提出以项目为中心的方法,基于基准样本的认知需求选择数据子集,降低前期成本并提升冷启动性能。

- 实验表明,Scales++在降低18倍以上选择成本的同时,保持了竞争力的预测准确性,并在Open LLM排行榜上取得了良好效果。

📝 摘要(中文)

在大规模语言模型(LLM)的综合基准测试中,评估成本高昂,因此需要创建小而具有代表性的数据子集(即微型基准),以便在保持预测准确性的同时实现高效评估。目前的方法采用以模型为中心的范式,根据现有模型的集体性能选择基准测试项目。这种方法受到前期成本高昂、无法立即处理新基准(“冷启动”)以及未来模型将与其前辈共享失败模式这一脆弱假设的限制。本文挑战了这种范式,提出了一种以项目为中心的基准子集选择方法,认为选择应基于任务项目本身的内在属性,而不是基于模型特定的失败模式。我们通过一种名为Scales++的新方法来实例化这种以项目为中心的高效基准测试方法,其中数据选择基于基准样本的认知需求。实验表明,Scales++将前期选择成本降低了18倍以上,同时实现了具有竞争力的预测准确性。在Open LLM排行榜上,仅使用0.5%的数据子集,我们就能以2.9%的平均绝对误差预测完整基准分数。我们证明了这种以项目为中心的方法能够实现更高效的模型评估,而不会显著降低准确性,同时还提供更好的冷启动性能和更易于解释的基准测试。

🔬 方法详解

问题定义:论文旨在解决大规模语言模型(LLM)评估中,由于全面基准测试成本过高而难以高效评估的问题。现有方法主要依赖于已训练模型的性能来选择具有代表性的数据子集,这种“以模型为中心”的方法存在三个主要痛点:一是前期需要大量模型进行评估,成本高昂;二是无法直接应用于新的基准测试(冷启动问题);三是假设未来的模型会与现有模型具有相似的失败模式,这在快速发展的LLM领域并不总是成立。

核心思路:论文的核心思路是将数据子集的选择从“以模型为中心”转变为“以项目为中心”。这意味着选择基准测试数据子集不应依赖于模型的性能,而是应该基于任务项目本身的内在属性,例如任务的认知难度。通过关注任务本身的特性,可以避免对现有模型的依赖,从而降低前期成本,提高冷启动性能,并使基准测试更具通用性和可解释性。

技术框架:Scales++方法的核心在于使用认知尺度嵌入来表示基准测试样本的认知需求。整体流程如下:1. 对基准测试集中的每个样本,提取其认知尺度特征,例如词汇复杂性、句法结构复杂度等。2. 将这些特征嵌入到一个高维空间中,形成每个样本的认知尺度嵌入向量。3. 使用聚类算法(例如k-means)对这些嵌入向量进行聚类,将基准测试集划分为若干个具有相似认知需求的簇。4. 从每个簇中选择具有代表性的样本,组成最终的评估子集。

关键创新:Scales++最重要的技术创新在于其“以项目为中心”的视角和使用认知尺度嵌入来表示任务难度。与传统的“以模型为中心”的方法相比,Scales++避免了对现有模型的依赖,从而降低了前期成本,提高了冷启动性能,并使基准测试更具通用性和可解释性。此外,使用认知尺度嵌入能够更准确地捕捉任务的内在难度,从而选择更具代表性的评估子集。

关键设计:Scales++的关键设计包括:1. 认知尺度特征的选择:选择哪些认知尺度特征对于准确表示任务难度至关重要。论文可能使用了多种自然语言处理技术来提取这些特征。2. 嵌入空间的维度:嵌入空间的维度会影响认知尺度嵌入的表达能力。需要选择合适的维度以平衡表达能力和计算成本。3. 聚类算法的选择和参数设置:聚类算法的选择和参数设置会影响子集的划分结果。论文可能使用了k-means或其他聚类算法,并对参数进行了优化。

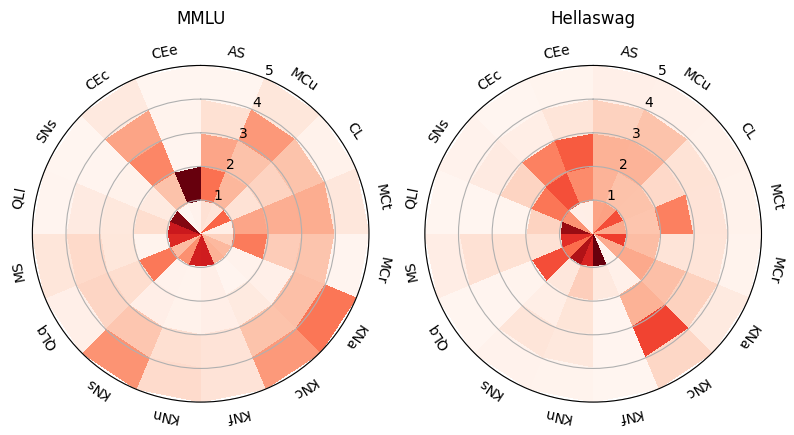

🖼️ 关键图片

📊 实验亮点

Scales++在实验中表现出色,将前期选择成本降低了18倍以上,同时保持了具有竞争力的预测准确性。在Open LLM排行榜上,仅使用0.5%的数据子集,Scales++就能以2.9%的平均绝对误差预测完整基准分数。这表明Scales++能够在显著降低评估成本的同时,保持较高的评估准确性。

🎯 应用场景

Scales++可应用于大规模语言模型的快速评估和基准测试,尤其是在资源受限或需要快速迭代的场景下。该方法能够降低评估成本,提高评估效率,并为模型开发者提供更具解释性的评估结果。此外,Scales++还可用于构建更具代表性和通用性的微型基准测试集,促进LLM的公平比较和持续改进。

📄 摘要(原文)

The prohibitive cost of evaluating large language models (LLMs) on comprehensive benchmarks necessitates the creation of small yet representative data subsets (i.e., tiny benchmarks) that enable efficient assessment while retaining predictive fidelity. Current methods for this task operate under a model-centric paradigm, selecting benchmarking items based on the collective performance of existing models. Such approaches are limited by large upfront costs, an inability to immediately handle new benchmarks (`cold-start'), and the fragile assumption that future models will share the failure patterns of their predecessors. In this work, we challenge this paradigm and propose a item-centric approach to benchmark subset selection, arguing that selection should be based on the intrinsic properties of the task items themselves, rather than on model-specific failure patterns. We instantiate this item-centric efficient benchmarking approach via a novel method, Scales++, where data selection is based on the cognitive demands of the benchmark samples. Empirically, we show Scales++ reduces the upfront selection cost by over 18x while achieving competitive predictive fidelity. On the Open LLM Leaderboard, using just a 0.5\% data subset, we predict full benchmark scores with a 2.9% mean absolute error. We demonstrate that this item-centric approach enables more efficient model evaluation without significant fidelity degradation, while also providing better cold-start performance and more interpretable benchmarking.