Beyond Benchmarks: The Economics of AI Inference

作者: Boqin Zhuang, Jiacheng Qiao, Mingqian Liu, Mingxing Yu, Ping Hong, Rui Li, Xiaoxia Song, Xiangjun Xu, Xu Chen, Yaoyao Ma, Yujie Gao

分类: cs.AI

发布日期: 2025-10-30

💡 一句话要点

构建LLM推理经济学框架,揭示成本、规模与质量间的关系

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理成本 经济学分析 生产前沿 规模经济

📋 核心要点

- 现有LLM推理成本高昂,限制了其商业化和普及,亟需量化分析推理过程的经济特性。

- 论文将LLM推理视为一种生产活动,从经济学角度分析成本、规模和质量之间的关系。

- 通过实验构建LLM推理生产前沿,揭示了边际成本递减、规模报酬递减等经济学规律。

📝 摘要(中文)

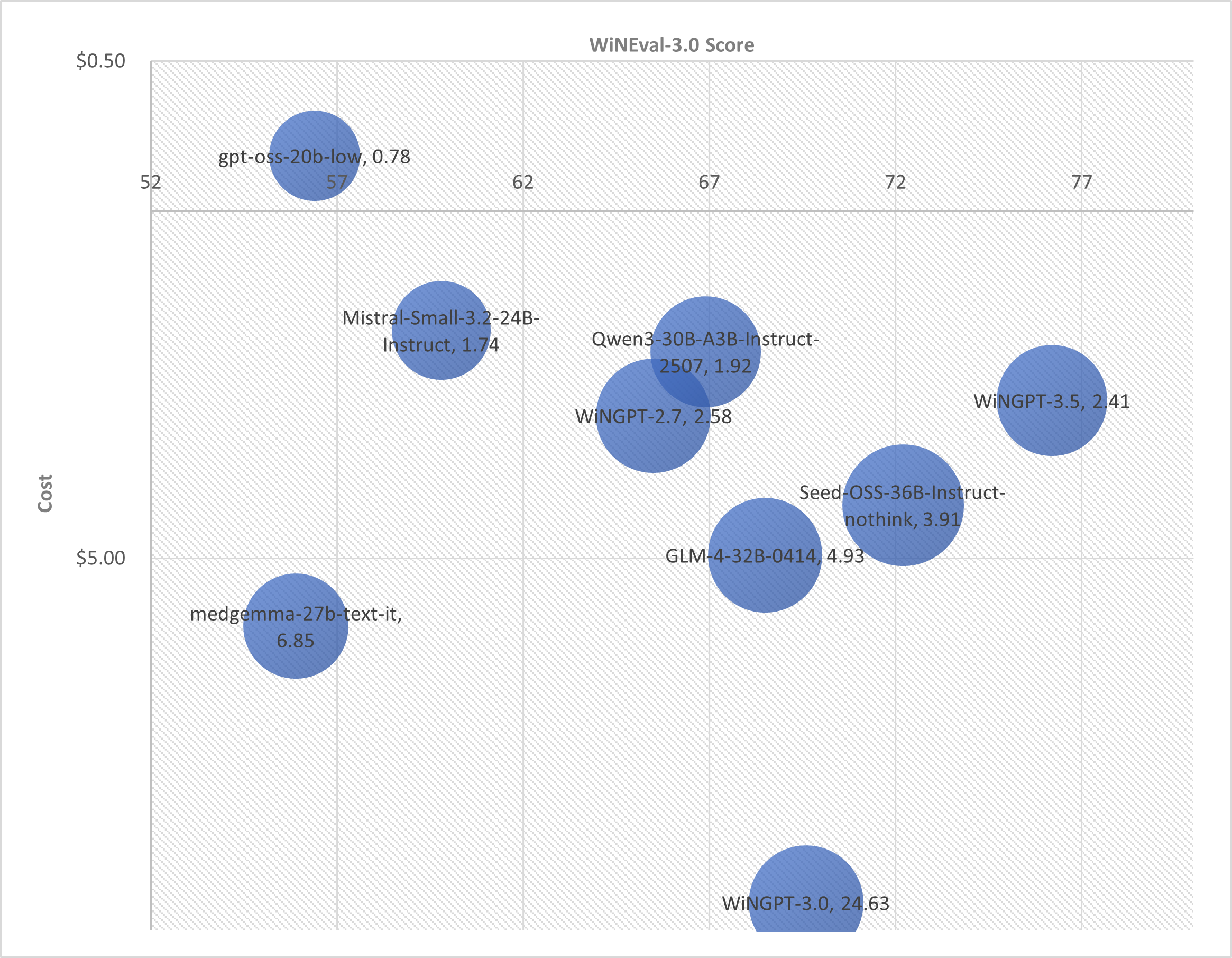

大型语言模型(LLM)的推理成本已成为决定其商业可行性和广泛应用的关键因素。本文提出了一个量化的“推理经济学”框架,将LLM推理过程视为一种计算驱动的智能生产活动。我们分析了在各种性能配置下,其边际成本、规模经济和产出质量。基于WiNEval-3.0的经验数据,我们构建了首个“LLM推理生产前沿”,揭示了三个原则:边际成本递减、规模报酬递减以及最佳成本效益区。本文不仅为模型部署决策提供了经济基础,也为未来基于市场的AI推理资源定价和优化奠定了经验基础。

🔬 方法详解

问题定义:论文旨在解决LLM推理成本高昂,缺乏有效经济学分析框架的问题。现有方法主要关注模型压缩、加速等技术手段,忽略了推理过程的经济特性,无法指导模型部署和资源分配。

核心思路:论文的核心思路是将LLM推理过程视为一种生产活动,借鉴经济学理论,分析其成本、规模和产出质量之间的关系。通过量化这些关系,可以更好地理解LLM推理的经济特性,从而优化模型部署和资源分配。

技术框架:论文构建了一个量化的“推理经济学”框架,主要包含以下几个阶段:1) 数据收集:使用WiNEval-3.0数据集,收集不同LLM在不同配置下的推理性能数据。2) 成本建模:建立LLM推理的成本模型,考虑计算资源、能源消耗等因素。3) 经济学分析:分析LLM推理的边际成本、规模经济和产出质量之间的关系。4) 生产前沿构建:基于实验数据,构建LLM推理的生产前沿,揭示最佳成本效益区。

关键创新:论文最重要的技术创新点在于将经济学理论引入LLM推理分析,提出了“推理经济学”框架。与现有方法相比,该框架不仅关注技术指标,还关注经济效益,可以更全面地评估LLM推理的性能。此外,构建“LLM推理生产前沿”也为模型部署和资源分配提供了新的视角。

关键设计:论文的关键设计包括:1) 使用WiNEval-3.0数据集进行实验,保证了实验结果的可靠性。2) 建立了合理的成本模型,考虑了计算资源和能源消耗等因素。3) 使用经济学指标(如边际成本、规模经济)来分析LLM推理的性能。4) 构建了“LLM推理生产前沿”,可视化了成本、规模和质量之间的关系。

🖼️ 关键图片

📊 实验亮点

论文基于WiNEval-3.0数据集,构建了首个“LLM推理生产前沿”,揭示了LLM推理的边际成本递减、规模报酬递减等经济学规律。实验结果表明,存在一个最佳成本效益区,可以在保证推理质量的前提下,显著降低推理成本。这些发现为LLM的部署和资源分配提供了重要的指导。

🎯 应用场景

该研究成果可应用于LLM的部署和资源分配优化,帮助企业降低推理成本,提高商业可行性。此外,该框架还可用于AI推理资源的定价和市场化,促进AI技术的广泛应用。未来,该研究可扩展到其他AI模型和任务,为AI经济学研究提供理论基础。

📄 摘要(原文)

The inference cost of Large Language Models (LLMs) has become a critical factor in determining their commercial viability and widespread adoption. This paper introduces a quantitative

economics of inference'' framework, treating the LLM inference process as a compute-driven intelligent production activity. We analyze its marginal cost, economies of scale, and quality of output under various performance configurations. Based on empirical data from WiNEval-3.0, we construct the firstLLM Inference Production Frontier,'' revealing three principles: diminishing marginal cost, diminishing returns to scale, and an optimal cost-effectiveness zone. This paper not only provides an economic basis for model deployment decisions but also lays an empirical foundation for the future market-based pricing and optimization of AI inference resources.