Mutual Wanting in Human--AI Interaction: Empirical Evidence from Large-Scale Analysis of GPT Model Transitions

作者: HaoYang Shang, Xuan Liu

分类: cs.CY, cs.AI

发布日期: 2025-10-27 (更新: 2025-11-14)

💡 一句话要点

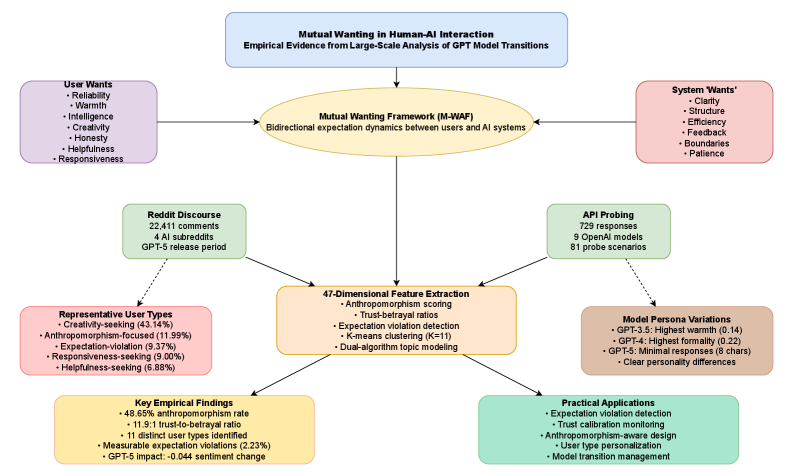

提出互需对齐框架M-WAF,用于量化人机交互中用户期望与AI行为的匹配程度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 大型语言模型 用户期望 互需 情感分析 主题建模 用户体验

📋 核心要点

- 现有方法缺乏对人机交互中双向期望的量化分析,难以有效管理用户期望和提升AI系统的可信度。

- 提出“互需”概念,通过分析用户评论和受控实验,量化用户对AI的期望以及AI对用户的响应,从而理解人机交互中的双向需求动态。

- 实验结果表明,用户存在明显的“互需”类型,且模型更新后存在期望违背现象,验证了互需概念的可行性,并为AI系统设计提供了指导。

📝 摘要(中文)

大型语言模型(LLM)的快速发展在用户和AI系统之间产生了复杂的双向期望,但对此的理解尚不充分。本文引入“互需”概念,分析模型重大转变期间的这些期望。通过分析主要AI论坛的用户评论以及跨多个OpenAI模型的受控实验,我们首次对人机交互中的双向需求动态进行了大规模实证验证。研究结果表明,近一半的用户使用拟人化语言,信任语言明显超过背叛语言,并且用户聚集成不同的“互需”类型。我们识别出可测量的期望违背模式,并量化了主要模型发布后期望与现实之间的差距。利用包括双算法主题建模和多维特征提取在内的先进NLP技术,我们开发了互需对齐框架(M-WAF),该框架具有主动用户体验管理和AI系统设计的实际应用。这些发现确立了互需作为一种可测量的现象,对构建更值得信赖和关系感知的AI系统具有明确的意义。

🔬 方法详解

问题定义:论文旨在解决人机交互中用户对AI系统的期望与AI系统实际表现不一致的问题。现有方法缺乏对这种双向期望的有效量化和管理,导致用户体验下降,AI系统信任度降低。具体来说,论文关注的是大型语言模型(LLM)更新换代时,用户期望的变化以及期望与现实之间的差距。

核心思路:论文的核心思路是引入“互需”的概念,将人机交互视为一个双向需求匹配的过程。通过分析用户在AI论坛上的评论以及设计受控实验,量化用户对AI的期望(例如,AI是否能理解人类情感,是否值得信任),以及AI系统在多大程度上满足了这些期望。通过识别期望违背模式,可以更好地理解用户需求,并指导AI系统的设计和优化。

技术框架:论文提出了互需对齐框架(M-WAF),该框架包含以下几个主要模块:1) 数据收集:从AI论坛收集用户评论,并设计受控实验以获取用户对不同AI模型的反馈。2) 特征提取:利用自然语言处理技术,提取用户评论中的情感、信任度、拟人化程度等特征。3) 主题建模:使用双算法主题建模技术,识别用户评论中的主要话题和期望。4) 期望违背分析:量化用户期望与AI系统实际表现之间的差距,识别期望违背模式。5) 用户类型聚类:根据用户的“互需”特征,将用户聚集成不同的类型。

关键创新:论文的关键创新在于:1) 首次提出“互需”概念,为分析人机交互中的双向期望提供了一个新的视角。2) 开发了互需对齐框架(M-WAF),能够量化用户期望与AI系统表现之间的差距。3) 通过大规模实证研究,验证了“互需”概念的可行性,并识别出用户期望违背模式。

关键设计:在特征提取方面,论文使用了多种NLP技术,包括情感分析、信任度分析和拟人化程度分析。在主题建模方面,论文采用了双算法主题建模技术,结合了LDA和NMF两种算法的优点。在期望违背分析方面,论文定义了多种指标来量化用户期望与AI系统表现之间的差距,例如期望满足率、期望违背率等。具体的参数设置和损失函数等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

研究发现近一半的用户在与AI交互时使用拟人化语言,表明用户倾向于将AI视为具有情感和意图的实体。信任语言的使用频率显著高于背叛语言,反映了用户对AI系统的整体信任态度。通过聚类分析,识别出不同的“互需”用户类型,为个性化AI服务提供了依据。模型更新后,用户期望与现实之间存在显著差距,表明需要更加关注模型更新对用户体验的影响。

🎯 应用场景

该研究成果可应用于AI系统的用户体验管理和设计。通过M-WAF框架,开发者可以主动监测用户对AI系统的期望变化,及时发现并解决期望违背问题,从而提升用户满意度和信任度。此外,该研究还可以指导AI系统的设计,使其更好地满足用户需求,构建更值得信赖和关系感知的AI系统。

📄 摘要(原文)

The rapid evolution of large language models (LLMs) creates complex bidirectional expectations between users and AI systems that are poorly understood. We introduce the concept of "mutual wanting" to analyze these expectations during major model transitions. Through analysis of user comments from major AI forums and controlled experiments across multiple OpenAI models, we provide the first large-scale empirical validation of bidirectional desire dynamics in human-AI interaction. Our findings reveal that nearly half of users employ anthropomorphic language, trust significantly exceeds betrayal language, and users cluster into distinct "mutual wanting" types. We identify measurable expectation violation patterns and quantify the expectation-reality gap following major model releases. Using advanced NLP techniques including dual-algorithm topic modeling and multi-dimensional feature extraction, we develop the Mutual Wanting Alignment Framework (M-WAF) with practical applications for proactive user experience management and AI system design. These findings establish mutual wanting as a measurable phenomenon with clear implications for building more trustworthy and relationally-aware AI systems.