Alita-G: Self-Evolving Generative Agent for Agent Generation

作者: Jiahao Qiu, Xuan Qi, Hongru Wang, Xinzhe Juan, Yimin Wang, Zelin Zhao, Jiayi Geng, Jiacheng Guo, Peihang Li, Jingzhe Shi, Shilong Liu, Mengdi Wang

分类: cs.AI

发布日期: 2025-10-27

备注: 15 pages, 3 figures

💡 一句话要点

ALITA-G:一种自进化生成式Agent,通过生成、抽象和管理MCP工具实现Agent的领域专家化。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自进化Agent 生成式Agent 模型上下文协议 领域专家化 知识蒸馏

📋 核心要点

- 现有自进化Agent主要局限于prompt重写或失败重试,缺乏系统性的领域知识学习和工具构建机制。

- ALITA-G通过生成、抽象和管理模型上下文协议(MCP)工具,使通用Agent能够自进化为领域专家。

- 实验表明,ALITA-G在多个基准测试中取得了显著的性能提升,同时降低了计算成本,实现了精度和效率的双赢。

📝 摘要(中文)

本文提出了一种自进化框架ALITA-G,旨在将通用Agent转化为领域专家。该框架通过系统地生成、抽象和管理模型上下文协议(MCP)工具来实现这一目标。ALITA-G首先让通用Agent执行一系列目标领域的任务,并从成功的轨迹中合成候选MCP。然后,这些MCP被抽象成参数化的原语,并整合到MCP Box中。在推理阶段,ALITA-G利用工具的描述和用例进行检索增强的MCP选择,然后执行配备MCP执行器的Agent。在GAIA、PathVQA和Humanity's Last Exam等多个基准测试中,ALITA-G取得了显著的性能提升,同时降低了计算成本。在GAIA验证集上,ALITA-G达到了83.03%的pass@1和89.09%的pass@3,创造了新的state-of-the-art结果,并且相对于强大的基线Agent,每个样本的平均token数量减少了约15%。ALITA-G为从通用能力到可重用的、特定领域能力的转化提供了一条有原则的途径,从而提高了复杂推理任务的准确性和效率。

🔬 方法详解

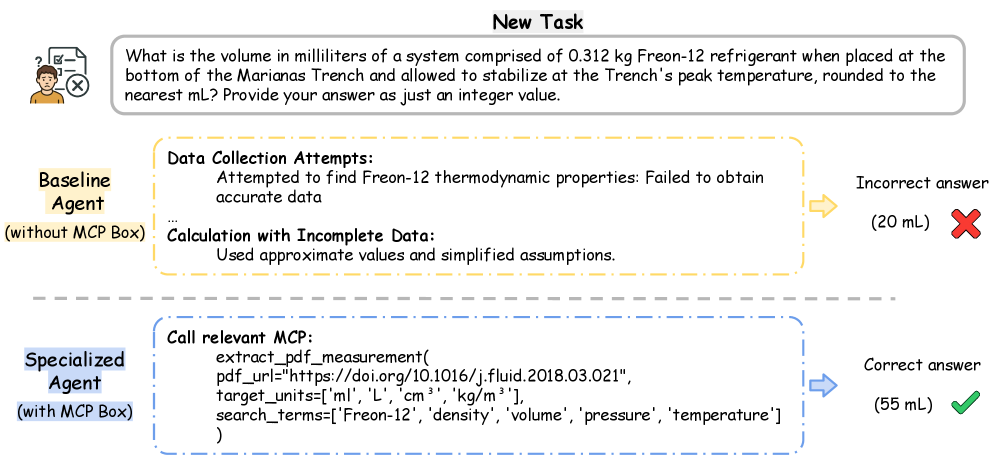

问题定义:现有的大语言模型Agent在特定领域任务中表现受限,缺乏领域知识和专用工具。现有的自进化Agent主要集中在prompt优化和错误重试,无法系统地学习和利用领域知识,导致性能提升有限。

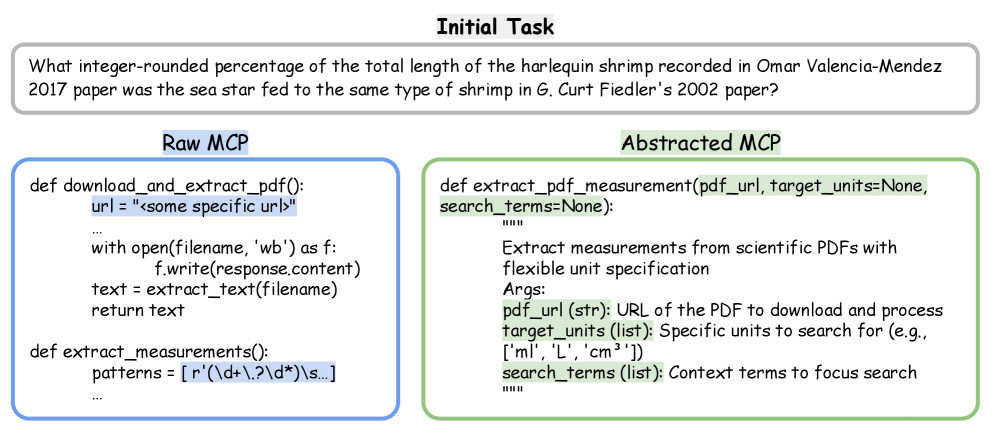

核心思路:ALITA-G的核心思路是通过让通用Agent在特定领域任务中学习,并自动生成、抽象和管理模型上下文协议(MCP)工具,从而使Agent具备领域专家的能力。这种方法允许Agent在推理时根据任务需求动态选择合适的MCP工具,提高解决问题的效率和准确性。

技术框架:ALITA-G框架包含以下主要模块:1) 任务执行:通用Agent执行目标领域的任务。2) MCP生成:从成功的任务执行轨迹中合成候选MCP。3) MCP抽象:将候选MCP抽象成参数化的原语。4) MCP管理:将抽象后的MCP存储在MCP Box中,并提供检索功能。5) MCP选择:在推理时,根据任务描述和MCP的用例,选择合适的MCP。6) Agent执行:配备MCP执行器的Agent执行任务。

关键创新:ALITA-G的关键创新在于其自进化的MCP生成和管理机制。与手动设计的工具或简单的prompt优化相比,ALITA-G能够自动地从任务执行过程中学习并提炼出可重用的MCP工具,从而实现Agent的领域专家化。这种自进化机制使得Agent能够不断适应新的任务和领域,提高其通用性和鲁棒性。

关键设计:MCP的生成过程依赖于对成功任务轨迹的分析,提取关键的上下文信息和操作步骤。MCP的抽象过程将具体的上下文信息参数化,使其能够应用于不同的任务实例。MCP的选择过程使用检索增强的方法,根据任务描述和MCP的用例,选择最相关的MCP。具体参数设置和损失函数等细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

ALITA-G在GAIA验证集上取得了83.03%的pass@1和89.09%的pass@3,创造了新的state-of-the-art结果。同时,相对于强大的基线Agent,每个样本的平均token数量减少了约15%,表明ALITA-G在提高准确性的同时,也降低了计算成本。

🎯 应用场景

ALITA-G具有广泛的应用前景,例如可以应用于医疗诊断、金融分析、法律咨询等需要专业知识的领域。通过自进化学习和工具构建,ALITA-G可以帮助Agent在这些领域中提供更准确、更高效的服务,从而提高工作效率和决策质量。未来,ALITA-G有望成为构建智能助手和自动化系统的关键技术。

📄 摘要(原文)

Large language models (LLMs) have been shown to perform better when scaffolded into agents with memory, tools, and feedback. Beyond this, self-evolving agents have emerged, but current work largely limits adaptation to prompt rewriting or failure retries. Therefore, we present ALITA-G, a self-evolution framework that transforms a general-purpose agent into a domain expert by systematically generating, abstracting, and curating Model Context Protocol (MCP) tools. In this framework, a generalist agent executes a curated suite of target-domain tasks and synthesizes candidate MCPs from successful trajectories. These are then abstracted to parameterized primitives and consolidated into an MCP Box. At inference time, ALITA-G performs retrieval-augmented MCP selection with the help of each tool's descriptions and use cases, before executing an agent equipped with the MCP Executor. Across several benchmarks GAIA, PathVQA, and Humanity's Last Exam, ALITA-G attains strong gains while reducing computation costs. On GAIA validation, it achieves 83.03% pass@1 and 89.09% pass@3, establishing a new state-of-the-art result while reducing mean tokens per example by approximately 15% relative to a strong baseline agent. ALITA-G thus provides a principled pathway from generalist capability to reusable, domain-specific competence, improving both accuracy and efficiency on complex reasoning tasks.