Policy-Aware Generative AI for Safe, Auditable Data Access Governance

作者: Shames Al Mandalawi, Muzakkiruddin Ahmed Mohammed, Hendrika Maclean, Mert Can Cakmak, John R. Talburt

分类: cs.AI

发布日期: 2025-10-27

备注: The 17th International Conference on Knowledge and Systems Engineering

💡 一句话要点

提出一种策略感知的生成式AI,用于安全、可审计的数据访问治理。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数据访问控制 大型语言模型 策略感知 访问治理 安全审计

📋 核心要点

- 现有数据访问决策方法难以同时满足最小权限原则、法规遵从和可审计性要求。

- 提出一种策略感知的控制器,利用LLM解释自然语言请求,并结合书面策略和元数据进行决策。

- 实验结果表明,该方法显著提高了决策的准确性、召回率和合规性,同时保持了较低的延迟。

📝 摘要(中文)

企业需要满足最小权限原则、符合法规且保持可审计性的访问决策。本文提出了一种策略感知的控制器,该控制器使用大型语言模型(LLM)来解释针对书面策略和元数据的自然语言请求,而不是原始数据。该系统使用Google Gemini 2.0 Flash实现,执行一个六阶段的推理框架(上下文解释、用户验证、数据分类、业务目的测试、合规性映射和风险综合),具有早期硬策略门控和默认拒绝机制。系统返回APPROVE、DENY、CONDITIONAL以及引用的控制和机器可读的理由。在七个场景系列的十四个规范案例上,使用隐私保护基准进行评估。结果表明,应用策略门控后,精确决策匹配从10/14提高到13/14(92.9%),DENY召回率提高到1.00,必须拒绝系列的错误批准率降至0,功能适当性和合规性坚持度达到14/14。专家对理由质量的评价很高,中位延迟低于一分钟。这些发现表明,策略约束的LLM推理,结合显式门控和审计跟踪,可以将人类可读的策略转化为安全、合规和可追溯的机器决策。

🔬 方法详解

问题定义:企业数据访问控制面临着多重挑战,既要确保用户能够访问所需数据,又要满足最小权限原则,同时还要符合各种法规要求,并保证整个过程的可审计性。现有方法往往难以兼顾这些方面,例如,基于角色的访问控制(RBAC)可能过于粗粒度,而基于属性的访问控制(ABAC)则可能过于复杂,难以维护和审计。此外,如何将自然语言形式的策略转化为机器可执行的规则也是一个难题。

核心思路:本文的核心思路是利用大型语言模型(LLM)的强大自然语言理解和推理能力,将人类可读的策略转化为机器可执行的决策。通过将LLM与显式的策略门控和审计跟踪相结合,可以实现安全、合规和可追溯的数据访问控制。这种方法的核心在于不直接访问原始数据,而是基于元数据和策略进行推理,从而降低了数据泄露的风险。

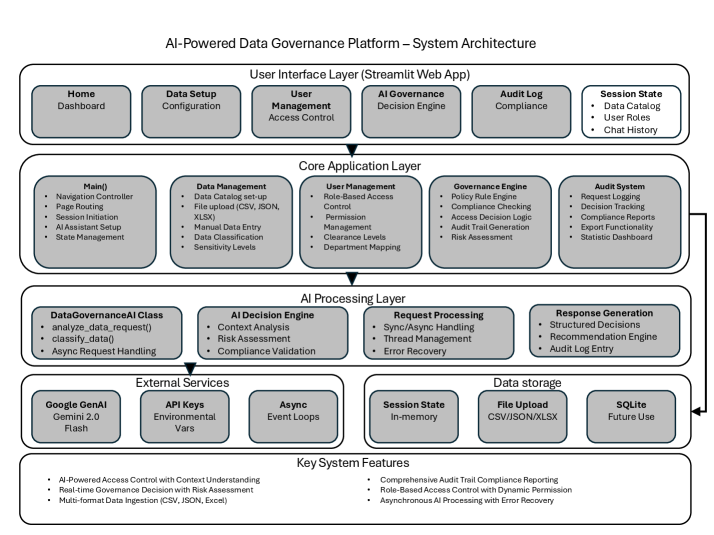

技术框架:该系统的整体架构包含一个六阶段的推理框架:1) 上下文解释:理解用户请求的含义;2) 用户验证:验证用户的身份和权限;3) 数据分类:确定请求访问的数据的敏感程度;4) 业务目的测试:评估请求的业务目的是否合理;5) 合规性映射:检查请求是否符合相关法规;6) 风险综合:综合考虑所有因素,评估请求的风险。在推理过程中,系统会应用早期硬策略门控,即在早期阶段就排除明显不合规的请求。此外,系统采用默认拒绝机制,即除非明确批准,否则所有请求都将被拒绝。

关键创新:该方法最重要的技术创新点在于将LLM应用于数据访问控制,并结合了显式的策略门控和审计跟踪。与传统的访问控制方法相比,该方法能够更好地理解自然语言形式的策略,并能够生成机器可读的决策理由。此外,通过策略门控和默认拒绝机制,可以有效地降低错误批准的风险。

关键设计:该系统使用Google Gemini 2.0 Flash作为LLM,并针对数据访问控制任务进行了微调。策略门控的设计需要仔细考虑各种策略的优先级和相互关系。审计跟踪的设计需要记录所有决策过程的细节,以便进行事后分析和合规性检查。此外,还需要设计合适的评估指标来衡量系统的性能,例如精确决策匹配、召回率和错误批准率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,应用策略门控后,精确决策匹配从10/14提高到13/14(92.9%),DENY召回率提高到1.00,必须拒绝系列的错误批准率降至0,功能适当性和合规性坚持度达到14/14。专家对理由质量的评价很高,中位延迟低于一分钟。这些数据表明,该方法在保证安全性和合规性的同时,也具有较高的效率。

🎯 应用场景

该研究成果可应用于各种需要严格数据访问控制的场景,例如医疗保健、金融服务和政府部门。它可以帮助企业更好地保护敏感数据,遵守相关法规,并提高数据访问控制的效率和透明度。未来,该技术还可以扩展到其他领域,例如物联网设备的安全访问控制。

📄 摘要(原文)

Enterprises need access decisions that satisfy least privilege, comply with regulations, and remain auditable. We present a policy aware controller that uses a large language model (LLM) to interpret natural language requests against written policies and metadata, not raw data. The system, implemented with Google Gemini~2.0 Flash, executes a six-stage reasoning framework (context interpretation, user validation, data classification, business purpose test, compliance mapping, and risk synthesis) with early hard policy gates and deny by default. It returns APPROVE, DENY, CONDITIONAL together with cited controls and a machine readable rationale. We evaluate on fourteen canonical cases across seven scenario families using a privacy preserving benchmark. Results show Exact Decision Match improving from 10/14 to 13/14 (92.9\%) after applying policy gates, DENY recall rising to 1.00, False Approval Rate on must-deny families dropping to 0, and Functional Appropriateness and Compliance Adherence at 14/14. Expert ratings of rationale quality are high, and median latency is under one minute. These findings indicate that policy constrained LLM reasoning, combined with explicit gates and audit trails, can translate human readable policies into safe, compliant, and traceable machine decisions.