Smaller Models, Smarter Rewards: A Two-Sided Approach to Process and Outcome Rewards

作者: Jan Niklas Groeneveld, Xi Qin, Alexander Schaefer, Yaad Oren

分类: cs.AI, cs.LG, cs.SE

发布日期: 2025-10-27 (更新: 2025-12-10)

备注: Accepted and presented at NeurIPS 2025 Workshop: Foundations of Reasoning in Language Models

💡 一句话要点

利用小型语言模型,结合过程与结果奖励,提升代码生成质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 奖励模型 小型语言模型 过程奖励 结果奖励 价值头模型 监督微调

📋 核心要点

- 大型语言模型生成高质量代码仍具挑战,奖励模型是改进的关键,但模型大小与性能的权衡是难题。

- 论文探索利用小型语言模型作为奖励模型,融合过程和结果奖励,以提升代码生成质量。

- 实验表明,小型LLM可有效评估代码,提升搜索能力超20%,验证了其作为奖励模型的潜力。

📝 摘要(中文)

大型语言模型(LLM)在生成高质量代码方面仍面临挑战。奖励模型是提升推理模型性能的关键中间步骤,用于评估中间步骤或最终结果的优劣。本文探讨了如何将Phi-4系列等先进的小型语言模型转化为有效的奖励模型,同时考虑过程奖励和结果奖励。为此,作者构建了一个包含代码样本及其正确性标签的数据集,数据来源于APPS代码挑战基准。然后,训练了一个价值头模型来估计中间输出的成功概率。评估结果表明,小型LLM能够作为有效的奖励模型或代码评估评论员,成功识别多个候选方案中的正确解决方案。使用该评论员,在多次生成中,最准确代码的搜索能力提升超过20%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在代码生成任务中,如何利用更小的模型构建有效的奖励模型,从而提升代码生成质量的问题。现有方法通常依赖于大型模型,但计算成本高昂,且小型模型的能力尚未充分挖掘。

核心思路:论文的核心思路是利用小型语言模型(如Phi-4系列),通过监督微调的方式,使其具备评估代码质量的能力。关键在于构建一个同时考虑过程奖励(中间步骤的正确性)和结果奖励(最终输出的正确性)的奖励模型。

技术框架:整体框架包括以下几个主要步骤:1) 构建数据集:使用APPS代码挑战基准,收集代码样本并标注正确性标签。2) 训练价值头模型:在小型语言模型的基础上,添加一个回归层(价值头),并使用监督学习的方式进行微调,使其能够预测代码中间输出的成功概率。3) 评估奖励模型:使用训练好的奖励模型评估多个候选代码方案,并选择得分最高的方案。4) 搜索能力评估:通过多次生成代码,并使用奖励模型进行评估,观察最准确代码的搜索能力提升情况。

关键创新:论文的关键创新在于探索了小型语言模型作为奖励模型的潜力,并提出了一种融合过程和结果奖励的训练方法。与以往主要依赖大型模型的方法不同,该方法能够在计算资源有限的情况下,有效地提升代码生成质量。

关键设计:论文的关键设计包括:1) 数据集的构建:使用APPS基准保证了数据集的多样性和难度。2) 价值头模型的训练:使用均方误差(MSE)等回归损失函数,优化价值头模型的预测精度。3) 奖励模型的评估:采用准确率、召回率等指标,评估奖励模型识别正确代码的能力。4) 搜索能力评估:通过多次生成和评估,衡量奖励模型对代码生成质量的提升效果。

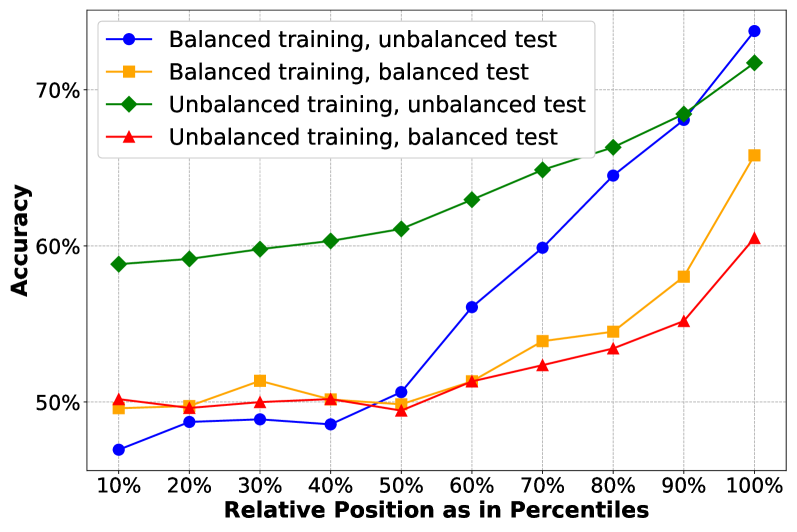

🖼️ 关键图片

📊 实验亮点

实验结果表明,小型LLM能够作为有效的奖励模型,成功识别多个候选方案中的正确解决方案。使用该奖励模型,在多次生成中,最准确代码的搜索能力提升超过20%。这表明,即使是小型语言模型,通过合适的训练方法,也能在代码生成任务中发挥重要作用。

🎯 应用场景

该研究成果可应用于代码自动生成、代码质量评估、智能编程助手等领域。通过利用小型语言模型构建高效的奖励模型,可以降低计算成本,并提升代码生成质量,从而加速软件开发过程,提高开发效率。未来,该方法有望推广到其他自然语言处理任务中,例如文本摘要、机器翻译等。

📄 摘要(原文)

Generating high-quality code remains a challenge for Large Language Models (LLMs). For the evolution of reasoning models on this task, reward models are a necessary intermediate step. These models judge outcomes or intermediate steps. Decoder-only transformer models can be turned into reward models by introducing a regression layer and supervised fine-tuning. While it is known that reflection capabilities generally increase with the size of a model, we want to investigate whether state-of-the-art small language models like the Phi-4 family can be turned into usable reward models blending the consideration of process rewards and outcome rewards. Targeting this goal, we construct a dataset of code samples with correctness labels derived from the APPS coding challenge benchmark. We then train a value-head model to estimate the success probability of intermediate outputs. Our evaluation shows that small LLMs are capable of serving as effective reward models or code evaluation critics, successfully identifying correct solutions among multiple candidates. Using this critic, we achieve over a 20% improvement in the search capability of the most accurate code out of multiple generations.