The Zero-Step Thinking: An Empirical Study of Mode Selection as Harder Early Exit in Reasoning Models

作者: Yuqiao Tan, Shizhu He, Kang Liu, Jun Zhao

分类: cs.AI, cs.CL

发布日期: 2025-10-22

备注: Accepted by NeurIPS'25 Efficient Reasoning Workshop

🔗 代码/项目: GITHUB

💡 一句话要点

研究推理模型中模式选择作为更难的提前退出问题,揭示现有方法在零步思维下的局限性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 推理模型 模式选择 提前退出 零步思维 链式思考 计算效率 提示学习

📋 核心要点

- 推理模型存在过度思考问题,导致计算开销增加,需要有效的方法来减少不必要的计算。

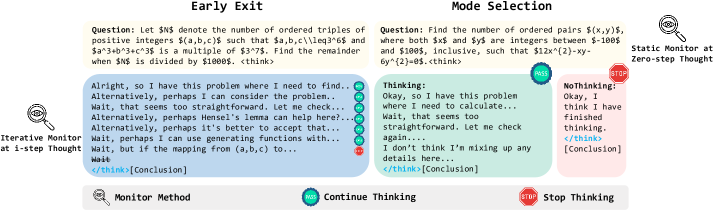

- 论文将模式选择定义为更具挑战性的提前退出问题,核心在于如何在推理开始前做出选择,即零步思维。

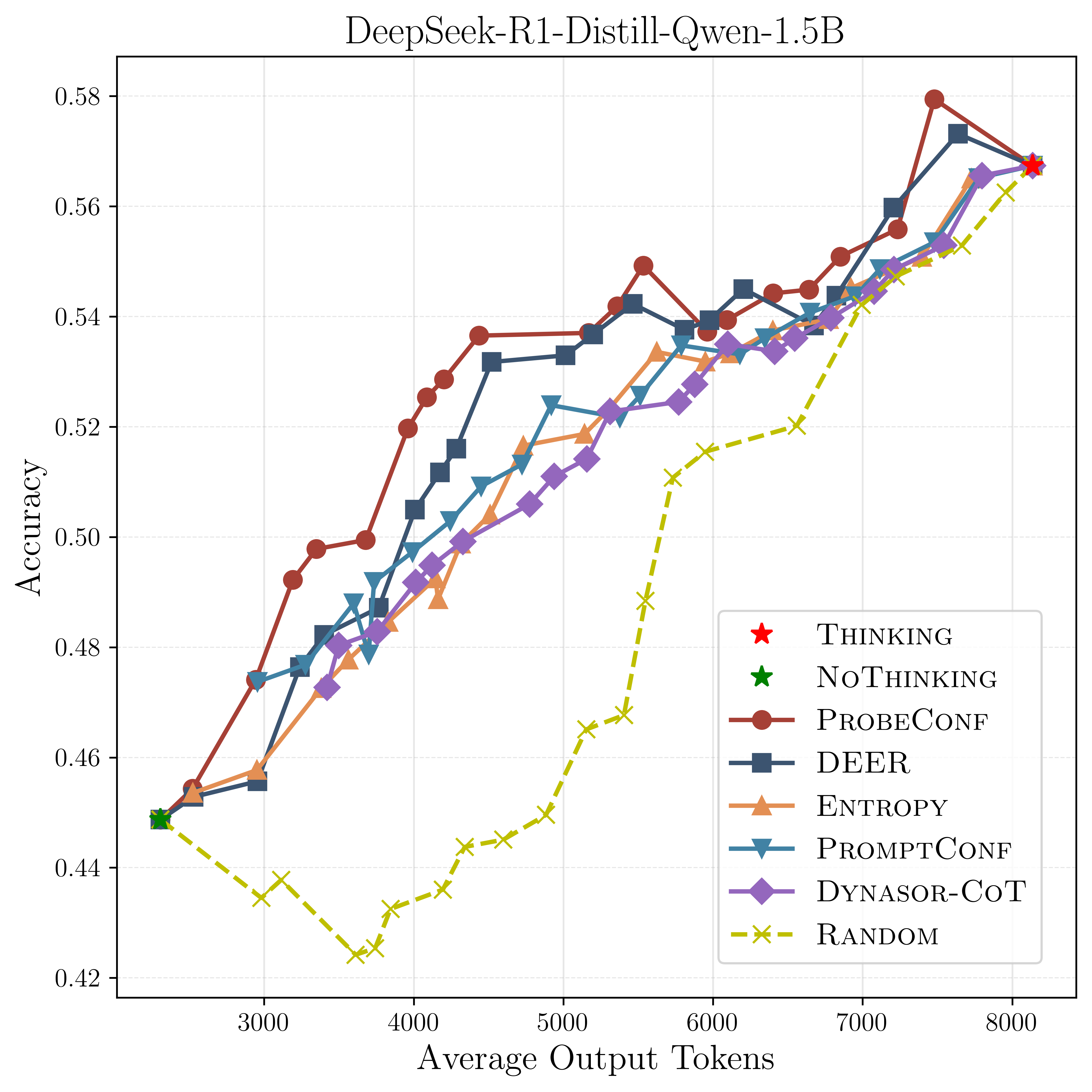

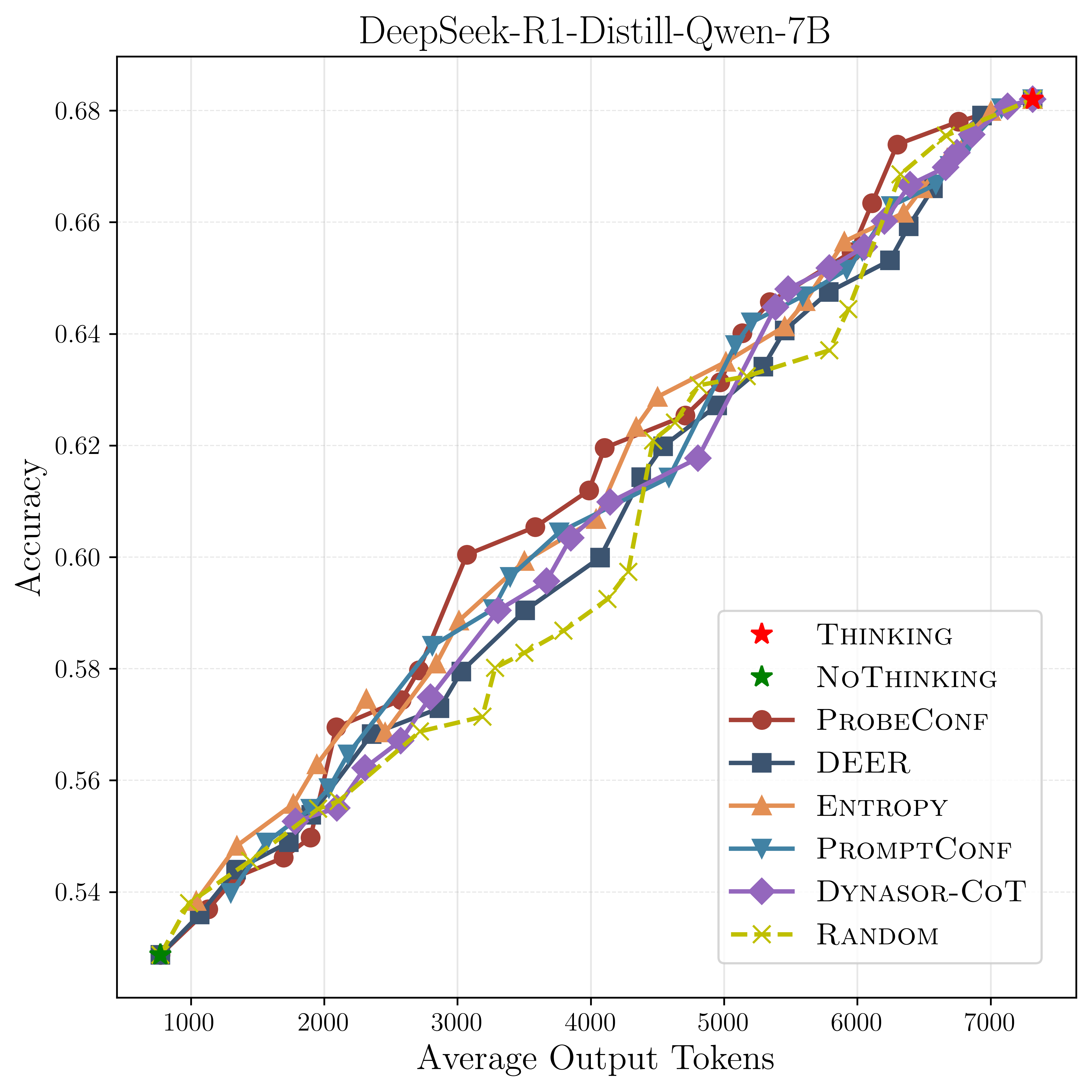

- 实验表明,基于提示的方法在信息有限的情况下表现不佳,而利用内部信息的方法虽然更好,但仍存在稳定性问题。

📝 摘要(中文)

推理模型在数学和逻辑推理等任务中表现出色,这主要归功于其逐步思考的能力。然而,这也常常导致过度思考,造成不必要的计算开销。模式选择旨在通过思考或不思考模式自动决定使用长链思考(Long-CoT)或短链思考(Short-CoT)。同时,提前退出(Early Exit)确定迭代推理过程中的最佳停止点。这两种方法都旨在减少计算负担。本文首先将模式选择定义为提前退出的一个更具挑战性的变体,因为它们具有相似的目标,但在决策时机上有所不同。提前退出侧重于在推理时确定简洁推理的最佳停止点,而模式选择必须在推理过程开始时做出此决定,依赖于预定义的虚假思考,而无需进行显式推理过程,即零步思维。通过对九个基线的实证研究,我们观察到,基于提示的方法通常会失败,因为当提供最少的手工信息时,它们的分类能力有限。相比之下,利用内部信息的方法通常在大多数情况下表现更好,但仍然存在稳定性问题。我们的研究结果表明,仅依赖模型提供的信息的现有方法不足以有效地解决信息有限场景中的模式选择问题,突出了该任务的持续挑战。

🔬 方法详解

问题定义:论文旨在解决推理模型中存在的过度思考问题,即模型在推理过程中进行了不必要的计算步骤,导致计算资源浪费。现有方法,如提前退出,虽然可以减少计算量,但模式选择需要在推理开始前就决定是否进行详细推理,这比提前退出更具挑战性。现有方法在信息有限的情况下难以做出准确的模式选择,导致性能下降。

核心思路:论文的核心思路是将模式选择问题视为一个零步思维问题,即在没有任何实际推理步骤的情况下,模型需要根据输入信息判断是否需要进行详细的链式思考(Chain-of-Thought)。这种思路的关键在于如何有效地利用有限的信息来做出准确的决策,避免过度思考或思考不足。

技术框架:论文主要通过实验分析现有方法在模式选择任务上的表现。具体来说,作者选取了九个基线模型,并在不同的数据集上进行了测试。这些基线模型包括基于提示的方法和利用内部信息的方法。通过分析实验结果,作者揭示了现有方法在零步思维场景下的局限性。

关键创新:论文的关键创新在于将模式选择问题定义为一个零步思维问题,并指出现有方法在信息有限的情况下难以有效解决该问题。这种新的视角有助于研究者更好地理解模式选择的挑战,并开发更有效的方法。

关键设计:论文主要关注实验分析,没有提出新的模型或算法。实验中,作者使用了不同的提示策略和内部信息利用方法,并评估了它们在模式选择任务上的性能。具体的参数设置和网络结构取决于所使用的基线模型。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于提示的方法在模式选择任务中表现不佳,而利用内部信息的方法虽然有所改善,但仍存在稳定性问题。这表明现有方法在零步思维场景下存在局限性,需要进一步的研究来解决信息有限情况下的模式选择问题。具体性能数据和提升幅度在论文中详细给出。

🎯 应用场景

该研究成果可应用于各种需要高效推理的场景,例如智能问答、对话系统和机器人控制。通过减少不必要的计算,可以提高系统的响应速度和资源利用率,降低部署成本。未来的研究可以探索更有效的零步思维方法,进一步提升推理效率。

📄 摘要(原文)

Reasoning models have demonstrated exceptional performance in tasks such as mathematics and logical reasoning, primarily due to their ability to engage in step-by-step thinking during the reasoning process. However, this often leads to overthinking, resulting in unnecessary computational overhead. To address this issue, Mode Selection aims to automatically decide between Long-CoT (Chain-of-Thought) or Short-CoT by utilizing either a Thinking or NoThinking mode. Simultaneously, Early Exit determines the optimal stopping point during the iterative reasoning process. Both methods seek to reduce the computational burden. In this paper, we first identify Mode Selection as a more challenging variant of the Early Exit problem, as they share similar objectives but differ in decision timing. While Early Exit focuses on determining the best stopping point for concise reasoning at inference time, Mode Selection must make this decision at the beginning of the reasoning process, relying on pre-defined fake thoughts without engaging in an explicit reasoning process, referred to as zero-step thinking. Through empirical studies on nine baselines, we observe that prompt-based approaches often fail due to their limited classification capabilities when provided with minimal hand-crafted information. In contrast, approaches that leverage internal information generally perform better across most scenarios but still exhibit issues with stability. Our findings indicate that existing methods relying solely on the information provided by models are insufficient for effectively addressing Mode Selection in scenarios with limited information, highlighting the ongoing challenges of this task. Our code is available at https://github.com/Trae1ounG/Zero_Step_Thinking.